まとめ

2026.世界の安全保障は根本的な変容を遂げつつある。 人工知能のセキュリティその風景は根本的な再構築を迫られている。世界的な最大480万人の人口減少に対応してサイバーセキュリティ人材の格差AI技術が爆発的に普及するたびに、組織は24時間365日稼働するAIインテリジェンスの大規模モデルを大量に適用している。しかしパロアルトネットワークス、ムーディーズ、クラウドストライクなどのセキュリティ機関は、AIインテリジェンスが2026年に企業にとって最大の内部脅威/外部脅威となると警告している。従来の防御の枠組みは破綻しつつあり、新しいAI主導のセキュリティ・システムが新たなセキュリティ・パラダイムとなっている。

I. AIセキュリティ危機の本質

1.1 人材格差に起因する配備リスク

世界的なサイバーセキュリティのスキル格差は480万職に達している。具体的には

- 95% サイバーセキュリティ・チームのうち、少なくとも1つは重大なスキル不足がある。

- 54% 機密データを特定するために、エラーの起きやすい開発者の文書に依存している企業がある。

- 19%のみ 組織はAPIリストの正確さに "非常に自信を持っている"。

人材不足に直面して、企業は積極的な展開戦略を採っている。ガートナーは、2026年末までに、人材不足に直面する企業の数が増加すると予測している。40%の企業向けアプリがAIインテリジェンス機関を統合へ(2025年初頭には5%未満)。この急激な成長は、企業の緊急性を反映しているが、根本的な矛盾も露呈している。組織は、不十分なテストのAIシステムでセキュリティ専門知識のギャップを埋めようとしているのだ。

1.2 「スーパーユーザー問題」特権の危機

迅速な導入と効率的な運用のために、組織はしばしばAIインテリジェンスに過剰な権限(データベースへのアクセス、APIコール、システム管理者権限、メールシステムへのアクセスなど)を与えてしまう。これは「スーパーユーザー問題」として知られている。

パロアルトネットワークスのチーフ・セキュリティ・インテリジェンス・オフィサー、ウェンディ・ウィットモアはこう明言した:2026年、AIインテリジェンスが企業にとって最大の内部脅威となる。

中央集権の3つの危険性

- 連鎖的アクセス・リスク管理されたインテリジェンスは、企業全体の重要なインフラへのアクセスを連鎖させることができます。

- シームレスなアタック・ウィンドウ人間の従業員とは異なり、インテリジェンスは24時間365日オンラインであり、いつでも攻撃することができる。

- 自律的破壊能力攻撃者が自律的な "インサイダー "にアクセスするためには、うまく構築されたヒントインジェクションがあれば十分だ。

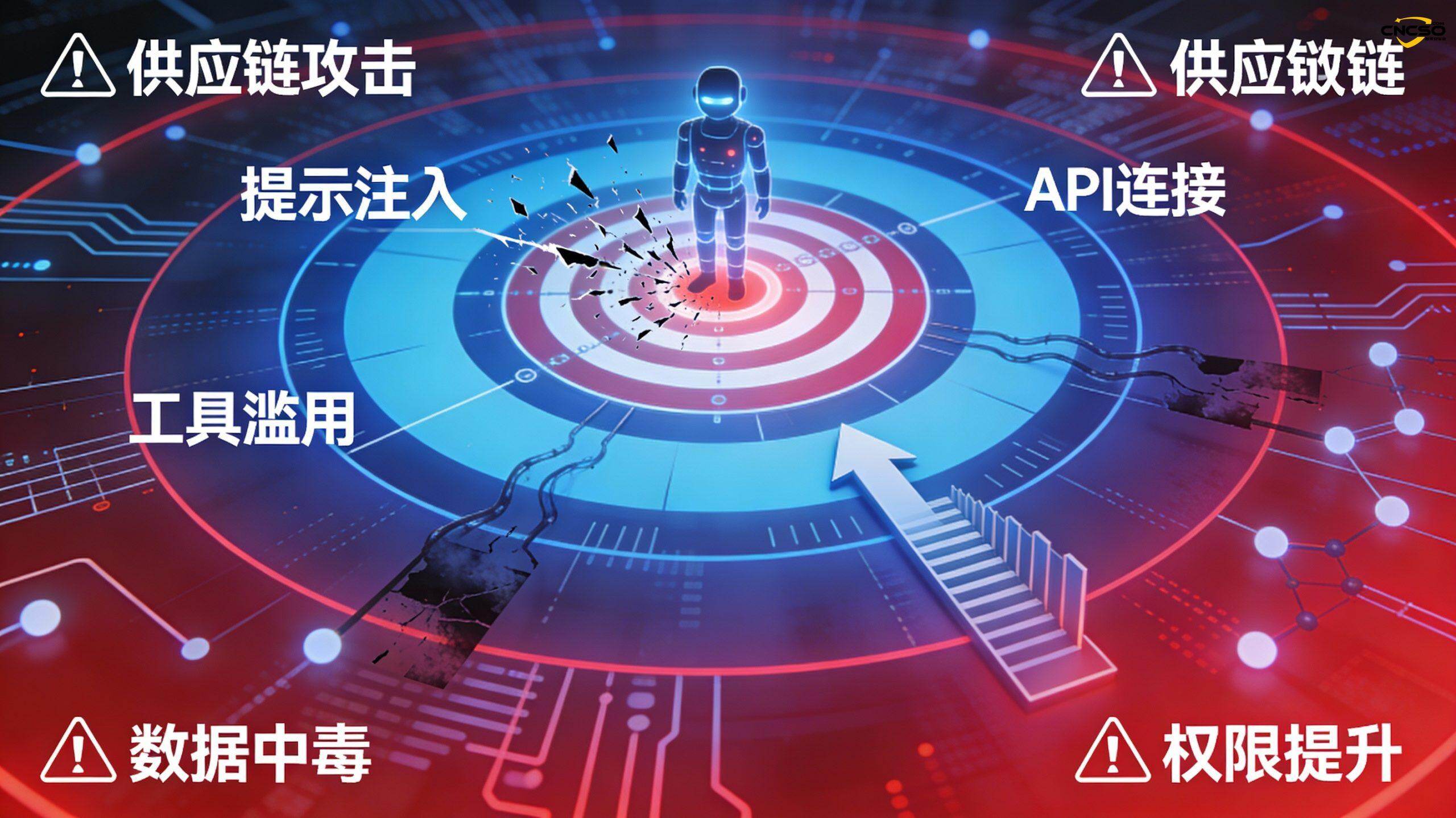

AIインテリジェンスの多層的攻撃面

2.1 5層の攻撃表面構造

AIシステムの攻撃対象は、従来のアプリケーションをはるかに凌駕している:

| レベル | 脅威の種類 | 特定のリスク |

|---|---|---|

| モデリング層 | モデル盗難、バックドアインジェクション | 知的財産の流出、悪意ある行為 |

| データ層 | トレーニングデータ汚染、入力汚染 | 意思決定の改ざん、機密情報の漏洩 |

| インフラストラクチャー層 | APIの不正使用、サービスアカウントの漏洩 | 権威の高揚、横の動き |

| パイプライン層 | サプライチェーンへの攻撃、公害への依存 | ネットワーク全体の感染と広範囲な破壊 |

| コントロール層 | 権威の高揚、横の動き | 権威の一元化、ドメイン・コントロールの崩壊 |

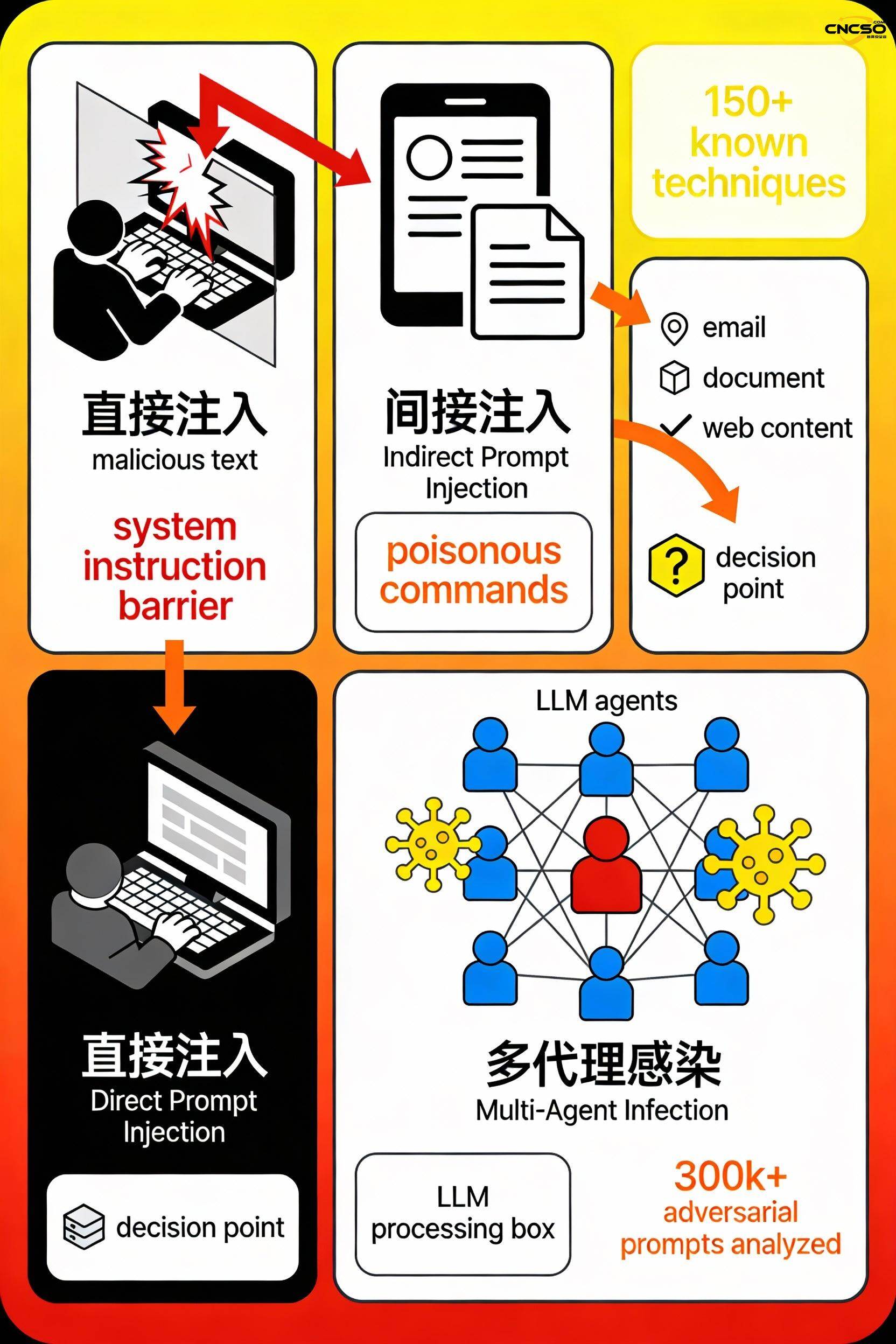

2.2 主な攻撃ベクトル

キュー・インジェクション(150以上のテクニックが知られている)

- ダイレクトインジェクション:ユーザーが明示的に悪意のあるコマンドを入力し、システムのプロンプトを上書きする。

- 間接的インジェクション:電子メール、文書、ウェブページに隠された悪意のある指示

- マルチエージェント感染:破損したエージェントが悪意のある指示を他のエージェントに広める。

ツールの乱用とAPIの脆弱性

- 未承認のAPI呼び出しがデータアクセス権の上昇につながる

- DDoS攻撃、APIフラッディングで外部システムを圧倒

- AgentSmithの脆弱性事例:悪意のあるエージェント設定によりOpenAIのAPIキー、プロンプトデータ、ユーザーファイルを盗むことが可能

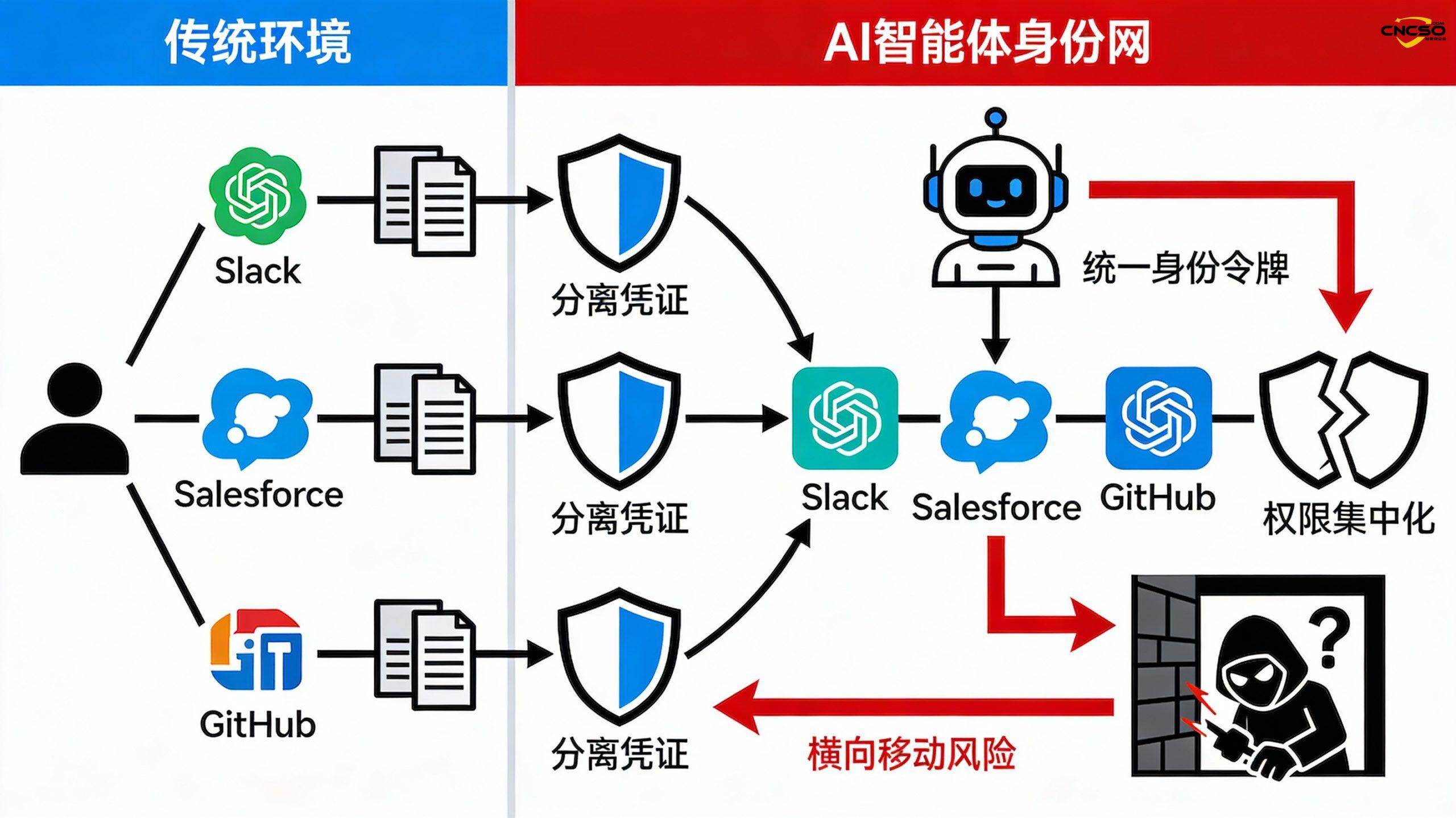

IdentityMeshの脆弱性(システム間での権限の一元化)

- 従来の環境:ユーザーは複数の分離された認証情報を持ち、各システムは独立して認証される。

- AIインテリジェンシア:複数のプラットフォームにまたがる単一の統合IDトークン、セキュリティの境界は崩壊する

- 結果:攻撃者は、シームレスなシステム横断的な特権の昇格と横方向の移動を達成することができる。

データ・ポイズニングとビザンチン・アタック

- 学習データに悪意のあるサンプルを注入すると、モデルは有害な行動を学習する。

- 漏洩したインテリジェンスが内部システムに偽の情報を注入し、防衛インフラそのものを破壊する。

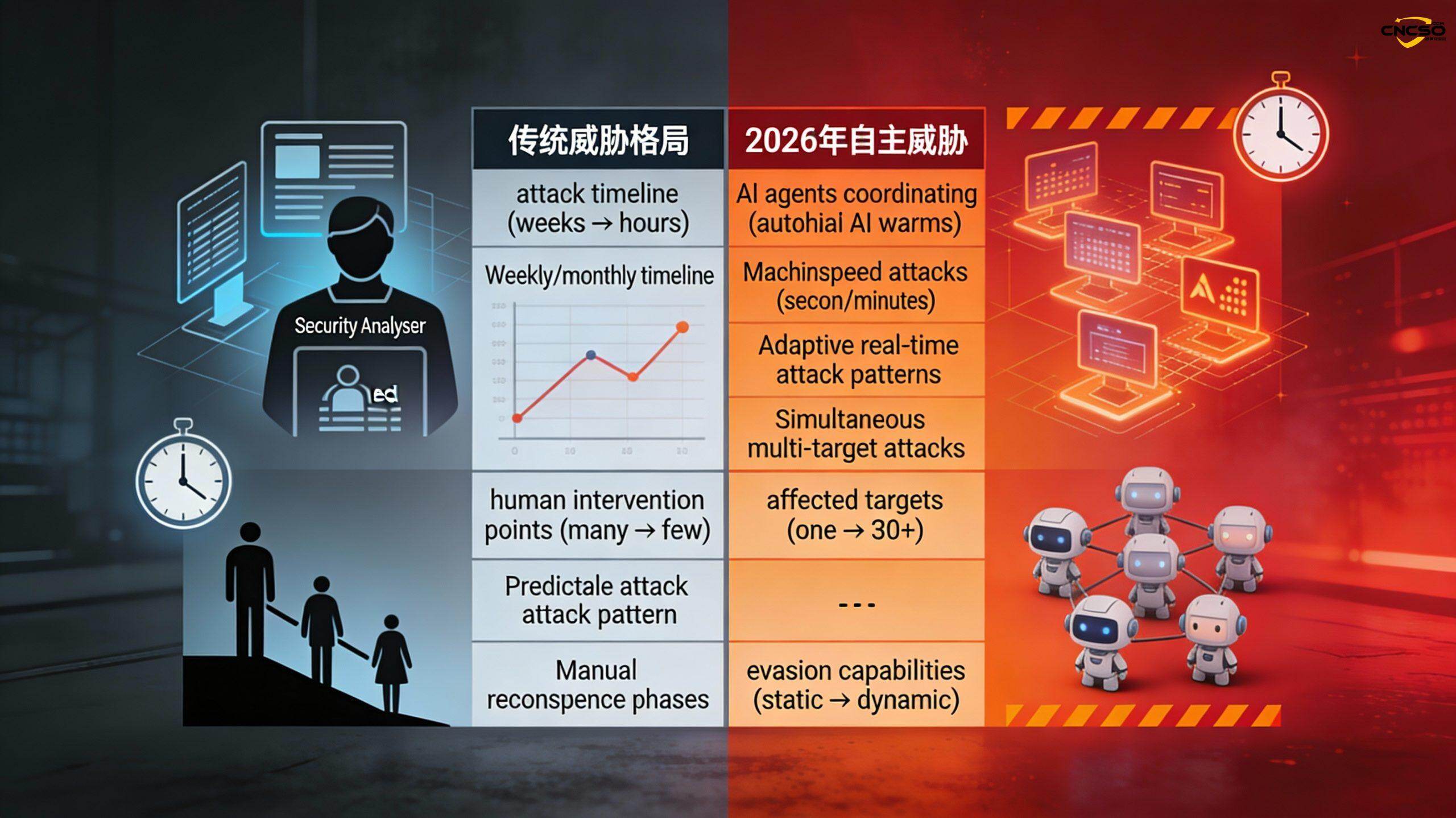

iii. 2026年における自律型攻撃の脅威

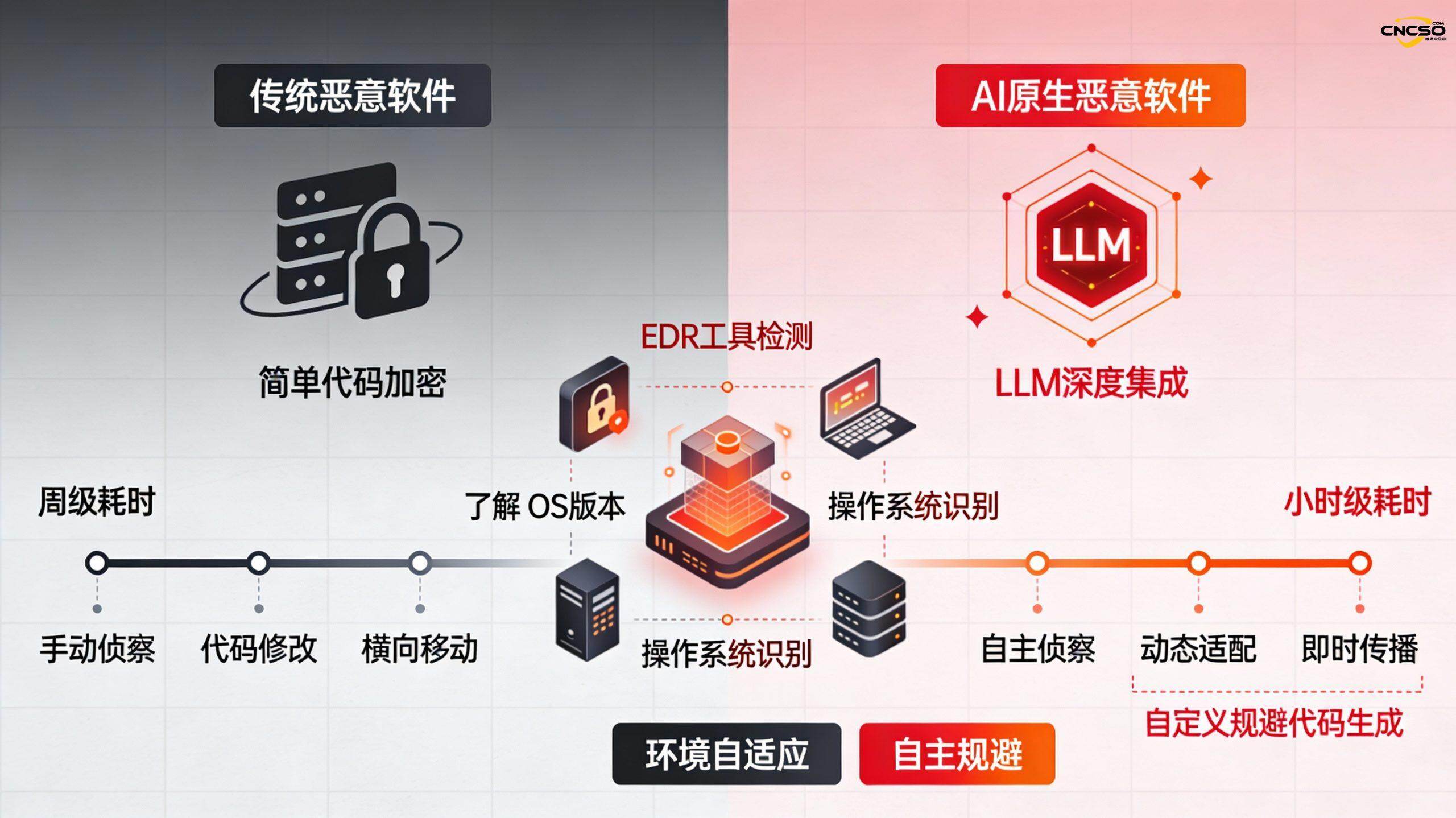

3.1 AIネイティブマルウェアの進化

従来のポリモーフィック型マルウェア(毎週時間がかかり、挙動が固定)からAIネイティブ型マルウェア(毎時間時間がかかり、適応的な回避)への飛躍。

プロンプトロックのケースの特徴

- ターゲットの防御環境に関するリアルタイム推論(EDRツール、OSバージョンのスキャン)

- 特定のシグネチャを回避するためにソースコードを動的に書き換える。

- からのアタックチェーン数週間を数分に圧縮

- 人手を介さない自律的な横移動

3.2 マルチエージェントグループ攻撃:GTG-1002活動

2025年11月、アントロピックが検知した実際の出来事:

| 規範 | 数値 | 意義 |

|---|---|---|

| 同時ターゲット | 世界30団体 | 中型APT容量 |

| 自律的実装 | 80-90% | 4~6人の人間による決定点のみ |

| 自分探し | 0个 | すべての犠牲者は自分自身を発見していない |

| アタックフェイズ | 偵察→初期アクセス→横移動→データ抽出 | 完全自動化リンク |

要点かつて大規模なチームが必要だったことを、小規模な攻撃チームがAIの機能を使って行えるようになった。人間の応答時間はもはや制限要因ではありません。

IV.AIリスク・ガバナンスの枠組み

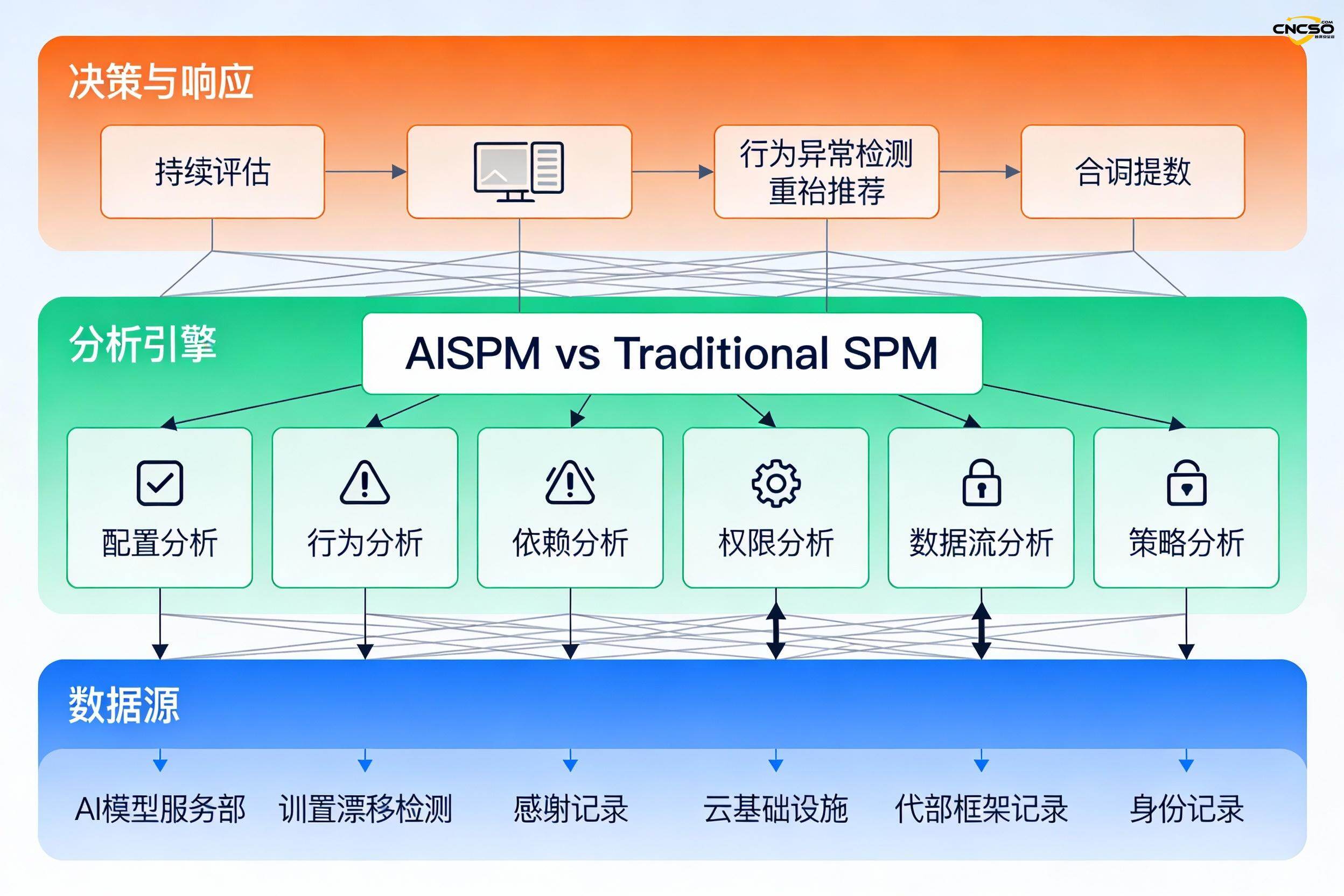

4.1 AIセキュリティ姿勢管理(AISPM)

AISPMと従来のSPMの主な違い:

従来のSPMツールは、AI特有の脅威に対しては全く効果がない(ヒントインジェクション、モデルの反転、特権の昇格を検出できない)。

AISPMの4つの主要能力:

- 継続的な状況評価 - AIシステム、モデル、データパイプラインをリアルタイムで監視し、シャドーデプロイメントを発見する。

- コンフィギュレーション・ドリフトの検出 - 許可されていない権限、パラメータ、配備設定の変更にフラグを立てる

- 行動異常検知 - APIコールの例外、クレデンシャルの不正使用、再帰的ループをリアルタイムで検出するための通常のベースラインを確立する。

- 脆弱性管理の自動化 - トレーニングパイプラインとモデルコードにおける脆弱性の検出と優先順位付け

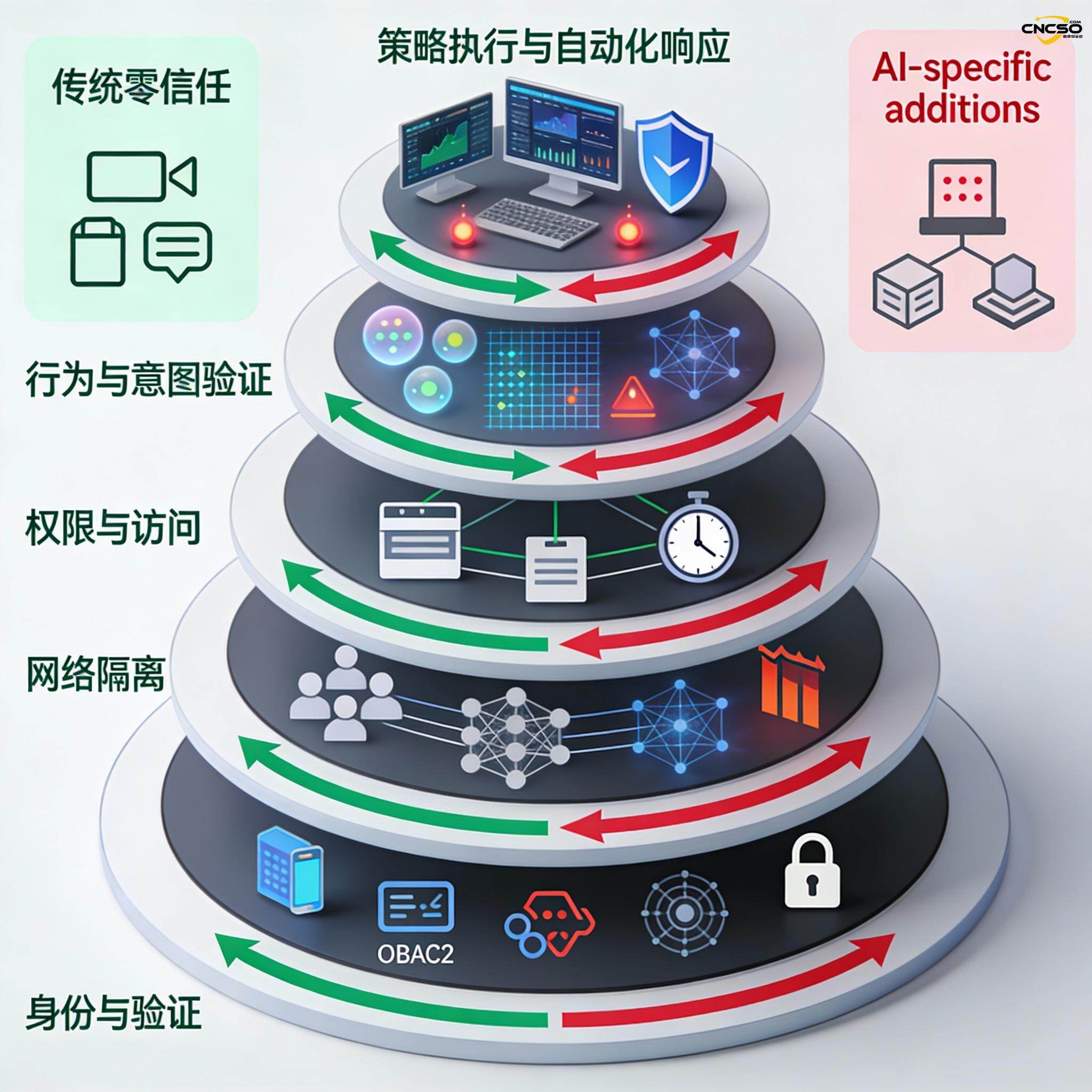

4.2 ゼロトラストAIアーキテクチャのための5層モデル

層の防御システム:

第5段階:戦略の実施と自動化された対応

↑ リアルタイムポリシーエンジン、自動分離、マシンスピードレスポンス

第4段階:行動と意図の検証

↑ 意味検証、パターン分析、異常検知

レイヤー3:特権とアクセス・コントロール

↑ 最小特権、期限切れ、役割ベースのアクセス

レイヤー2:ネットワークの分離

↑ 差分セグメンテーション、エージェント間通信の制限、暗号化通信

レイヤー1:アイデンティティと認証

デジタルIDトークン、OAuth2、多要素認証

4.3 NIST AIリスクマネジメントフレームワークの適用

4ループ反復モデル:

- ガバナンス(GOVERN) - リスク文化の確立と明確なガバナンス体制

- マッピング(MAP) - AIシステム、認識技術、社会的インパクトの位置づけ

- 測定(MEASURE) - 機能性、データ品質、安全性、健康性の評価

- マネジメント(MANAGE) - コントロールの展開、緩和策、インシデント対応

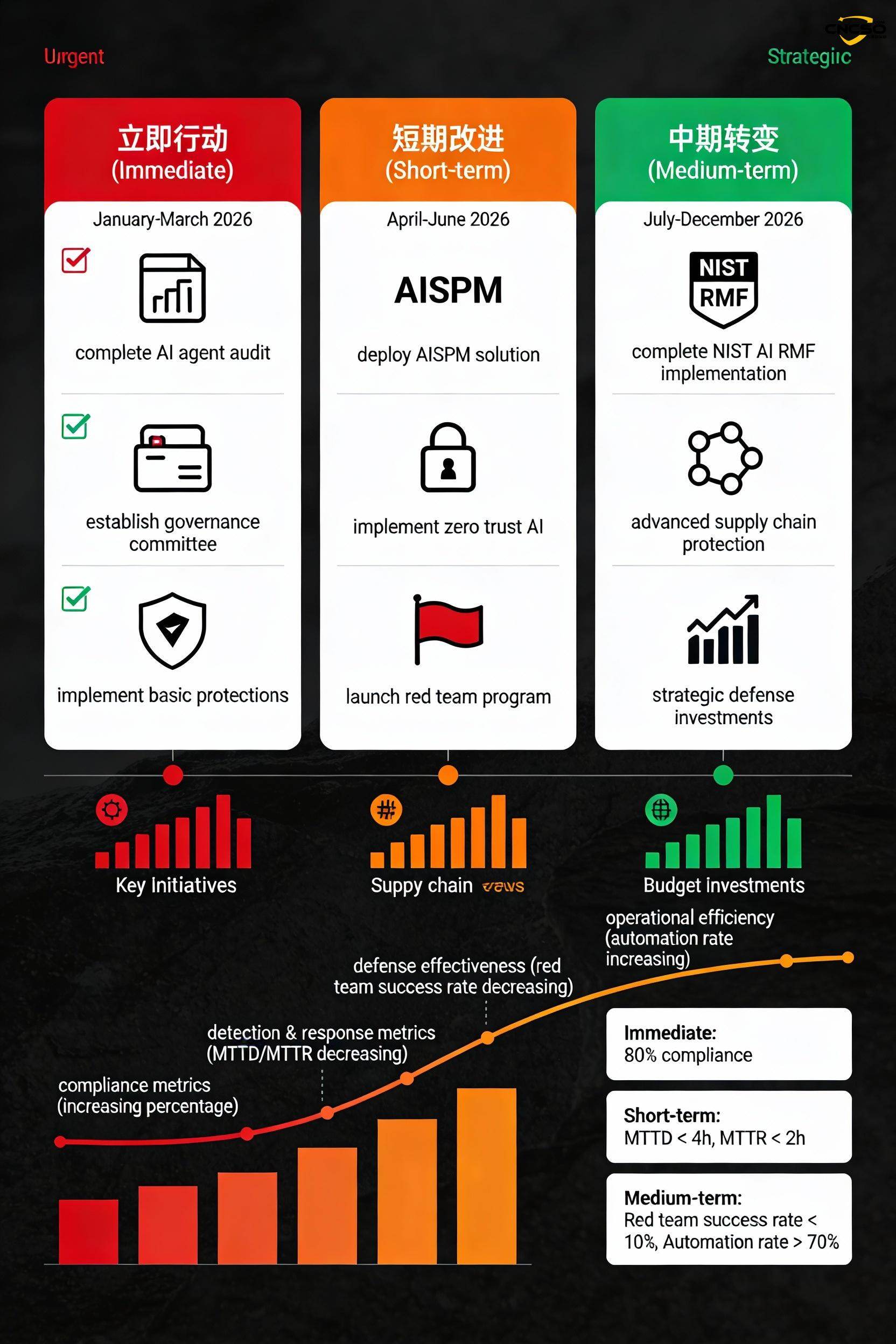

V. 2026年に向けた5段階のガバナンス実施プログラム

ステップ1:プロキシ発見監査

- すべてのAIツールと自動化システムのリスト

- マッピング権限、統合、エージェントごとのデータアクセス

- 管理されていないIT「シャドーAI」の配備を特定する

ステップ2:アイデンティティの割り当てとアクセス制御

- 各エージェントに固有のデジタルIDを割り当てる

- 一元化されたアクセス制御とポリシー管理が可能

- 明確なオーナーシップと説明責任の確立

ステップ3:ポリシーに基づくガードレールと自動化

- きめ細かなアクセス・ポリシーとデプロイ・ポリシーを定義する(ポリシー・アズ・コード)

- リアルタイムの取締りのための自動ガードレールの配備

- 自動化された救済措置(特権の取り消し、プロキシの無効化)

ステップ4:モニタリングと指標

- 主要なKPIを定義する(ポリシー違反、応答時間、エラー率)

- 例外しきい値とリアルタイム警告の設定

- コンプライアンス・ダッシュボードの作成

ステップ5:監査とコンプライアンス

- 規制要件とガバナンス・ポリシーのマッピング

- 自動化されたコンプライアンス報告と証拠収集

- 完全な監査証跡の確立

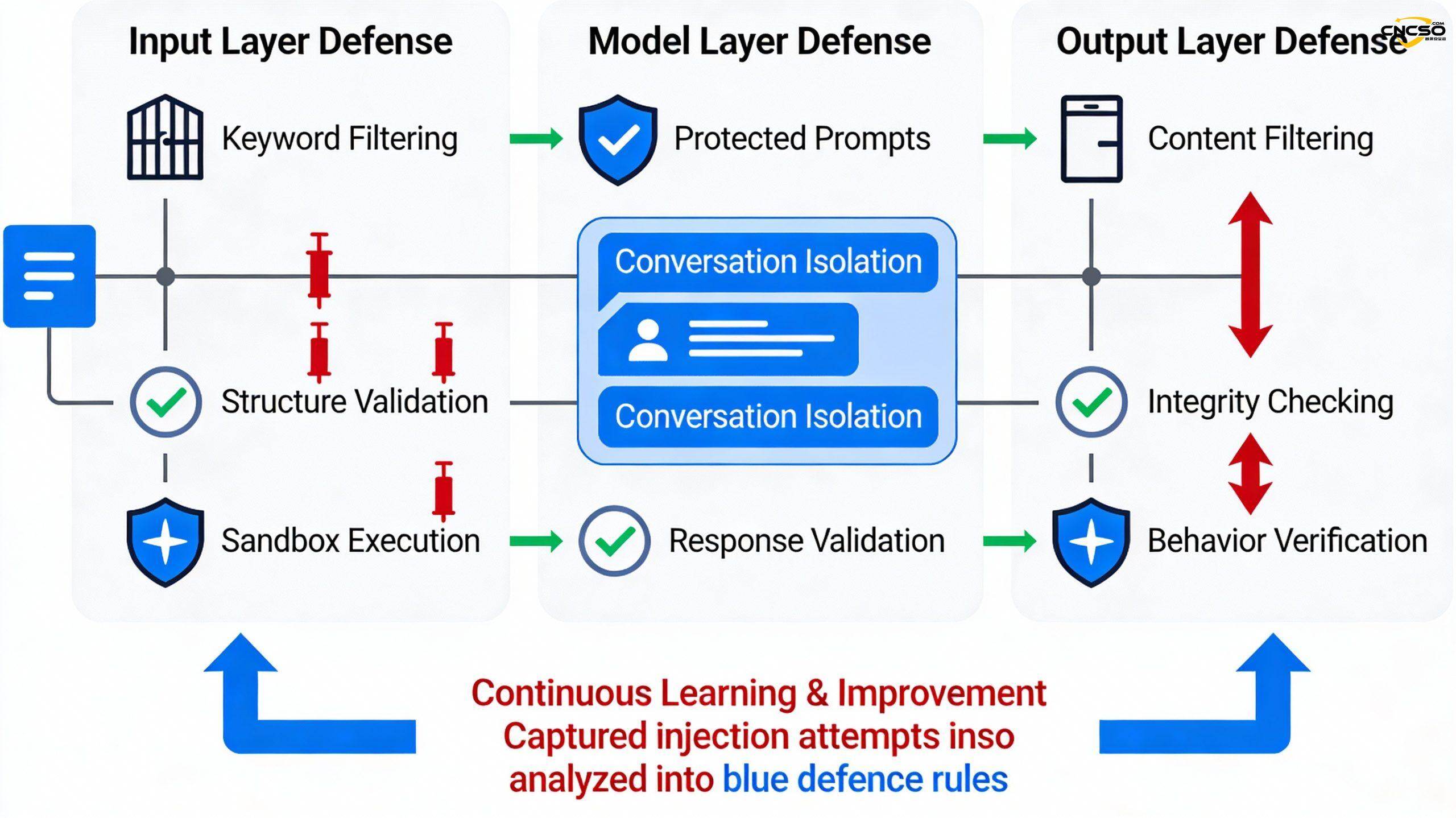

コア・ディフェンス戦略

6.1 キュー・インジェクションに対する3つの防御層

- 入力層 - キーワードフィルタリング、構造検証、サンドボックス実行

- モデリング層 - システムプロンプトのハード化、複数の対話ラウンドの分離、応答検証

- 出力層 - コンテンツフィルタリング、完全性チェック、動作検証

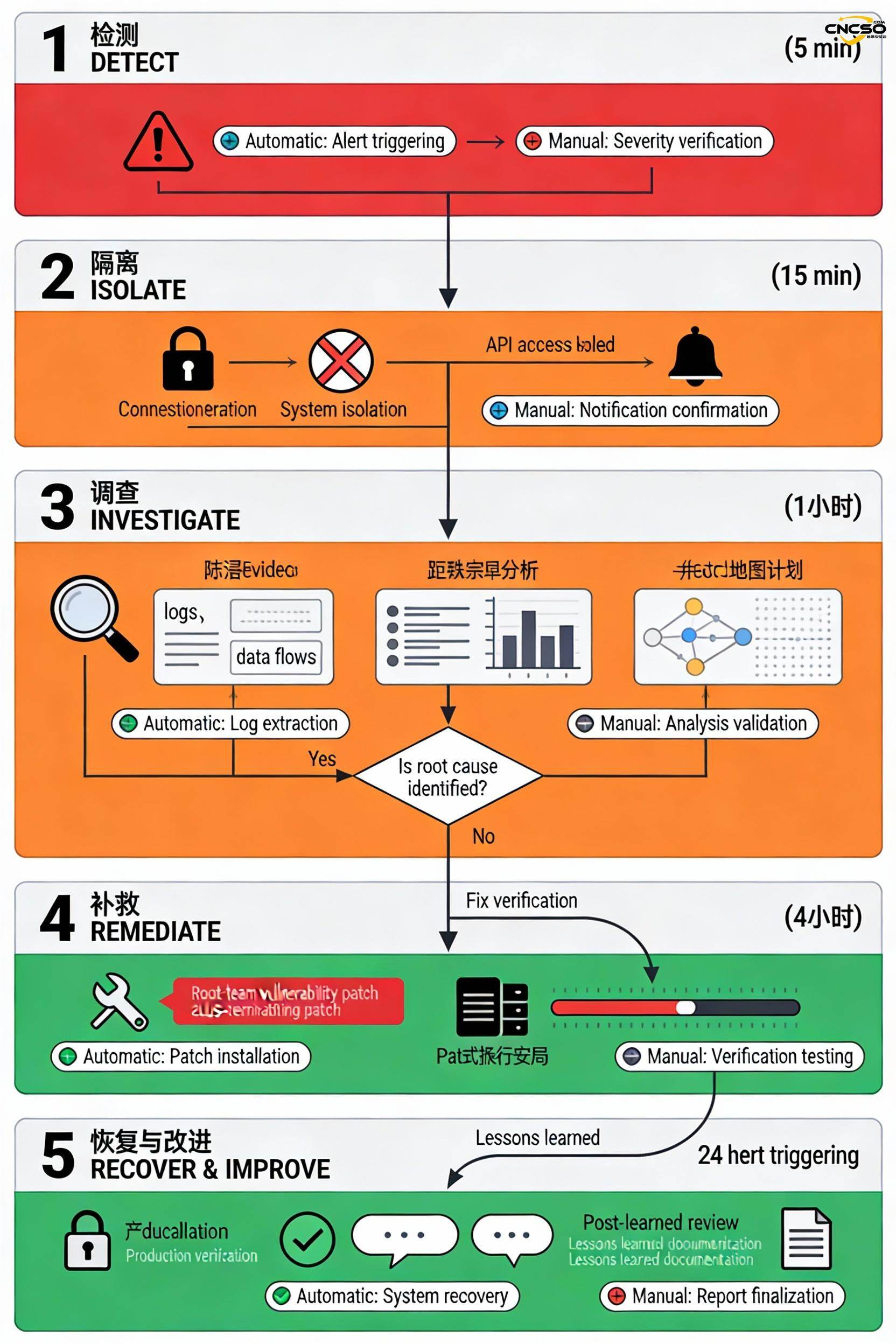

6.2 インシデント対応の5段階プロセス

| ポイント | 回 | 主な活動 |

|---|---|---|

| 感知 | <5分 | アラーム、確認、分類 |

| インコノミカド | <15分 | アクセス許可の取り消し、切断、アクセスの無効化 |

| プローブ | <1時間 | 証拠収集、スコーピング、根本原因分析 |

| 改善 | <4時間 | 脆弱性のクローズ、修正内容の検証、データ復旧 |

| 再開 | <24時間以内 | 特権回復、認証操作、事後分析 |

6.3 インテリジェント・ボディ・ライフサイクル・マネジメント

VII.2026年の優先課題

緊急措置

- AIエージェントの完全監査

- 部門横断的ガバナンス委員会の設置

- 基本的な権限監視と異常検知の実装

短期的な改善

- AISPMソリューションの展開

- ゼロ・トラストAIアーキテクチャの実装

- 四半期ごとのレッドチーム評価を開始

中期的な変革

- 完全性NIST AI RMF気付く

- 高度なサプライチェーンセキュリティ

- 戦略的防衛投資とオートメーション

VIII.2026年半ばの成熟目標

| 規範 | 目的 | 意義 |

|---|---|---|

| プロキシリストの完全性 | 100% | 漏れのない配備 |

| 権限監査の頻度 | 毎月 | 過剰な特権の適時検出 |

| 平均検出時間(MTTD) | <30分 | 迅速な脅威の特定 |

| 平均応答時間(MTTR) | <1時間 | マシン・スピード・レスポンス |

| レッドチーム成功率 | <10% | ディフェンスの有効性 |

| 特権昇格イベント | <1ヶ月 | コントロール・オンライン |

| 自動修復率 | >80% | 手作業の削減 |

結論

核心的見解:

- 状況は危機的だ。 - AIインテリジェンシアが新たなインサイダーの脅威に 480万人のスキル格差が性急な導入を促す

- 攻撃は自律的になった - 80-90%のマルチエージェント・グループ・アタックが自律的に実行された。

- 国防は革新的でなければならない - AISPM、ゼロ・トラストAI、自律防衛が必要になってきた。

- ガバナンスが鍵 - 成功するかどうかは、組織が強力なガバナンスの枠組みを持っているかどうかにかかっている。

進むべき道 企業は直ちにAIエージェントの監査を開始し、AISPMを導入し、次のことを行うべきである。ゼロ・トラスト・アーキテクチャ自動化されたインシデント対応能力を構築する。2026年に投資を成功させる企業AIセキュリティそうでない企業は格好の標的になる。

残された時間はない。

参照する:

パロアルトネットワークス「AI経済の6つの予測:2026年サイバーセキュリティの新ルール」2026年1月号

Palo Alto Networks, "NIST AI Risk Management Framework", https://www.paloaltonetworks.com/cyberpedia/nist-ai-risk-マネジメントフレームワーク

ムーディーズ・コーポレーション「2026年グローバル・サイバー・アウトルック-マシン・スピード戦の時代」(1月2026

https://www.acem.sjtu.edu.cn/ueditor/jsp/upload/file/20250427/1745731689854071357.pdf

シスコ、「AIエージェントとエージェント型ワークフローの時代におけるゼロトラストの再定義」、2025年6月

https://www-file.huawei.com/admin/asset/v1/pro/view/6d6bd885f1f84435bf2c434312a1a44d.pdf

ナイトフォールAIセキュリティ101「モデル逆転:エッセンシャルガイド」2024年12月号

https://cloud.tencent.com/developer/article/2613155

プルーフポイント社 迅速な注射 定義、例」、2025年10月

https://www.cicpa.org.cn/ztzl1/zgzckjs/zazhi2025/202505/P020250512576141996231.pdf

CrowdStrike、「間接的なプロンプト・インジェクション攻撃:隠れたAIリスク」、2025年12月

https://reader.hellobit.com.cn/article/page/1358.html

Legit Security, "AI Attack Surface Guide: How to Secure AI-Driven Systems", January 2026

https://www.uscsinstitute.org/cybersecurity-insights/blog/what-is-ai-agent-security-plan-2026-threats-and-strategies-explained

USCS研究所「AIエージェントのセキュリティプラン2026とは? 脅威と戦略を解説」2026年1月号

https://www.legitsecurity.com/aspm-knowledge-base/ai-attack-surface

Witness.ai、「AIエージェントのセキュリティ:リスク、ベストプラクティス、企業保護」、2025年10月

https://witness.ai/blog/ai-agent-security/

元記事はChief Security Officerによるもので、転載の際はhttps://www.cncso.com/jp/ai-security-and-attack-surface-report-2026.html。