序文

2025.AI(AI)は研究室から大規模な応用へと移行し、同時にサイバーセキュリティの攻防の様相を大きく変えている。Verizon Data Breach Investigations Report (DBIR)、IBMのCost of a Data Breach Annual Report、CrowdStrike Ransomware Investigation、Microsoft Digital Defence Reportなどの当局によると、今年はAIによるサイバー攻撃が爆発的に増加している。世界で報告されたAIによるサイバー攻撃の47%の増加は、防御技術の急速な進化を伴っており、AI防御を採用している組織は、これらの技術を採用していない組織と比較して、侵害コストを平均190万ドル削減している。

本レポートは、2025年における世界と香港のサイバー脅威の状況を包括的に分析し、AIが攻撃者と防御者のコスト分析をどのように再構築しているか、最も影響を受ける業界と地域、実際の事例の要点、セキュリティ侵害の経済的影響、組織が取るべき主要な防御行動に関する洞察を提供しています。本レポートは、ますます複雑化する脅威の状況において、企業が十分な情報に基づいたセキュリティ投資の意思決定を行えるよう、意思決定者にデータに基づく洞察を提供することを目的としています。

II.2025年の脅威態勢

2.1 世界のサイバー脅威の概要

2025年のサイバー脅威の状況は、著しい加速とエスカレーションによって特徴付けられる。データによると、組織が1週間に経験するサイバー攻撃の平均件数は過去4年間で倍増しており、2021年第2四半期の818件から2025年の同時期には1,984件と、2年間で58%も増加している。この加速傾向は、攻撃チェーンにおけるAI技術の普及を直接反映したものである。

主な統計

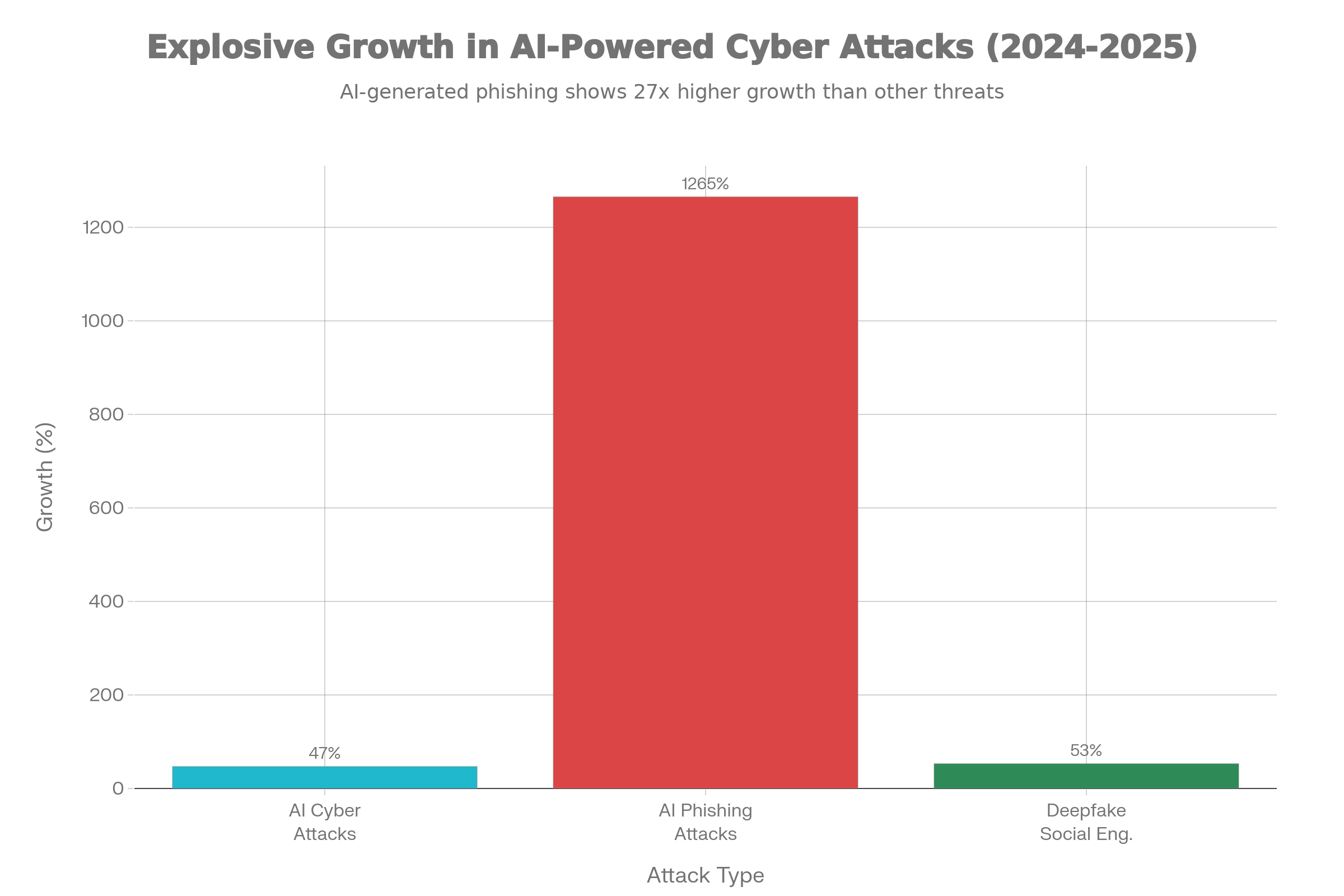

| 規範 | 2024 | 2025 | 成長率 |

|---|---|---|---|

| AIによるサイバー攻撃 | 基数 | 47%を追加 | 47% |

| AIが生成するフィッシング攻撃 | 基数 | 1,265%の増加 | 1,265% |

| ディープフェイク・ソーシャルエンジニアリング | 基数 | 53%を追加 | 53% |

| 1週間の平均攻撃回数 | 1,260 | 1,984 | 58% |

| セキュリティ・リーダーたちは、AIによる攻撃を日常的に期待している | 基数 | 93%レポート | - |

AIによるサイバー攻撃は世界的な脅威となっている。世界的な被害額は300億ドルと推定されている。こうした攻撃では、AIがフィッシングメールの信頼性を高めたり、IDなりすましを実行するための深い偽造を生成したり、侵入ステップを自動化したり、露出したAIインフラを検出したりするために使用されている。

2.2 AIを駆使した特異な攻撃

フィッシングメール用AIの産業化

2025年には、フィッシングメールの82.6%がAI技術を使用している。これらのメールはもはや単なるスパムではなく、高度に個人化されたソーシャル・エンジニアリング攻撃である。データによると、AI技術を使用したフィッシングメールは40%速く書かれ、以下のことが可能である:

-

ブランドと個人の声のトーンを一致させる

-

LinkedIn、過去の電子メール、公的記録から本物の詳細を統合する

-

従来のスペルミスのない、完全に文法的なメッセージの作成

-

被害者が実際に関与したプロジェクトと請求書番号を挙げること。

この結果、メールの開封率は最大78%、悪意のあるリンクのクリックは最大21%となった。特に注目すべきは、AIが生成したフィッシングメールの割合が、2024年と比較して約40%から83%に増加していることである。

ディープフェイクとサウンドクローニング

2025年には、AIによるディープフォージェリーがソーシャルエンジニアリングのインシデントを53%増加させ、ソーシャルエンジニアリングと不正請求が233%増加した:

-

エグゼクティブになりすますリアルなビデオと音声を作成

-

テキスト合成技術による本人なりすまし

-

複数のメディアを組み合わせたマルチチャネル詐欺

ランサムウェアのためのAIアクセラレーション

CrowdStrikeの2025年ランサムウェア調査によると、グローバル組織の76%が、AIを活用した攻撃のスピードと巧妙さに対応できていないことが明らかになりました。48%の組織が、AIによる自動化された攻撃チェーンが最大の脅威であると考えています:

-

侵入ステップを自動化し、最初のアクセスから暗号化までの時間を短縮

-

ランサムウェアのペイロードを最適化して検知を回避する

-

データ抽出と販売プロセスの自動化

-

個人的な恐喝要求と交渉戦術

2.3 AIインフラの大量露出

2025年半ばのトレンドマイクロのスキャンによると、AIアプリケーションの深刻な設定ミスが直接的な攻撃経路を作り出している。これらはゼロデイ脆弱性の問題ではなく、根本的なセキュリティ衛生の欠陥である:

-

完全に保護されていない200台以上のChromaサーバー(ベクター・データベース) データは、ネットワークにアクセスできる人なら誰でも読み書きや削除ができる。

-

10,000台以上のOllamaサーバーインターネットへの露出(2024年11月の3,000件から増加)

-

2,000台のRedisサーバー認証なし

-

72%用MCP(モデル・コンテキスト・プロトコル)サーバー少なくとも1つの機微な能力への曝露

-

50%を3台以上のMCPサーバーにプロキシ接続「ハイリスク」ステータス

このような露呈は攻撃者に許してしまう:

-

埋め込まれた機密文書の窃盗

-

データポイズニングによるAIモデルの侵害

-

ベクター・ドリフトとヒント・インジェクション攻撃の実行

-

環境内での横方向への移動

AIが攻撃者をどのように再構築できるかについての費用便益分析。

3.1 AIが攻撃のコストを下げ、規模を拡大するメカニズム

経済的観点から分析すると、AIはサイバー犯罪のビジネスモデルを根本的に変えつつある。従来のサイバー犯罪は多くの手作業を必要としていたが、AI技術によって攻撃者は非常に低い限界コストで大規模な自動化を行うことができる。

コスト構造の変化:

| アタックフェイズ | 従来の方法のコスト | AI支援コスト | 効率改善 |

|---|---|---|---|

| フィッシング・メールの作成 | 高い(要調査) | 低い(自動化) | 40%加速度 |

| ターゲット識別 | 控えめ | 低い(データ集約) | 大幅に簡素化 |

| ソーシャルエンジニアリング | 控えめ | 低い(深度偽装) | 信頼性 +53% |

| ペイロードのカスタマイズ | 御前 | 俯す | 自動生成 |

| 検知と回避 | 御前 | 俯す | ポリモーフィックマルウェア +76% |

具体的な経済指標:

攻撃者がパーソナライズされたフィッシング・メールを調査・作成するのに何時間もかかっていたものが、ジェネレーティブAIを使えば数分でできるようになり、攻撃の初期コストを80%以上削減できることになる。同時に、AIが生成した電子メールの成功率は、従来の方法では5-101 TP3Tであったものが、15-201 TP3Tに増加しており、これは攻撃者のROIが劇的に増加したことを意味する。

3.2 規模を攻撃する経済的コスト

AIの最も重要な経済的メリットは規模である。従来の標的型攻撃は特定の組織を標的にすることがあるが、AIが生成する攻撃は数百万の標的を同時に標的にすることができる。データに基づき、生成的なAIツールと自動化により、攻撃者は手作業よりも40%も速くフィッシング・メールを作成することができる。

ビジネスメール詐欺(BEC)の分野では、攻撃者は適切なターゲットと支払いプロセスを特定するために数週間かけて偵察を行う必要がありました。現在では、AIがLinkedIn、公開財務報告書、買収発表を分析することで、同じ分析を数日で行うことができる。これにより、攻撃チームは数百の組織に対して同時にキャンペーンを実施することができる。

3.3 ROIとコスト差に対するディフェンス

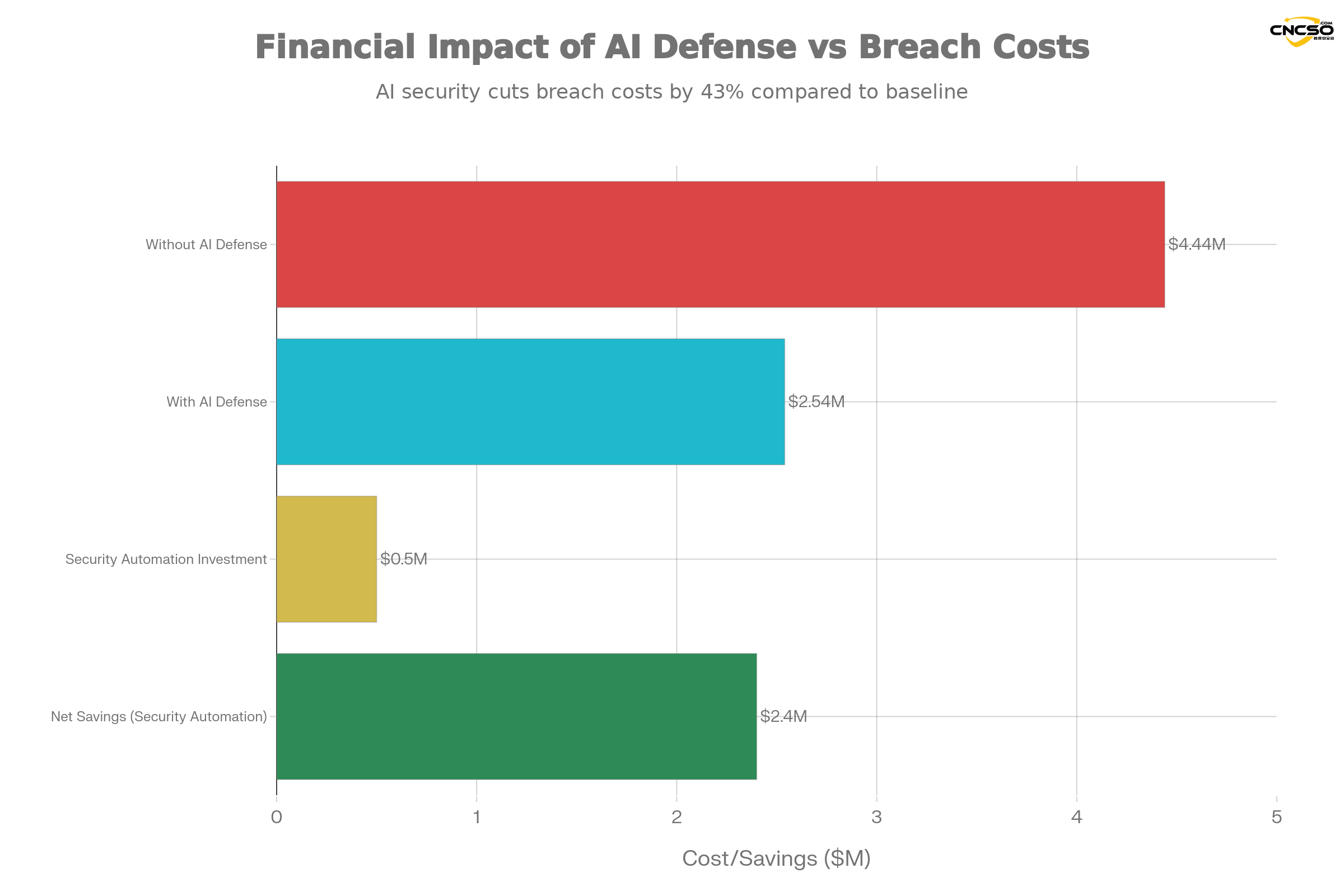

これと対照的なのが、防御側のコストメリットだ。AI防御を使用する組織は、平均してコストを削減できる。

-

漏水1件につき190万ドルを節約(AI防御を使用しない組織とは対照的である)。

-

テスト期間を平均80日短縮

-

漏水のライフサイクルが241日に短縮(過去9年間で最短)

-

レコード1枚あたりのコストを234ドルから128ドルに削減(AIによる自動検出)

これはパラドックスを生む。AIは攻撃のコストを劇的に下げるが、効果的な守備のコストもより早く下げる。重要な違いは、攻撃側がターゲットごとにカスタマイズしなければならないのに対し、守備側はすべての攻撃に対して一度だけ投資すればいいという点だ。

最も影響を受ける産業と地域

4.1 産業別のリスク評価

金融サービス(最高リスク)

AIを活用したサイバー攻撃に最も直面しているのは金融サービス業界。ディープ・エクスペリエンス調査が示す

-

45%の金融サービス組織過去12カ月間のAIによるサイバー攻撃

-

12.81 B2B金融会社向けTP3Tランサムウェアとの遭遇

-

1,338,357件のバンキング型トロイの木馬攻撃検出された

-

金融セクターにおける漏洩の平均コストは、引き続き1TP4.8~1TP4.5Mの範囲にある。

金融機関はAIによるBEC攻撃に対して特に脆弱である:

-

取引承認プロセスは、しばしば時間的なプレッシャーの中で行われる。

-

多額の送金は一般的な商習慣

-

攻撃者は莫大な金銭的報酬を直接得ることができる。

医療(死亡率が高い)

医療は複数の脅威に直面している:

-

1,710件のセキュリティ・インシデント(ベライゾンDBIR 2025)

-

1,542件のデータ漏洩が確認された

-

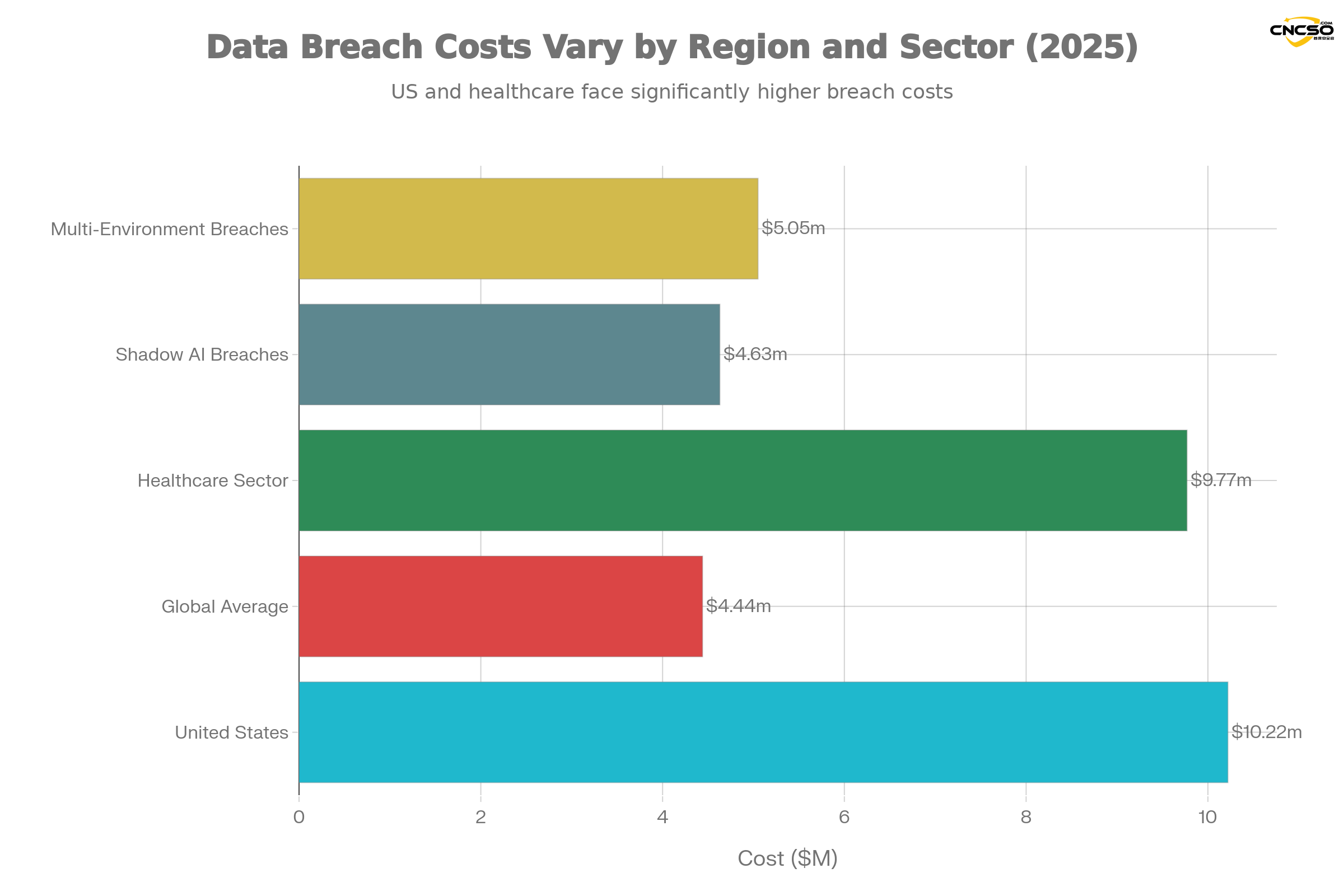

平均漏洩コスト $9.77M(業界最高)

-

442%でフィッシング攻撃が急増(2024年後半)

-

主な脅威は、ランサムウェア、ID攻撃、AIによるディープフォージェリーだ。

医療部門は価値の高いターゲットである:

-

患者データは永続的な闇市場価値を持つ(医療記録1件につき$150~$300)

-

操業の中断は生活安全のリスクにつながり、身代金の迅速な支払いを促す。

-

厳格なHIPAAコンプライアンス要件が侵害コストを増加させる

-

ランサムウェア集団は、医療機関が強い支払いインセンティブにさらされていることを知っている

教育機関(高成長の脅威)

教育分野はランサムウェアの新たなフロンティアとなりつつある:

-

217 ランサムウェア攻撃(2023年4月~2024年4月)

-

前年比成長率35%以上

-

世界で確認されている攻撃の56%が米国によるものである。

-

教育は、製造業に次いで世界第4位の影響を受ける部門である。

教育機関は特に脆弱である:

-

限られたITリソースと予算

-

学生データの高い価値

-

運営上の混乱は学年に深刻な影響を与える

-

初期アクセスのためのオープンなネットワーク環境

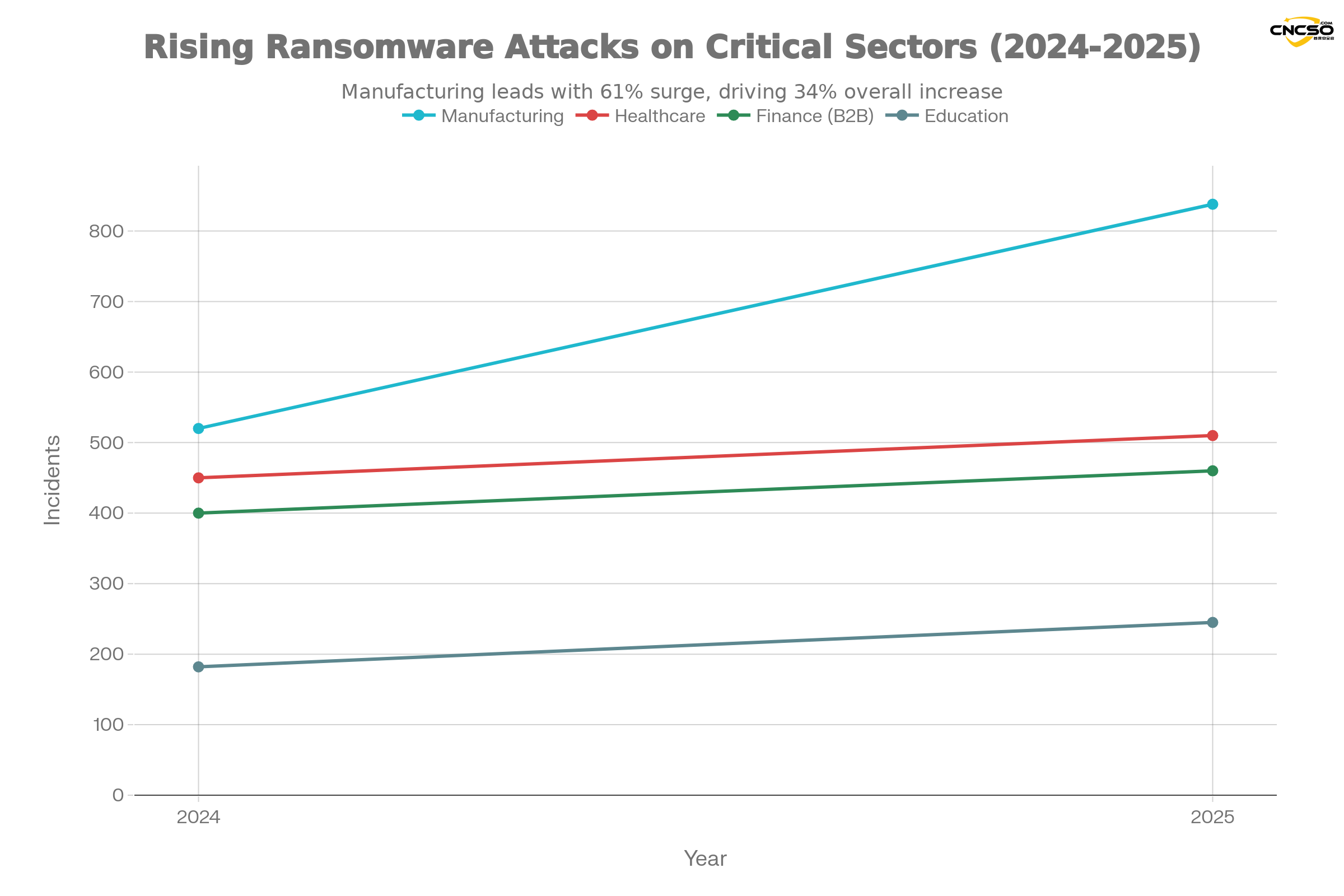

製造業(急成長)

2025年、製造業がランサムウェアの標的として急成長:

-

838件のランサムウェア攻撃(61%と520の比較)

-

34%のランサムウェア世界インシデントの増加主要セクターをターゲット

-

高度にデジタル化され、相互接続されたシステムは攻撃に対して脆弱である。

-

オペレーショナル・テクノロジー(OT)とITシステムの融合がエクスポージャーの増大を招く

4.2 エリアのリスク分析

香港特別行政区

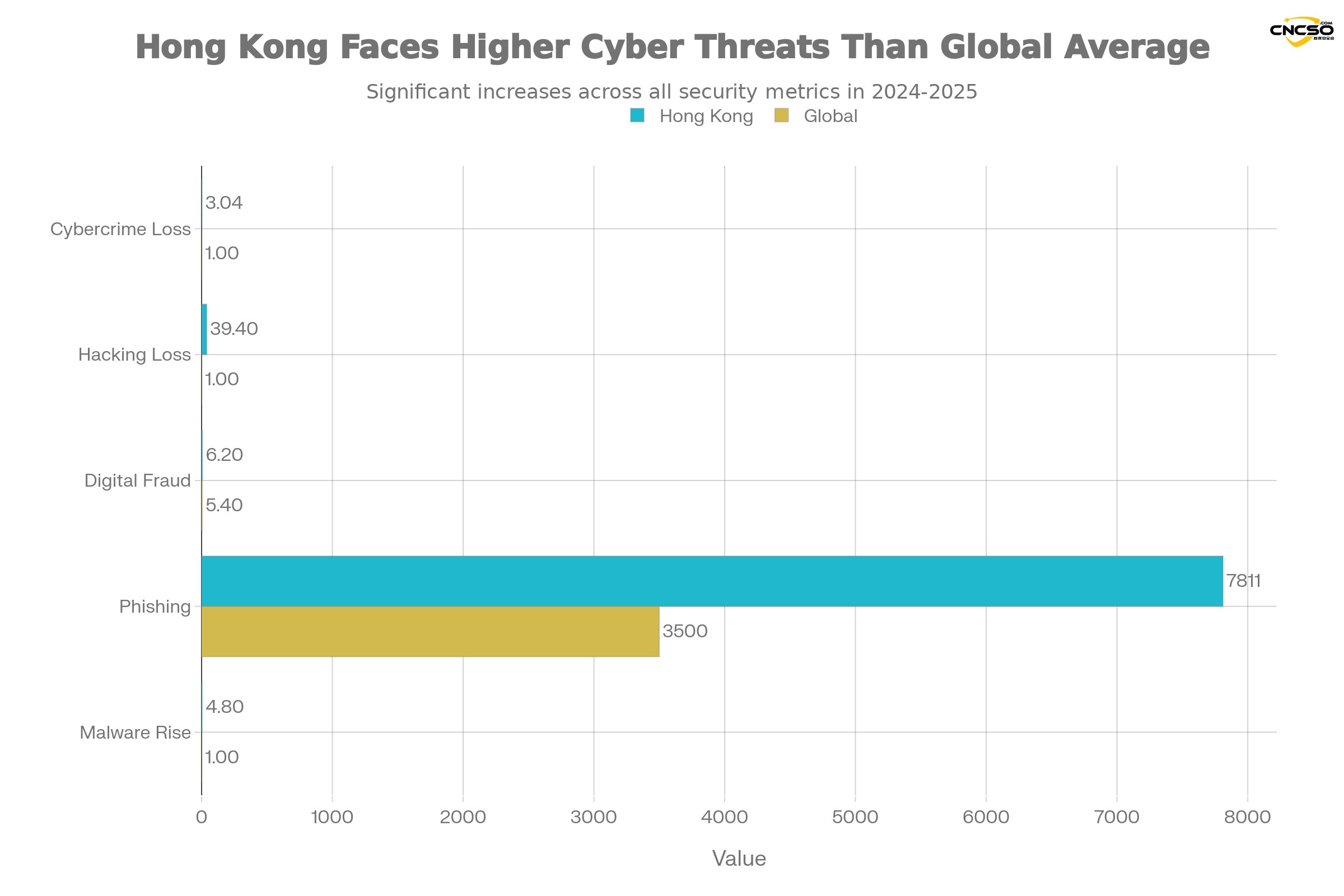

香港は世界平均よりもかなり高いレベルのサイバー脅威に直面している:

| 規範 | 2024-2025年データ | グローバル比較 |

|---|---|---|

| サイバー犯罪による損失(2025年上半期) | $3.04億香港ドル(前年同期比15%増) | +15%の成長 |

| ハッキング被害(2025年上半期) | HK$39.4M (+10倍) | 10倍サージ |

| デジタル詐欺率 | 6.2% | 世界平均5.41 TP3T、最高151 TP3T |

| 小売業界の不正 | 17.8% | 前年比113%の伸び |

| フィッシング件数 | 7,811 (+108%) | 過去5年で最悪 |

| マルウェア事件 | 4.8倍の増加 | 大幅に上昇 |

| フィッシングリンク | 48,000+ (+150%) | スパイク |

香港警察のサイバーセキュリティ・テクノロジー犯罪課によると、ハッキング攻撃の件数はわずかに減少したものの、金銭的損失の大幅な増加は脅威がエスカレートしていることを示しているという。HKCERTは2024年に12,536件のセキュリティ・インシデントを処理した。

その他のアジア太平洋地域

2025年タレス・データ脅威レポート」によると、アジア太平洋地域(オーストラリア、インド、日本、ニュージーランド、シンガポール、韓国、香港を含む)は以下のような脅威に直面している:

-

65%以上の組織AIの急速な発展が安全保障上の最重要課題と見なされる

-

63% AIの誠実さの欠如を懸念

-

55% AIの信頼性の低さを懸念

-

47%のアジア太平洋企業情報漏えいの経験

米国(最高額)

侵害1件あたりのコストは米国が最も高かった:

-

米国の平均漏洩コスト:$1,022万ドル(過去最高、+9%)

-

これは、世界平均の$4.44万ドルを1,30%以上上回っている。

-

規制当局の罰金と検査時間の遅れがコストを押し上げる

-

2025年に数百万件の記録を含む複数の大規模な情報漏洩が発生

V. 代表的なケースと洞察

5.1 香港ディープ偽造詐欺事件

事例の概要

2025年、香港の金融会社がAIを使ったディープ偽装詐欺で2500万ドルを失った。攻撃者は非常にリアルなディープフェイク映像と音声を使ってCFOになりすまし、緊急の資金移動を要求した。

攻撃プロセス

-

検出フェーズ攻撃者はオープンソースのAIツールを使ってリンクトイン、企業のウェブサイト、年次報告書を分析し、経営幹部の詳細なプロフィールを作成した。

-

ディープ・フェイクの創造DeepFaceLabのようなオープンソースの偽造ツールを使って、CFOのクローン動画を作成。

-

イニシャルコンタクト悪質なリンクを含むフィッシングメールによる偽の会議招待状

-

ソーシャルエンジニアリング詳細な偽造ビデオを社内通信アプリで共有し、取締役会の承認前に移籍を行うことを義務付ける。

-

資金移動不正な会計係は時間的なプレッシャーの中で送金を承認する

要点

-

時間圧力戦術緊急取締役会の緊急性を悪用する攻撃者たち

-

マルチチャンネル検証の行方組織は帯域外検証プロセスを実施していない。

-

AIツールの民主化: オープンソースのディープ・フォージェリー・ツールが技術的障壁を劇的に下げる

-

社内信頼の濫用経営者」からのメッセージに対する従業員の自然な信頼。

5.2 エネルギー企業CEOの音声詐欺(2019年、しかし2025年には一般的になる)

ケース・レビュー

この事件は2019年に起きたが、2025年には同様の攻撃が組織的に行われるようになる。欧州のエネルギー企業の米国子会社の財務担当者が、親会社のCEOらしき人物から電話を受け、秘密買収のために22万ユーロを緊急送金するよう要求されるのだ。電話の声は同じだが、それは偽造された深みのある声だった。

2025年の進化

2025年、この種の攻撃は大規模な作戦に変わった:

-

攻撃者は現在、機械学習モデルを使って特定の経営幹部の声や話し方のパターンをシミュレートしている。

-

攻撃は事前に録画されたものではなく、リアルタイムで実行されるため、発見がより困難になる。

-

深い多言語偽造が可能になり、地理的範囲が拡大

-

組織は、本物のコールと深い偽物を区別するのが難しいと報告している。

5.3 フォーチュン500のAI代理人データ流出(2025年3月)

ケース詳細

2025年3月、フォーチュン500に名を連ねる金融サービス企業が、顧客サービスのAIエージェントが数週間にわたって機密口座データを漏洩させていたことを発見した。根本的な原因は、綿密に計画されたプロンプト・インジェクション攻撃だった。

攻撃のメカニズム

攻撃者はAIエージェントに、隠された命令を含むクライアントのクエリを装ったメッセージを送信した。これらの命令はエージェントのシステムプロンプトを書き換え、セキュリティフィルターを無効にし、エージェントを実行させた:

-

機密のビジネスインテリジェンスを外部のエンドポイントに漏らす

-

独自のシステム・プロンプトを変更し、永続的なアクセスを追加する。

-

ユーザーの権限範囲を超える昇格権限でAPIコールを実行する。

-

未承認データベースへのアクセス

規模とインパクト

-

漏洩した顧客データは不明

-

雨漏りは何週間も発見されない

-

数百万ドルの規制当局による罰金

-

AIエージェントのアーキテクチャ全体を置き換える必要がある

要点

-

キュー・インジェクションはインパクトの大きい攻撃ベクトルである。伝統的なセキュリティ対策は効果がない

-

AIエージェントは新しいタイプの特権ユーザーシステムにアクセスし、変更することはできるが、監視はほとんどない。

-

インプット・ベースの汚染持続性データベースに保存された悪意のあるヒントは、エージェントによって処理されると自動的に実行されます。

-

観測可能性の欠如組織はAIエージェントの行動を監査しなかった。

5.4 グーグルとフェイスブックのベンダー詐欺($1億円以上)

ケースの背景

この事件は何年にもわたるが、2025年にテンプレート化された。詐欺師がグーグルとフェイスブックに(本物のハードウェア・サプライヤーを装って)偽の請求書を送りつけ、$億ドル以上の利益を得た:

-

Eメールの書式が実際のサプライヤーと完全に一致

-

真の調達サイクルに沿った要求

-

資金移動の二次検証は実施されなかった

2025年に向けたアップグレード版

2025年、この攻撃は進化した:

-

漏洩したベンダーの本物のメールアカウントを使用する(スプーフィングではない)

-

サプライヤーの過去のフォーマットに完全に準拠したAI生成請求書

-

新たな注文書に対する支払いで、実際の事業運営のように見せる。

-

ベンダーによる電子メール侵害攻撃、2024年に137%増加

VI.人工知能によるセキュリティ侵害の資本損失分析

6.1 シャドーAIのコスト

定義と規模

シャドーAIとは、IT部門の承認や監督なしに従業員が使用する未承認のAIツールやアプリケーションのことである。これは2025年における新たな重要なコスト要因である。

経済効果

IBMの『Cost of a Data Breach 2025』レポートによると、データ漏洩のコストは、2025年まで続く:

-

シャドーAIリーク 平均コスト: $$4.63M

-

標準的なイベントより$670万円多い****。

-

検出時間が長い標準241日に対し247日

-

幅広いデータ露出:: 複数環境を含む62%データ

-

組織は、機密データがどのAIツールに共有されるかを追跡したり管理したりすることはできない。

根本原因

-

視界不良:: 83%の組織はAIツールへのデータ暴露を防ぐための基本的な管理を欠いている

-

分類危機どのようなデータが機微(センシティブ)データとして分類されるかを追跡することができない。

-

従業員のバイパス従業員はAIツールを使って生産性を向上させる一方で、ITセキュリティ・プロセスを回避している

-

コンプライアンス・バキューム企業におけるAI活用のための政策やガバナンスの枠組みがない

6.2 クラウドの誤設定による資本損失コスト

統計の現状

-

15%のリーククラウドの誤設定から始める(3番目に重要な攻撃ベクター)

-

23%におけるクラウドセキュリティ事件設定ミスから直接派生

-

27%のある企業パブリック・クラウドの情報漏えいが報告される

-

ガートナー、2025年までに99%のクラウド障害を予測クラウドプロバイダーの欠陥ではなく、顧客のミスに起因する。

-

26%のすべてのリークヒューマンエラーによるもの

コスト変動

| 保管場所 | 平均漏洩コスト |

|---|---|

| マルチ環境ストレージ | $505万ドル |

| プライベートクラウド | $468万ドル |

| パブリッククラウド | $418万ドル |

| ローカルデータ | $401百万ドル |

マルチ環境リークが最もコストがかかるのは、そのためである:

-

検出期間が長い(276日対241日)

-

環境を超えた協調的対応の必要性

-

コンプライアンス評価の複雑化

-

第三者への通知義務の強化

6.3 AIインフラ脆弱性のコスト

ゼロデイ脆弱性とオープンソース脆弱性

公開されたAIインフラには、設定ミスだけでなく、コアコンポーネントにパッチが適用されていない脆弱性も含まれている:

-

ChromaDB ゼロデイ認証されていない読み取りと書き込みを許可する。

-

Redisのポストユース脆弱性ベクトル・ストレージのデータ破損の原因

-

NVIDIA Triton推論サーバの脆弱性任意のデータロードを許可する

-

NVIDIAコンテナツールキットの脆弱性外部変数の初期化

これらの脆弱性を開発するコストは

-

各脆弱性の発見から悪用までの時間数週間(従来のソフトウェア)から数日(AIツール)への短縮

-

規模の活用一つの脆弱性が何千台ものサーバーに影響を及ぼす可能性がある。

-

カスケード効果1つのAIサービスが危険にさらされると、システム全体が危険にさらされる可能性がある。

6.4 ベクター・データベース中毒におけるキャピタル・ロス

攻撃のメカニズム

ベクターデータベース(Chromaなど)には、AIシステムによって検索された埋め込み画像や文書が保存されている。これらのデータベースに毒を盛ると、以下のような結果になりかねない:

-

検索補強世代(RAG)システムが間違った情報を返す

-

AIエージェントは誤ったデータに基づいて決定を下す

-

持続的な攻撃を検知するのが難しい(通常の操作のように見える)

原価計算

-

毒されたデータベースによる誤った決断のコスト定量化されていないが、潜在的に大きい(例:FAIが投資判断を誤る)。

-

修復費用モデルの再トレーニング、バックアップからのリストア(通常はオフライン)

-

評判コストAIシステムが偏った出力や誤った出力をすることの公的根拠

-

規制コストデータ品質の問題はデータガバナンス規定に違反する

VII.2025年における主要な防衛行動のガイドライン

7.1 アイデンティティとアクセス防御(優先度:最高)

パスワード不要、フィッシングに強い多要素認証の導入

標準的なMFA(SMSコード、電子メールリンク)は、現代の攻撃に対して不十分であることが証明されている。NIST SP 800-63-4標準によると、組織は以下を実装すべきである:

オプション1:FIDO2/WebAuthnハードキー

-

ハードウェアキー(USBまたはBluetooth)を認証に使用する。

-

キーは暗号化により保護され、デバイスから離れることはありません。

-

クレデンシャル・リプレイと中間者攻撃を防ぐ

-

費用:1ユーザーにつき$15~$50/年

オプション2:内蔵バイオメトリクス

-

Windows Hello、Face ID、またはTouch IDを使用する

-

秘密鍵はチップに保存され、エクスポート不可

-

ID プロバイダとのフェデレーション(OIDC/SAML を通じて)

-

コスト:既存設備に含まれる

実装パラメータ

-

財務部パスワードレスMFAを使用する全アカウント100%

-

IT管理者すべての特権アカウントでパスワード不要のMFAを実現

-

リモートアクセスVPNとクラウドアプリケーションはパスワードレスMFAを使わなければならない

-

コールバック検証どのような送金も、既知の電話番号で2回確認する必要があります(メッセージ内の電話番号は使用されません)。

実施コスト

| アセンブリー | (製造原価 |

|---|---|

| ハードキー(5,000ユーザー) | $75,000 |

| MFAマネジメント・ソリューション | $50,000 |

| 配備とトレーニング | $30,000 |

| 年間総費用 | $155,000 |

ROI

-

平均漏洩コスト:$444百万ドル

-

70%でクレデンシャル盗難のリスクを低減:$で310万ドルの節約

-

1年間のROI:20倍

7.2 AIインフラのハードニング(優先度:最高)

すべてのAIシステムの目録と分類

-

すべてのモデル、データソース、ベクターデータベース、推論エンドポイントをリストアップしたAI部品表(BOM)を作成する。

-

デプロイ場所の特定(ローカル、AWS、Azure、Google Cloudなど)

-

データの機密性をマークする(公開、内部、制限、機密)

-

各AIシステムとの依存関係や統合を文書化する。

露出したAIコンポーネントをロックダウンする

早急な対応(1週目):

-

Chroma、Redis、Ollamaのすべてのインターネット向けインスタンスのスキャン

-

Shodan、Censys、または社内の脆弱性スキャナーの使用

-

費用:$0~$5,000(スキャンツールを購入した場合)

-

-

認証と暗号化を有効にする

-

すべてのベクターデータベースに強力なパスワードまたはAPIキーを追加する

-

TLS 1.3暗号化を有効にする

-

役割ベースのアクセス制御(RBAC)の実装

-

-

監査ログの有効化

-

すべてのデータの読み取りと書き込み操作を記録

-

異常検知のためにログをSIEMシステムに送信

-

コスト:$10,000~$20,000(SIEM構成)

-

中期的行動(2~4週目):

-

不要なインターネットアクセスをオフにする

-

プライベート・サブネットの背後にAIサービスを移動

-

VPNまたはバスティオンホストを使用したアクセス

-

ネットワーク・セグメンテーションの実装

-

-

セキュリティパッチの適用

-

ChromaDB、NVIDIA Tritonなどの最新パッチを適用!

-

パッチ管理プロセスの確立

-

費用:$5,000~$15,000(エンジニアリング時間)

-

-

ランタイム・モニタリングの実装

-

行動分析による異常パターンの検出

-

データポイズニングの兆候がないかモデル出力を監視する

-

費用:$20,000~$50,000(ツール+コンフィギュレーション)

-

長期的な行動(2~3ヶ月):

-

CI/CDセキュリティの確立

-

モデル訓練パイプラインにおけるサプライチェーン・セキュリティ・スキャニング

-

依存関係のバージョン管理と脆弱性スキャン

-

-

-

すべてのAIコンポーネント間の相互TLS認証

-

サービスごとに個別のID証明書と短期証明書を発行する。

-

費用: $50,000-$100,000 (ツールとエンジニアリング)

-

7.3 エージェント AI ガバナンスの枠組み(優先度:高)

問題の規模

-

69%の企業がAIエージェントを導入

-

21%のみ、適切なセキュリティ管理がなされている

-

79% 正式なAIエージェントガバナンスポリシーの欠如

-

20%はコントロールが全くない

ガバナンス・フレームワークの主な構成要素

1.AIエージェントのリストと分類

代理人リストエントリー:

- エージェント名と目的

- アクセスするシステムとデータ

- 許可された権限(作成、削除、変更、読み取り)

- 所有者と緊急連絡先の詳細

- リスクレベル(低、中、高、重要)

- 展開ループ期間(開発、テスト、本番)

- 監査日

2.警備員の特権と最小特権の原則

-

エージェントは、その機能に必要なデータとシステムにのみアクセスできる。

-

グローバルAPIや昇格特権APIにアクセスできない

-

センシティブな操作(データ削除、権限変更、資金移動)の手動承認

-

厳格なワークフロー・ガバナンス

3.行動監視と異常検知

-

通常のエージェントアクティビティ(データアクセスパターン、APIコール、実行時間)のベースラインを確立する。

-

ベースラインからの逸脱をリアルタイムで検出

-

異常を示すエージェントの自動隔離

-

フォレンジックのためにすべてのエージェント操作を監査する

4.キュー・インジェクション・ディフェンス

-

ユーザーの入力を信用しない - すべての外部入力をクリーンアップする

-

実行前のユーザー・クエリのセキュリティ・レビュー

-

厳密な入力検証と型チェックを行う

-

システムプロンプトの前に "not jailbreakable "コマンドを追加する(これは完全な解決策ではないが)

-

エージェントコマンドとユーザーデータの分離

5.ガバナンス・ツールとフレームワーク

-

NIST AIリスクマネジメントフレームワーク(AI RMF):: 4つのコア機能(ガバナンス、マップ、測定、管理)

-

ISO 42001AIマネジメントシステム

-

オワスプllmriskトップ10LLM特有の脆弱性

-

プロキシの脱獄と不正使用をチェックするための定期的なレッドチームテスト

7.4 データ分類とシェーディングAI制御(優先度:高)

企業データ分類の実施

IBMのデータによると、83%の組織はAIツールへのデータ暴露を防ぐための基本的な管理ができていない。解決策

| 分類レベル | 定義する | AIツールの使い方 | 典型例 |

|---|---|---|---|

| 公然と | 公に共有できる | 無制限 | マーケティングコピー、出版物 |

| うち | 社内使用のみ | 認可された工具のみ | 会議メモ、社内コミュニケーション |

| 秘密 | 企業秘密または競争 | すべてのAIツールを無効にする | 財務データ、製品ロードマップ |

| 制限付き | 個人または規制データ | 禁酒法--法的リスク | PII、PHI、支払情報 |

シャドーAIコントロール

未承認のAIツールの使用を防止する技術的措置を導入する:

-

データ損失防止(DLP) - AIツールにコピー/ペーストしようとすると、制限されたデータをブロックする。

-

ブラウザ隔離 - 信頼できないウェブサイトを隔離されたコンテナで実行する

-

APIゲートウェイ - OpenAIやClaudeなどの公開AI APIへのトラフィックをブロックする。

-

SaaSガバナンス・ツール - 未承認のAI SaaSアプリケーションの部門利用を検知する

-

スタッフ・トレーニング - 特定のデータをAI用に処理できない理由を説明する

実施コスト

| 封じ込め | (製造原価 |

|---|---|

| DLPツール | $40,000-$80,000/year |

| ブラウザ隔離 | $30,000-$60,000/year |

| SaaSマネジメント | $20,000-$40,000/year |

| スタッフ・トレーニング | $5,000-$10,000 |

| 合計 | $95,000-$190,000/year |

ROI

-

シャドーAIリークコスト:$4.63M

-

60%でのシェードAI使用のリスクを低減:$ 278万円の節約

-

投資回収期間:1年未満

7.5 安全な自動化とAIによる検知(優先度:最高)

ビジネス・ケース

セキュリティの自動化とAIを活用する組織

-

手動安全装置 60-80%の運転コスト削減

-

年間平均$240万ドルの節約(企業導入)

-

インシデント対応時間を10倍短縮(4時間から15分まで)

-

試験時間を80日短縮

-

セキュリティ・インシデントの処理能力が5倍に向上

主な実施分野

1.SIEMとSOARの統合

-

SIEMを使用して、すべてのセキュリティログとイベントを集約する

-

SOARによる一般的な対応ワークフローの自動化

-

コスト:導入$10万~$20万+メンテナンス$5万~$10万/年

-

ROI: 検出時間の短縮により、平均$190万円/漏洩の削減

2.行動分析と異常検知

-

ユーザーとエンティティのベースライン行動を確立する

-

ベースラインから逸脱した活動を機械学習で検出する

-

不審なアカウントの自動隔離

-

Cost: $30,000-$60,000/year

3.脅威インテリジェンスの自動化

-

既知の悪意のあるIP、ドメイン、ファイルハッシュの自動関連付け

-

プロアクティブな脅威ブロック指標

-

外部脅威ソースとの統合

-

Cost: $20,000-$40,000/year

4.コンプライアンスの自動化

-

自動レポート

-

継続的なコントロールの検証

-

Cost: $15,000-$30,000/year

7.6 財務部門固有の管理(優先度:重要)

本レポートのデータによると、金融セクターはAIによるBECの主要な標的となっている。具体的な防御策

コントロールリスト:

| 封じ込め | 実施方法 | (製造原価 |

|---|---|---|

| 反漁業MFA | すべての金融口座 100% FIDO2 | $75,000 デプロイメント |

| コールバック検証 | 資金移動のための第二要因の義務化 | プロセスの変更(追加費用なし) |

| 支払い承認ワークフロー | 複数レベルの認可、金額のしきい値 | $20,000-$40,000 工具 |

| サプライヤー検証 | DNS/DMARCチェック、第三者検証 | $10,000-$20,000 工具 |

| 深い偽造検出 | ビデオ/オーディオ真正性チェッカー | $30,000-$50,000/year |

| 定期的なトレーニング | BEC攻撃をシミュレートするセキュリティ啓発テスト | $10,000-$20,000/year |

リスク軽減の費用対効果:

-

平均BECコスト:1イベントあたり$200,000~$500,000

-

99%攻撃を阻止する防御策

-

1回のストップに成功すれば、1年分のコントロール代が支払われる。

VIII.古典的問題のまとめ

質問1:AIによって脅威の露出度が変化していると回答した組織はどのくらいありますか?

ソリューション

主要なベンダーや機関のレポートによれば、AIは2025年の攻撃と防衛の両方において重要な要素であり、急速な成長を遂げている:

-

93%のセキュリティ・リーダー、2025年までにAIによる攻撃を毎日受けると予想

-

89%、AIを活用したプロテクションがディフェンス・ギャップの解消に不可欠と見る

-

76%、AI攻撃のスピードと巧妙さが防御を凌駕していると報告

-

86%のビジネスリーダーは、過去12カ月間に少なくとも1件のAI関連インシデントを報告した。

質問2:AIのディープフェイクは本当にBECの主要なドライバーなのか?

ソリューション

はい。2025年警告は、現実的な内容の音声およびテキストによるなりすましを対象としています。組織は次のことをしなければならない:

-

資金移動またはアクセス権の付与に関するあらゆる要求の帯域外の検証

-

メッセージで受信したことのない、既知の電話番号を使用してコールバックする。

-

ビデオ検証のための深い偽造検出ツールの実装

-

緊急」資金提供要請の承認要件の強化

ディープフォージェリーは現在、全詐欺攻撃の6.51 TP3Tを占め、2022年から21371 TP3T増加している。

質問3:公開されたAIインフラは本当に一般的なのか?

ソリューション

はい。業界のスキャンによると、何百もの保護されていないAIデータストアとエンドポイントがあり、多くの場合、コンテナ化され、公共のウェブ上でアクセスできるように展開されている:

-

認証なしでデータの読み書きが可能な、完全に保護されていない200台以上のChromaサーバー

-

インターネット上で1万件以上のOllamaが暴露される

-

2,000台のRedisサーバーが無防備に

-

部分的に保護されているが、露出している多数の追加サーバー

-

これらは設定ミスの問題であり、ゼロデイ問題ではない!

質問4:AIは本当に守備側の妥協コストを削減するのか?

ソリューション

IBM Cost of a Data Breach 2025」レポートによると、セキュリティAIと自動化を使用している組織は、通常、同業他社よりも平均侵害コストが低いと報告している:

-

AIツールを使用する組織は、リークのライフサイクルを80日短縮

-

平均貯蓄額 $1.9 百万ドル

-

複数の環境漏れ(最も高いコスト)の場合、節約額はさらに高くなる。

-

同じデータセットを分析する第三者は、カーブ・アクセラレーションの利用を強調しており、検知と対応に少なくとも限定的にAIを利用していると報告する企業が増えている。

ただし、これはツールを導入し、正しく運用している組織に対してのみ有効である。普及曲線はまだ初期段階にある。

質問5:今期、財務部門はどのような個別管理を実施すべきですか?

ソリューション

2段階ルール:

-

すべての金融口座のフィッシング対策MFASMSやEメールコードではなく、FIDO2/WebAuthnを使用してください!

-

支払いまたは銀行明細の変更に伴うコールバック検証の義務化従業員のファイルに保存されている、既知の電話番号を使用する。

これらのコントロールは、BECが成功する可能性を劇的に減らし、最も一般的な初期アクセスベクターをブロックする最も費用対効果の高い方法です。

質問6:脆弱性の傾向について、権威ある年次ベンチマークは?

ソリューション

まずはこれらを確認し、次にセクターごとのニュアンスをクロスチェックする:

-

ベライゾンDBIR 2025 - イベントモデルの最大限の根拠

-

IBMコスト・データ侵害レポート 2025 - コストと根本原因の分析

-

CrowdStrike2025 ランサムウェアに関する調査 - 特にランサムウェアとAI加速攻撃

-

ENISA 脅威の風景 2025 - 欧州の視点と新たな脅威

-

マイクロソフト デジタル ディフェンス レポート 2025 - 取引相手と防衛能力に関するグローバルな見解

-

トレンドマイクロ AIセキュリティ現状報告(2025年上半期) - AIインフラとエージェントのセキュリティ

業界の参考文献とギャップ分析

9.1 国防フレームワークのベンチマーク

多くの組織では、成熟度モデルやフレームワークを使用してセキュリティ体制を評価している。この分析では、主要なフレームワークがAIセキュリティをどのように扱っているかを比較する:

| フレームワーク/規格 | AIカバレッジ | プロキシー・ガバナンス | キュー・インジェクション | 向き不向き |

|---|---|---|---|---|

| NIST AI RMF | 包括的(統治/地図/測定/管理) | 説明的 | 隠す | 御前 |

| ISO 27001 | 限定的(従来の情報セキュリティ) | ない | ない | 俯す |

| ISO 42001 | 専門的なAI管理(2024年追加) | 説明的 | 説明的 | 御前 |

| CISコントロール | 限定的(主にインフラ) | ない | ない | 俯す |

| NISTサイバーセキュリティフレームワークv2.0 | 一部(AIへの配慮を追加) | パート | パート | 控えめ |

| PCI DSS 4.0 | 限定的(データ保護の文脈においてのみ) | ない | ない | 俯す |

結論はNIST AI RMFとISO 42001は、AIのセキュリティ成熟度評価と実装に最も適したフレームワークである。

9.2 防御ツールの状況

SIEM/SOARプラットフォーム(イベント検知と対応)

| お飾り | AI検知機能 | AIエージェント・サポート | MCPセキュリティ | (製造原価 |

|---|---|---|---|---|

| Splunk Enterprise セキュリティ | 強い(機械学習による異常検知) | パート | ない | $150K-$500K/year |

| マイクロソフトセンチネル | 強い(Azure ML統合) | パート | ない | $50K-$300K/year |

| クラウドストライク・ファルコンXDR | 強い(行動分析学) | パート | ない | $200K-$600K/year |

| データドッグ | 控えめ | ない | ない | $30K-$200K/year |

| IBM QRadar | 控えめ | ない | ない | $100K-$400K/year |

AIインフラのセキュリティ(コンテナ/ベクター・データベースの保護)

| お飾り | クロマ・プロテクション | オラマ・プロテクション | レディスの保護 | MCPサポート |

|---|---|---|---|---|

| ウィズ | であります | であります | であります | であります |

| スニーク | 詰り | 詰り | 詰り | 詰り |

| アクア・セキュリティ | パート | パート | パート | 詰り |

| トレンドマイクロ | であります | であります | であります | であります |

| パロアルトネットワークス | パート | パート | であります | 詰り |

エージェントAIセキュリティ

| お飾り | 行動モニタリング | キュー・インジェクション検出 | ワークフロー・ガバナンス | 成熟度 |

|---|---|---|---|---|

| オブシディアン・セキュリティ | であります | であります | であります | 御前 |

| ラケラ | であります | であります | 詰り | 控えめ |

| レバフ | であります | であります | 詰り | 控えめ |

| ロバスト・インテリジェンス | であります | であります | 詰り | 控えめ |

| SOARワークフローのカスタマイズ | パート | 詰り | であります | 俯す |

9.3 社内の能力格差

典型的なビジネスの実際の状態と望ましい状態の比較:

| 能力 | 現在の状態 | 望む状態 | 格差 | ブリッジング費用 |

|---|---|---|---|---|

| AIインフラのインベントリー | 29%は完全なリストを持っている | 100% | 71% | $50-$100K |

| AIエージェント・ガバナンス・ポリシー | 21%には正式なポリシーがある | 100% | 79% | $30-$50K(戦略)+$50-$100K(ツール) |

| キュー・インジェクション・ディフェンス | 5%が実装された | 95% | 90% | $100-$200K(工具+改良品) |

| MFAの展開(財務) | 45% 釣り防止MFAの使用 | 100% | 55% | $75-$150K |

| AIツール DLP | 18%が実装された | 80% | 62% | $95-$190K |

| SIEM/AI統合 | 35%には何らかのAI検知機能がある | 90% | 55% | $150-$300K |

| セーフティ・オートメーション | 40%は基本SOAR | 85% | 45% | $100-$200K導入+$50-$100K/年 |

ギャップ・クロージングの総費用初期費用$60万円~$120万円+運転費用$10万円~$20万円/年

X. 結論

10.1 主要な調査結果

2025年、AIはサイバーセキュリティ体制にとって諸刃の剣となった。主な調査結果は以下の通り:

-

脅威の増大が防衛を上回るTP3Tの組織的な報告は、攻撃のスピードに対応できない。

-

AIインフラは新たな攻撃対象ベクター・データベース、推論サーバー、モデル・リポジトリーなど、何千ものAIシステムが公開されている。これらは高度な脅威ではなく、基本的なセキュリティ衛生の問題である。

-

シャドーAIがデータ漏洩の新たな原因にAIツールの無制限な使用は、さらに$67百万/リークにつながる。ほとんどの組織では基本的な管理ができていない。

-

エージェントAIは新たな特権ユーザーAIエージェントは今や、人間の従業員よりも多くのシステムにアクセスできる。ほとんどの組織は適切なガバナンスの枠組みを持っていない。

-

ディープ・フォージェリーは現在市販されている音声と映像のクローニングは、高価な特注攻撃から比較的安価な大規模作戦へと進化している。

-

ディフェンスのROIは明確AI防御を使用する組織は、侵害1件につき平均$1.9百万ドルを節約できる。早期に投資した組織は、コストと対応時間の両方で勝利する。

-

地域による大きな違い香港をはじめとするアジア太平洋地域は、世界平均を上回る脅威に直面しています。特に、金融センターは標的型BECや深 刻な偽造行為にさらされている。

10.2 意思決定者のための優先行動項目

即時(0~30日目)

-

すべてのAIシステムの棚卸しと分類

-

金融セクターの全口座に対するアンチフィッシングMFAの展開

-

インターネット向けベクターデータベースのスキャンと認証の追加

-

資金移動のコールバック検証を有効にする

コスト:$75K-$150K|ROI:ブロック平均$200K+BEC

短期(30~90日)

-

AIエージェントのガバナンス・フレームワークとインベントリーの確立

-

エンタープライズ・データ分類とシャドーAI DLPの導入

-

異常を検出するための行動分析の導入

-

配備されたすべてのAIシステムのセキュリティ監査を実施する。

コスト:$150K~$300K|ROI:シャドーAI流出リスクの低減 $278M+

中期(90~180日目)

-

AI主導の検知のためのSIEM + SOAR統合の導入

-

プロンプトインジェクションとベクターポイズニング防御の展開

-

迅速な対応のためのセキュリティ自動化の構築

-

プロキシシステムのレッドチームテストの実施

コスト:$20万~$40万|ROI:テスト期間80日短縮、$190万/漏洩の節約

長期(180~365日目)

-

完全なゼロ・トラスト・アーキテクチャの実装

-

AI開発と展開のための安全なSDLCの確立

-

エージェントの継続的なセキュリティ監視の確立

-

組織固有のAIセキュリティ文化の構築

コスト:$30万~$60万|ROI:高コストの事象を防止するための回復力の構築

10.3 アジア太平洋地域への特別な提言

香港特有の脅威のシナリオを考えれば、現地の組織は特に懸念すべきだろう:

-

金融機関のためのBEC対策:: 大口の送金や国際取引のため、金融部門では厳格な決済ガバナンスを実施すべきである。

-

小売業界における不正検知小売部門の不正率は17.8%(前年比113%増)であり、不正検知ツールへの投資を優先すべきである。

-

国境を越えた脅威情報香港の地理的位置により、アジア太平洋地域の特定の脅威グループによる標的になりやすい。地域のCERTおよび法執行機関と脅威インテリジェンスを共有する。

-

規制遵守香港のデータ保護規制と国際的なコンプライアンス要件の高まりにより、クラウドとAIシステムにおける適切なデータ分類と保護が重要になっている。

-

サプライチェーンの回復力グローバル・サプライチェーンにおけるAIの広範な統合を考慮すると、組織はサードパーティのAIツールやサービスの安全性を評価すべきである。

10.4 最終勧告

右最高セキュリティ責任者(CSO国際連合の

-

リスク選好度の再評価: AIの脅威のスピードと規模が変わった。従来の冷静な評価サイクルでは遅すぎる。迅速な意思決定のための枠組みを作る。

-

商品よりも観測可能なものに投資する最新のツールを手に入れることよりも、AIシステムの異常を検出し、挙動を追跡できる観測値に焦点を当てる。

-

AIセキュリティの専門知識の構築ほとんどの組織は、従来のサイバーセキュリティに関する深い専門知識を持っているが、AI特有の脅威に関する専門知識は不足している。AIセキュリティの専門家の採用や育成を優先する。

-

優先事項としてのプロキシー・ガバナンスの実施: エージェントAIを大規模に展開する前に、ガバナンスの枠組みを確立せよ。事後のガバナンスは事前のガバナンスの10倍のコストがかかる。

運営指導者への提言

-

AIのセキュリティはビジネスリスクサイバーセキュリティは「ITの問題」ではなく、事業継続のリスクである。AIセキュリティを企業のリスク管理に組み込む

-

予防は修理よりずっと安い漏えい1件につき$4.44Mのコスト。防衛投資のROIは明らかで、漏水1件あたり平均$220万円の節約。

-

シャドーAIはコンプライアンスリスクAIツールの無秩序な使用は、データプライバシー規制(GDPR、CCPA等)に抵触する可能性がある。リスクをコントロールするためのガバナンスの枠組みがある。

-

サプライヤー・リスクの拡大あらゆるAIツール、クラウドサービス、サードパーティモジュールは、新たな次元のリスクをもたらす。サードパーティによる厳格なセキュリティ評価を実施する。

10.5 将来性

2026年までには、こうなることが予想される:

-

AIによる攻撃は今後も加速する特に代理AIの分野で

-

防衛技術は成熟する防衛のためにAIツールを採用する組織はさらに普及するだろう

-

規制の枠組みは後に続くAIのセキュリティガバナンスにISO 42001とNIST AI RMFを使用することが義務化される。

-

エージェントAIのセキュリティが大きな焦点に脆弱性やインシデントの大半は、設定ミスや侵害されたエージェントが関係している。

-

ディープな偽造詐欺が増加生体認証と多要素認証が一般的になるまで

重要なのは、今行動することだ。今日、AIセキュリティに投資する組織は、脅威の迅速な検知、迅速な対応、コストと風評被害の軽減により、来年、競争優位に立つことができるだろう。

参考文献

-

ベライゾン データ侵害調査報告書(DBIR)2025 - インシデントおよび侵害データの最大データベース

-

IBM データ侵害コスト・レポート 2025 - 世界の平均侵害コスト($444M)、産業別および地域別に分析

-

CrowdStrike 2025 State of Ransomware Report - 76%の組織はAIの攻撃速度に及ばない

-

Microsoft Digital Defense Report 2025 - 国家レベルの脅威と防衛能力

-

トレンドマイクロ「AIセキュリティの現状」レポート2025年上半期 - 露出したOllamaインスタンスは1万台以上、無防備なChromaサーバーは200台以上

-

ENISA 脅威の展望 2025 - 欧州の脅威の展望

-

世界経済フォーラム・グローバル・サイバーセキュリティ展望2025 - 93%のセキュリティ・リーダーたちは、毎日のAI攻撃に期待している

-

カスペルスキー金融セクターレポート2025 - 12.8%のB2B金融がランサムウェアに直面

-

KELA エスカレートするランサムウェア・レポート 2025 - 34% 世界の主要セクターの成長、製造業の成長 61%

-

HKCERT香港サイバーセキュリティ・アウトルック2025 - フィッシング7811件(+108%)、マルウェアインシデント+4.8倍

-

NIST 人工知能リスク管理フレームワーク(AI RMF) - 企業AIセキュリティのための実装フレームワーク

-

ISO 42001 - AIマネジメントシステム規格

-

OWASP LLMリスクTOP10 - LLM特有の脆弱性カテゴリー

-

マッキンゼー 安全・安心なエージェント型AIの導入 - エージェント型ガバナンスのベストプラクティス

-

Obsidian Security Agentic AI Security Report - 69%の企業がAIエージェントを導入、セキュリティ制御を実施しているのは21%のみ

-

DeepStrikeのAIサイバー攻撃統計 2025年 - 72%の成長、$30Bの被害予測

-

KnowBe4 2025年フィッシング傾向レポート - AIを利用したフィッシングメールは83%

-

Cysure 2025 BEC レポート - Google/Facebook $100M+ ベンダー詐欺事件

-

Deep Instinct 金融サービスAIサイバー攻撃調査 - 45% AI攻撃に直面して

-

NIST SP 800-63-4 - パスワードレス MFA を含む、認証およびライフサイクル管理の基準

-

香港警察サイバーセキュリティ犯罪統計(2025年上半期)-HK$3.04Bの損失、前年同期比15%増

-

Thales 2025 Data Threat Report APAC Edition - 65% 組織はAIをセキュリティ上の最重要課題と考えている

-

フューチャーCISO香港 2025年サイバーディフェンス - 6.2%のデジタル詐欺率

元記事はChief Security Officerによるもので、転載の際はhttps://www.cncso.com/jp/2025-ai-cyber-attack-trends-security-report.html。