多くの人は、AIがサイバーセキュリティに与える影響は、主に「より賢いツールが1つ増える」という形だと考えている。しかし、アジア太平洋地域(AP)におけるAIのサイバーセキュリティに関するこの大要を読むと、より切実な結論が浮かび上がってくる:AIは攻撃をより速く、より安く、よりリアルにするまた、モデル、データパイプライン、トレーニング、配備プロセスなど、企業のシステムアーキテクチャにおける新たな「弱い層」の出現にもつながっている。

つまり、あなたはAIを使って効率を高め、攻撃者はAIを使ってスピードを高めているのだ。

以下は、この報告書から最も価値のあるものを抜き出したもので、判断や管理に直接使えるように凝縮したものである。

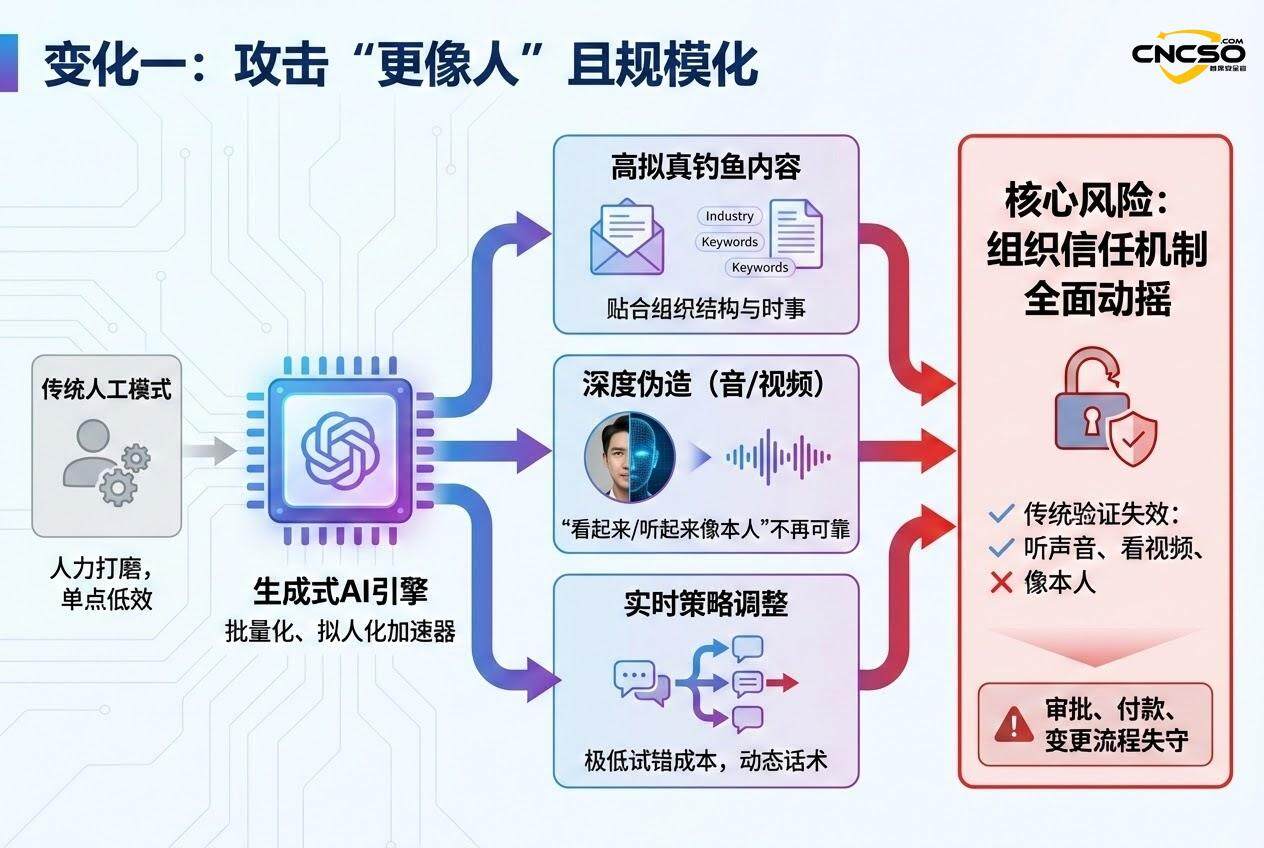

01 変化1:攻撃は「より人間的」に、そして大規模に

従来の時代には、フィッシングメール、カスタマーサービスのなりすまし、ソーシャルワーカーからの電話は人間によって磨かれていた。今やジェネレーティブAIは、この問題を「量産」することができる:

-

- より通常のコミュニケーションに近い釣りコンテンツを書き、業界のトーンや組織構造、時事問題にも適合させる。 -

- ディープ・フォージェリー(音声/映像)は強力な証拠から「そっくりさん」を取り除く -

- また、リアルタイムで戦術や戦略を調整することができ、試行錯誤のコストも非常に少なくて済む。

これは単一のリスクではなく、組織レベルの変化をもたらす:信頼のメカニズムが揺らいでいる。かつては「声を聞く」「ビデオを見る」「相手のように話す」ことに頼っていた承認、支払い、変更のプロセスの多くが、不十分になってきている。声を聞く」、「ビデオを見る」、「相手のように話す」ことに頼っていた承認、支払い、変更のプロセスの多くは、もはや十分ではなくなってきている。

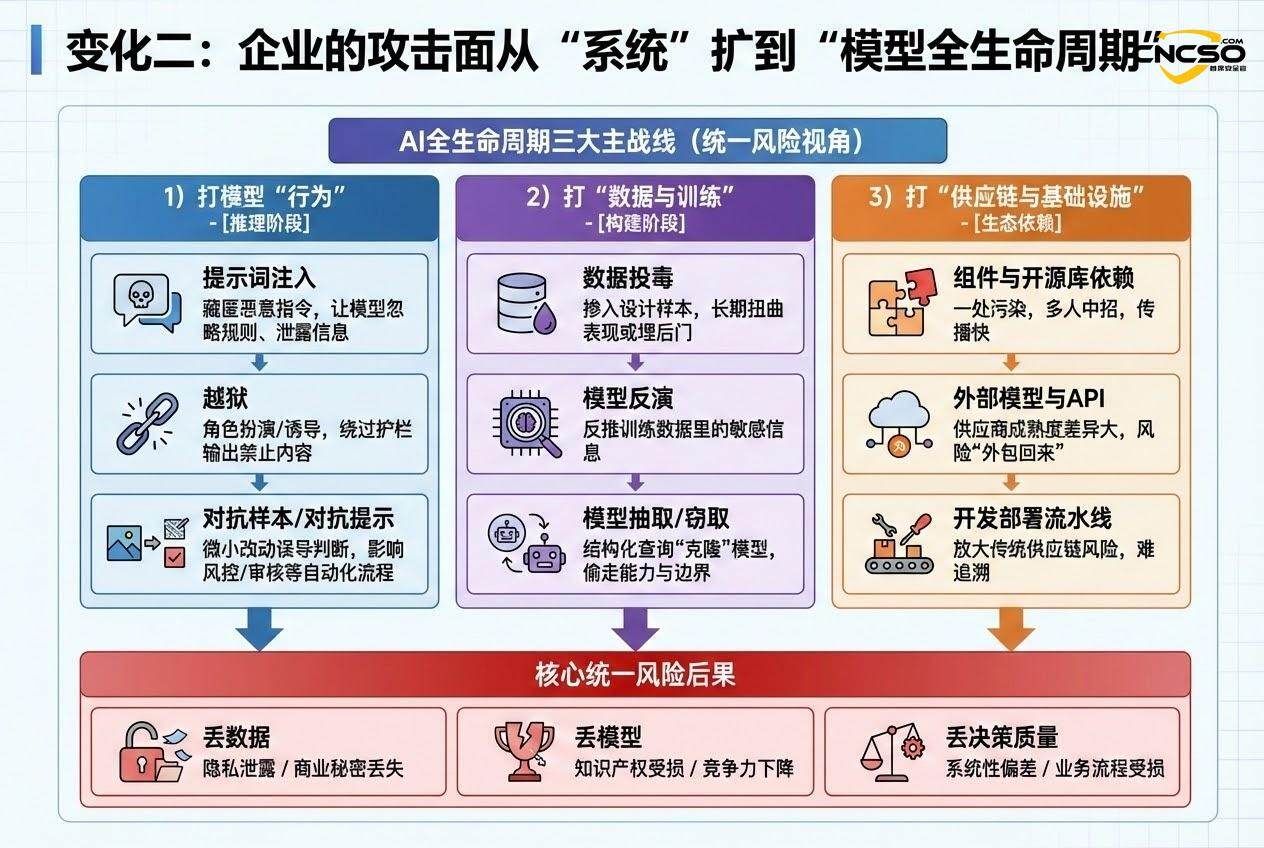

02 変化2:企業は攻撃対象領域を「システム」から「フルモデルライフサイクル」へと拡大する。

報告書は、AI関連のサイバー攻撃を3つの大きなカテゴリーに分類している。

1)模範的な「行動」を演じる:キューワードの注入、脱獄、対決のサンプル

-

• 迅速な注射ユーザー入力、文書、ウェブページ、データに悪意のある指示を隠し、モデルが「ルールを無視」したり、情報を漏らしたり、やってはいけないことをするように仕向ける。 -

• 脱獄ロールプレイングや多段階誘導などでガードレールを迂回し、禁じられているはずのことをモデルに出力させる。 -

• 対立のサンプル/対立のヒントモデルが判断を誤り、自動化されたプロセス(リスク管理、不正防止、コンテンツレビューなど)に影響を与えるようなインプットを、小さいながらも意図的に変更する。

これは "技術界の難解な話 "のように聞こえるかもしれないが、突き詰めれば非常にシンプルなことなのだ:1つの文章、1つの文書、1つの外部コンテンツ参照その結果、モデルが狂ってしまい、下流工程に影響を及ぼすことになる。

2) 「データとトレーニング」との戦い:データ・ポイズニング、モデル・インバージョン、モデルの盗用

-

• データ・ポイズニング"普通に見えるが細工された "サンプルをトレーニング/微調整データに混ぜ、時間の経過とともにモデルの性能を歪め、さらにはバックドアを仕掛ける。 -

• モデルの反転常に出力を問い合わせることで、訓練データの機密情報を隠蔽する。 -

• モデル抽出/盗難構造化されたクエリーを大量に使ってモデルを "クローン "し、能力と境界を盗む。

核となるリスクは明らかだ:

データ(プライバシー/企業秘密)、モデル(知的財産/競争力)、そして決定の質(システマティック・バイアス)の両方を失う可能性がある。

3) 「サプライチェーンとインフラ」との戦い:コンポーネント、外部モデル、開発と展開のパイプライン

AIシステムは多くの場合、オープンソースライブラリ、事前学習済みモデル、サードパーティAPI、クラウドインフラ、自動展開ツールなど、外部のエコシステムに大きく依存している。報告書は、これが従来のサプライチェーン・リスクを増幅させる可能性があることを強調している。一人が汚染されれば、多くの人が影響を受けるまた、追跡が難しく、すぐに拡散する。

プロバイダーの成熟度は千差万別である。十分にガバナンスが効いているプロバイダーもあれば、まだ駆け出しのプロバイダーもある。ガバナンスに目を向けず、機能性にしか目を向けない企業は、簡単にリスクを「アウトソーシングし返す」ことができる。

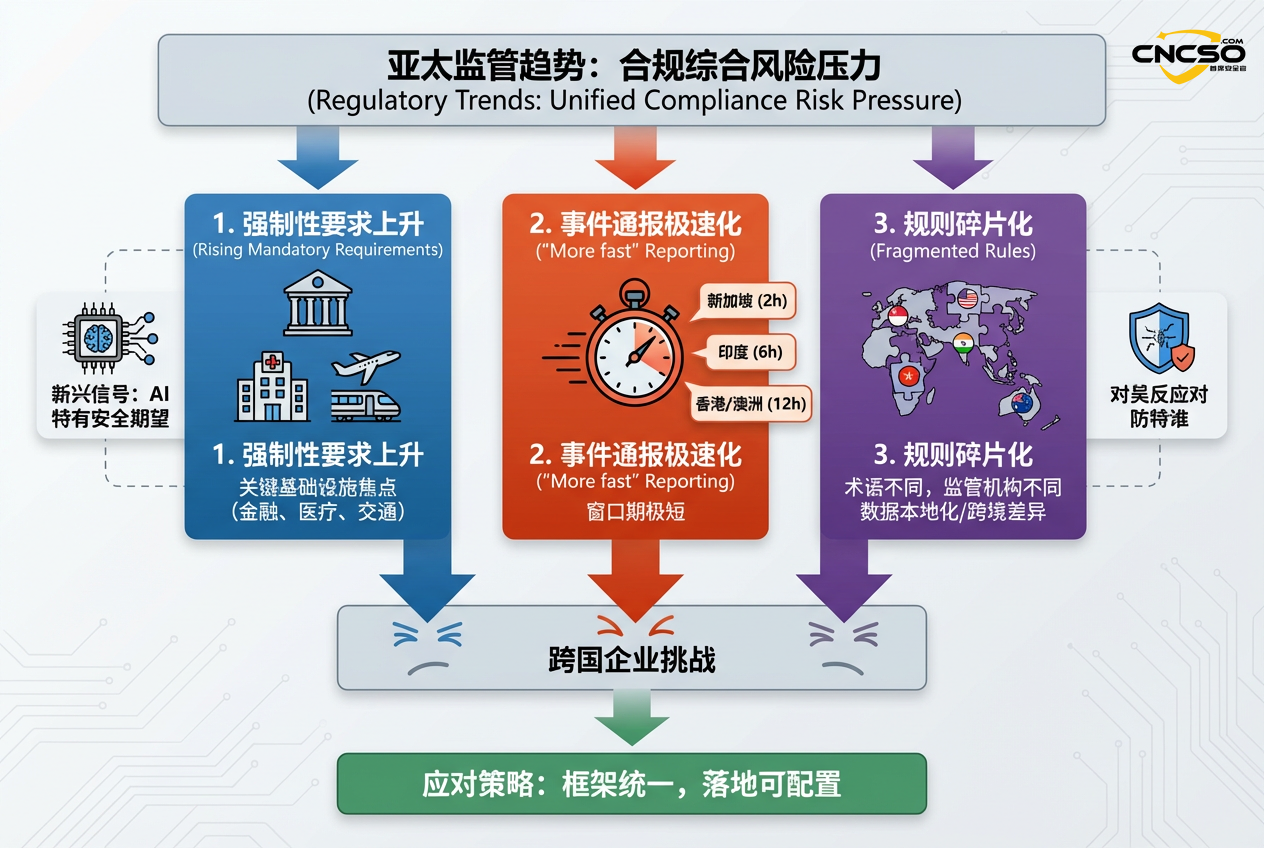

03 規制動向:義務化、細分化、迅速な通知の重視

アジア太平洋地域の規制環境は、主に2つの点から企業に圧力をかけている:

-

1. 義務化される安全要件が増加重要インフラ、金融、医療、運輸などが特に顕著だ。 -

2. インシデント通知はますます "緊急 "になっている重要インシデントの報告窓口が非常に短い国もある(シンガポールは特定のシナリオで2時間、オーストラリアは場合によっては12時間、インドはCERT-Inへの報告に6時間、香港は重要インフラ法施行後、重大インシデントの報告窓口が12時間と報告されている)。

同時に、ルールは断片化用語は異なり、適用対象も異なり、規制機関も異なり、データのローカライゼーションやクロスボーダー要件も異なる。多国籍企業にとって、テンプレートのセットを使用することは難しく、「統一された枠組みを作るだけで、地面を構成することができる」。

もう1つの注目すべきシグナルは、ほとんどの地域で伝統的なサイバーセキュリティのフレームワークが依然として優勢である一方で、次のようなことである。AI特有のセキュリティへの期待例えば、モデルの頑健性、敵対的テスト、安全なデータ処理、(深層合成による)コンテンツ識別子の生成などである。

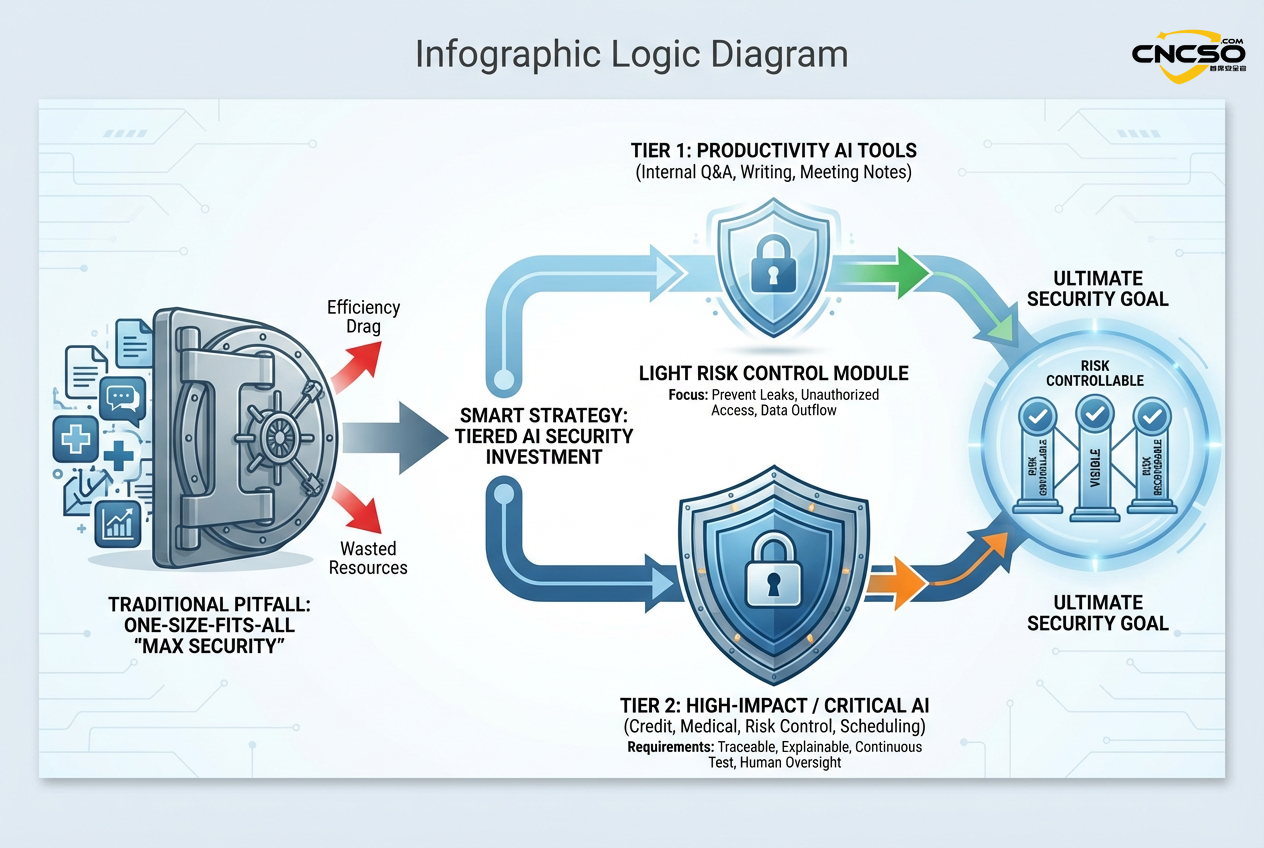

04 最も失敗しやすい点:すべてのAIを「トップ・セキュリティー」にすること。

報告書には、とても役に立つ注意書きがある:AIセキュリティインプットは "格付け "される必要がある。そうでなければ、資源の無駄遣いになるか、事業の効率性の足を引っ張ることになる。

シンプルだが有効な分け方はこうだ:

-

• 生産性AIツール(社内Q&A、検索、筆記用具、議事録):通常、軽めの管理は適用できるが、漏洩、権限の逸脱、データ漏洩は厳しくガードされる。 -

• 意思決定クリティカル/顧客志向の影響力の大きいAI(クレジット、クレーム、リスク・コントロール、メディカル・アシスト、クリティカル・ディスパッチ):トレーサビリティ、解釈可能性、継続的テスト、人間の監視に重点を置いた、より厳格なセキュリティと監査要件が必要である。

セキュリティの目標は、AIが「絶対に失敗しない」ことではなく、リスクと影響を最小限に抑えることである。制御可能、可視化可能、回収可能。

05 企業が直接コピーできる「7つの着陸帯リスト」。

社内に持ち帰って議論し、システムに組み込めるバージョンが必要なら、この7つが最も重要だ:

-

1. AIサイバーセキュリティを取締役会レベルに

リスクのトレードオフ、リソースの投入、許容範囲、責任者、技術週報だけで終わらせない。 -

2. AI資産目録」を作成する。

どのようなモデルが使われているのか、データはどこから来ているのか、どのような外部APIが接続されているのか、誰が責任を負っているのか、リスクレベル、変更ログなど、明確なリストを作成する。インベントリーなしにガバナンスを語ることはできない。 -

3. リスクの高いシナリオは「安全第一」でなければならない。

本番稼動前に敵対的テストとレッドチーム訓練を実施し、本番稼動後も継続的モニタリングと定期的な再テストを実施する。 -

4. コンティンジェンシープランニングにAI特有の事象を組み込む

データポイズニング、モデルの盗難、モデルの改ざん、オーバーステップにつながるキューワードの注入などのシナリオに対処する方法を明確にする。 -

5. サプライチェーンは "契約上明確で、運用上管理しやすい "ものでなければならない。

契約では、データの使用方法、モデルの更新方法、変更の通知方法、インシデントの報告方法、サービスの継続性の保証方法などをカバーする必要がある。重要なサプライヤーは、単に契約して終わりというのではなく、常にコミュニケーションをとる必要がある。 -

6. アイデンティティと権限のシステムは、より厳格である必要がある。

多要素認証、最小権限、機密データの分離は、ソーシャルワーカーや綿密な偽造の機会を大幅に減らすことができる。 -

7. "言葉の信頼に依存する "重要なプロセスをやり直す

例えば、リスクの高い転送、設定変更、機密データのエクスポート:デュアルチャンネル検証(システム承認+コールバック検証/二次検証)を導入し、「~のように聞こえる」を証拠としないこと。

私たちが本当にアップグレードしなければならないのは、"信頼アプローチ "だ。

AIの問題点は「より賢くなる」ことではなく、偽造をより現実にし、攻撃をより安価にし、自動化によってミスを増幅しやすくすることだ。

ディープな偽造は確かに恐ろしいが、もっと恐ろしいのは......。私たちは、新しい時代の真実を検証するために、古い時代のプロセスや直感をまだ使っているのです。

ハンドルを持つオブジェクトの分類器AIセキュリティそれを正しく行うには、結局のところ、特定のツールや特定のルールが必要なのではなく、より洗練された組織能力が必要なのだ:

重要なリンクを検証し、重要な決定を追跡し、問題を回復することができる。

次に "リーダー "から緊急のメッセージを受け取ったり、システムが突然 "間違っているが、ただ間違っている "モデル出力のバッチを生成したりするとき、あなたのチームが運に賭ける必要がなく、確実に正しい結果を出すためのメカニズムを持っていることを望む。

参照する:

AIにおけるサイバーセキュリティの保護:新たなリスク環境におけるレジリエンスの構築(2025年12月)。

元記事はChief Security Officerによるもので、転載の際はhttps://www.cncso.com/jp/artificial-intelligence-entity-ai-attack-surface-and-risk.html。