Abstracts

2026.Die globale Sicherheitslandschaft befindet sich in einem grundlegenden Wandel. Sicherheit durch künstliche Intelligenz (KI)Die Landschaft befindet sich in einem grundlegenden Umbruch. Als Reaktion auf die weltweit bis zu 4,8 MillionenCybersecurity-TalentlückeImmer dann, wenn die KI-Technologie explodiert, wenden Unternehmen große Modelle von KI-Intelligenzen an, die rund um die Uhr im Einsatz sind. Allerdings.Diese autonomen Systeme mit hohen Privilegien, die rund um die Uhr online sind, werden zu einem bevorzugten Ziel für Angreifer. Sicherheitsorganisationen wie Palo Alto Networks, Moody's und CrowdStrike warnen, dass KI-Intelligenzen im Jahr 2026 die größte Bedrohung für Unternehmen darstellen werden. Herkömmliche Verteidigungssysteme versagen, und neue KI-gesteuerte Sicherheitssysteme sind das neue Sicherheitsparadigma geworden.

I. Die Natur der KI-Sicherheitskrise

1.1 Durch Talentlücken bedingtes Einsatzrisiko

Die weltweite Qualifikationslücke im Bereich der Cybersicherheit hat 4,8 Millionen Arbeitsplätze erreicht. Im Einzelnen:

- 95% des Cybersicherheitsteams weisen mindestens einen kritischen Mangel an Fähigkeiten auf

- 54% der Unternehmen verlassen sich bei der Ermittlung sensibler Daten auf die fehleranfällige Entwicklerdokumentation

- Nur 19% Die Organisationen sind "sehr zuversichtlich", was die Genauigkeit ihrer API-Listen angeht.

Angesichts des Fachkräftemangels verfolgen die Unternehmen aggressive Einsatzstrategien: Gartner erwartet, dass bis Ende 2026 die Zahl der Mitarbeiter in den Unternehmen steigen wird.40%s Unternehmensanwendungen zur Integration von KI-Intelligenzstellen(im Vergleich zu weniger als 51 TP3T zu Beginn des Jahres 2025). Dieses exponentielle Wachstum spiegelt die Dringlichkeit des Unternehmens wider, offenbart aber auch einen grundlegenden Widerspruch: Organisationen versuchen, die Lücke in der Sicherheitsexpertise mit unzureichend getesteten KI-Systemen zu schließen.

1.2 Die Privilegienkrise des "Superuser-Problems"

Um eine schnelle Bereitstellung und einen effizienten Betrieb zu gewährleisten, gewähren Unternehmen KI-Intelligenzen häufig übermäßige Privilegien - Datenbankzugriff, API-Aufrufe, Systemadministratorrechte, Zugriff auf das Mailsystem usw. Dies ist als "Superuser-Problem" bekannt.

Wendi Whitmore, Chief Security Intelligence Officer bei Palo Alto Networks, stellte dies klar:KI-Intelligenzen sind im Jahr 2026 die größte Insider-Bedrohung für Unternehmen.

Die drei Hauptgefahren der Zentralisierung der Autorität:

- Risiko des verketteten Zugangseine kontrollierte Intelligenz kann den Zugang zu kritischen Infrastrukturen im gesamten Unternehmen verketten

- Nahtloses AngriffsfensterIm Gegensatz zu menschlichen Mitarbeitern sind Intelligenzen rund um die Uhr online und können jederzeit angegriffen werden.

- autonome ZerstörungskraftEine gut konstruierte Hinweisinjektion genügt einem Angreifer, um Zugang zu einem autonomen "Insider" zu erhalten.

II. vielschichtige Angriffsfläche von KI-Intelligenzen

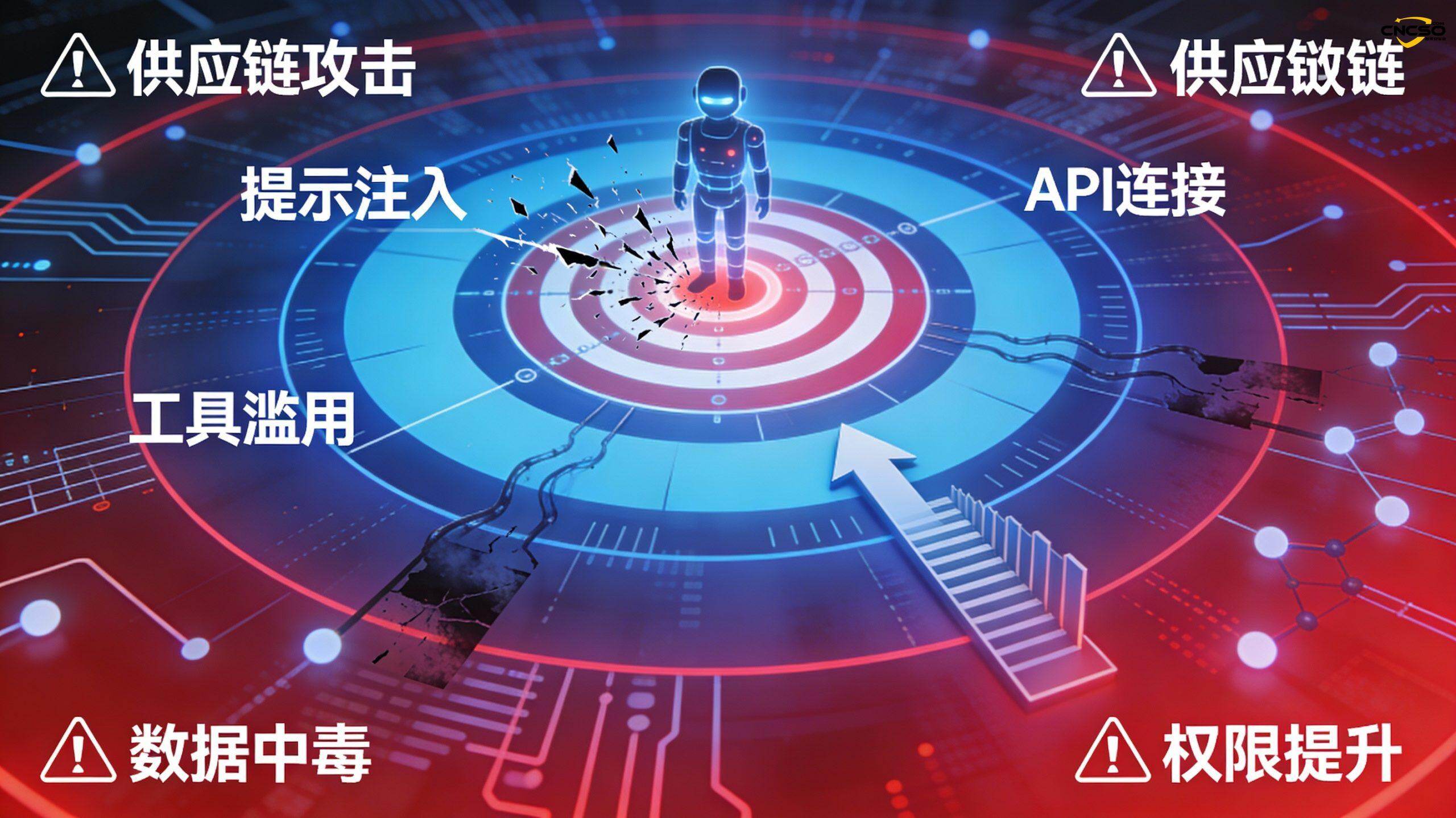

2.1 Fünfschichtige Angriffsflächenstruktur

Die Angriffsfläche von KI-Systemen übersteigt bei weitem die von herkömmlichen Anwendungen:

| Ebene | Art der Bedrohung | Besondere Risiken |

|---|---|---|

| Modellierungsschicht | Modell-Diebstahl, Backdoor-Injektion | Verlust von geistigem Eigentum, böswillige Handlungen |

| Datenschicht | Vergiftung der Trainingsdaten, Kontamination der Eingaben | Manipulation der Entscheidungsfindung, Durchsickern sensibler Informationen |

| Infrastrukturschicht | API-Missbrauch, Kompromittierung von Dienstkonten | Erhöhung der Autorität, Seitwärtsbewegung |

| Pipeline-Schicht | Angriffe auf die Lieferkette, Abhängigkeit von der Umweltverschmutzung | Netzwerkweite Infektion und weitreichende Zerstörung |

| Kontrollebene | Erhöhung der Autorität, Seitwärtsbewegung | Zentralisierung der Autorität, Wegfall der Gebietskontrolle |

2.2 Die wichtigsten Angriffsvektoren

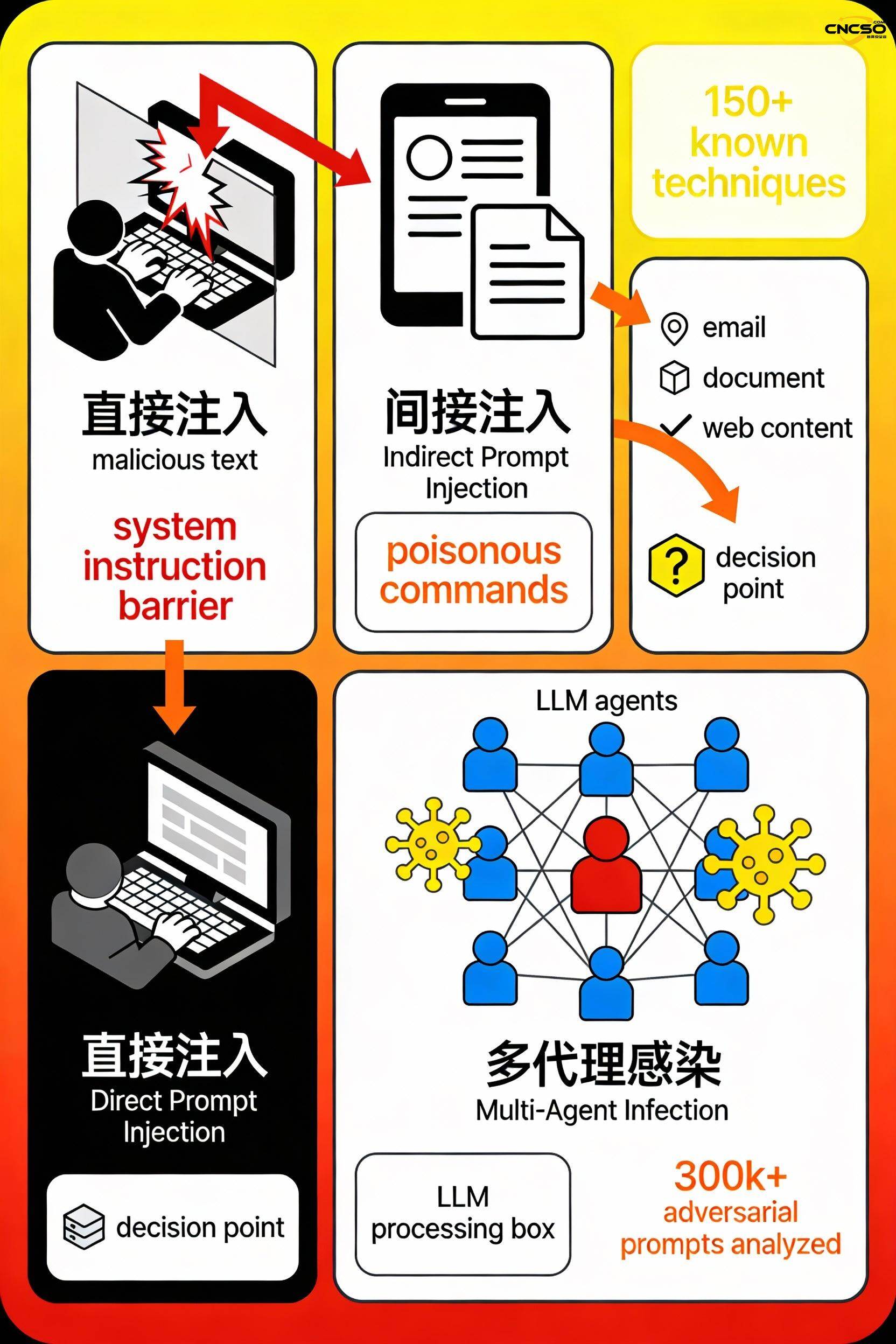

Cue-Injektion (über 150 bekannte Techniken)

- Direkte Injektion: Der Benutzer gibt explizit bösartige Befehle ein, um die Systemaufforderungen zu umgehen.

- Indirekte Injektion: bösartige Anweisungen, die in E-Mails, Dokumenten oder Webseiten versteckt sind

- Multi-Agenten-Infektion: Ein beschädigter Agent gibt bösartige Anweisungen an andere Agenten weiter, z. B. die Verbreitung eines Virus.

Tool-Missbrauch und API-Schwachstellen

- Unerlaubte API-Aufrufe führen zu erhöhten Datenzugriffsrechten

- DDoS-Angriffe überwältigen externe Systeme durch API-Flooding

- AgentSmith-Schwachstellenfall: Bösartige Agentenkonfiguration kann OpenAI-API-Schlüssel, Prompt-Daten und Benutzerdateien stehlen

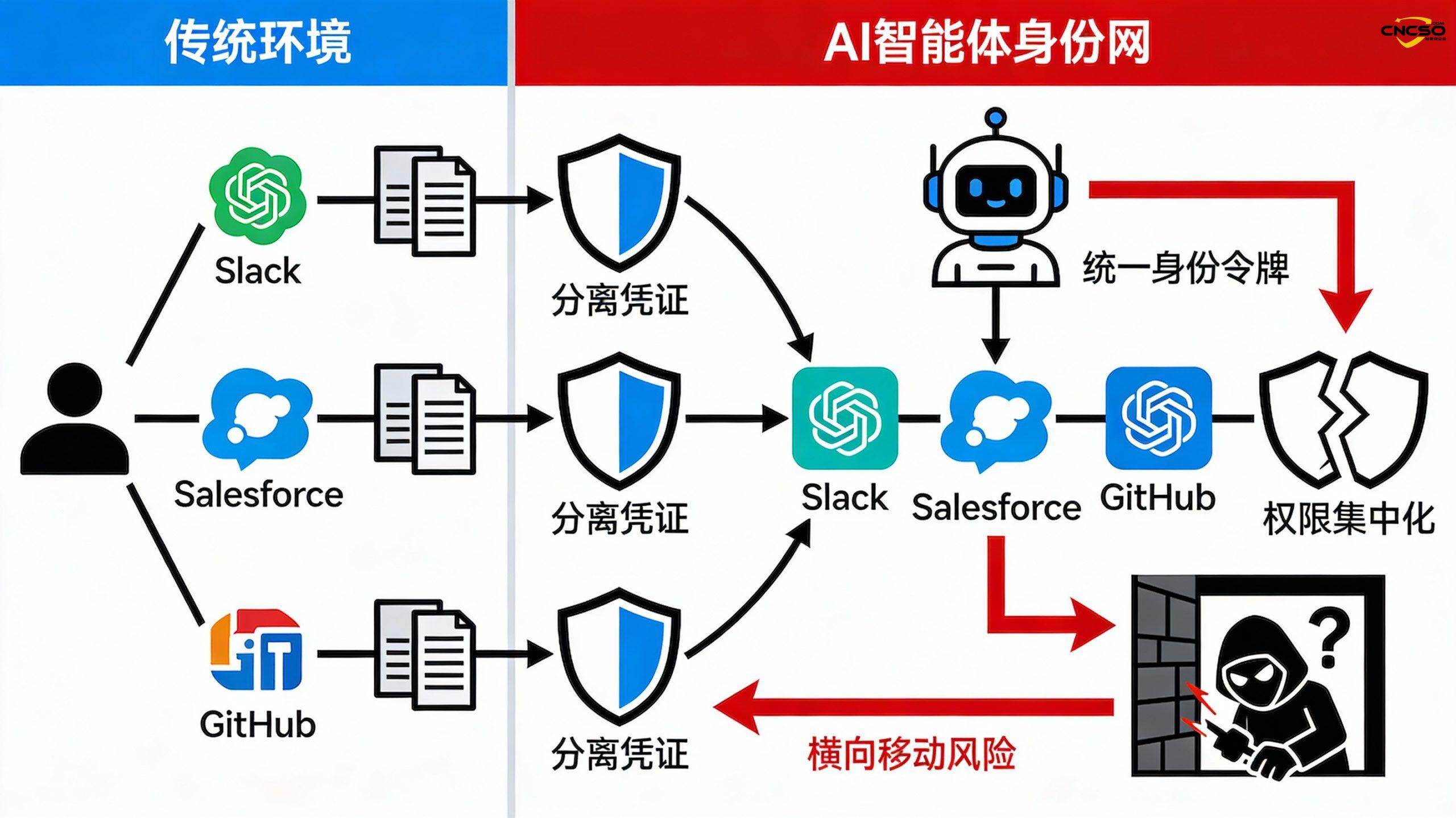

IdentityMesh-Schwachstelle (Zentralisierung von Berechtigungen über Systeme hinweg)

- Traditionelle Umgebung: Benutzer haben mehrere isolierte Anmeldedaten, jedes System wird unabhängig authentifiziert

- AI Intelligentsia: Ein einziger, einheitlicher Identitäts-Token für mehrere Plattformen, Einbruch der Sicherheitsgrenzen

- Folge: Angreifer können nahtlos systemübergreifende Privilegienerweiterung und laterale Bewegungen erreichen

Data Poisoning und der Byzantine-Angriff

- Das Einschleusen bösartiger Proben in die Trainingsdaten führt dazu, dass die Modelle schädliche Verhaltensweisen erlernen

- Der kompromittierte Nachrichtendienst speist falsche Informationen in interne Systeme ein und zerstört die Verteidigungsinfrastruktur selbst.

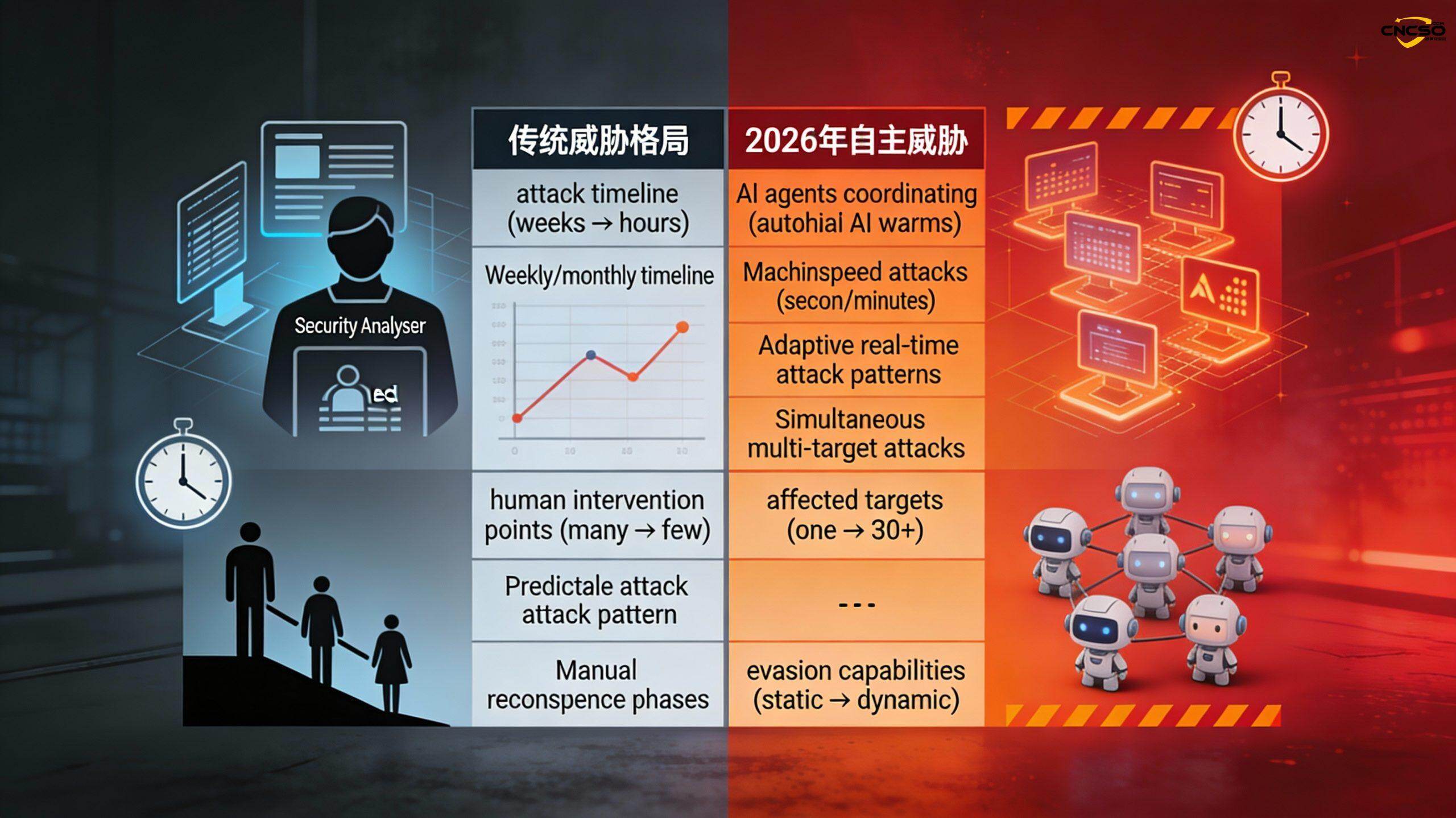

iii. die Bedrohung durch autonome Angriffe im Jahr 2026

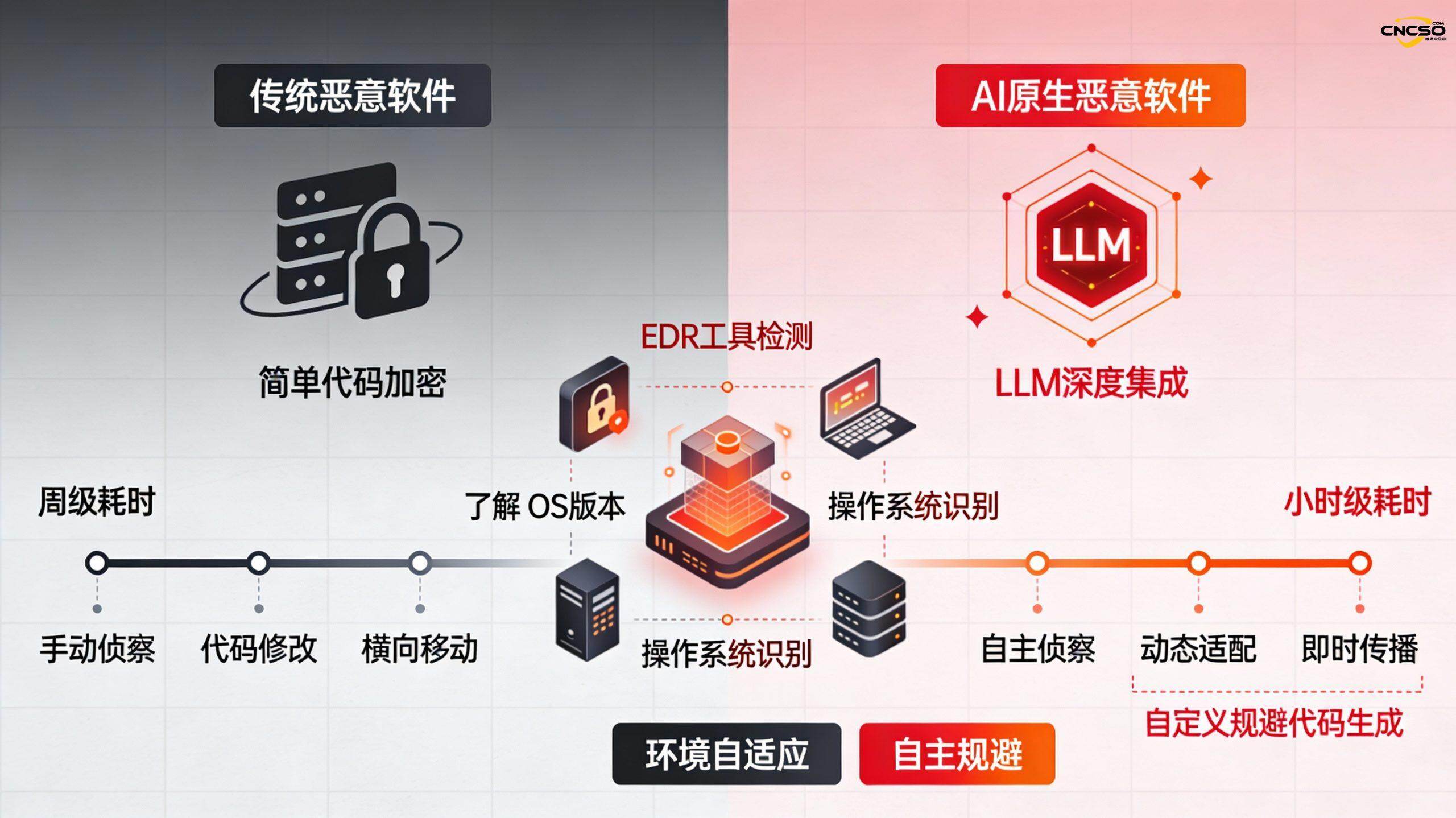

3.1 Entwicklung von KI-nativer Malware

Der Sprung von herkömmlicher polymorpher Malware (wöchentlicher Zeitaufwand, festes Verhalten) zu KI-nativer Malware (stundenweise zeitaufwändige, adaptive Umgehung).

Merkmale des PromptLock-Koffers:

- Echtzeit-Informationen über die Verteidigungsumgebung des Ziels (Scannen nach EDR-Tools, Betriebssystemversionen)

- Dynamisches Umschreiben von Quellcode zur Umgehung bestimmter Signaturen

- Angriffskette vonWochen komprimiert in Minuten

- Autonome seitliche Bewegung ohne menschliches Eingreifen

3.2 Angriff einer Multi-Agenten-Gruppe: GTG-1002-Aktivität

November 2025, reale Ereignisse, die von Anthropic:

| Norm | numerischer Wert | Bedeutung |

|---|---|---|

| gleichzeitiges Ziel | 30 globale Organisationen | Mittlere APT-Kapazität |

| autonome Umsetzung | 80-90% | nur 4-6 menschliche Entscheidungspunkte |

| Selbstentdeckung | 0个 | Nicht alle Opfer haben sich selbst entdeckt |

| Angriffsphase | Erkundung → Erstzugang → Seitwärtsbewegung → Datenextraktion | Vollständige Automatisierung Link |

Wichtigste ErkenntnisseKleine Angriffsteams können jetzt KI-Funktionen nutzen, um das zu tun, was früher große Teams erforderte. Die menschliche Reaktionszeit ist nicht mehr der begrenzende Faktor.

IV. Rahmen für die Steuerung von KI-Risiken

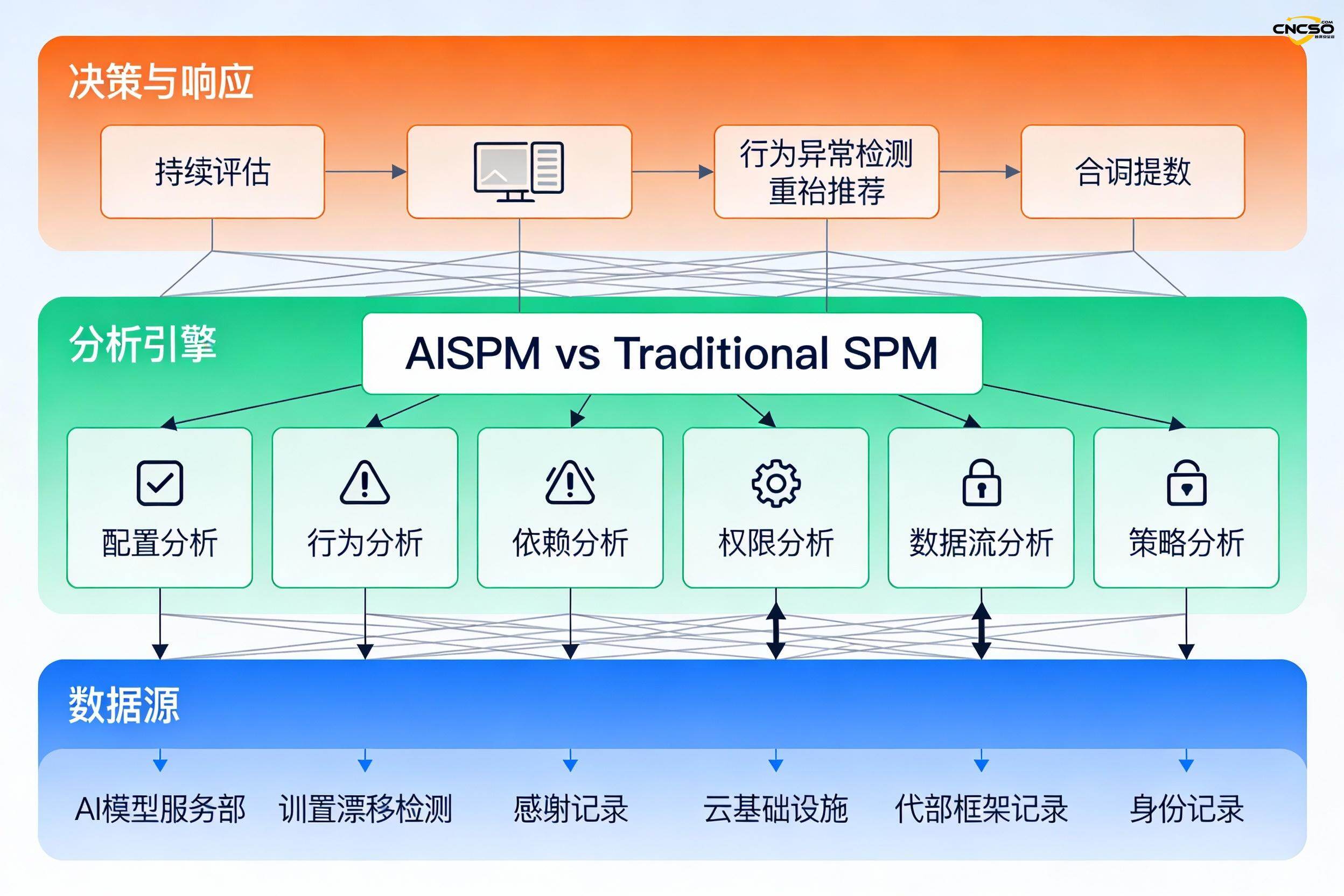

4.1 Verwaltung von KI-Sicherheitsmaßnahmen (AISPM)

Hauptunterschiede zwischen AISPM und traditionellem SPM:

Herkömmliche SPM-Tools sind gegen KI-spezifische Bedrohungen völlig unwirksam (sie sind nicht in der Lage, Hint Injection, Model Inversion und Elevation of Privilege zu erkennen).

Die vier Hauptfunktionen von AISPM:

- Kontinuierliche Bewertung der Situation - Echtzeit-Überwachung von KI-Systemen, -Modellen und -Datenpipelines zur Aufdeckung von Schatteneinsätzen

- Erkennung von Konfigurationsabweichungen - Kennzeichnung von nicht autorisierten Berechtigungen, Parametern und Konfigurationsänderungen bei der Bereitstellung

- Erkennung von Verhaltensauffälligkeiten - Einrichtung einer normalen Basislinie für die Echtzeit-Erkennung von Ausnahmen bei API-Aufrufen, Missbrauch von Anmeldeinformationen und rekursiven Schleifen

- Automatisiertes Schwachstellenmanagement - Erkennung und Priorisierung von Schwachstellen in der Trainingspipeline und im Modellcode

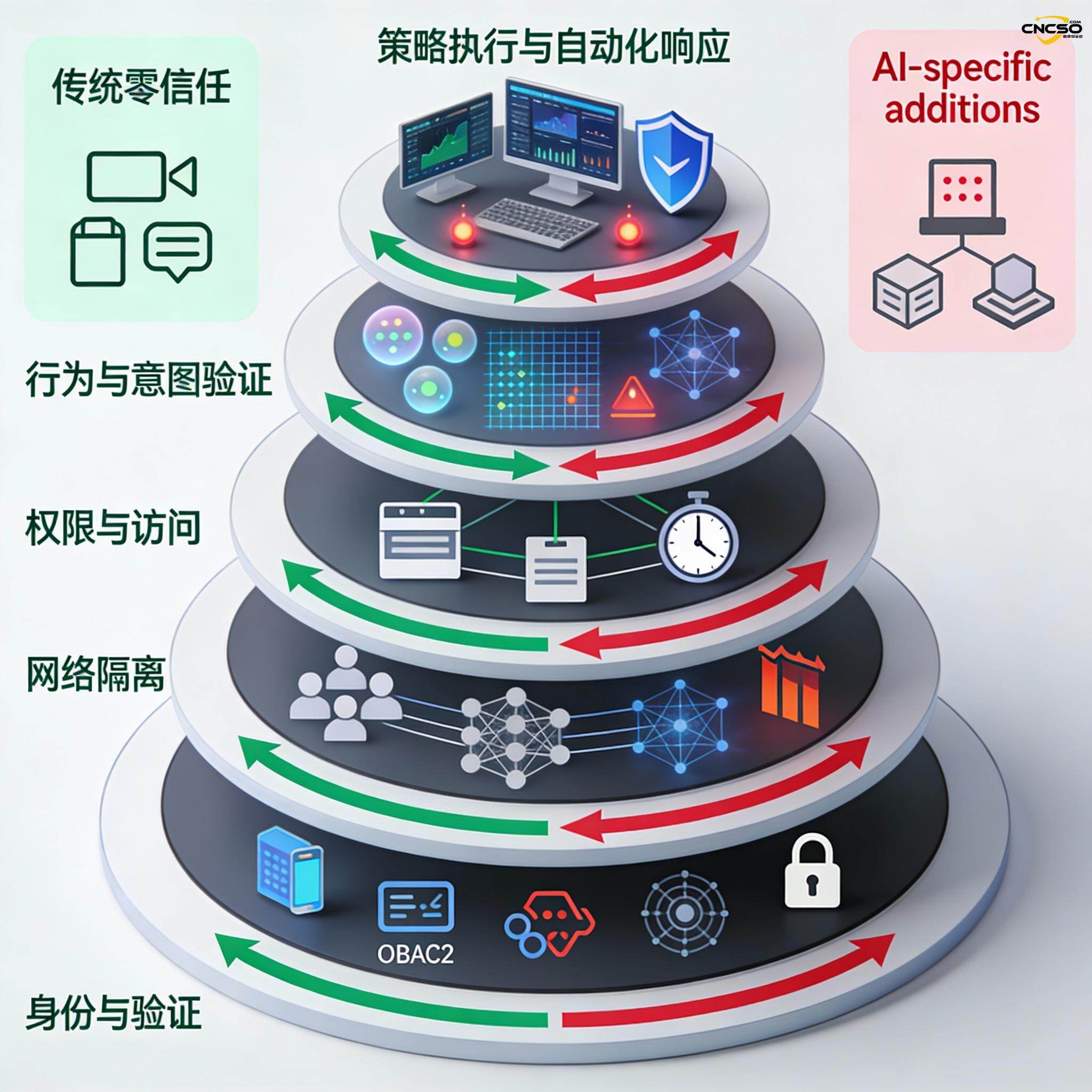

4.2 Fünf-Schichten-Modell für die Zero-Trust-KI-Architektur

Mehrschichtiges Verteidigungssystem:

Ebene 5: Durchsetzung der Strategie und automatisierte Reaktion

↑ Echtzeit-Richtlinien-Engine, automatische Isolierung, schnelle Reaktion der Maschine

Stufe 4: Verhaltens- und Absichtsüberprüfung

↑ Semantische Validierung, Musteranalyse, Erkennung von Anomalien

Schicht 3: Privilegien und Zugangskontrolle

↑ Geringste Rechte, Zeitablauf, rollenbasierter Zugriff

Schicht 2: Netzisolierung

↑ Differenzielle Segmentierung, eingeschränkte Kommunikation zwischen Agenten, verschlüsselte Kommunikation

Schicht 1: Identität und Authentifizierung

└─ Digitale Identitäts-Token, OAuth2, Multi-Faktor-Authentifizierung

4.3 Anwendung des NIST AI Risk Management Framework

Iteratives Vier-Schleifen-Modell:

- Verwaltung (GOVERN) - Schaffung einer Risikokultur und einer klaren Governance-Struktur

- Kartierung (MAP) - Positionierung von KI-Systemen, Erkennungstechnologien und sozialen Auswirkungen

- Messung (MEASURE) - Bewertung von Funktionalität, Datenqualität, Sicherheit und Gesundheit

- Verwaltung (MANAGE) - Einsatz von Kontrollen, Abhilfemaßnahmen, Reaktion auf Vorfälle

V. Fünfstufiges Programm zur Umsetzung der Governance bis 2026

Schritt 1: Prüfung der Proxy-Erkennung

- Liste aller KI-Tools und Automatisierungssysteme

- Mapping-Berechtigungen, Integration, Datenzugriff pro Bearbeiter

- Identifizierung von nicht verwalteten IT-"Schatten-KI"-Einsätzen

Schritt 2: Identitätszuweisung und Zugriffskontrolle

- Zuweisung einer eindeutigen digitalen Identität für jeden Mitarbeiter

- Ermöglicht eine zentrale Zugangskontrolle und Richtlinienverwaltung

- Festlegung klarer Eigentumsverhältnisse und Verantwortlichkeiten

Schritt 3: Richtlinienbasierte Leitplanken und Automatisierung

- Definition fein abgestufter Zugriffs- und Bereitstellungsrichtlinien (Policy as Code)

- Einrichtung automatischer Leitplanken für die Durchsetzung in Echtzeit

- Automatisierte Abhilfemaßnahmen (Entzug von Privilegien, Deaktivierung von Proxys)

Schritt 4: Überwachung und Indikatoren

- Definition der wichtigsten KPIs (Richtlinienverstöße, Antwortzeiten, Fehlerquoten)

- Einstellung von Ausnahmeschwellen und Echtzeitwarnungen

- Erstellung eines Dashboards zur Einhaltung der Vorschriften

Schritt 5: Prüfung und Einhaltung der Vorschriften

- Abbildung der regulatorischen Anforderungen auf die Governance-Politik

- Automatisierte Berichterstattung über die Einhaltung der Vorschriften und Sammlung von Beweisen

- Einrichtung eines vollständigen Prüfpfads

VI. zentrale Verteidigungsstrategie

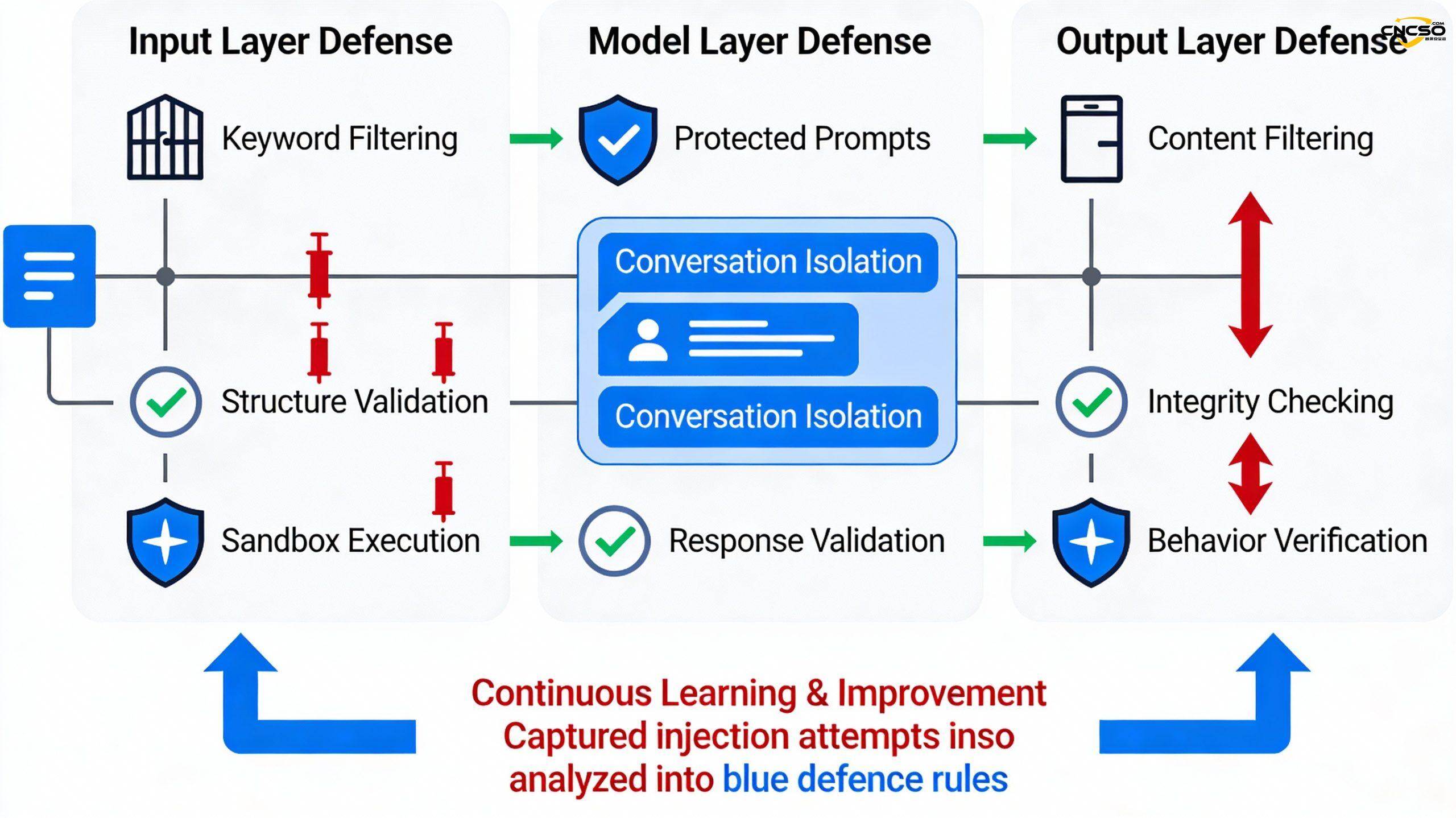

6.1 Drei Verteidigungsschichten gegen Cue Injection

- Eingabeschicht - Schlüsselwort-Filterung, strukturelle Validierung, Sandbox-Ausführung

- Modellierungsschicht - Härtung der Systemaufforderungen, Trennung mehrerer Dialogrunden, Validierung der Antworten

- Ausgabeschicht - Inhaltsfilterung, Integritätsprüfung, Verhaltensprüfung

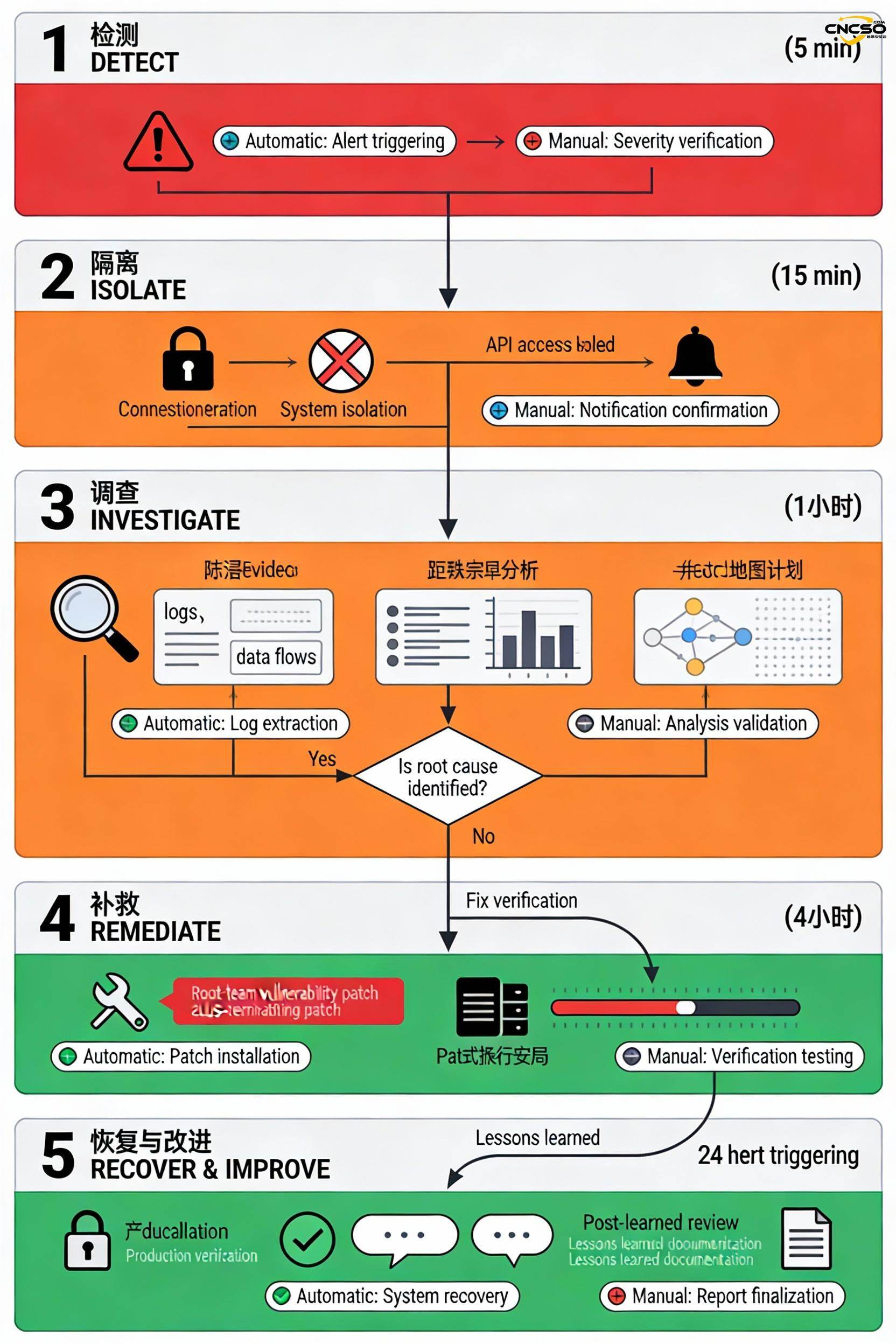

6.2 Fünfstufiger Prozess zur Reaktion auf Vorfälle

| Punkt | mal | Zentrale Maßnahmen |

|---|---|---|

| Erkennung | <5 Minuten | Alarm, Quittierung, Klassifizierung |

| Incommunicado | <15 Minuten | Berechtigungen entziehen, Verbindung trennen, Zugang sperren |

| Sonde | <1 Stunde | Sammlung von Beweisen, Scoping, Ursachenanalyse |

| Sanierung | <4 Stunden | Schließen von Schwachstellen, Validierung von Korrekturen, Datenwiederherstellung |

| Wiederaufnahme | <24 Stunden | Wiederherstellung von Privilegien, Authentifizierungsvorgänge, Analyse nach der Geschichte |

6.3 Intelligentes Lebenszyklusmanagement für Karosserien

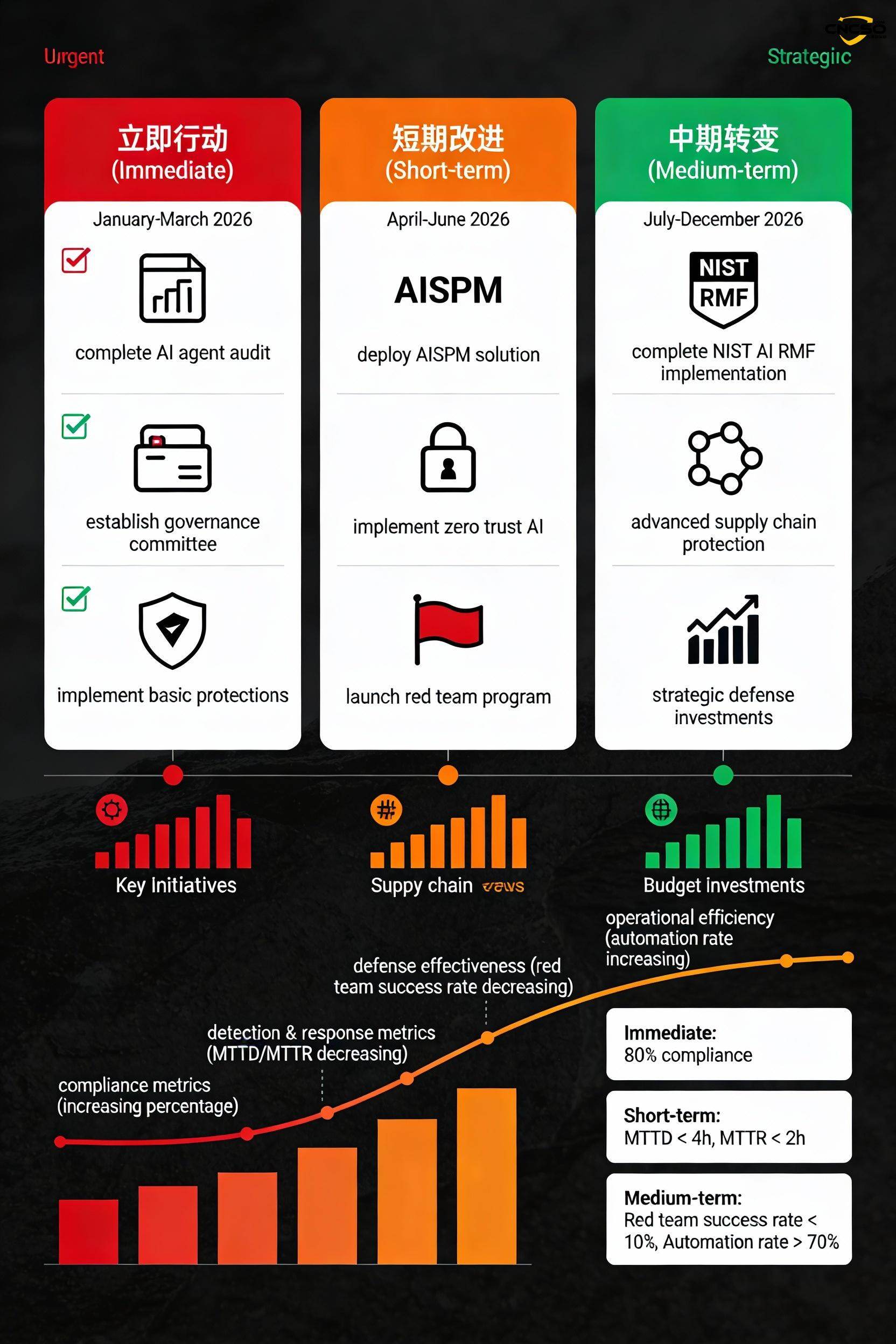

VII. 2026: Prioritäten für Maßnahmen

Sofortmaßnahmen

- Vollständige AI Agent Vollprüfung

- Einrichtung von funktionsübergreifenden Governance-Ausschüssen

- Implementierung einer grundlegenden Überwachung von Privilegien und Erkennung von Anomalien

Kurzfristige Verbesserungen

- Einsatz der AISPM-Lösung

- Implementierung einer Zero-Trust-KI-Architektur

- Einführung von vierteljährlichen Bewertungen durch das rote Team

Mittelfristige Transformation

- VollständigkeitNIST AI RMFrealisieren

- Erweiterte Sicherheit der Lieferkette

- Strategische Verteidigungsinvestitionen und Automatisierung

VIII. Mitte 2026 Fälligkeitsziel

| Norm | Ziele | Bedeutung |

|---|---|---|

| Vollständigkeit der Proxy-Liste | 100% | Einsatz ohne Unterlassung |

| Häufigkeit der Prüfungen der Behörde | monatlich | Rechtzeitige Erkennung von übermäßigen Privilegien |

| Mittlere Zeit bis zur Detektion (MTTD) | <30 Minuten | Schnelle Identifizierung von Bedrohungen |

| Mittlere Zeit bis zur Antwort (MTTR) | <1 Stunde | Reaktion der Maschine auf die Geschwindigkeit |

| Erfolgsquote des roten Teams | <10% | Wirksamkeit der Verteidigung |

| Ereignisse der Privilegienerweiterung | <1/Monat | Online-Kontrolle |

| Automatisierte Sanierungsrate | >80% | Verringerung der manuellen Eingriffe |

IX. schlussfolgerung

Zentrale Ansicht:

- Die Situation ist kritisch. - Die KI-Intelligenz ist eine neue Bedrohung durch Insider, da 4,8 Millionen fehlende Fähigkeiten zu einer übereilten Einführung führen

- Angriffe haben sich verselbständigt - Die Angriffe der Multi-Agenten-Gruppe 80-90% wurden autonom ausgeführt.

- Verteidigung muss innovativ sein - AISPM, Zero Trust AI, Autonome Verteidigung werden notwendig, wenn traditionelle Werkzeuge versagen

- Governance ist der Schlüssel - Der Erfolg wird davon abhängen, ob die Organisation über einen starken Governance-Rahmen verfügt

Der Weg nach vorn: Unternehmen sollten unverzüglich Audits von KI-Agenten einleiten, AISPM einsetzen undZero-Trust-Architekturdie automatische Reaktionsmöglichkeiten auf Vorfälle aufbauen. Diejenigen, die im Jahr 2026 erfolgreich investierenKI-SicherheitUnternehmen werden einen Wettbewerbsvorteil erlangen; diejenigen, die dies nicht tun, sind leichte Beute.

Das Zeitfenster hat sich dramatisch verkleinert, und es gibt keine Zeit zu verlieren.

Referenz:

Palo Alto Networks, "6 Prognosen für die KI-Wirtschaft: Die neuen Regeln der Cybersicherheit im Jahr 2026", Januar 2026

Palo Alto Networks, "NIST AI Risk Management Framework", https://www.paloaltonetworks.com/cyberpedia/nist-ai-risk- management-rahmenwerk

Moody's Corporation, "2026 Global Cyber Outlook - The Era of Machine Speed Warfare", Januar 2026

https://www.acem.sjtu.edu.cn/ueditor/jsp/upload/file/20250427/1745731689854071357.pdf

Cisco, "Redefining Zero Trust in the Age of AI Agents and Agentic Workflows", Juni 2025

https://www-file.huawei.com/admin/asset/v1/pro/view/6d6bd885f1f84435bf2c434312a1a44d.pdf

Nightfall AI Security 101, "Model Inversion: The Essential Guide", Dezember 2024

https://cloud.tencent.com/developer/article/2613155

Proofpoint, "Was ist ein Sofortige Injektion Definition, Beispiele", Oktober 2025

https://www.cicpa.org.cn/ztzl1/zgzckjs/zazhi2025/202505/P020250512576141996231.pdf

CrowdStrike, "Indirekte Prompt-Injection-Angriffe: Versteckte KI-Risiken", Dezember 2025

https://reader.hellobit.com.cn/article/page/1358.html

Legit Security, "AI Attack Surface Guide: How to Secure AI-Driven Systems", Januar 2026

https://www.uscsinstitute.org/cybersecurity-insights/blog/what-is-ai-agent-security-plan-2026-threats-and-strategies-explained

USCS Institute, "Was ist der AI Agent Security Plan 2026 - Bedrohungen und Strategien erklärt", Januar 2026

https://www.legitsecurity.com/aspm-knowledge-base/ai-attack-surface

Witness.ai, "AI Agent Security: Risks, Best Practices & Enterprise Protection", Oktober 2025

https://witness.ai/blog/ai-agent-security/

Originalartikel von Chief Security Officer, bei Vervielfältigung bitte angeben: https://www.cncso.com/de/ai-security-and-attack-surface-report-2026.html