Многие считают, что влияние ИИ на кибербезопасность проявляется в основном в виде "еще одного более умного инструмента". Но после прочтения этого сборника, посвященного кибербезопасности с использованием ИИ в Азиатско-Тихоокеанском регионе (АТР), напрашивается более искренний вывод:ИИ делает атаки быстрее, дешевле и реалистичнееЭто также привело к появлению новых "слабых слоев" в системной архитектуре предприятия - моделей, конвейеров данных, процессов обучения и развертывания.

Другими словами, вы используете ИИ для повышения эффективности, а злоумышленники - для повышения скорости.

Вот наиболее ценные сухие выводы из отчета, сжатые до версии, которую вы можете использовать непосредственно для вынесения суждений и управления.

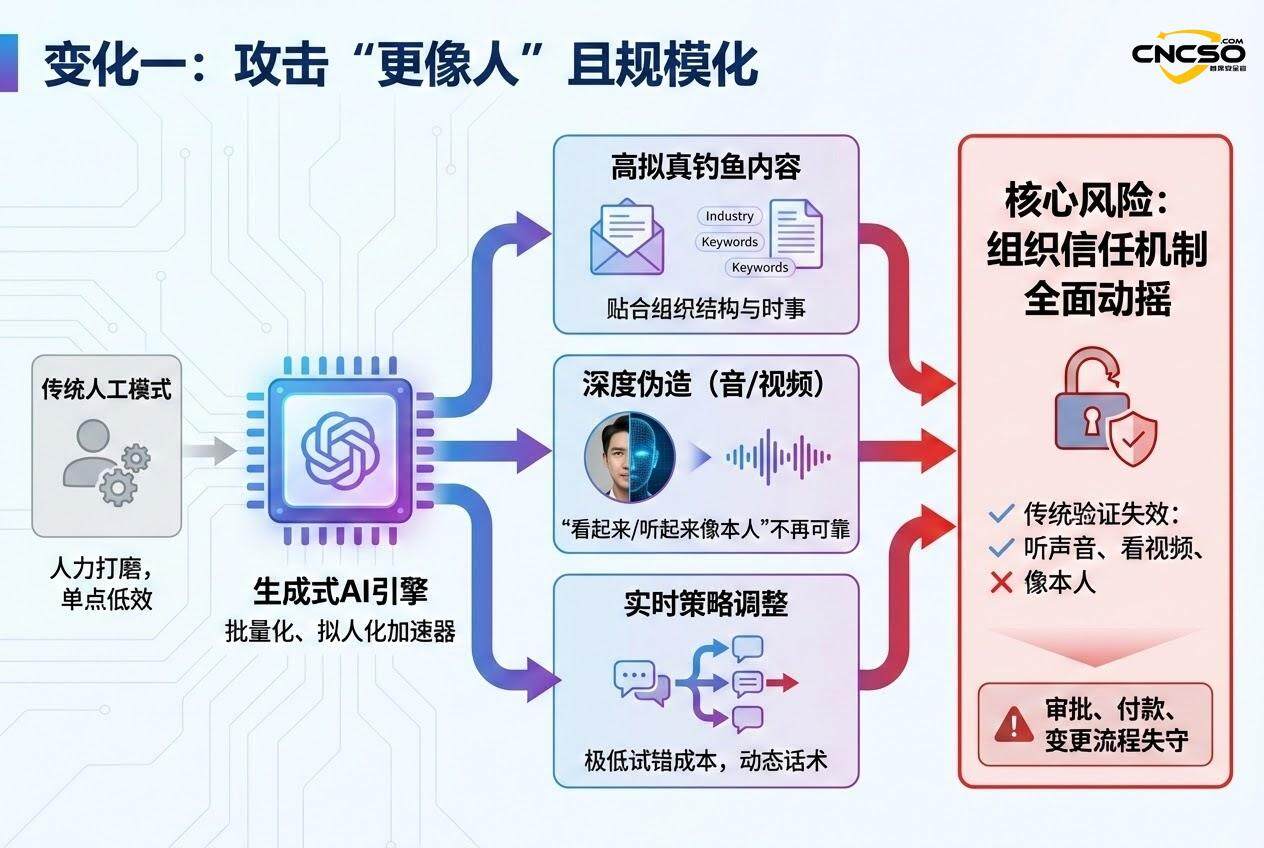

01 Изменение 1: Атаки стали "более человечными" и масштабными

В традиционную эпоху фишинговые письма, выдача себя за клиента и звонки социальным работникам отшлифовывались людьми. Теперь генеративный ИИ может "массово производить" эту информацию:

-

- Написание рыболовного контента, который больше похож на обычное общение, даже соответствует тону отрасли, организационной структуре и текущим событиям -

- Глубокая подделка (аудио/видео) избавляет от "похожести" в убедительных доказательствах -

- Вы также можете корректировать свои тактики и стратегии в режиме реального времени, с минимальными затратами на пробы и ошибки.

Это влечет за собой не какой-то отдельный риск, а изменения на организационном уровне:Механизм доверия пошатнулся.Многие процессы утверждения, оплаты и внесения изменений, которые раньше опирались на "прослушивание голосов", "просмотр видео" и "разговор на равных", становятся неадекватными. Многие процессы утверждения, оплаты и внесения изменений, которые раньше основывались на "прослушивании голосов", "просмотре видео" и "разговоре, как с другим человеком", больше не являются достаточными.

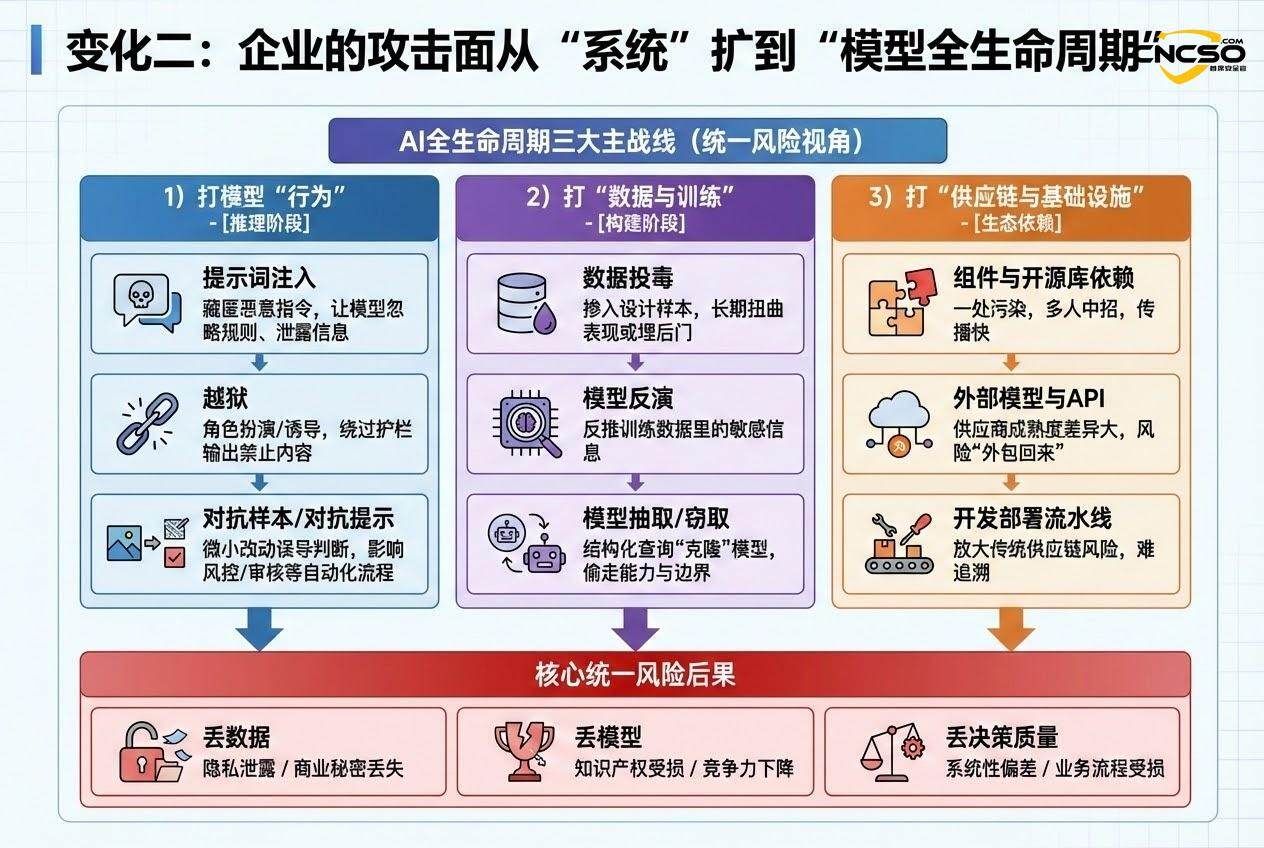

02 Изменение 2: Предприятия расширяют свою поверхность атаки с "систем" до "полного жизненного цикла модели".

В отчете кибератаки, связанные с ИИ, разделены на три широкие категории, и я предлагаю понимать их как три основных фронта.

1) Разыгрывание модели "поведения": введение подсказок, побег из тюрьмы, примеры противостояния

-

• Быстрое введение: Скрытие вредоносных инструкций в пользовательском вводе, документах, веб-страницах, данных, чтобы модель "игнорировала правила", раскрывала информацию или делала то, что не должна. -

• Джейлбрейк: Обойдите ограждения с помощью ролевых игр, многоступенчатой индукции и т. д. и заставьте модель выдать то, что должно быть запрещено. -

• Образцы противостояния/ Советы по противостояниюВносите небольшие, но намеренные изменения в исходные данные, которые позволяют моделям ошибаться и влияют на автоматизированные процессы (например, контроль рисков, борьба с мошенничеством, проверка содержимого).

Это может звучать как "мумбо-джамбо" из области технологий, но на самом деле все очень просто:Одно предложение, один документ, одна ссылка на внешний контентЭто может вывести модель из строя, что, в свою очередь, повлияет на последующий процесс.

2) Борьба с "данными и обучением": отравление данных, инверсия моделей, кража моделей

-

• Отравление данных: Смешивание "вроде бы нормальных, но сконструированных" образцов с обучающими/настраивающими данными, искажение производительности модели с течением времени и даже установка бэкдоров. -

• Инверсия модели: Инвертируйте конфиденциальную информацию в обучающих данных, постоянно запрашивая выходные данные. -

• Извлечение/кража моделей: "Клонируйте" модель с помощью множества структурированных запросов, чтобы украсть возможности и границы.

Основные риски очевидны:

Можно потерять и данные (конфиденциальность/торговая тайна), и модели (интеллектуальная собственность/конкурентоспособность), и качество решений (систематическая предвзятость).

3) Борьба с "цепочкой поставок и инфраструктурой": компоненты, внешние модели, конвейеры разработки и развертывания

Системы искусственного интеллекта часто сильно зависят от внешних экосистем: библиотек с открытым исходным кодом, предварительно обученных моделей, сторонних API, облачной инфраструктуры, инструментов автоматического развертывания. В отчете подчеркивается, что это может усилить традиционные риски цепочки поставок - какОдин заражен, многие могут пострадатьИх трудно отследить, и они быстро распространяются.

Более реалистичная точка зрения такова: зрелость провайдеров сильно варьируется. Некоторые из них хорошо управляются, а другие только начинают свою деятельность. Предприятия, которые обращают внимание только на функциональность, а не на управление, могут легко "отдать" риск на аутсорсинг.

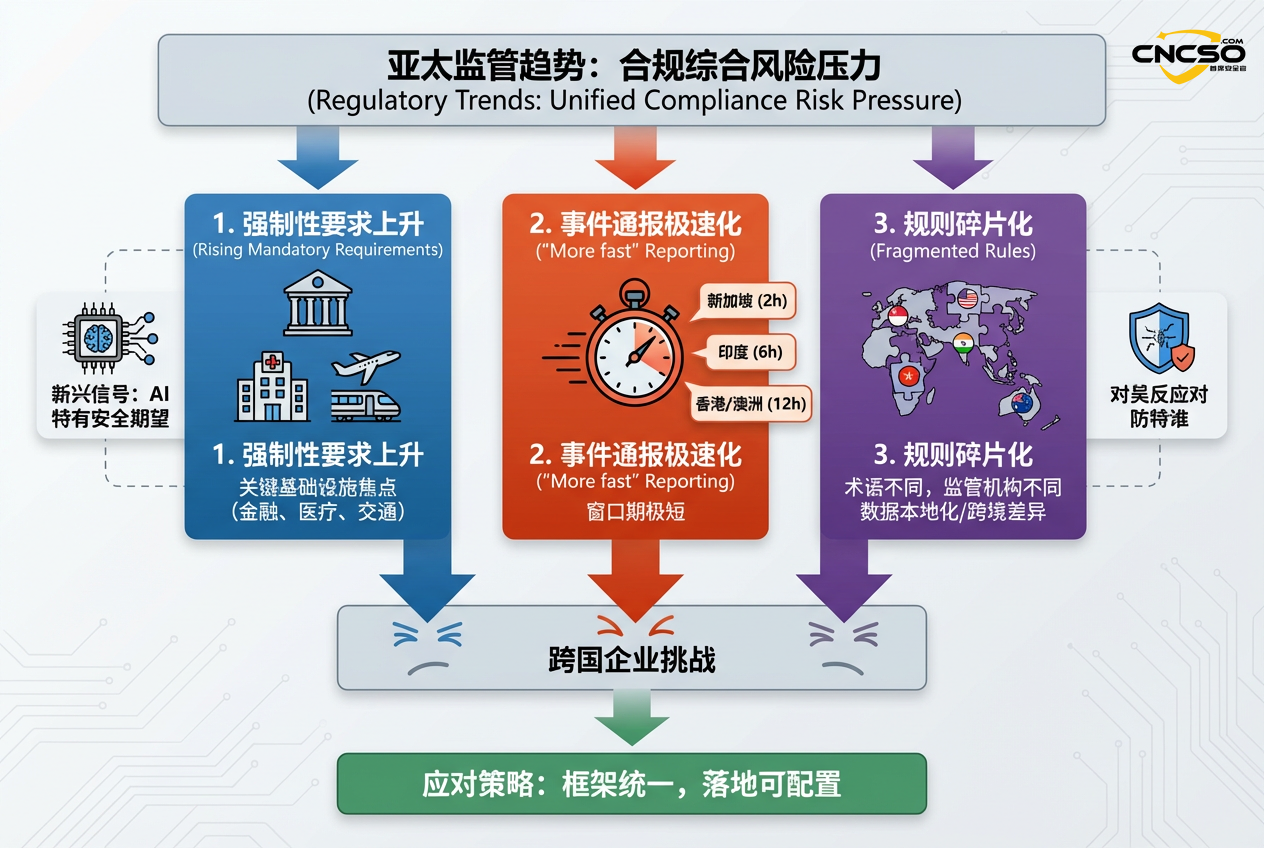

03 Нормативные тенденции: более обязательные, более фрагментированные, больше внимания уделяется быстрому уведомлению

Регуляторная среда в Азиатско-Тихоокеанском регионе оказывает давление на бизнес по двум основным направлениям:

-

1. Обязательные требования к безопасности растутОсобенно ярко выражены критическая инфраструктура, финансы, здравоохранение, транспорт и т.д. -

2. Уведомление о происшествиях становится все более "срочным": В некоторых юрисдикциях существуют очень короткие окна для сообщения о критических инцидентах (в Сингапуре, по некоторым данным, они составляют всего 2 часа; в Австралии - 12 часов в некоторых случаях; Индия требует 6 часов для сообщения в CERT-In; а Гонконг - 12 часов для серьезных инцидентов после вступления в силу законопроекта о критической инфраструктуре).

В то же время правилафрагментацияТерминология разная, применимые объекты разные, регулирующие органы разные, локализация данных и трансграничные требования разные. Транснациональным предприятиям сложно использовать набор шаблонов, а лишь создать "единую основу, на которой можно настраивать".

Еще один примечательный сигнал: хотя в большинстве регионов по-прежнему преобладают традиционные системы кибербезопасности, вТребования к безопасности с учетом особенностей ИИПоявляются такие вопросы, как устойчивость моделей, тестирование на состязательность, безопасная обработка данных, генерирование идентификаторов контента (с помощью глубокого синтеза) и т.д.

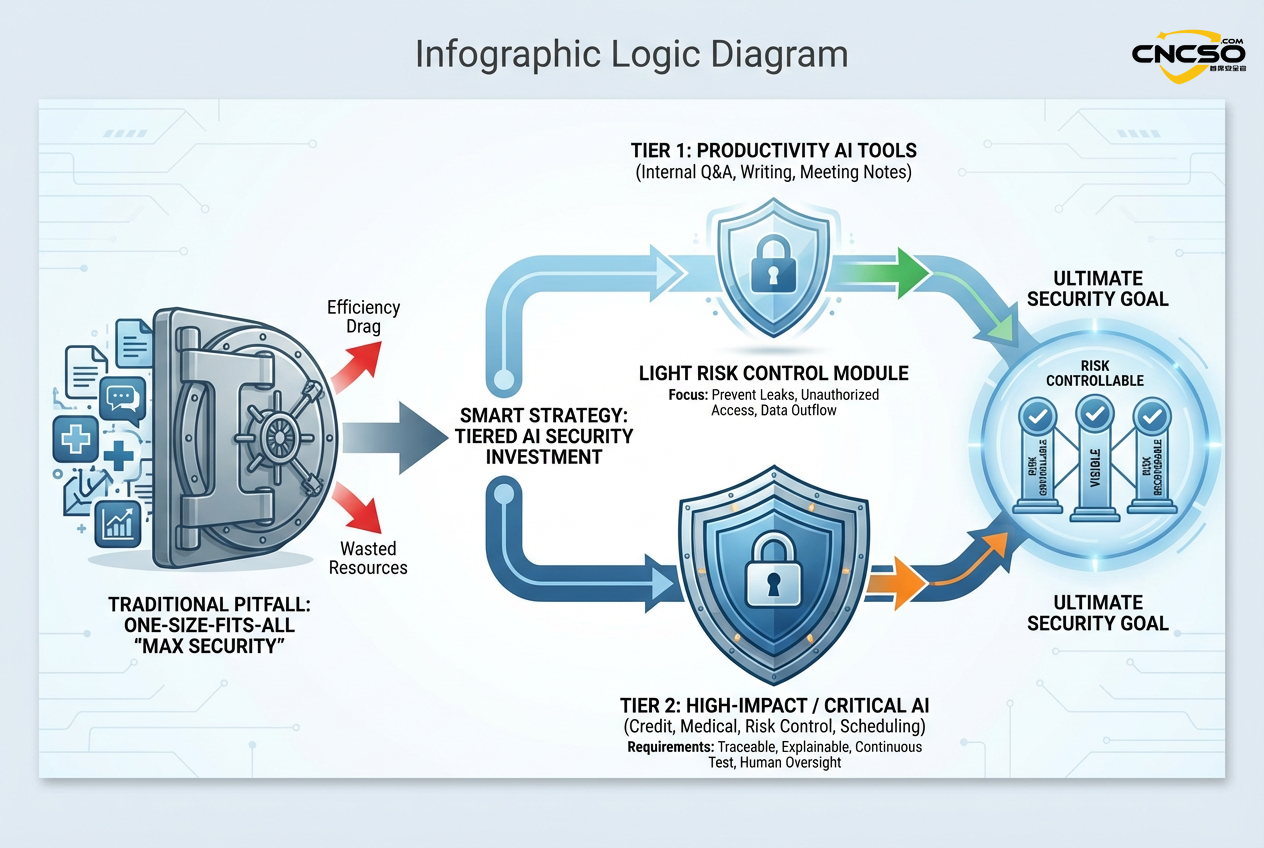

04 Где все может пойти не так: если подвергнуть весь ИИ "максимальной безопасности".

В отчете есть очень полезное напоминание:Безопасность ИИИсходные данные должны быть "оценены", иначе они будут либо пустой тратой ресурсов, либо снижением эффективности бизнеса.

Простой, но работающий способ разделения:

-

• Инструменты искусственного интеллекта для повышения производительности(внутренние вопросы и ответы, поиск информации, письменные принадлежности, протоколы): обычно можно применять более мягкие меры контроля, но утечка информации, превышение полномочий и утечка данных строго исключены. -

• ИИ, ориентированный на принятие важных решений/клиентов и оказывающий большое влияние на ситуацию(Кредитование, рекламации, контроль рисков, медицинская помощь, критическая диспетчерская служба): необходимы более строгие требования к безопасности и аудиту с акцентом на прослеживаемость, интерпретируемость, непрерывное тестирование и человеческий надзор.

Цель безопасности заключается не в том, чтобы ИИ "никогда не пошел не так", а в том, чтобы минимизировать риски и последствия.Контролируемый, видимый и восстанавливаемый.

05 "Список 7 посадочных полос", с которых предприятия могут копировать информацию.

Если вам нужна версия, которую можно вынести на обсуждение в компании и ввести в систему, то эти 7 наиболее критичны:

-

1. Обеспечение кибербезопасности с помощью искусственного интеллекта на уровне совета директоров

Сделайте это постоянным вопросом: компромиссы между рисками, ресурсы, допуски, ответственные лица, не ограничивайтесь еженедельным техническим отчетом. -

2. Составьте "Инвентаризацию активов ИИ".

Составьте четкие списки: какие модели используются, откуда берутся данные, какие внешние API подключены, кто несет ответственность, уровни риска, журналы изменений. Нельзя говорить об управлении без инвентаризации. -

3. Сценарии высокого риска должны быть "безопасными".

Проведите тестирование на состязательность и учения "красной команды" перед запуском; осуществляйте постоянный мониторинг и периодическое повторное тестирование после запуска. -

4. Учет специфических для ИИ событий при планировании действий в чрезвычайных ситуациях

Уточнить, как действовать в таких случаях, как отравление данных, кража моделей, подделка моделей и введение слов реплики, приводящее к превышению допустимого уровня; а также согласовать сроки и уровень уведомления в разных регионах. -

5. Цепочка поставок должна быть "понятной с точки зрения контракта и управляемой с операционной точки зрения".

Контракты должны охватывать: порядок использования данных, обновления моделей, уведомления об изменениях, сообщения об инцидентах, гарантии непрерывности обслуживания; ключевые поставщики должны находиться в постоянном взаимодействии, а не просто подписать контракт и на этом закончить. -

6. Системы идентификации и полномочий должны быть более жесткими

Многофакторная аутентификация, наименьшие привилегии и разделение конфиденциальных данных могут значительно сократить возможности для социальных работников и глубокого подлога. -

7. Пересмотр ключевых процессов, которые "опираются на вербальное доверие".

Например, передача данных с высоким риском, изменение конфигурации, экспорт конфиденциальных данных: введите двухканальную проверку (одобрение системы + обратная проверка/вторичная проверка) и не принимайте "похоже" за доказательство.

Что нам действительно нужно обновить, так это "доверительный подход".

Проблема с ИИ не в том, что он "умнее", а в том, что он делает подделку более реальной, атаки более дешевыми, а ошибки легче усилить автоматизацией.

Глубокая подделка - это, конечно, страшно, но еще страшнее то, что...Мы все еще используем процессы и интуицию старого времени, чтобы проверить истину нового времени..

классификатор для объектов с ручкойБезопасность ИИВ конечном счете, правильное решение - это не конкретный инструмент или конкретное правило, а более сложная организационная способность:

Можно проверить важнейшие связи, проследить за принятием важных решений и устранить проблемы.

В следующий раз, когда вы получите срочное сообщение от своего "лидера" или ваша система внезапно выдаст партию результатов моделирования, которые "неправильные, но просто неправильные", надейтесь, что вашей команде не нужно играть на удачу и у нее есть механизм, чтобы убедиться, что вы все сделали правильно.

Ссылаться на:

Обеспечение кибербезопасности в искусственном интеллекте: создание устойчивости в условиях нового ландшафта рисков (декабрь 2025 г.).

Оригинальная статья написана Chief Security Officer, при воспроизведении просьба указывать: https://www.cncso.com/ru/artificial-intelligence-entity-ai-attack-surface-and-risk.html.