I. Предисловие

2025.ИИ(ИИ) перешел от лабораторных исследований к крупномасштабному применению, а также кардинально изменил наступательный и оборонительный ландшафт кибербезопасности. По данным таких авторитетных организаций, как Verizon Data Breach Investigations Report (DBIR), IBM's annual Cost of a Data Breach Report, CrowdStrike Ransomware Investigation и Microsoft Digital Defence Report, в текущем году произошел взрыв кибератак, управляемых ИИ. Рост числа кибератак с использованием искусственного интеллекта в мире на 47% сопровождался стремительным развитием технологий защиты: организации, использующие средства защиты с использованием искусственного интеллекта, сэкономили в среднем 1,9 миллиона долларов на взломах по сравнению с теми, кто не применяет эти технологии.

В этом отчете представлен всесторонний анализ глобального и гонконгского ландшафта киберугроз в 2025 году, а также информация о том, как ИИ меняет анализ затрат атакующих и защитников, наиболее пострадавшие отрасли и регионы, реальные примеры, экономические последствия нарушений безопасности и основные защитные действия, которые следует предпринять организациям. Отчет призван предоставить лицам, принимающим решения, данные, которые помогут организациям принимать обоснованные решения об инвестициях в безопасность в условиях все более сложного ландшафта угроз.

II. Угрозы в 2025 году

2.1 Обзор глобальных киберугроз

В 2025 году ландшафт киберугроз будет характеризоваться значительным ускорением и эскалацией. Согласно данным, среднее количество кибератак, которым подвергаются организации в неделю, удвоилось за последние четыре года: с 818 во втором квартале 2021 года до 1 984 за тот же период 2025 года, то есть на 58% за два года. Эта тенденция ускорения является прямым отражением широкого использования технологий искусственного интеллекта в цепочке атак.

Ключевая статистика:

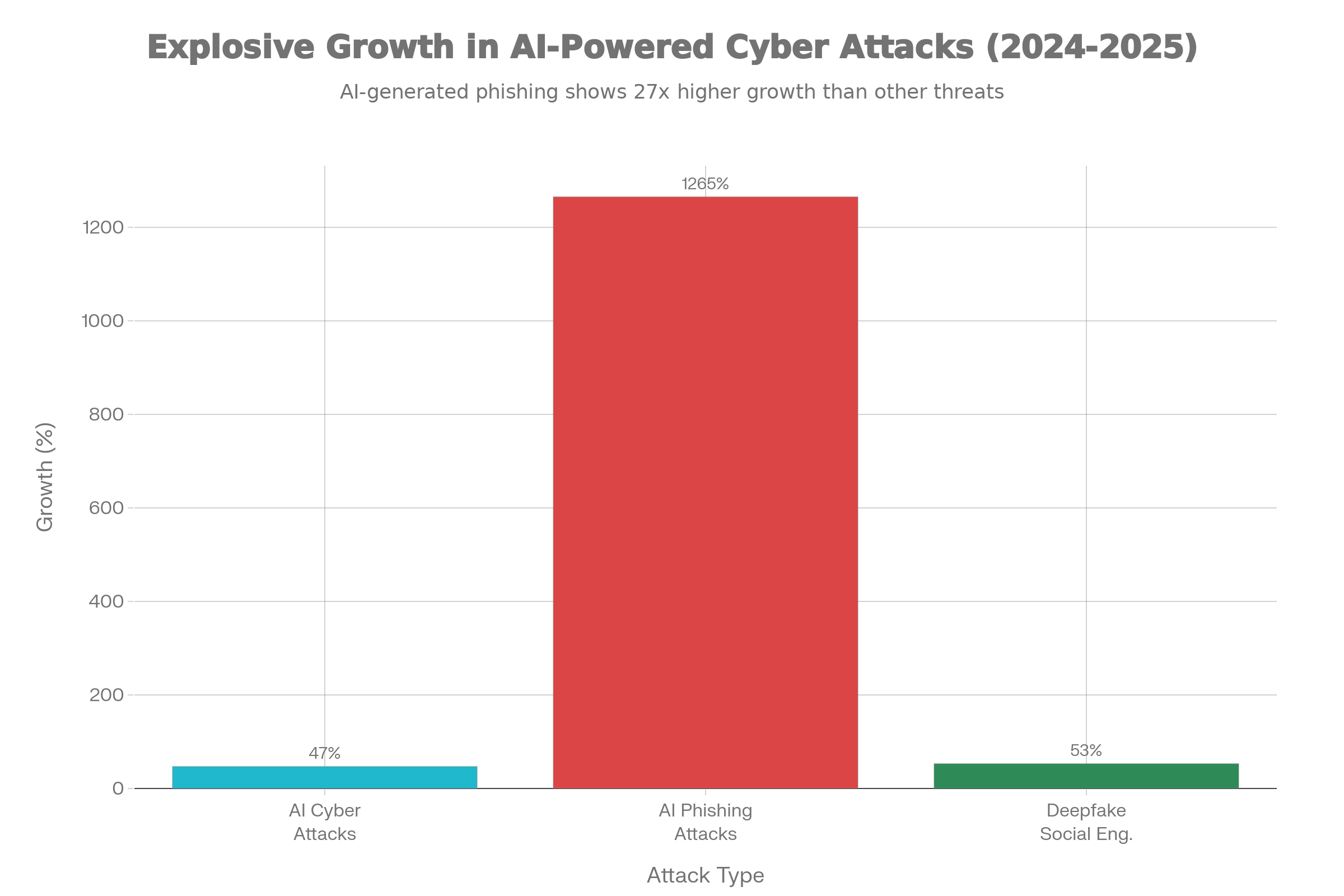

| норма | 2024 | 2025 | темпы роста |

|---|---|---|---|

| Кибератаки, управляемые искусственным интеллектом | кардинальное число | Добавить 47% | 47% |

| Фишинговые атаки, генерируемые искусственным интеллектом | кардинальное число | Увеличение на 1,265% | 1,265% |

| Глубокая подделка социальной инженерии | кардинальное число | Добавить 53% | 53% |

| Среднее количество атак в неделю | 1,260 | 1,984 | 58% |

| Лидеры в области безопасности ожидают ежедневных атак с использованием искусственного интеллекта | кардинальное число | Отчет 93% | - |

Кибератаки, управляемые искусственным интеллектом, стали глобальной угрозой. Глобальный ущерб оценивается в 30 миллиардов долларов. В этих атаках ИИ используется для повышения достоверности фишинговых писем, создания глубоких подделок для подделки личности, автоматизации шагов вторжения и обнаружения незащищенной инфраструктуры ИИ.

2.2 Специфические атаки с использованием ИИ

Промышленная разработка искусственного интеллекта для фишинговых писем

В 2025 году в 82,61 TP3T фишинговых писем будут использоваться технологии искусственного интеллекта. Эти письма больше не являются простым спамом, а представляют собой высоко персонализированные атаки социальной инженерии. Согласно полученным данным, фишинговые письма с использованием технологий искусственного интеллекта пишутся на 401 TP3T быстрее и способны на:

-

Соответствие фирменного и личного тона голоса

-

Интеграция подлинных данных из LinkedIn, исторических электронных писем и публичных записей

-

Создавайте полностью грамматические сообщения без традиционных орфографических ошибок

-

Укажите проект и номер счета, в котором жертва была фактически задействована

В результате частота открытия писем достигает 781 TP3T, а количество переходов по вредоносным ссылкам - 211 TP3T. Особо следует отметить увеличение доли фишинговых писем, сгенерированных искусственным интеллектом, с примерно 401 TP3T до 831 TP3T по сравнению с 2024 годом.

Глубокая подделка и клонирование звука

Число мошеннических атак, вызванных глубокой подделкой, выросло на 21371 тп3т и теперь составляет 6,51 тп3т от всех мошеннических атак. в 2025 году глубокая подделка, вызванная ИИ, привела к увеличению числа инцидентов, связанных с социальной инженерией, на 531 тп3т, а число случаев социальной инженерии и мошеннических заявлений - на 2331 тп3т. был использован генеративный ИИ:

-

Создавайте реалистичные видео- и аудиоматериалы, чтобы выдать себя за руководителей

-

Идентификация личности с помощью методов синтеза текста

-

Многоканальное мошенничество, объединяющее несколько видов СМИ

Ускорение ИИ для борьбы с вымогательством

Исследование CrowdStrike 2025 Ransomware Survey показало, что 76% глобальных организаций не в состоянии противостоять скорости и изощренности атак, управляемых искусственным интеллектом.48% организаций считают цепочки атак, управляемые искусственным интеллектом, самой большой угрозой.85% сообщают, что традиционные методы обнаружения становятся неактуальными для атак с использованием искусственного интеллекта.ИИ используется:

-

Автоматизация действий при вторжении для ускорения времени от первого доступа до шифрования

-

Оптимизация полезной нагрузки вымогательских программ для уклонения от обнаружения

-

Автоматизируйте извлечение данных и процессы продаж

-

Персональные требования шантажа и тактика ведения переговоров

2.3 Массовое использование инфраструктуры искусственного интеллекта

Исследование Trend Micro, проведенное в середине 2025 года, показало, что серьезные ошибки в конфигурации приложений искусственного интеллекта создают прямые пути для атак. Речь идет не об уязвимостях "нулевого дня", а об основополагающих недостатках гигиены безопасности:

-

Более 200 полностью незащищенных серверов Chroma(Векторная база данных) Данные могут быть прочитаны, записаны или удалены любым человеком, имеющим доступ к сети.

-

Более 10 000 серверов OllamaВоздействие Интернета (увеличилось с 3 000 в ноябре 2024 года)

-

2 000 серверов Redisнет аутентификации

-

Сервер MCP (Model Context Protocol) для 72%Подверженность, по крайней мере, одной чувствительной возможности

-

50% прокси-соединение с 3 или более серверами MCPСтатус "Высокий риск"

Эти уязвимости позволяют злоумышленникам:

-

Кража встроенных и конфиденциальных документов

-

Компрометация моделей искусственного интеллекта с помощью отравления данных

-

Выполните атаки на дрейф вектора и внедрение подсказок

-

Передвижение в боковом направлении в окружающей среде

iii. анализ затрат и выгод, связанных с тем, как искусственный интеллект может перестроить работу злоумышленников

3.1 Механизмы, с помощью которых ИИ снижает стоимость и увеличивает масштаб атак

Если анализировать ситуацию с экономической точки зрения, то ИИ кардинально меняет бизнес-модель киберпреступности. В то время как традиционная киберпреступность требует большого количества ручных операций, технология ИИ позволяет злоумышленникам автоматизировать ее в больших масштабах при очень низких предельных затратах.

Изменения в структуре затрат:

| фаза атаки | Стоимость традиционных методов | Расходы, связанные с искусственным интеллектом | Повышение эффективности |

|---|---|---|---|

| Написание фишинговых писем | Высокий (необходимо исследование) | Низкий (автоматизированный) | 40% Ускорение |

| идентификация цели | умеренный | Низкий (агрегация данных) | значительно упростить |

| социальная инженерия | умеренный | Низкий (глубинная фальсификация) | Надежность +53% |

| Настройка полезной нагрузки | ваш (почетный) | опускать (голову) | автоматическая генерация |

| Обнаружение и обход | ваш (почетный) | опускать (голову) | Полиморфное вредоносное ПО +76% |

Конкретные экономические показатели:

То, что заняло бы у злоумышленника несколько часов на поиск и составление персонализированного фишингового письма, теперь можно сделать за считанные минуты с помощью генеративного ИИ, что означает снижение первоначальной стоимости атаки более чем на 801 TP3T. В то же время коэффициент успешности сгенерированных ИИ писем увеличился с 5-101 TP3T до 15-201 TP3T при использовании традиционных методов, что означает значительное увеличение рентабельности инвестиций злоумышленника.

3.2 Экономические издержки нападения на шкалу

Важнейшим экономическим преимуществом ИИ является масштаб. Если традиционные целевые атаки могут быть направлены на конкретные организации, то атаки, генерируемые ИИ, могут быть направлены на миллионы целей одновременно. На основе данных инструменты генеративного ИИ и автоматизация позволяют злоумышленникам создавать фишинговые письма на 40% быстрее, чем ручные методы.

Раньше злоумышленникам приходилось неделями проводить разведку, чтобы определить подходящие цели и процессы оплаты. Теперь, когда искусственный интеллект анализирует LinkedIn, публичные финансовые отчеты и объявления о приобретениях, такой анализ можно провести за считанные дни. Это позволяет команде злоумышленников проводить кампании против сотен организаций одновременно.

3.3 Защита от окупаемости инвестиций и разницы в затратах

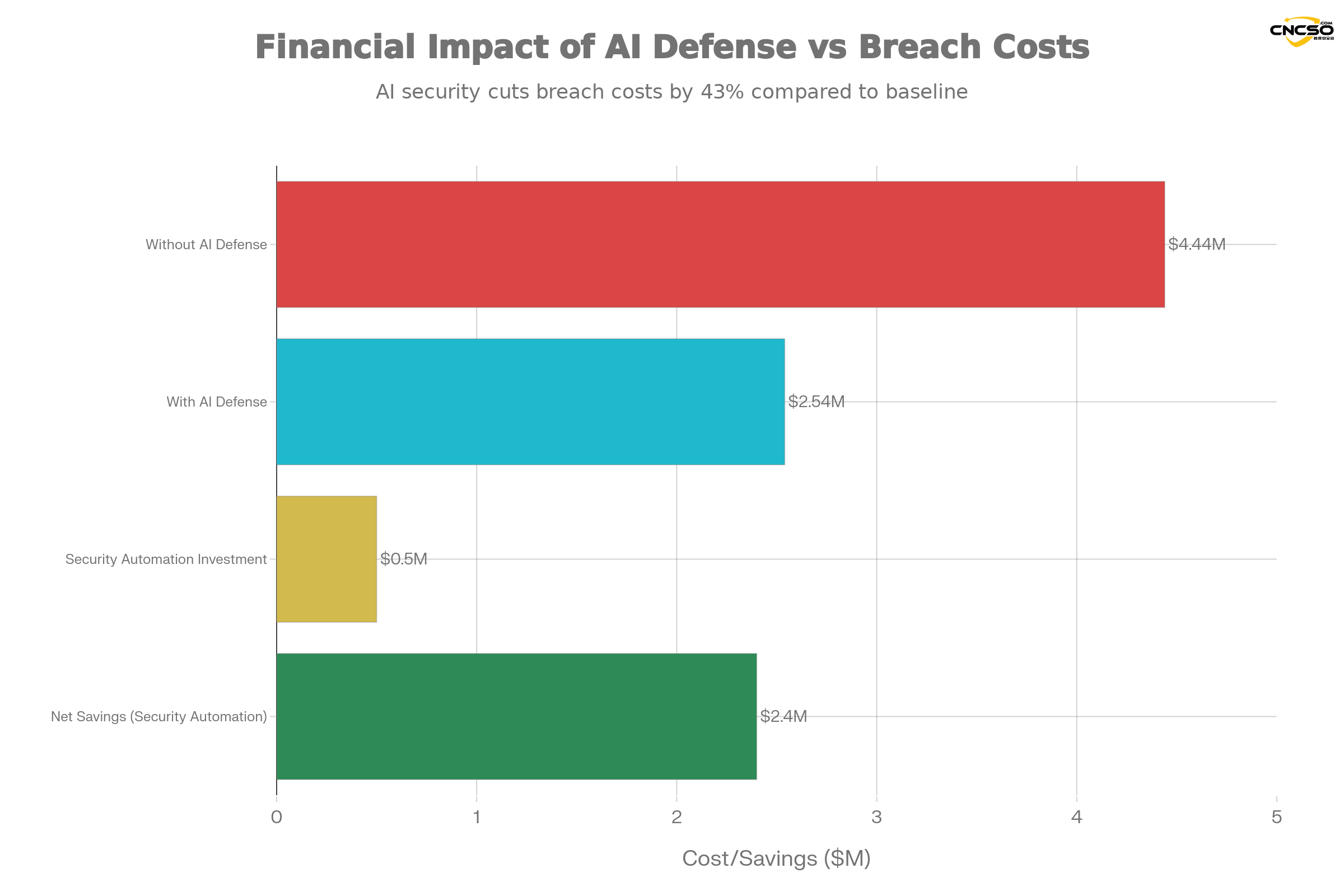

Напротив, защитники выигрывают в стоимости. Организации, использующие ИИ-защиту, в среднем экономят.

-

Экономия 1,9 миллиона долларов за одну утечку(в отличие от организаций, не использующих средства защиты от ИИ)

-

Сокращение времени тестирования в среднем на 80 дней

-

Жизненный цикл утечки сократился до 241 дня(Самый короткий за последние 9 лет)

-

Стоимость одной записи снизилась с $234 до $128(Автоматическое обнаружение ИИ)

Это создает парадокс: ИИ значительно снижает стоимость атаки, но при этом гораздо быстрее снижает стоимость эффективной обороны. Ключевое различие заключается в том, что защитник может инвестировать средства один раз, против всех атак, в то время как атакующий должен подстраиваться под каждую цель.

IV. Наиболее пострадавшие отрасли и регионы

4.1 Оценка риска по отраслям

Финансовые услуги (самый высокий риск)

Сфера финансовых услуг подвергается наибольшему количеству кибератак с использованием ИИ. Исследование Deep Example показывает:

-

Финансовая организация 45%Кибератаки с использованием искусственного интеллекта за последние 12 месяцев

-

12,81 TP3T для финансовых компаний B2BВстреча с вымогательским ПО

-

1 338 357 банковских троянских атакобнаружено

-

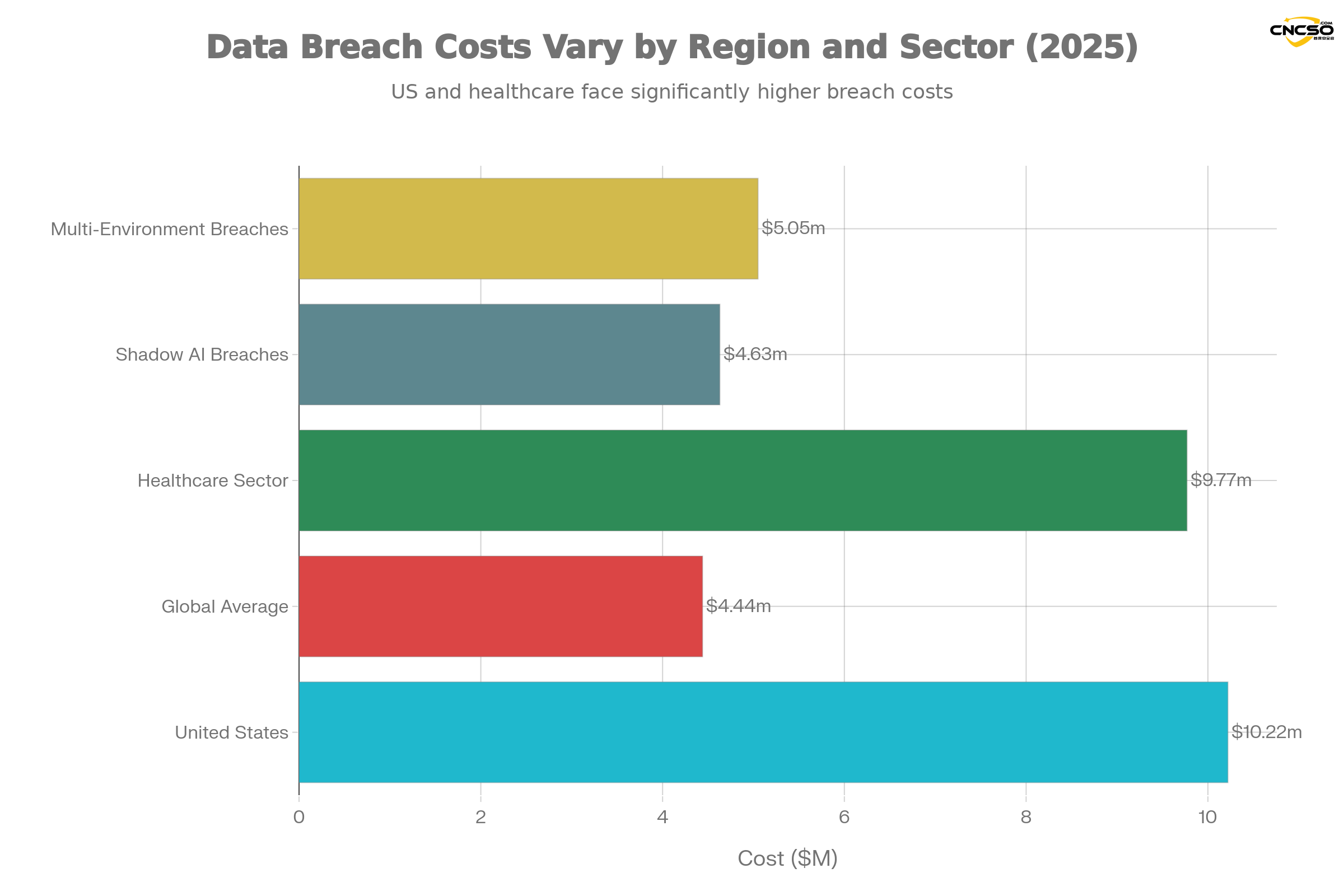

Средняя стоимость утечки в финансовом секторе по-прежнему находится в диапазоне $4.8-$5.0M

Финансовые учреждения особенно уязвимы для BEC-атак с использованием искусственного интеллекта, поскольку:

-

Процессы авторизации транзакций часто проходят в условиях дефицита времени

-

Крупные переводы - обычная деловая практика

-

Злоумышленники могут получить огромное прямое финансовое вознаграждение

Здравоохранение (высокий уровень смертности)

Здравоохранение сталкивается с многочисленными угрозами:

-

1 710 инцидентов, связанных с безопасностью(Verizon DBIR 2025)

-

1 542 подтвержденных случая утечки данных

-

Средняя стоимость утечки $9.77M(самый высокий показатель в отрасли)

-

Рост числа фишинговых атак на 442%(вторая половина 2024 года)

-

Основные угрозы исходят от программ-вымогателей, атак на идентификационные данные и глубоких подделок, управляемых искусственным интеллектом.

Сектор здравоохранения - это очень ценная цель, потому что:

-

Данные о пациентах имеют долгосрочную стоимость на черном рынке ($150-$300 за медицинскую карту)

-

Перебои в работе приводят к риску для безопасности жизни, что побуждает к быстрой выплате выкупов

-

Строгие требования к соблюдению HIPAA увеличивают затраты на устранение утечек

-

Банды, распространяющие вымогательское ПО, знают, что медицинские организации имеют сильные стимулы для оплаты.

Образовательные учреждения (угроза высокого роста)

Образовательный сектор становится новым рубежом для программ-вымогателей:

-

217 атак вымогателей(апрель 2023 - апрель 2024)

-

Годовой рост на 35% или более

-

На Соединенные Штаты приходится 561 TP3T известных атак по всему миру.

-

Образование - четвертый по степени воздействия сектор в мире после обрабатывающей промышленности.

Образовательные учреждения особенно уязвимы, потому что:

-

Ограниченные ИТ-ресурсы и бюджет

-

Высокая ценность данных о студентах

-

Перебои в работе серьезно влияют на учебный год

-

Открытая сетевая среда для первоначального доступа

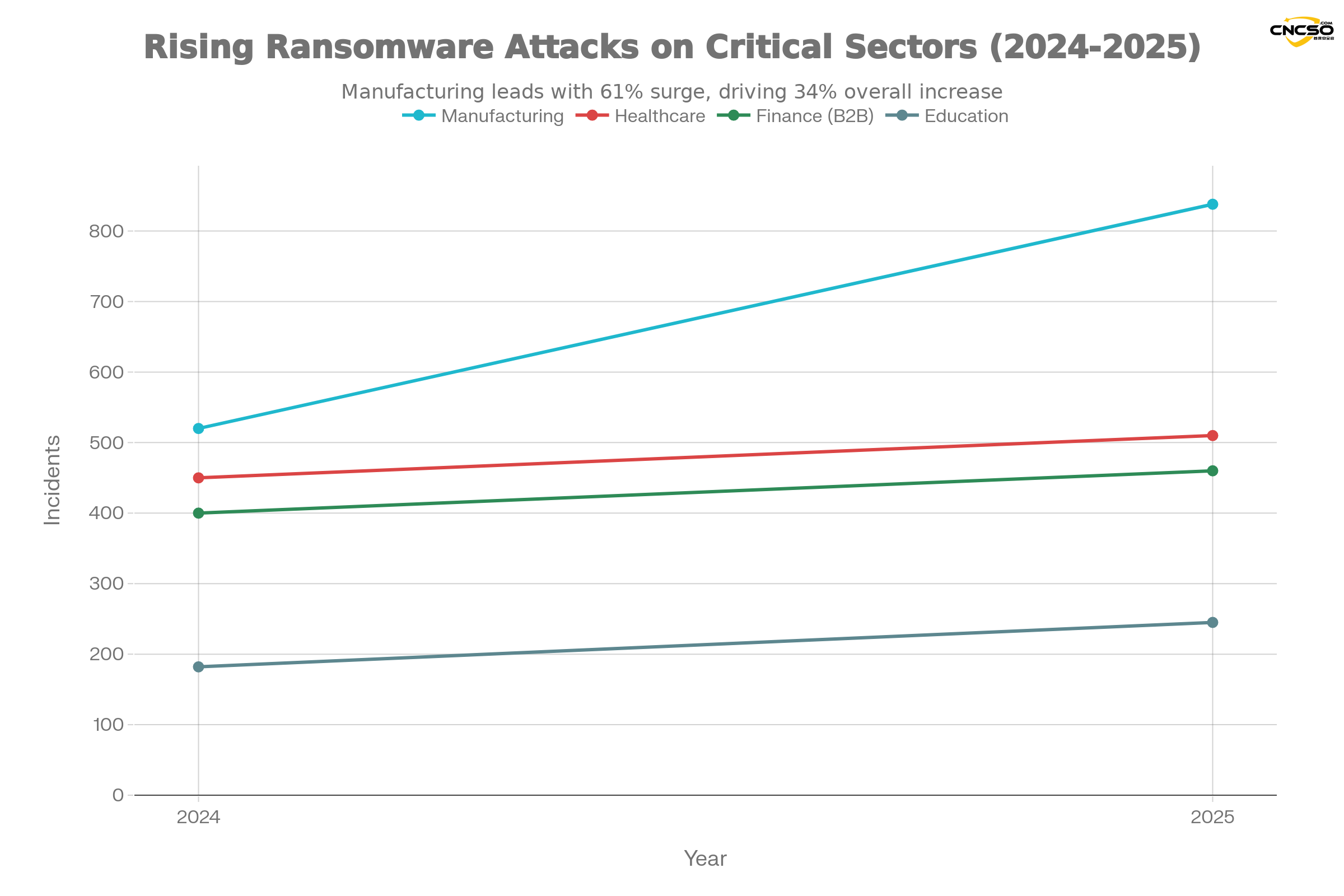

Обрабатывающая промышленность (самый быстрый рост)

Производство - самая быстрорастущая цель для ransomware в 2025 году:

-

838 атак вымогателей(61% по сравнению с 520)

-

34% рост числа инцидентов с вымогательством в миреОриентация на ключевые сектора

-

Сильно оцифрованные и взаимосвязанные системы делают их уязвимыми для атак

-

Конвергенция операционных технологий (ОТ) и ИТ-систем увеличивает риск

4.2 Анализ рисков в зоне

Специальный административный район Гонконг

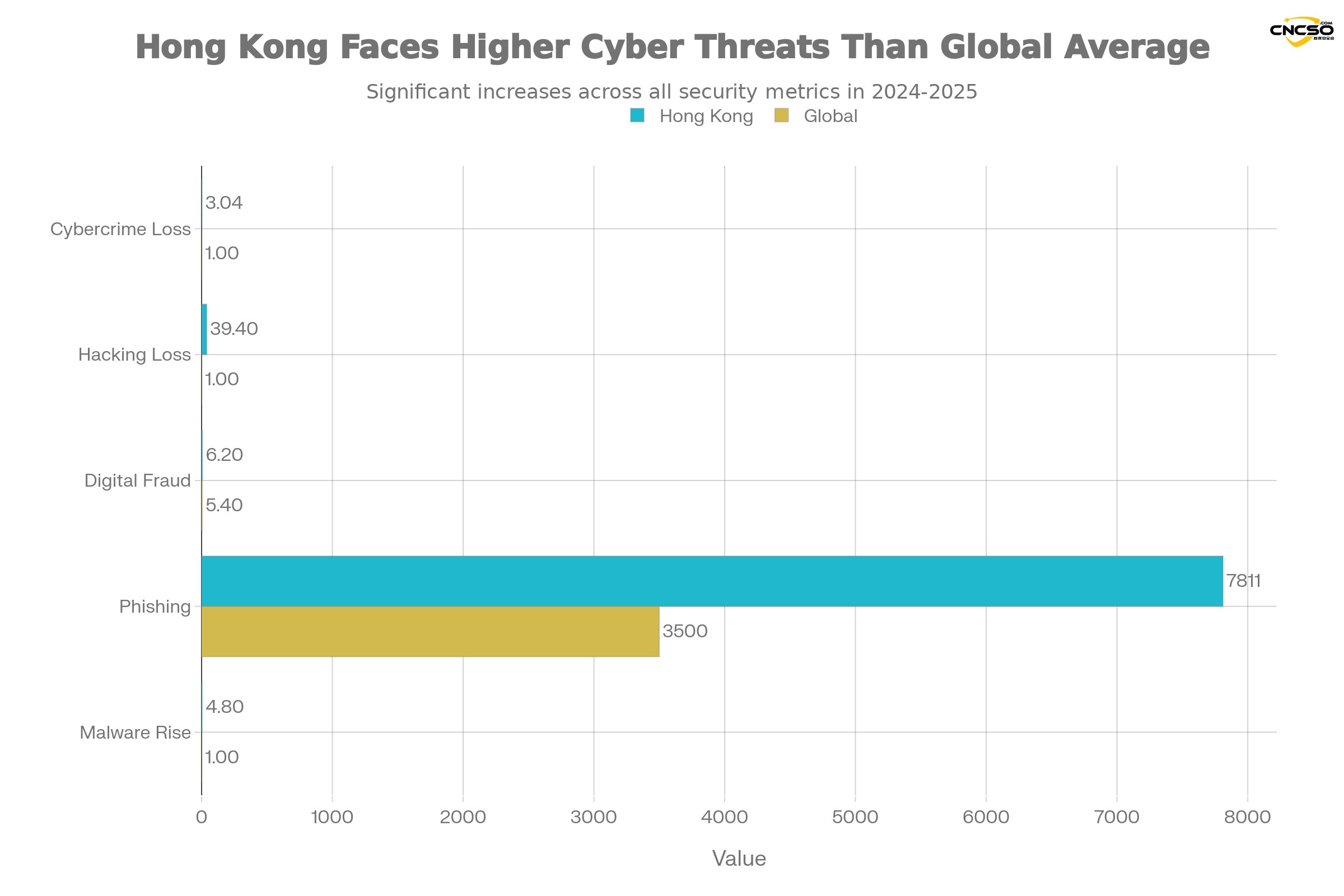

Уровень киберугроз в Гонконге значительно выше, чем в среднем по миру:

| норма | Данные за 2024-2025 гг. | глобальное сравнение |

|---|---|---|

| Убытки от киберпреступлений (H1 2025) | HK$3.04B (+15% г/г) | +15% Рост |

| Потери от взлома (H1 2025) | HK$39.4M (+10x) | 10-кратный рост |

| Уровень цифрового мошенничества | 6.2% | Среднее значение по миру 5,41 TP3T, высокое 151 TP3T |

| Мошенничество в секторе розничной торговли | 17.8% | Годовой рост 113% |

| Количество инцидентов, связанных с фишингом | 7,811 (+108%) | Худшее за последние 5 лет |

| инцидент с вредоносным ПО | Увеличение в 4,8 раза | значительно увеличиваться |

| фишинговая ссылка | 48,000+ (+150%) | шип |

Отдел кибербезопасности и технологических преступлений полиции Гонконга заявил, что, хотя количество хакерских атак несколько снизилось, огромный рост финансовых потерь свидетельствует о нарастании угрозы. В 2024 году HKCERT обработал 12 536 инцидентов безопасности.

Остальная часть Азиатско-Тихоокеанского региона

Согласно отчету Thales Data Threat Report за 2025 год, Азиатско-Тихоокеанский регион (включая Австралию, Индию, Японию, Новую Зеландию, Сингапур, Южную Корею и Гонконг) сталкивается с угрозами:

-

Организации выше 65%Стремительное развитие искусственного интеллекта считается одной из главных проблем безопасности

-

63% Озабочен отсутствием целостности ИИ

-

55% Беспокоит отсутствие доверия к искусственному интеллекту

-

47%'s Asia Pacific EnterprisesОпыт утечки данных

Соединенные Штаты (самая высокая стоимость)

США понесли наибольшие затраты на устранение нарушений:

-

Средняя стоимость утечки в США: $10.22M(Рекордный максимум, +9%)

-

Это более чем на 1 30% выше среднемирового показателя в $4,44M.

-

Штрафы, налагаемые регулирующими органами, и замедление сроков тестирования приводят к увеличению расходов

-

Несколько крупных утечек, затрагивающих миллионы записей, в 2025 году

V. Типичные случаи и выводы

5.1 Дело о мошенничестве с глубокой подделкой в Гонконге

Обзор дел

В 2025 году финансовая компания из Гонконга потеряла 25 миллионов долларов в результате мошенничества с глубокой подделкой данных с помощью искусственного интеллекта. Злоумышленники использовали очень реалистичные видео- и аудиозаписи глубокой подделки, чтобы выдать себя за финансового директора и запросить срочный перевод средств.

процесс атаки

-

этап обнаружения: Злоумышленники использовали инструменты искусственного интеллекта с открытым исходным кодом для анализа LinkedIn, веб-сайтов компаний и годовых отчетов, чтобы создать подробные профили руководителей.

-

Создание глубокой подделки: Создание видеоклона финансового директора с помощью открытых инструментов глубокой подделки, таких как DeepFaceLab.

-

первоначальный контакт: Поддельные приглашения на конференции, отправленные по фишинговым письмам, содержащим вредоносные ссылки

-

социальная инженерия: Видеоролик с углубленной разработкой, распространенный через приложение для внутренних коммуникаций, требующий осуществления переводов до получения разрешения совета директоров.

-

Перевод средств: Мошенники-казначеи санкционируют переводы в условиях дефицита времени

Основные выводы

-

тактика давления на время: Злоумышленники используют срочность чрезвычайных совещаний совета директоров

-

Многоканальная верификация отсутствует: Организация не внедрила процесс внеполосной валидации

-

Демократизация инструментов искусственного интеллекта: Инструмент глубокой подделки с открытым исходным кодом значительно снижает технические барьеры

-

Злоупотребление внутренним доверием: Естественное доверие сотрудников к сообщениям от "руководства".

5.2 Мошенничество с голосом руководителя энергетической компании (2019 год, но в 2025 году станет обычным явлением)

Обзор дел

Хотя этот случай произошел в 2019 году, подобная атака станет систематической в 2025 году: казначею американского филиала европейской энергетической компании звонит человек, представляющийся генеральным директором материнской компании, и просит срочно перевести 220 000 евро на секретное приобретение. Голос в телефоне идентичен - но это но это глубокая голосовая подделка.

Эволюция в 2025 году

В 2025 году подобные атаки превратились в крупномасштабные операции:

-

Злоумышленники теперь используют модели машинного обучения для имитации голоса и речи конкретных руководителей.

-

Атаки могут осуществляться в режиме реального времени, а не по заранее записанным данным, что затрудняет их обнаружение

-

Глубокая многоязычная подделка становится возможной, расширяя географический охват

-

Организации сообщают, что им трудно отличить подлинные звонки от глубоких подделок

5.3 Нарушение данных прокси-сервера AI из списка Fortune 500 (март 2025 года)

Описание случая

В марте 2025 года финансовая компания из списка Fortune 500 обнаружила, что ее ИИ-агенты по работе с клиентами в течение нескольких недель компрометировали конфиденциальные данные учетных записей. Первопричиной стала хорошо спланированная атака с использованием оперативной инъекции.

Механизмы атаки

Злоумышленник передавал агенту ИИ сообщение, замаскированное под клиентский запрос, содержащий скрытые инструкции. Эти инструкции переписывали системные подсказки агента, отключали фильтры безопасности и вызывали выполнение агента:

-

Утечка конфиденциальной деловой информации на внешние устройства.

-

Измените собственные системные подсказки, чтобы добавить постоянный доступ

-

Выполнение вызовов API с повышенными привилегиями, выходящими за рамки полномочий пользователя.

-

Доступ к несанкционированным базам данных

Масштаб и влияние

-

Неизвестный объем скомпрометированных данных клиентов

-

Утечки остаются незамеченными неделями

-

Миллионы долларов штрафов для компаний

-

Необходимость замены всей архитектуры агентов ИИ

Основные выводы

-

Инъекции Cue являются высокоэффективными векторами атак: Традиционные средства защиты против них неэффективны.

-

ИИ-агенты - новый тип привилегированных пользователейОни могут получать доступ к системе и изменять ее, но надзор за ними практически отсутствует.

-

Устойчивость загрязнения на основе исходных данных: Вредоносные подсказки, хранящиеся в базе данных, автоматически выполняются при обработке агентом

-

Отсутствие наблюдаемости: Организация не проверяла поведение агента ИИ.

5.4 Мошенничество поставщиков Google и Facebook ($100M+)

История болезни

Хотя это дело длилось много лет, в 2025 году оно превратилось в шаблон. Мошенник нажил более $$100 млн, отправляя поддельные счета в Google и Facebook (выдавая себя за настоящих поставщиков оборудования):

-

Форматирование электронной почты в точности соответствует реальному поставщику

-

Запросы соответствуют реальному циклу закупок

-

Вторичное подтверждение переводов средств не проводилось

Модернизированная версия для 2025 года

В 2025 году эта атака эволюционировала:

-

Используйте настоящие взломанные учетные записи электронной почты поставщиков (не подделки).

-

Счета-фактуры, сгенерированные искусственным интеллектом и полностью соответствующие историческим форматам поставщиков

-

Оплата по новым заказам на поставку, чтобы все выглядело как реальная коммерческая операция

-

Атаки на электронную почту поставщиков увеличатся на 137% в 2024 году

VI. Анализ потерь капитала при нарушениях безопасности, вызванных искусственным интеллектом

6.1 Затраты на теневой ИИ

Определение и масштаб

Теневой ИИ - это несанкционированные инструменты и приложения ИИ, используемые сотрудниками без разрешения или надзора со стороны ИТ-отдела. Это значительный фактор роста затрат в 2025 году.

экономическое воздействие

Согласно отчету IBM "Стоимость утечки данных в 2025 году":

-

Утечка теневого ИИ Средняя стоимость: $$4.63M

-

$670 000 больше, чем стандартные события***.

-

Увеличенное время обнаружения:: 247 дней против 241 дня по стандарту

-

Более широкое распространение данных:: Данные 62%, включающие несколько сред

-

Организации не могут отслеживать и контролировать, каким инструментам ИИ передаются конфиденциальные данные.

первопричина

-

отсутствие видимости:: В организации 83% отсутствуют базовые средства контроля для предотвращения воздействия инструментов искусственного интеллекта на данные

-

классификационный кризис: Организации не могут отследить, какие данные относятся к категории конфиденциальных.

-

Сотрудники обходят стороной: Сотрудники используют инструменты искусственного интеллекта для повышения производительности, обходя при этом процессы ИТ-безопасности

-

Вакуум для соблюдения норм: Отсутствие политики или системы управления для использования ИИ на предприятиях

6.2 Затраты на капитальные потери из-за неправильной конфигурации облака

Текущее состояние статистики

-

Утечка 15%Начиная с неправильной конфигурации облака (третий по значимости вектор атаки)

-

Инцидент с облачной безопасностью в 23%Происходит непосредственно от неправильной конфигурации

-

Предприятия с 27%В отчете говорится о нарушении работы публичного облака

-

Gartner прогнозирует 99% отказов облаков к 2025 годуВозникает из-за ошибок клиентов (а не из-за ошибок облачных провайдеров).

-

Все утечки 26%Причина - человеческая ошибка

изменение стоимости

| место хранения | Средняя стоимость утечки |

|---|---|

| Хранение в нескольких средах | $5.05 млн. |

| частное облако | $4.68 млн. |

| публичное облако | $4.18 млн. |

| локальные данные | $401 миллион |

Утечки, связанные с несколькими средами, обходятся дороже всего:

-

Более длительное время обнаружения (276 дней против 241 дня)

-

Необходимость скоординированного реагирования в разных средах

-

Повышенная сложность оценки соответствия

-

Увеличение обязательств по уведомлению третьих сторон

6.3 Стоимость уязвимостей инфраструктуры искусственного интеллекта

уязвимости "нулевого дня" и уязвимости с открытым исходным кодом

Инфраструктура искусственного интеллекта включает в себя не только неправильную конфигурацию, но и неустраненные уязвимости в основных компонентах:

-

Нулевой день ChromaDB: Разрешить чтение и запись без аутентификации

-

Уязвимость Redis Post-Use: Причина повреждения данных в векторном хранилище

-

Уязвимость сервера выводов NVIDIA Triton: Разрешить произвольную загрузку данных

-

Уязвимость в инструментарии NVIDIA Container Toolkit: Инициализация внешних переменных

Стоимость разработки этих уязвимостей составляет:

-

Время от обнаружения до эксплуатации каждой уязвимости: Сокращение с недель (традиционное программное обеспечение) до дней (инструменты искусственного интеллекта)

-

Использование масштаба: Одна уязвимость может затронуть тысячи незащищенных серверов.

-

каскадный эффект: Один скомпрометированный сервис ИИ может привести к компрометации всей системы.

6.4 Капитальные потери при отравлении векторной базой данных

Механизмы атаки

Векторные базы данных (например, Chroma) хранят вкрапления и документы, извлеченные системами искусственного интеллекта. Отравление этих баз данных может привести к следующим последствиям:

-

Система Retrieval Augmentation Generation (RAG) возвращает неверную информацию

-

ИИ-агенты принимают решения на основе ошибочных данных

-

Труднообнаруживаемые постоянные атаки (выглядят как обычная работа)

калькуляция себестоимости

-

Издержки принятия неверных решений из-за отравленных баз данных: Не поддается количественной оценке, но потенциально велик (например, ФАИ принимает неверные инвестиционные решения)

-

Расходы на устранение последствий: переобучение модели, восстановление из резервной копии (обычно в автономном режиме)

-

Расходы на репутациюОбщественное мнение о системах искусственного интеллекта, выдающих необъективные или ошибочные результаты

-

Нормативные затратыПроблемы качества данных нарушают положения об управлении данными

VII. Руководящие принципы для приоритетных действий в области обороны в 2025 году

7.1 Защита личности и доступа (приоритет: наивысший)

Внедрите многофакторную аутентификацию, не требующую паролей и устойчивую к фишингу

Стандартные MFA (SMS-коды, ссылки на электронную почту) оказались недостаточными для защиты от современных атак. Согласно стандарту NIST SP 800-63-4, организации должны внедрить:

Вариант 1: жесткий ключ FIDO2/WebAuthn

-

Используйте аппаратный ключ (USB или Bluetooth) в качестве аутентификатора

-

Ключи защищены шифрованием и никогда не покидают устройство

-

Предотвращение воспроизведения учетных данных и атак типа "человек посередине".

-

Стоимость: $15-$50/год за пользователя

Вариант 2: Встроенная биометрия

-

Используйте Windows Hello, Face ID или Touch ID

-

Закрытый ключ хранится в микросхеме, не подлежит экспорту

-

Федерация с поставщиками идентификационных данных (через OIDC/SAML)

-

Стоимость: включена в существующее оборудование

Параметры реализации

-

финансовый отдел: Все учетные записи 100% с использованием беспарольного MFA

-

ИТ-администратор: MFA без пароля для всех привилегированных учетных записей

-

удалённый доступVPN и облачные приложения должны использовать беспарольные MFA

-

проверка обратного вызова: Любой перевод средств должен быть дважды подтвержден по известному номеру телефона (номер телефона в сообщении не используется)

Расходы на реализацию

| сборки | (производство, изготовление и т.д.) затраты |

|---|---|

| Жесткие ключи (5 000 пользователей) | $75,000 |

| MFA Management Solutions | $50,000 |

| Развертывание и обучение | $30,000 |

| Общие годовые затраты | $155,000 |

ROI

-

Средняя стоимость утечки: $444 млн.

-

Снижение риска кражи учетных данных в 70%: экономия $3,1 млн в $

-

Окупаемость инвестиций за 1 год: 20x

7.2 Усиление инфраструктуры ИИ (приоритет: наивысший)

Инвентаризация и классификация всех систем искусственного интеллекта

-

Создайте спецификацию материалов AI (BOM), в которой перечислены все модели, источники данных, векторные базы данных и конечные точки вывода.

-

Определите место развертывания (локальное, AWS, Azure, Google Cloud и т. д.).

-

Маркировка чувствительности данных (публичные, внутренние, ограниченные, конфиденциальные)

-

Документирование зависимостей и интеграций с каждой системой искусственного интеллекта

Блокировка открытых компонентов ИИ

Неотложные действия (неделя 1):

-

Сканирование всех интернет-ориентированных экземпляров Chroma, Redis, Ollama

-

Использование Shodan, Censys или внутренних сканеров уязвимостей

-

Стоимость: $0-$5 000 (при покупке инструмента для сканирования)

-

-

Включите аутентификацию и шифрование

-

Добавьте надежные пароли или ключи API ко всем базам данных векторов

-

Включить шифрование TLS 1.3

-

Реализация управления доступом на основе ролей (RBAC)

-

-

Включение журнала аудита

-

Записывает все операции чтения и записи данных

-

Отправляйте журналы в систему SIEM для обнаружения аномалий

-

Стоимость: $10,000-$20,000 (конфигурация SIEM)

-

Среднесрочные действия (недели 2-4):

-

Отключите нежелательный доступ в Интернет

-

Перемещение служб искусственного интеллекта за частные подсети

-

Доступ с помощью VPN или бастионного узла

-

Реализация сегментации сети

-

-

Применяйте исправления безопасности

-

Применяйте последние исправления для ChromaDB, NVIDIA Triton и других!

-

Создайте процесс управления исправлениями

-

Стоимость: $5,000-$15,000 (время проектирования)

-

-

Реализация мониторинга во время выполнения

-

Обнаружение аномальных паттернов с помощью поведенческого анализа

-

Отслеживайте выходные данные модели на предмет признаков отравления данных

-

Стоимость: $20,000-$50,000 (инструменты + конфигурация)

-

Долгосрочные действия (месяцы 2-3):

-

Создание системы безопасности CI/CD

-

Сканирование безопасности цепей поставок в процессе обучения моделей

-

Контроль версий зависимостей и сканирование уязвимостей

-

-

реализуйтеАрхитектура нулевого доверия

-

Взаимная аутентификация TLS между всеми компонентами ИИ

-

Отдельные идентификационные и краткосрочные сертификаты для каждой службы

-

Стоимость: $50,000-$100,000 (инструменты и проектирование)

-

7.3 Система управления агентским ИИ (приоритет: высокий)

Масштаб проблемы

-

69% предприятий развернули агентов искусственного интеллекта

-

Только 21% имеет адекватные средства контроля безопасности

-

79% Отсутствие официальной политики управления агентами ИИ

-

20% не имеет никаких элементов управления

Ключевые компоненты системы управления

1. Список и классификация агентов искусственного интеллекта

Запись в списке прокси:

- Имя и назначение агента

- Системы и данные, к которым он имеет доступ

- Предоставленные разрешения (создание, удаление, изменение, чтение)

- Владелец и контактная информация для экстренной связи

- Уровень риска (низкий, средний, высокий, критический)

- Период цикла развертывания (разработка, тестирование, производство)

- Дата проведения аудита

2. Привилегии и принцип наименьших привилегий для охранников

-

Агенты могут получить доступ только к тем данным и системам, которые необходимы для выполнения их функций

-

Отсутствие доступа к глобальным API или API с повышенными привилегиями

-

Ручное утверждение конфиденциальных операций (удаление данных, изменение прав, перевод средств)

-

Строгое управление рабочими процессами

3. Поведенческий мониторинг и обнаружение аномалий

-

Установите базовые показатели нормальной деятельности агента (шаблоны доступа к данным, вызовы API, время выполнения).

-

Обнаружение отклонений от базовой линии в режиме реального времени

-

Автоматическая изоляция агентов, демонстрирующих аномалии

-

Аудит всех операций агента для проведения экспертизы

4. Защита от инъекций Cue

-

Не доверяйте пользовательскому вводу - очищайте все внешние вводы

-

Проверка безопасности пользовательских запросов перед их выполнением

-

Используйте строгую проверку ввода и проверку типов

-

Добавьте команду "not jailbreakable" перед системным приглашением (хотя это не полное решение).

-

Отделение команд агента от данных пользователя

5. инструменты и рамки управления

-

NIST AI Risk Management Framework (AI RMF):: Четыре основные функции (руководство, карта, измерение, управление)

-

ISO 42001: Система управления искусственным интеллектом

-

OWASP LLMRISK TOP 10: Специфические уязвимости LLM

-

Регулярное тестирование "красной команды" на предмет взлома прокси и злоупотреблений

7.4 Классификация данных и управление искусственным интеллектом затенения (приоритет: высокий)

Внедрение классификации корпоративных данных

По данным IBM, в 83% организациях отсутствуют базовые средства контроля для предотвращения попадания данных в руки инструментов искусственного интеллекта. Решение:

| уровень классификации | определить | Использование инструментов искусственного интеллекта | типичный пример |

|---|---|---|---|

| открыто | Можно публично поделиться | безгранично | Маркетинговые копии, опубликованные документы |

| внутри (часть, раздел) | Только для внутреннего использования | Только одобренные инструменты | Записи совещаний, внутренние коммуникации |

| секреты | Коммерческая тайна или конкурентная борьба | Отключите все инструменты искусственного интеллекта | Финансовые данные, дорожная карта продукта |

| ограниченный | Личные или нормативные данные | Запрет - юридический риск | PII, PHI, платежная информация |

Управление теневым искусственным интеллектом

Применяйте технические меры для предотвращения использования несанкционированных инструментов искусственного интеллекта:

-

Предотвращение потери данных (DLP) - Блокировка ограниченных данных при попытке копирования/вставки в инструменты искусственного интеллекта

-

карантин браузера - Запуск недоверенных веб-сайтов в изолированных контейнерах

-

Шлюз API - Блокировка трафика для публичных API ИИ, таких как OpenAI, Claude и другие.

-

Инструменты управления SaaS - Обнаружение использования отделом несанкционированных приложений AI SaaS

-

Обучение персонала - Объясните, почему некоторые данные не могут быть использованы для искусственного интеллекта

Расходы на реализацию

| защитная оболочка | (производство, изготовление и т.д.) затраты |

|---|---|

| Средства DLP | $40,000-$80,000/year |

| карантин браузера | $30,000-$60,000/year |

| Управление SaaS | $20,000-$40,000/year |

| Обучение персонала | $5,000-$10,000 |

| (общая) сумма | $95,000-$190,000/year |

ROI

-

Утечка теневого ИИ Стоимость: $4.63M

-

Снижение риска использования затененного ИИ на 60%: $ 2,78M экономии

-

Срок окупаемости: менее 1 года

7.5 Автоматизация защиты и обнаружение на основе искусственного интеллекта (приоритет: наивысший)

Бизнес-кейсы

Организации, использующие автоматизацию безопасности и искусственный интеллект для достижения поставленных целей:

-

Снижение эксплуатационных расходов на ручную безопасность для 60-80%

-

Средняя годовая экономия $2,4 млн.(внедрение на предприятиях)

-

Время реагирования на инциденты увеличивается в 10 раз(от 4 часов до 15 минут)

-

Сокращение времени тестирования на 80 дней

-

Пятикратное увеличение возможностей по обработке инцидентов, связанных с безопасностью

Ключевые области реализации

1. интеграция SIEM + SOAR

-

Используйте SIEM для объединения всех журналов и событий безопасности

-

Автоматизация общих рабочих процессов реагирования с помощью SOAR

-

Стоимость: $100,000-$200,000 внедрение + $50,000-$100,000/год обслуживание

-

Окупаемость инвестиций: Сокращение времени обнаружения означает среднюю экономию в $1,9 млн на утечку

2. Поведенческий анализ и обнаружение аномалий

-

Установление базового поведения для пользователей и организаций

-

Использование машинного обучения для обнаружения действий, отклоняющихся от базовой линии

-

Автоматический карантин подозрительных учетных записей

-

Cost: $30,000-$60,000/year

3. Автоматизация анализа угроз

-

Автоматическая ассоциация известных вредоносных IP-адресов, доменов, хэшей файлов

-

Индикаторы проактивного блокирования угроз

-

Интеграция с внешними источниками угроз

-

Cost: $20,000-$40,000/year

4. автоматизация соответствия

-

автоматизированная отчетность

-

Непрерывная проверка контроля

-

Cost: $15,000-$30,000/year

7.6 Средства контроля, специфичные для финансового отдела (приоритет: критический)

Согласно данным, приведенным в этом отчете, финансовый сектор является основной мишенью для BEC, управляемых искусственным интеллектом. Специфические средства защиты:

Контрольные списки:

| защитная оболочка | Способы реализации | (производство, изготовление и т.д.) затраты |

|---|---|---|

| Антирыболовный МФА | Все финансовые счета 100% FIDO2 | $75,000 Развертывание |

| проверка обратного вызова | Обязательный второй фактор для перевода средств | Изменения в технологическом процессе (без дополнительной оплаты) |

| Рабочий процесс утверждения платежей | Многоуровневая авторизация, пороговые суммы | $20,000-$40,000 Инструменты |

| Проверка поставщиков | Проверка DNS/DMARC, проверка третьей стороной | $10,000-$20,000 Инструменты |

| Глубокое обнаружение подделок | Программа проверки подлинности видео/аудио | $30,000-$50,000/year |

| Регулярные тренировки | Тест на осведомленность о безопасности для имитации атак BEC | $10,000-$20,000/year |

Экономическая эффективность снижения рисков:

-

Средняя стоимость BEC: $200,000-$500,000 за мероприятие

-

Средства защиты от атак 99%

-

Одна успешная остановка позволяет оплатить годовой объем контроля.

VIII. Резюме классических вопросов

Вопрос 1: Сколько организаций сообщают, что ИИ меняет их подверженность угрозам?

решение

В отчетах крупнейших поставщиков и агентств говорится, что в 2025 году ИИ станет важным фактором как в атаке, так и в обороне, причем темпы его роста будут стремительными:

-

93% Лидеры в области безопасности ожидают ежедневных атак искусственного интеллекта к 2025 году

-

89% считает защиту на основе искусственного интеллекта критически важной для устранения пробелов в обороне

-

76% сообщает, что скорость и изощренность атак искусственного интеллекта опережает их защиту

-

Руководители компаний в 861ТП3Т сообщили о хотя бы одном инциденте, связанном с ИИ, за последние 12 месяцев

Вопрос 2: Действительно ли глубокая подделка ИИ является основным фактором для BEC?

решение

Да. Предупреждение 2025 охватывает голосовые и текстовые пародии с реалистичным содержанием. Организации должны:

-

Внеполосное подтверждение любого запроса на перевод средств или предоставление прав доступа

-

Перезвоните по известному номеру телефона, который не был получен в сообщении

-

Реализация инструментов глубокого обнаружения подделки для проверки видео

-

Ужесточение требований к утверждению "срочных" запросов на финансирование

На глубокие подделки теперь приходится 6,51 TP3T всех мошеннических атак, что на 21371 TP3T больше, чем в 2022 году.

Вопрос 3: Является ли открытая инфраструктура ИИ действительно распространенной?

решение

ДА. Отраслевое сканирование показывает сотни незащищенных хранилищ данных ИИ и конечных точек, часто развернутых в виде контейнеров и доступных в общедоступном Интернете:

-

200+ полностью незащищенных серверов Chroma, которые могут читать/записывать данные без аутентификации

-

Более 10 000 случаев использования Ollama в Интернете

-

2 000 незащищенных серверов Redis

-

Многие дополнительные серверы подвержены риску, но частично защищены

-

Это проблемы неправильной конфигурации, а не проблемы "нулевого дня" - все они должны быть немедленно исправлены!

Вопрос 4: Действительно ли ИИ снижает стоимость компромисса для защитников?

решение

Согласно отчету IBM Cost of a Data Breach 2025, организации, использующие искусственный интеллект и автоматизацию безопасности, обычно отмечают более низкую среднюю стоимость взлома по сравнению с аналогичными компаниями:

-

Организации, использующие инструменты искусственного интеллекта, сократили жизненный цикл утечек на 80 дней

-

Средняя экономия $1,9 млн.

-

При многочисленных утечках в окружающую среду (самая высокая стоимость) экономия еще выше

-

Третьи стороны, анализирующие тот же набор данных, подчеркивают использование ускорения кривых, причем все больше компаний сообщают о хотя бы ограниченном использовании ИИ для обнаружения и реагирования.

Однако это справедливо только для тех организаций, которые уже внедрили и правильно эксплуатируют инструмент. Кривая внедрения все еще находится на ранней стадии.

Вопрос 5: Какой индивидуальный контроль следует внедрить в этом квартале?

решение

Правило двух шагов:

-

Антифишинговый MFA для всех финансовых счетов: Используйте FIDO2/WebAuthn, а не SMS или коды электронной почты!

-

Обязательное подтверждение обратного вызова при изменении платежа или банковского реквизита: Используйте телефонный номер из известного номера, хранящегося в личном деле сотрудника, и ни в коем случае не номер, полученный в сообщении.

Эти средства контроля значительно снижают вероятность успеха BEC и являются наиболее экономически эффективным способом блокирования наиболее распространенных векторов первоначального доступа.

Вопрос 6: Какие тенденции уязвимости являются авторитетными ежегодными эталонными показателями?

решение

Начните с них, а затем проверьте отраслевые нюансы:

-

Verizon DBIR 2025 - Максимальная доказательная база для событийной модели

-

IBM Cost Data Breach Report 2025 - Анализ затрат и первопричин

-

Расследование по делу о вымогательстве CrowdStrike2025 - Особенно это касается вымогательских программ и атак, ускоряемых искусственным интеллектом.

-

ENISA Угрожающие ландшафты 2025 - Европейская перспектива и возникающие угрозы

-

Отчет Microsoft о цифровой обороне за 2025 год - Глобальное представление о контрагентах и возможностях защиты

-

Trend Micro Безопасность ИИОтчет о состоянии дел (первая половина 2025 года) - Инфраструктура ИИ и безопасность агентов

IX. Отраслевые рекомендации и анализ пробелов

9.1 Сравнительный анализ оборонных систем

Многие организации используют модели и рамки зрелости для оценки уровня безопасности. В этом анализе сравнивается то, как ведущие системы относятся к безопасности ИИ:

| Рамки/стандарты | Охват искусственным интеллектом | управление по доверенности | Впрыскивание кия | пригодность |

|---|---|---|---|---|

| NIST AI RMF | Всеобъемлющий (управление/карта/измерение/управление) | пояснительная записка | содержать в скрытом виде | ваш (почетный) |

| ISO 27001 | Ограниченно (традиционная информационная безопасность) | не иметь | не иметь | опускать (голову) |

| ISO 42001 | Специализированное управление искусственным интеллектом (добавлено в 2024 году) | пояснительная записка | пояснительная записка | ваш (почетный) |

| Контроль СНГ | Ограниченно (в основном инфраструктура) | не иметь | не иметь | опускать (голову) |

| NIST Cybersecurity Framework v2.0 | Частично (добавлены соображения по поводу искусственного интеллекта) | часть | часть | умеренный |

| PCI DSS 4.0 | Ограниченно (только в контексте защиты данных) | не иметь | не иметь | опускать (голову) |

в заключениеNIST AI RMF и ISO 42001 являются наиболее применимыми системами для оценки и реализации зрелости безопасности ИИ.

9.2 Обзор средств защиты

Платформа SIEM/SOAR (обнаружение и реагирование на события)

| предложения | Возможности обнаружения искусственного интеллекта | Поддержка агентов искусственного интеллекта | MCP Security | (производство, изготовление и т.д.) затраты |

|---|---|---|---|---|

| Splunk Enterprise Security | Сильный (машинное обучение обнаружению аномалий) | часть | не иметь | $150K-$500K/year |

| Microsoft Sentinel | Сильный (интеграция Azure ML) | часть | не иметь | $50K-$300K/year |

| CrowdStrike Falcon XDR | Сильный (поведенческий анализ) | часть | не иметь | $200K-$600K/year |

| Datadog | умеренный | не иметь | не иметь | $30K-$200K/year |

| IBM QRadar | умеренный | не иметь | не иметь | $100K-$400K/year |

Безопасность инфраструктуры ИИ (защита контейнеров/векторных баз данных)

| предложения | Защита хрома | Защита Олламы | Защита Redis | Поддержка MCP |

|---|---|---|---|---|

| Виз | да | да | да | да |

| Snyk | нет | нет | нет | нет |

| Аква Безопасность | часть | часть | часть | нет |

| Trend Micro | да | да | да | да |

| Palo Alto Networks | часть | часть | да | нет |

Агент ИИ Безопасность

| предложения | поведенческий мониторинг | Обнаружение инъекций реплик | Управление рабочими процессами | уровень зрелости |

|---|---|---|---|---|

| Obsidian Security | да | да | да | ваш (почетный) |

| Лакера | да | да | нет | умеренный |

| Ребаф | да | да | нет | умеренный |

| Надежный интеллект | да | да | нет | умеренный |

| Настройка рабочих процессов SOAR | часть | нет | да | опускать (голову) |

9.3 Недостатки внутреннего потенциала

Фактическое состояние по сравнению с желаемым состоянием типичного бизнеса:

| способности | текущее состояние | желаемое состояние | неравенства | Пограничные расходы |

|---|---|---|---|---|

| Инвентаризация инфраструктуры искусственного интеллекта | 29% имеет полный список | 100% | 71% | $50-$100K |

| Политика управления агентами искусственного интеллекта | 21% имеет официальную политику | 100% | 79% | $30-$50K (стратегия) + $50-$100K (инструменты) |

| Защита от впрыскивания кия | 5% был реализован | 95% | 90% | $100-$200K (инструменты + улучшения) |

| Развертывание MFA (финансы) | 45% Использование МФА для борьбы с рыбной ловлей | 100% | 55% | $75-$150K |

| Средства искусственного интеллекта DLP | 18% был реализован | 80% | 62% | $95-$190K |

| Интеграция SIEM/AI | 35% имеет какой-то вид обнаружения искусственного интеллекта | 90% | 55% | $150-$300K |

| автоматизация безопасности | 40% имеет базовый SOAR | 85% | 45% | $100-$200K внедрение + $50-$100K/год |

Общие расходы на ликвидацию разрыва: $600K-$1.2M первоначальные + $100-$200K/год эксплуатационные расходы

X. Заключение

10.1 Основные выводы

В 2025 году ИИ станет обоюдоострым мечом для кибербезопасности. Ключевые выводы включают:

-

Рост угроз опережает оборонуВ то время как защита с помощью ИИ совершенствуется, атаки с помощью ИИ растут и развиваются быстрее.761 Организационная отчетность TP3T не может соответствовать скорости атак.

-

Инфраструктура искусственного интеллекта - новая поверхность для атак: Тысячи открытых систем искусственного интеллекта (векторные базы данных, серверы выводов, хранилища моделей) создают прямые пути для атак. Это не продвинутые угрозы - это базовые вопросы гигиены безопасности.

-

Теневой ИИ - новая причина утечек данныхНеконтролируемое использование инструментов искусственного интеллекта приводит к дополнительной утечке $67 миллионов. В большинстве организаций отсутствует базовый контроль.

-

Агент ИИ - новый привилегированный пользовательАгенты искусственного интеллекта сейчас имеют больший доступ к системе, чем большинство сотрудников. В большинстве организаций отсутствует надлежащая система управления.

-

Глубокая подделка теперь доступна на коммерческой основе: Клонирование голоса и видео превратилось из дорогостоящих заказных атак в относительно недорогие крупномасштабные операции, причем крупные мошенничества будут происходить ежегодно в 2025 году.

-

Окупаемость инвестиций в оборону очевидна: Организации, использующие средства защиты от ИИ, экономят в среднем $1,9 млн на утечку. Организации, которые вкладывают средства на ранних стадиях, выигрывают как в стоимости, так и во времени реагирования.

-

Значительные региональные различия: Гонконг и другие регионы Азиатско-Тихоокеанского региона сталкиваются с более высокими, чем в среднем по миру, угрозами. В частности, финансовый центр подвержен целенаправленному воздействию BEC и глубокой контрафактной деятельности.

10.2 Приоритетные направления деятельности для лиц, принимающих решения

Непосредственно (дни 0-30)

-

Инвентаризация и классификация всех систем искусственного интеллекта

-

Развертывание антифишинговой MFA для всех учетных записей в финансовом секторе

-

Сканирование базы данных векторов, ориентированных на Интернет, и добавление аутентификации

-

Включите проверку обратного вызова для финансовых переводов

Стоимость: $75K-$150K | ROI: Среднее по блоку $200K+ BEC

Краткосрочные (30-90 дней)

-

Создание системы управления и инвентаризации агентов ИИ

-

Внедрение классификации корпоративных данных и теневого ИИ DLP

-

Развертывание поведенческой аналитики для обнаружения аномалий

-

Проведите аудит безопасности всех развернутых систем искусственного интеллекта.

Стоимость: $150K-$300K | ROI: Снижение риска утечки теневого ИИ $278M+

Среднесрочная (дни 90-180)

-

Реализация интеграции SIEM + SOAR для обнаружения на основе искусственного интеллекта

-

Развертывание защиты от инъекций и отравления векторов

-

Создайте автоматизацию системы безопасности для более быстрого реагирования

-

Проведение группового тестирования прокси-системы

Стоимость: $200K-$400K | ROI: сокращение времени тестирования на 80 дней, экономия $1.9M/утечка

Долгосрочная (180-365 дней)

-

Полное внедрение архитектуры нулевого доверия

-

Создание безопасного SDLC для разработки и внедрения ИИ

-

Обеспечьте непрерывный мониторинг безопасности агентов

-

Разработка культуры безопасности ИИ для конкретной организации

Стоимость: $300K-$600K | Рентабельность инвестиций: Создание устойчивости для предотвращения дорогостоящих событий

10.3 Специальные рекомендации для Азиатско-Тихоокеанского региона

Местные организации должны быть особенно обеспокоены, учитывая особый сценарий угроз в Гонконге:

-

Защита от BEC для финансовых учреждений:: В финансовом секторе должно быть внедрено строгое управление платежами из-за крупных переводов и международных операций

-

Обнаружение мошенничества в розничной торговле: В секторе розничной торговли уровень мошенничества составляет 17,81 TP3T (+1131 TP3T по сравнению с прошлым годом), и ему следует уделять первоочередное внимание инвестициям в средства обнаружения мошенничества.

-

Анализ трансграничных угрозГеографическое положение Гонконга делает его уязвимым для атак конкретных групп угроз в Азиатско-Тихоокеанском регионе. Обмен информацией об угрозах с региональными CERT и правоохранительными органами

-

соблюдение нормативных требованийГонконгские правила защиты данных и растущие международные требования к соответствию нормативным требованиям делают правильную категоризацию и защиту данных в облачных системах и системах искусственного интеллекта критически важными.

-

Устойчивость цепочки поставок: организациям следует оценить безопасность инструментов и услуг искусственного интеллекта сторонних производителей, учитывая широкую интеграцию искусственного интеллекта в глобальную цепочку поставок.

10.4 Заключительные рекомендации

справаглавный офицер безопасности(CSOОрганизации Объединенных Наций

-

Переоценка склонности к риску: Скорость и масштаб угрозы ИИ изменились. Традиционные циклы беспристрастной оценки слишком медленны. Создайте основу для быстрого принятия решений.

-

Инвестиции в наблюдаемые объекты, а не в инструментыВместо того чтобы приобретать новейшие инструменты, основное внимание уделяется наблюдаемым параметрам, которые позволяют выявлять аномалии и отслеживать поведение систем ИИ.

-

Создание экспертных знаний в области безопасности ИИ: Большинство организаций обладают глубокими знаниями в области традиционной кибербезопасности, но не имеют достаточного опыта в борьбе с угрозами, связанными с ИИ. Приоритет отдается найму или обучению экспертов по безопасности ИИ.

-

Внедрение управления через доверенных лиц в качестве приоритета: Создайте систему управления перед масштабным развертыванием агентского ИИ. Управление "после факта" обходится в 10 раз дороже, чем управление "до факта".

Рекомендации для оперативного руководства

-

Безопасность искусственного интеллекта - это риск для бизнесаКибербезопасность - это не "проблема ИТ", а риск непрерывности бизнеса. Интегрируйте безопасность ИИ в управление рисками предприятия.

-

Профилактика гораздо дешевле, чем исправление: $4.44M затрат на одну утечку. Окупаемость инвестиций в оборону очевидна - в среднем $2,2M экономии на одну утечку.

-

Теневой искусственный интеллект - это риск соответствия нормативным требованиямНерегулируемое использование инструментов искусственного интеллекта может нарушать правила конфиденциальности данных (GDPR, CCPA и т. д.). Наличие системы управления для контроля рисков.

-

Риски поставщиков расширились: Любой инструмент искусственного интеллекта, облачный сервис или модуль стороннего производителя представляет собой новое измерение риска. Проводите строгую оценку безопасности сторонних производителей.

10.5 Перспективы

К 2026 году мы можем ожидать:

-

Атаки, управляемые искусственным интеллектом, будут продолжать ускорятьсяособенно в области прокси ИИ

-

Оборонные технологии будут развиватьсяОрганизации, использующие инструменты искусственного интеллекта для обороны, станут более распространенными

-

Нормативно-правовая база будет создана послеИспользование ISO 42001 и NIST AI RMF для управления безопасностью ИИ станет обязательным

-

Безопасность искусственного интеллекта будет в центре вниманияБольшинство уязвимостей и инцидентов связано с неправильно настроенными или скомпрометированными агентами.

-

Мошенничество с глубокой подделкой растетПока биометрия и многофакторная аутентификация не станут обычным делом

Главное - действовать сейчас. Те организации, которые инвестируют в ИИ-безопасность сегодня, получат конкурентное преимущество в следующем году: более быстрое обнаружение угроз, оперативное реагирование, меньшие затраты и репутационный ущерб.

Ссылка на литературу

-

Verizon Data Breach Investigations Report (DBIR) 2025 - крупнейшая база данных об инцидентах и нарушениях

-

IBM Cost of the Data Breach Report 2025 - Средняя стоимость утечки данных в мире $444M, анализ по отраслям и регионам

-

Отчет CrowdStrike 2025 State of Ransomware - организация 76% не может сравниться со скоростью атак искусственного интеллекта

-

Microsoft Digital Defense Report 2025 - Угрозы национального уровня и возможности защиты

-

Trend Micro State of AI Security Report 1H 2025 - 10 000+ открытых инстансов Ollama, 200+ незащищенных серверов Chroma

-

ENISA Threat Landscape 2025 - Европейская перспектива угроз

-

Всемирный экономический форум "Перспективы глобальной кибербезопасности до 2025 года" - 93% Лидеры в области безопасности ожидают ежедневных атак искусственного интеллекта

-

Kaspersky Financial Sector Report 2025 - 12,8% финансовых компаний B2B сталкиваются с вымогательством

-

KELA Escalating Ransomware Report 2025 - 34% Глобальный рост ключевых секторов, рост производства 61%

-

HKCERT Hong Kong Cyber Security Outlook 2025 - 7 811 случаев фишинга (+108%), инциденты с вредоносным ПО +4,8x

-

NIST Artificial Intelligence Risk Management Framework (AI RMF) - рамочная основа для обеспечения безопасности искусственного интеллекта на предприятии

-

ISO 42001 - стандарт для систем управления искусственным интеллектом

-

OWASP LLM Risk TOP 10 - категории уязвимостей, характерные для LLM

-

McKinsey Развертывание агентского ИИ с обеспечением безопасности - лучшие практики агентского управления

-

Obsidian Security Agentic AI Security Report - 69% предприятий развертывают агентов искусственного интеллекта, только 21% имеют средства контроля безопасности

-

Статистика кибератак ИИ DeepStrike к 2025 году - рост 72%, прогнозируемый ущерб $30B

-

Отчет KnowBe4 2025 Phishing Trends Report - 83% фишинговых писем с использованием искусственного интеллекта

-

Отчет Cysure 2025 BEC - случай мошенничества с поставщиками Google/Facebook $100M+

-

Deep Instinct Financial Services AI Cyberattack Survey - 45% Столкновение с ИИ-атаками

-

NIST SP 800-63-4 - Стандарт для аутентификации и управления жизненным циклом, включая беспарольную MFA

-

Статистика преступлений в сфере кибербезопасности полиции Гонконга (первое полугодие 2025 года) - убытки HK$3.04B, +15% по сравнению с прошлым годом

-

Thales 2025 Data Threat Report APAC Edition - 65% Организации считают искусственный интеллект главной проблемой безопасности

-

Будущий CISO Гонконга 2025 Киберзащита - 6,2% Уровень цифрового мошенничества

Оригинальная статья написана Chief Security Officer, при воспроизведении просьба указывать: https://www.cncso.com/ru/2025-ai-cyber-attack-trends-security-report.html.