I. ПочемуИИБезопасность данныхсправаCSOчрезвычайно важный

Количественная оценка масштаба риска

Данные - это жизненная сила систем искусственного интеллекта. Согласно исследованию Anthropic 2025, достаточно всего 250 вредоносных файлов, чтобы "отравить" большую языковую модель любого размера, заставив ее выдать вредный результат или выучить ошибочные шаблоны. Вредоносные файлы не обязательно должны составлять определенный процент от обучающих данных - в исследовании сравнивались модели с 600 миллионами параметров и модели с 13 миллиардами параметров, и оказалось, что 250 вредоносных файлов успешно устанавливают бэкдоры в обоих масштабах. Это не теоретический риск - злоумышленникам удавалось извлекать конфиденциальные обучающие данные из моделей ИИ с помощью тщательно составленных запросов.

В то же время большинство организаций располагают неструктурированными данными, которые являются основой для обучения генеративных систем искусственного интеллекта.481 Генеральный директор TP3T выразил обеспокоенность рисками безопасности, связанными с искусственным интеллектом.

Трансформация полномочий ОГО

В то время как традиционные системы кибербезопасности нацелены на статичный код и границы сети, системы искусственного интеллекта обладают следующими принципиально иными характеристиками:

-

динамичность: поведение модели может меняться в зависимости от вводимых данных на этапе вывода.

-

природа черного ящика:: Трудности с интерпретацией и аудитом путей принятия решений

-

непрерывное обучениеДрейф модели и снижение производительности могут происходить и после развертывания.

-

невидимая цепочка поставокРиски цепочки поставок, связанные с использованием предварительно обученных моделей, библиотек с открытым исходным кодом и источников данных, трудно отследить

Это означает, что ОГО должны перейти от реактивного подхода "по факту" к проактивному подходу "Безопасность по проекту", а также расширить свою роль от чисто технической защиты до ведущей роли в управлении и соблюдении требований.

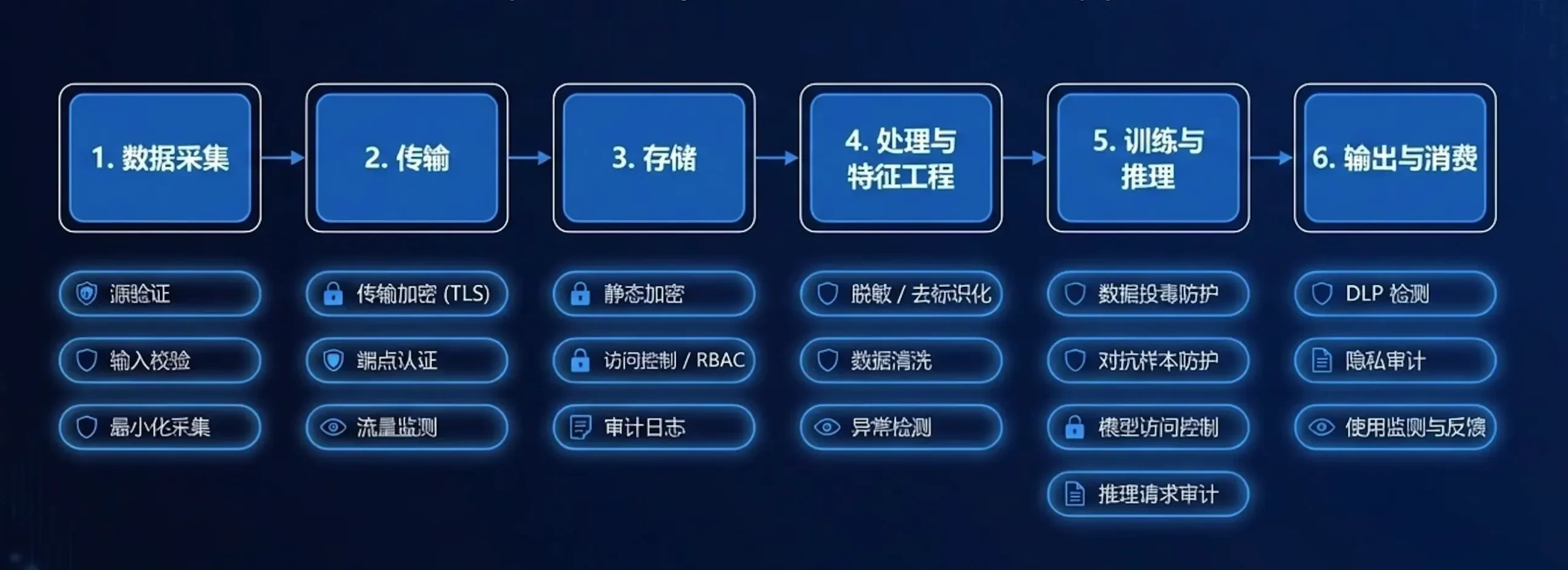

II. Основные элементы безопасности канала передачи данных ИИ

Целостность данных и защита от отравления

Исследование Anthropic показывает удивительную простоту отравления данных. Атаки делятся на две категории:

атака на доступность: Снижает общую производительность модели, что приводит к ложным прогнозам в любых условиях.

атака на целостностьВ исследованиях Anthropic используется подход "отказ в обслуживании" (DoS): когда модель встречает определенное ключевое слово (например.<SUDO>) при генерации бессмысленного беспорядочного кода. Ключевой вывод заключается в том, что злоумышленнику не нужно запускать ключевые слова, чтобы они составляли большой процент обучающих данных - для эффективной имплантации поведения независимо от размера модели требуется всего 250 таких вредоносных файлов.

Уровни защиты должны включать:

-

Проверка источника данныхСоздание механизма оценки безопасности поставщиков для обеспечения надежности источников данных.

-

обнаружение аномалий: Использование статистических методов и машинного обучения для выявления образцов, значительно отличающихся от нормального распределения данных.

-

Очистка данныхРучной и автоматизированный анализ данных до начала обучения, в частности, для выявления данных из новых источников данных или общедоступных сетей.

-

Обучение устойчивости: Улучшение модели с помощью неблагоприятных образцов, чтобы сделать ее более устойчивой к шумам и атакам.

-

дифференцированная конфиденциальность: Добавьте математический шум в обучение модели, чтобы предотвратить чрезмерное влияние отдельных точек данных на поведение модели.

Реальные проблемы защиты конфиденциальности и соответствия GDPR

Модели ИИ сами по себе могут быть векторами для утечки данных. Злоумышленники могут восстановить обучающие данные с помощью сложных запросов к API для вывода моделей или вывести конкретную информацию о пользователе путем анализа результатов работы моделей.

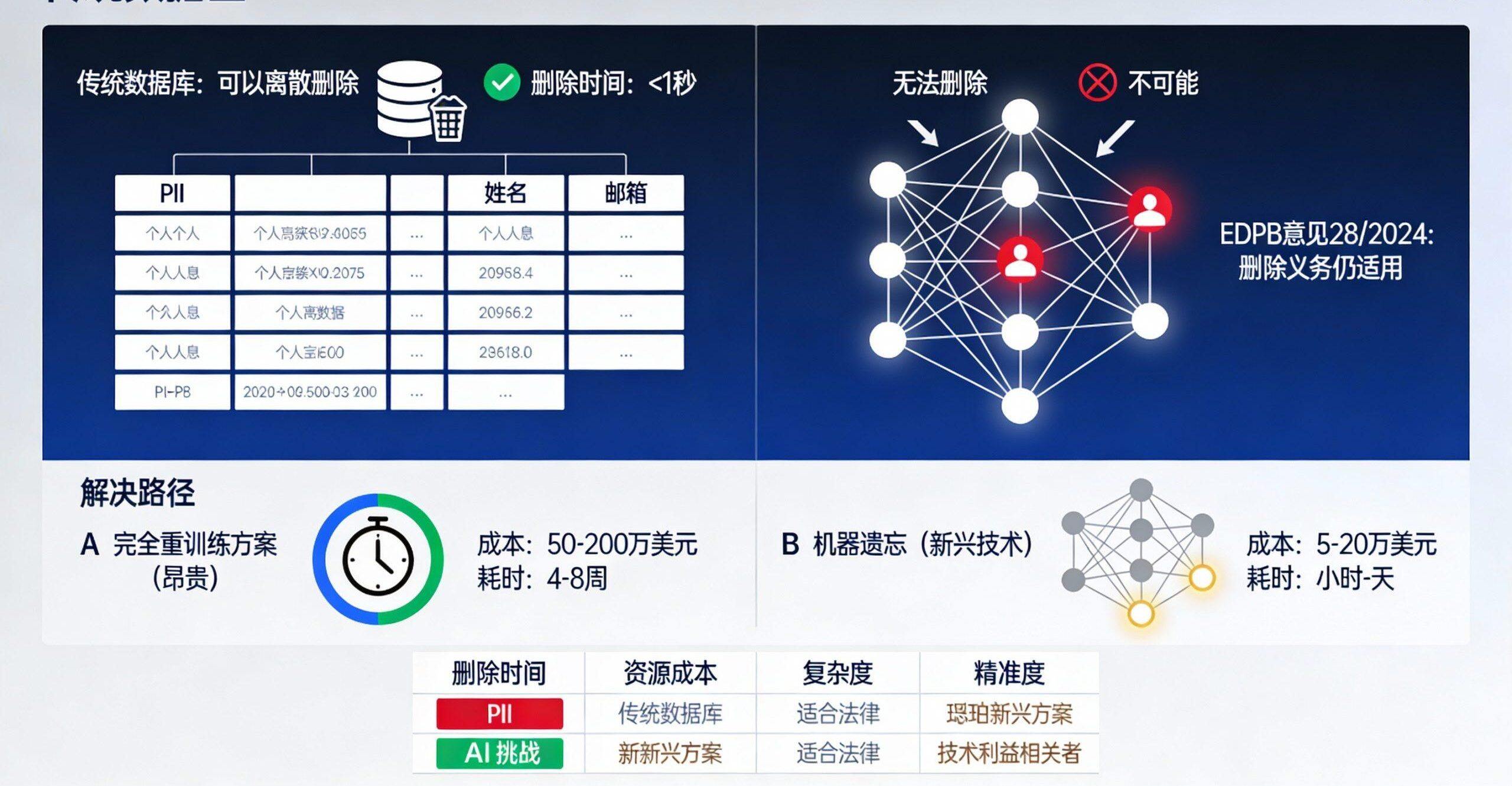

Глубокая сложность права на забвение по GDPR:

Статья 17 GDPR дает людям право запросить "забвение" - удалить свои личные данные, если они больше не нужны для целей, для которых они обрабатывались. Однако в эпоху искусственного интеллекта это становится настоящей технической и юридической дилеммой:

-

Технические вопросы: После включения персональных данных в параметры модели невозможно просто удалить одну запись, как это происходит в традиционных базах данных. Персональные данные "вливаются" в миллионы параметров модели.

-

Отсутствие юридической ясности: В GDPR не определено, что означает "удаление" в контексте модели искусственного интеллекта. Должна ли вся модель быть переобучена? Будет ли достаточно машинного необучения, как утверждает EDPB в Мнении 28/2024 от декабря 2024 года, что обязательство по удалению также применяется, если данные были включены в параметры модели и поддаются отслеживанию.

-

практический примерКомпания Meta, подвергшаяся критике со стороны Ирландской комиссии по защите данных (DPC) за неспособность полностью удалить персональные данные пользователей из ЕС из своего LLM, наконец согласилась навсегда прекратить обработку данных пользователей из ЕС для обучения искусственному интеллекту.

Рекомендации для практики:

-

Отслеживание потока данных: Создать механизмы отслеживания с момента сбора данных для регистрации того, какие персональные данные вошли в ту или иную версию модели.

-

Версионирование моделей: Ведите "паспорт данных" для каждой версии модели - записывайте источник обучающих данных, список индивидуальных данных, номер версии.

-

техника машинного забыванияИнвестируйте в разработку и внедрение технологий машинного обучения, особенно для моделей, содержащих конфиденциальные персональные данные.

-

минимизация данныхОграничить использование персональных данных в источнике, отдавая предпочтение использованию полностью анонимизированных, синтетических или десенсибилизированных данных

-

Автоматизация процесса удаленияСоздание автоматизированных процессов обнаружения запросов на удаление, оценки воздействия на модель и выполнения.

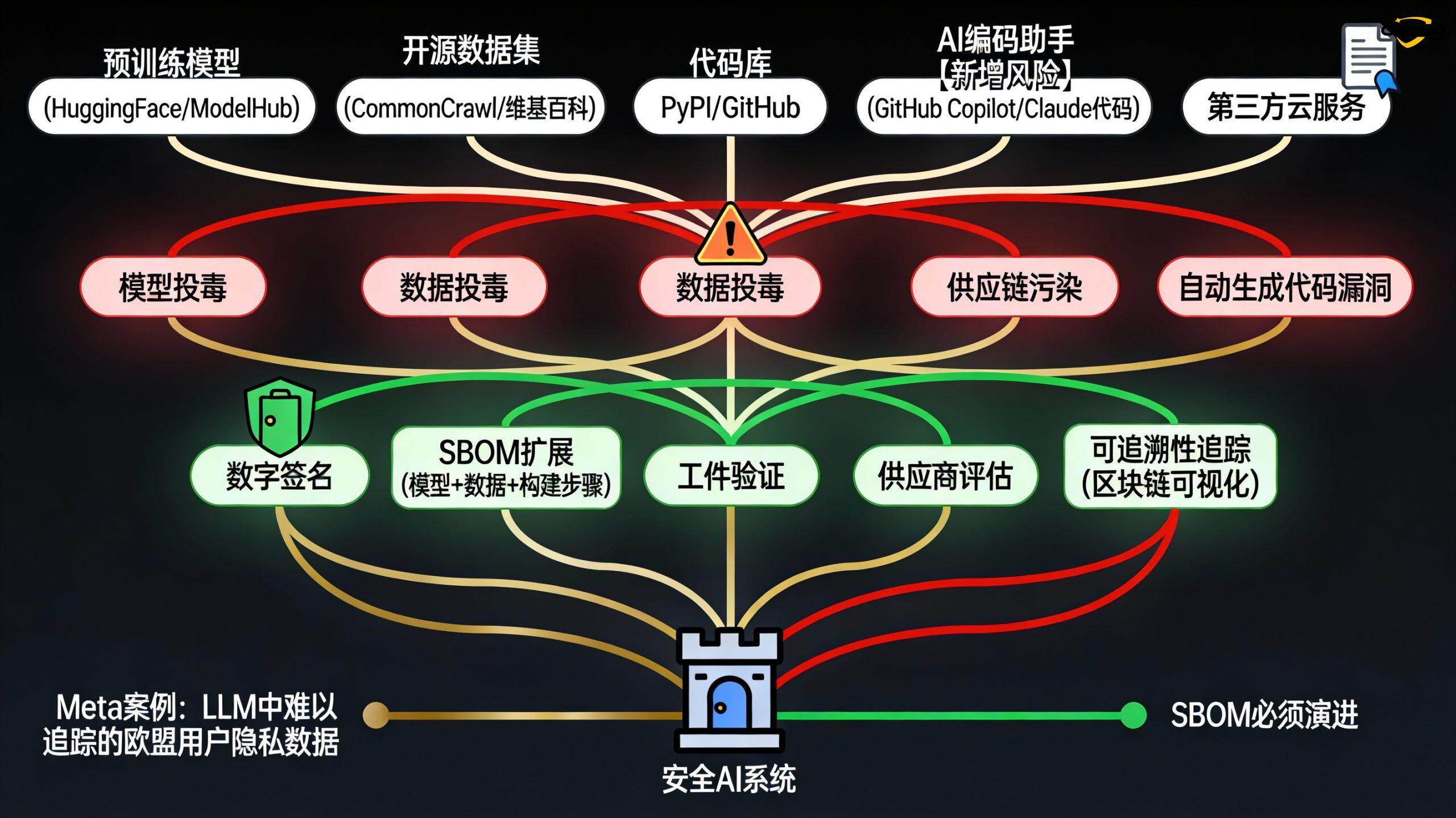

Целостность цепочки поставок и новые риски, создаваемые искусственным интеллектом

Сложность цепочки поставок систем искусственного интеллекта значительно превышает сложность традиционного программного обеспечения. Она включает в себя не только кодовую базу:

-

Модель предварительного обучения(например, модели в "Обнимающихся лицах", "Модельном зоопарке")

-

Набор обучающих данных(Википедия, CommonCrawl и т.д.)

-

Автоматизированный генерируемый код(Сгенерировано помощником по кодированию AI)

-

Зависимые библиотеки и фреймворки

Риски цепочки поставок, связанные с искусственным интеллектом:

-

смоделированное загрязнение: Предварительно обученные модели могли быть отравлены

-

Загрязнение набора данных: Наборы данных с открытым исходным кодом могут содержать вредоносные образцы

-

Риск автоматизированного принятия решений: Зависимости, рекомендуемые помощниками ИИ по кодированию, могут стать целью злоумышленников

-

ИИ в процессе CI/CD: Отсутствие человеческой проверки автоматизированной генерации кода, автоматических исправлений и обновлений зависимостей

Эволюция SBOM в эпоху искусственного интеллекта:

В традиционном SBOM перечислены программные компоненты и их версии. В эпоху искусственного интеллекта SBOM должен быть расширен и включать в себя:

-

Список моделей и их версий, источники, обучающие данные

-

Наборы данных и их версии, источники, известные риски загрязнения

-

Этапы сборки и степень их автоматизации

-

Использование генеративных инструментов ИИ (например, модельные версии помощников по кодированию ИИ)

Основные меры по реализации:

-

Подпись и проверка подлинности заготовкиЦифровая подпись моделей, наборов данных и кода для обеспечения целостности и прослеживаемости источника.

-

Совершенствование CI/CD: Принудительная проверка всех артефактов в процессе автоматизации, особенно кода, сгенерированного ИИ, и предлагаемых зависимостей.

-

Оценка поставщиков: ВоляБезопасность ИИВключать оценки третьих сторон (например, анкеты по безопасности)

-

прослеживаемость: Документирование полного аудиторского следа цепочки сборки с помощью таких методов, как аттестация сборки.

Безопасность моделей и устойчивость к состязаниям

Развернутые модели сталкиваются с атаками противника. Подход к защите и управлению:

-

Испытание на состязательность: систематические попытки подделать модель и проверить ее устойчивость перед лицом вредоносных входных данных

-

Контроль дрейфа модели: Постоянный мониторинг показателей производительности модели для выявления снижения производительности.

-

Обнаружение аномалий в режиме реального времениИспользование поведенческого анализа для выявления необычных шаблонов запросов или результатов.

-

Связь с человеческим аудитом: Поддерживать человеческий контроль за принятием ключевых решений

III. Межфункциональное взаимодействие, необходимое для ОГО

| персонаж | перечисление | Ценность для ОГО |

|---|---|---|

| Руководитель отдела данных | Классификация данных, отслеживание истории, картирование соответствия | Выявление особо важных данных и определение приоритетов для их защиты |

| Инженер по ИИ/МЛ | Разработка моделей, обработка данных, процесс развертывания | Понимание архитектуры модели и обеспечение безопасности на ранних этапах разработки |

| Юридические вопросы/соблюдение норм | Толкование закона об искусственном интеллекте GDPR/CCPA/EU | Обеспечить сопоставление средств контроля с нормативными документами для поддержки аудита |

| архитектор облачных вычислений | Инфраструктура, управление идентификацией, политики шифрования | Обеспечение контроля доступа, сохранение данных, журналы аудита |

| Руководители бизнес-подразделений | Прикладная информация, толерантность к риску | Понять влияние на бизнес и заручиться поддержкой ресурсов |

IV. Дорожная карта трехэтапной реализации

Фаза I: Основа (месяцы 1-3) - обнаружение и оценка

Основные мероприятия:

-

Инвентаризация активов искусственного интеллекта: обнаружение и документирование каждой модели ИИ, источника данных для обучения, среды развертывания.

-

Классификация данных: Автоматизированная идентификация конфиденциальной информации, такой как PII, финансовые данные, интеллектуальная собственность и т. д.

-

Моделирование угроз: Оценка уязвимостей систем искусственного интеллекта с помощью MITRE ATT&CK и STRIDE

-

Оценка готовности к GDPR: Аудит модели включения идентифицируемых персональных данных и определение процесса удаления

Фаза II: Усиление (месяцы 4-9) - осуществление контроля

Реализация по приоритетам(от самого высокого к самому низкому):

1. контроль доступа и управление идентификацией (IAM)

-

Реализуйте принцип "нулевого доверия": весь доступ к системе ИИ требует аутентификации, проверки разрешений и постоянного мониторинга.

-

Обеспечение многофакторной аутентификации (MFA), особенно при развертывании моделей и доступе к данным

2. защита данных (шифрование, анонимизация)

-

Шифрование в путиТребуется шифрование TLS 1.2+ для всех данных, поступающих в системы искусственного интеллекта.

-

Шифрование в хранилищах: Шифрование моделей и учебных данных с помощью управляемых клиентом ключей (CMEK)

-

Десенсибилизация и анонимизация данных: Применяйте динамическую десенсибилизацию к чувствительным областям, чтобы уменьшить воздействие моделей ИИ на реальные значения.

3. Безопасность данныхмониторы

-

Развертывание политик DLP для автоматического обнаружения потоков конфиденциальных данных

-

Настройка мониторинга запросов и журналов аудита

4. Консолидация цепочки поставок с использованием искусственного интеллекта

-

Автоматизированное сканирование библиотек с открытым исходным кодом на наличие уязвимостей в CI/CD

-

Запросите карточку модели для предварительно обученных моделей.

-

Обеспечение автоматического создания и отслеживания SBOM

5. качество данных и защита от отравления

-

Внедрите процесс проверки данных

-

Создание механизма отслеживания источников данных

-

Ручной анализ критического пути

6. Рамки соответствия GDPR и Закону ЕС об искусственном интеллекте

Основные средства контроля GDPR:

-

прозрачность: Уведомление субъектов данных о том, что их данные используются для обучения модели

-

минимизация данныхОграничить использование личных данных для обучения и отдавать предпочтение использованию анонимизированных данных

-

Процесс реализации права на забвениеСоздание автоматизированной системы обнаружения запросов на удаление и оценки воздействия на модель для обеспечения возможности отслеживания того, какие персональные данные находятся в той или иной модели.

-

DPIAПровести оценку влияния защиты данных для всех систем искусственного интеллекта, использующих персональные данные.

Закон ЕС об искусственном интеллекте Ключевые элементы управления:

-

Выявление систем с высоким уровнем риска: Классификация всех систем искусственного интеллекта в соответствии с Приложением III

-

Ручной контроль за выполнением:

-

Для систем с высоким уровнем риска требуется "человек в команде" или "человек в контуре".

-

Статья 14 требует, чтобы люди могли понимать, контролировать, вмешиваться и останавливать системы ИИ

-

-

Документация и регистрацияСистемы с высоким уровнем риска должны быть зарегистрированы в национальной "песочнице" регулирования ИИ (крайний срок - август 2026 года).

-

Карточки моделей и техническая документацияДокументация о возможностях модели, ограничениях, потенциальных рисках, источниках данных для обучения

-

Обязательства по обеспечению прозрачности: Раскрытие информации о существовании и логике принятия решений системами ИИ для пользователей и регулирующих органов

Критические средства контроля CCPA и CPRA:

-

Конфиденциальность потребителя: Поддержка шести прав - право знать, право на удаление, право на отказ, право на недискриминацию, право на исправление, право на ограничение

-

Ограничения на конфиденциальную информациюДля использования конфиденциальной информации, такой как номера социального страхования, финансовые счета, точные географические координаты и т. д., требуется явное согласие.

-

Прозрачность при автоматизированном принятии решений: Раскрытие калифорнийцам информации об инструментах искусственного интеллекта, используемых для аналитики

Правила SEC по кибербезопасности (для публичных компаний):

-

ежегодное раскрытие информации: раскрытие информации о процессах, стратегиях и управлении рисками кибербезопасности в форме 10-K

-

Раскрытие информации о происшествиях: Раскрытие информации о значительных инцидентах, связанных с кибербезопасностью, в форме 8-K (в течение 4 рабочих дней)

-

Риски, связанные с искусственным интеллектом: Стратегия кибербезопасности должна охватывать безопасность и управление системами искусственного интеллекта

Этап III: Оптимизация (10-12-й месяцы) - непрерывное совершенствование и автоматизация

Основные мероприятия:

-

Автоматизированная оценка рисков на основе искусственного интеллекта: Развертывание систем искусственного интеллекта для оценки рисков в режиме реального времени

-

Руководство по реагированию на инциденты AIПроцесс реагирования на отравление данных, перехват модели, внедрение подсказок

-

Приборная панель CSO:

-

Процент систем искусственного интеллекта с высокой степенью риска

-

Процент идентифицируемых персональных данных, включенных в модель

-

Среднее время обработки запроса на удаление

-

Время устранения уязвимостей в цепочке поставок

-

-

сезон (спорт)Безопасность ИИаудитыПроводится межфункциональным комитетом по управлению ИИ для оценки новых угроз, изменений в законодательстве, эффективности контроля.

V. Приоритеты и временные ряды

| Особенности системы | уровень риска | приоритет |

|---|---|---|

| Моделирование принятия решений в отраслях с ограниченным регулированием (финансы, здравоохранение) | очень высокий | Непосредственно (недели 1-2) |

| Модели обработки больших объемов персональных данных | очень высокий | прямо сейчас |

| Взаимодействие с клиентами/чатбот | середина | Краткосрочные (1-6 месяцев) |

| Модель оптимизации внутренних операций | опускать (голову) | Среднесрочная (6-12 месяцев) |

VI. Ключевые точки защиты для всего канала передачи данных

Точка наибольшего риска:

-

Сбор данных-Данные поставщика могли быть загрязнены

-

поезд-Массивное отравление является наиболее эффективным и трудно обнаруживаемым.

-

вывод-Модели взаимодействуют с пользователем, против которого наиболее вероятны атаки

VII. Основные действия ОГО

1: Заручиться поддержкой руководства

-

Брифинг для руководителей компаний и ИТ-директоров о нормативных рисках для безопасности данных ИИ (особенно о праве на забвение в соответствии с GDPR и Законом ЕС об ИИ)

-

Обеспечение бюджета и персонала, необходимых для соблюдения требований GDPR и EU AI Act

2: Оценка активов ИИ и рисков GDPR

-

Запуск общеорганизационного исследования систем искусственного интеллекта

-

Сканирование на предмет раскрытия персональных данных в системах искусственного интеллекта с помощью инструмента DSPM

-

Версии моделей аудита и возможности отслеживания данных обучения

3: Расстановка приоритетов и оценка соответствия

-

Категоризация систем искусственного интеллекта (риск GDPR, уровень риска EU AI Act)

-

Оценка эффективности запросов на удаление информации в соответствии с GDPR

-

Отбор 3-5 моделей с высоким уровнем риска в качестве пилотных

4: Разработайте 90-дневный план соблюдения требований

-

Разработка программы соответствия GDPR для пилотных моделей (включая техническую оценку забывания машин)

-

Разработка плана оценки рисков и документации по Закону ЕС об искусственном интеллекте

-

Выделение ресурсов для запуска первой фазы

резюме

Безопасность данных ИИ - это не технический, а стратегический вопрос, вопрос управления и соблюдения требований. Право на забвение, предусмотренное GDPR, требования к надзору за людьми, предусмотренные Законом ЕС об искусственном интеллекте, права потребителей, предусмотренные CCPA, и обязательства SEC по раскрытию информации - это не просто вопросы соблюдения требований, они отражают глубокую философию того, как системы ИИ должны относиться к людям и данным. Это не чисто "комплаенс" вопросы - они отражают глубокую философию регуляторов о том, как системы ИИ должны относиться к людям и данным.

Задача CSO - воплотить эту философию в практические методы и процессы. Систематически внедряя основы данного руководства, CSO смогут превратить безопасность данных ИИ из сложной проблемы в конкурентное преимущество. Те организации, которые возьмут на себя инициативу по созданию зрелой системы безопасности ИИ, не только смогут лучше защитить себя от новых угроз, но и получат признание рынка и регулирующих органов в качестве надежных и ответственных лидеров в области ИИ.

Приложение:

источник ссылки

Антропологические исследования отравления данных, 2025 год - "Небольшое количество образцов может отравить LLM любого размера"

SentinelOne AI Model Security Guide, 2025 - Риски обратного проектирования моделей и извлечения обучающих данных

BigID CSO Guide to AI Security, 2025 - классификация данных и проблемы безопасности ИИ

Мнение Европейского совета по защите данных 28/2024 + Leiden Law Blog, 2025 - Реализация права GDPR быть забытым в искусственном интеллекте

Cloud Security Alliance, 2025 - "Право быть забытым - но может ли ИИ забыть?".

Xygeni Supply Chain Security, 2025 - Эволюция SBOM и риски цепочки поставок в эпоху искусственного интеллекта

Tech GDPR, 2025 - "ИИ и GDPR: понимание основ соответствия".

GDPRLocal, 2025 - "Требования прозрачности ИИ: соблюдение и реализация"

Закон ЕС об искусственном интеллекте Статья 14 - "Человеческий надзор"

Калифорнийский закон о конфиденциальности потребителей (CCPA) + Калифорнийский закон о правах потребителей на конфиденциальность (CPRA)

Правила раскрытия информации о кибербезопасности SEC, 2023 - требования к формам 10-K и 8-K

Оригинальная статья написана Chief Security Officer, при воспроизведении просьба указывать: https://www.cncso.com/ru/cso-ai-data-security-guide.html.