CrowdStrike:3 лучших метода атаки на Intelligentsia: отравление инструментов, самозванство и "коверканье" угрожают предприятиям

В новом блоге компания CrowdStrike раскрывает три ключевых атаки на цепочку инструментов агента, которые угрожают безопасности ИИ-агентов: отравление инструментов, выдача себя за пользователя сервера и пост-интеграционный дрейф (атаки Rugpull). Эти атаки используют способность агента искусственного интеллекта активно выбирать и выполнять задания с помощью описаний, шаблонов и примеров на естественном языке, чтобы манипулировать языком, метаданными и контекстом, на основе которых агент принимает решения. Отравление инструментов вводит агентов в заблуждение, скрывая вредоносные инструкции в описаниях инструментов; имперсонация сервера крадет учетные данные, маскируясь под легитимный MCP-сервер; а атаки Rugpull бесшумно изменяют поведение инструментов после интеграции для осуществления эксфильтрации данных. CrowdStrike рекомендует предприятиям использовать несколько уровней защиты, таких как манифесты сигнатур, блокировка версий, двусторонняя TLS-аутентификация, проверка параметров и обнаружение аномалий, и выпустила программу Решение Falcon AI Detection and Response для борьбы с атаками ИИ.

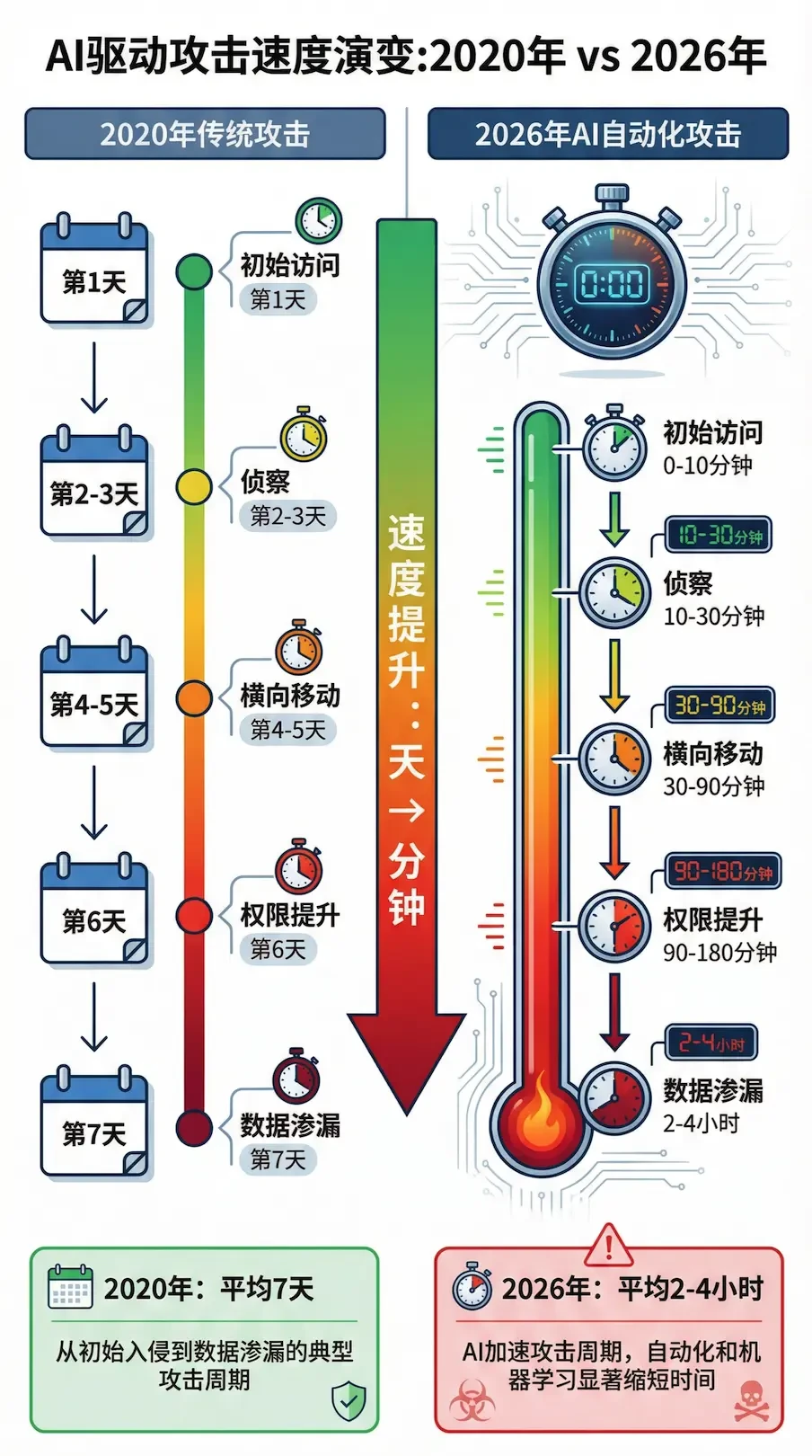

2026 Новая норма в кибербезопасности: ИИ автоматизирует цепочки атак, защита должна ускориться с дней до минут

В отчете Cybersecurity 2026: Responsible AI Defence, опубликованном компанией Forvis Mazars, говорится, что ИИ революционизировал темпы кибербезопасности: злоумышленники используют ИИ для автоматизации разведки, социальной инженерии и бокового перемещения, что позволяет сократить цикл атаки с нескольких дней до нескольких часов или даже минут. В отчете подчеркивается, что основной проблемой кибербезопасности в 2026 году станет скорость: атаки перейдут от кражи данных к операционному воздействию, что приведет к простою, репутационному ущербу и отвлечению сотрудников. Отчет рекомендует организациям принять стратегию "ответственной защиты от ИИ", которая включает развертывание многофакторной аутентификации (MFA), устойчивой к фишингу, внедрение технологий обнаружения и реагирования на угрозы идентификации (ITDR), использование платформ расширенного обнаружения и реагирования (XDR), а также создание многоуровневых неизменяемых резервных копий. Управление на первом месте, взаимодействие человека и компьютера, прозрачность и возможность аудита - вот три принципа защиты от ИИ.

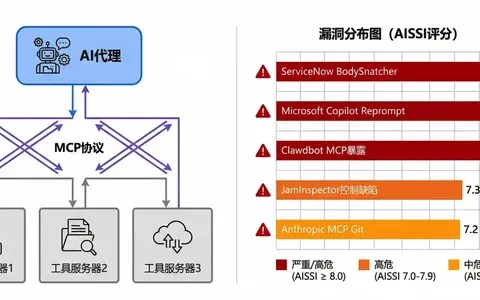

Рост числа инцидентов, связанных с безопасностью ИИ, в январе 2026 года: уязвимости MCP становятся главной угрозой для предприятий

Обзор инцидентов безопасности искусственного интеллекта за январь 2026 года, опубликованный исследовательской лабораторией PointGuard AI Research Labs, показывает значительное увеличение количества и серьезности инцидентов безопасности искусственного интеллекта в этом месяце, причем несколько инцидентов получили более 7,0 баллов по индексу серьезности безопасности искусственного интеллекта (AISSI). MCP, недостатки плоскости управления JamInspector и другие рискованные инциденты. Кроме того, уязвимость ServiceNow "BodySnatcher" (CVE-2025-12420) и атака Microsoft Copilot "Reprompt" получили высокие рейтинги риска - 8,7 и 8,3 соответственно. В отчете отмечается, что злоумышленники перешли от экспериментальных исследований к систематической эксплуатации рабочих процессов ИИ, что атаки cue injection продолжают развиваться, и что большинство рискованных инцидентов связано со слабостями цепочки инструментов и протоколов, а не самих моделей.

Risk Insight: Теневой ИИ детонирует в результате взлома данных личных счетов LLM

Последний отчет Cloud Threat Report показывает, что использование сотрудниками личных учетных записей для доступа к инструментам LLM, таким как ChatGPT, Google Gemini, Copilot и другим, стало одним из основных каналов утечки корпоративных данных, причем число нарушений политики обработки данных, связанных с genAI, составляет в среднем 223 в месяц, что вдвое больше, чем в прошлом году. Согласно отчету, количество советов, отправляемых приложениям генеративного ИИ в некоторых организациях, за год увеличилось в шесть раз, а на головном предприятии 1% ежемесячно отправляется более 1,4 миллиона советов, которые содержат очень конфиденциальные данные, такие как исходный код, текст контракта, информация о клиентах и даже учетные данные, которые после использования для обучения моделей или вторичной кражи представляют собой долгосрочные необратимые риски для соблюдения нормативных требований и интеллектуальной собственности. Общим для этого типа теневого ИИ является то, что он "невидим и неуправляем": команды безопасности, как правило, фокусируются на официальном доступе к большим моделям, игнорируя серые каналы браузеров, личных аккаунтов и мобильных устройств, а в будущем на него будут накладываться персонализированные объявления, основанные на контексте сессии, и сторонние плагины, что еще больше размоет границы данных. Предприятиям следует как можно скорее разработать политики использования genAI, нормы классификации и классификации, выявлять и блокировать трафик ИИ с помощью CASB/SASE, по умолчанию запретить персональный доступ к LLM для особо важных подразделений и внедрить корпоративную версию контролируемого LLM в качестве альтернативы, с поддержкой стратегий аудита и минимизации данных.

ChatGPT представляет разговорную рекламу: новые проблемы безопасности данных и соответствия нормативным требованиям, стоящие за моделями прибыли искусственного интеллекта

OpenAI объявила о тестировании внутрисессионной рекламы в бесплатной и Go-версиях ChatGPT. Это коммерческая реорганизация, которая также выдвигает на первый план "соответствие рекламе и безопасность данных". Представители компании подчеркнули, что не будут продавать данные о разговорах рекламодателям и что реклама не отделена от логики ответа, но не уточнили типы данных и пути обработки, используемые для персонализированного размещения, что является серой зоной, на которой должны сосредоточиться команды безопасности и соответствия. С технической точки зрения реклама в чате требует извлечения в реальном времени характеристик контекста разговора, сигналов интереса и профилей пользователей, а затем выбора "релевантного спонсируемого контента" с помощью моделей рекомендаций или сортировки, что требует установления минимального контроля сбора, десенсибилизации и ограничения использования в цепочке сбора логов, генерации характеристик, обучения моделей и вытеснения, иначе она легко превратится в "неявное рисование". Для этого необходимо установить минимальный контроль сбора, десенсибилизации и ограничения использования в процессе сбора журналов, генерации функций, обучения моделей и цепочки push, иначе это очень легко перерастет в "неявное профилирование + повторное использование за пределами границ". Для команд безопасности предприятий, с одной стороны, необходимо включить такие "разговорные объявления ИИ" в оценку рисков сторонних сервисов, проверить наличие межрегиональных потоков данных, красных линий регулирования (например, несовершеннолетние, политики блокировки рекламы на чувствительных сценах) и пробелов в аудите; с другой стороны, необходимо провести обратную проверку собственных внутренних помощников ИИ и роботов для обслуживания клиентов на предмет наличия такого же "заимствованного взаимодействия" и его наличия. С другой стороны, нам также следует присмотреться к своим собственным внутренним ИИ-помощникам и роботам для обслуживания клиентов, чтобы понять, нет ли в них того же импульса и закулисной логики "заимствования взаимодействия для создания рекламы/портретов". Можно предположить, что в будущем безопасность продуктов, созданных на основе больших моделей, расширится с чистого обсуждения "чрезмерного влияния моделей и оперативного введения" до "скрытых маркетинговых границ в человеко-машинном диалоге", и как разработать прозрачные и контролируемые механизмы управления рекламой и данными между устойчивой прибыльностью, доверием пользователей и нормативными требованиями становится ключевым вопросом для следующего поколения ИИ-ассистентов и роботов для обслуживания клиентов. Как разработать прозрачные и контролируемые механизмы управления рекламой и данными между устойчивой рентабельностью, доверием пользователей и нормативными требованиями становится ключевым предложением для следующего раунда практики безопасности ИИ.

Risk Insight: в 2026 году глобальная безопасность предприятий сместится в сторону уязвимостей ИИ

Отчет "Основные выводы":

В августе-октябре 2025 года ВЭФ (Всемирный экономический форум) провел анкетный опрос 800 корпоративных специалистов-практиков по всему миру, результаты которого будут опубликованы в январе 2026 года. Результаты опроса показали, что 94% руководителей считают ИИ наиболее значимым фактором изменения ландшафта кибербезопасности в 2026 году; 87% респондентов назвали уязвимости, связанные с ИИ, наиболее быстро растущим риском кибербезопасности. По сравнению с опросом 2025 года доля предприятий, оценивающих безопасность инструментов ИИ, значительно возросла - с 37% до 64%. С точки зрения наступления и защиты предприятия обеспокоены как использованием злоумышленниками ИИ для ускорения своих атак (обеспокоенность 72%), так и инвестированием в инструменты защиты от ИИ.

Три основных "подводных камня" безопасности ИИ:

ОГО выделили три наиболее значимых риска в порядке убывания:

(1) Нарушение конфиденциальности данных (30%) - учебные данные модели искусственного интеллекта отравлены или конфиденциальная информация извлечена в процессе вычисления;

(2) Расширение возможностей ИИ противника (28%) - злоумышленники используют ИИ для создания фишинговых писем, адаптивных вредоносных программ и ложных заключений;

(3) Техническая безопасность систем ИИ (15%) - специфические для ИИ уязвимости, такие как бэкдоры в моделях, обфускация привилегий и внедрение подсказок.

Тем временем предприятие 73% переходит от "защиты от вымогательства в первую очередь" в 2025 году к "защите от мошенничества и фишинга с помощью искусственного интеллекта" в 2026 году.

ИИ Intelligentsia Permission Explosion Problem:

CyberArk и другие поставщики систем безопасности сообщают о ключевой тенденции: нечеловеческие идентификаторы скоро станут вектором нарушений в облаке номер один. К 2026 году каждый искусственный интеллект будет представлять собой "личность", требующую учетных данных базы данных, токенов облачных сервисов, ключей репозиториев кода и т. д. По мере того как организации развертывают десятки или даже сотни ИИ-интеллектов, эти идентификаторы накапливают все больше привилегий, что делает их мишенью для злоумышленников. Новый вектор атаки oWASP "неправомерное использование инструмента" особенно опасен: злоумышленник может внедрить вредоносные данные через инжектор вредоносных данных, не изменяя командный префикс ИИ (системный запрос), но и не изменяя командный префикс ИИ. Новый вектор атаки "злоупотребление инструментами" в OWASP особенно опасен: злоумышленник может обманом заставить ИИ выполнить непредусмотренные вызовы API, повысить привилегии или украсть данные, не изменяя системный запрос ИИ.

Перспективные стратегии преодоления:

Внедрите управление идентификацией и доступом к ИИ (IAM): назначьте минимально необходимые разрешения для каждого ИИ-интеллекта, регулярно проверяйте его учетные данные и журналы вызовов API.

Разверните защиту от выражений и подсказок: добавьте обнаружение инъекций команд на уровень проверки ввода агента ИИ и поместите в карантин недоверенные внешние источники данных.

Создание системы доверия к цепочке поставок ИИ: проверка источников безопасности сторонних моделей ИИ, плагинов и источников данных для предотвращения развертывания моделей с "черным ходом".

Расширение SIEM с поддержкой ИИ: традиционный анализ журналов с трудом справляется с высоким уровнем автономности ИИ, поэтому требуется специальное обнаружение аномалий, связанных с поведением ИИ.

Формирование группы экстренного реагирования на угрозы безопасности ИИ: поскольку традиционным группам кибербезопасности не хватает опыта экстренного реагирования на угрозы, характерные для ИИ

Trend Insight:

2026 год станет поворотным пунктом от "защиты безопасности с помощью ИИ" к "систематизации управления безопасностью с помощью ИИ". Это уже не просто "использование ИИ для борьбы с вредоносным ИИ", а интеграция осознания рисков ИИ во все процессы управления идентификацией, управления привилегиями, журналами аудита, реагирования на чрезвычайные ситуации и так далее. Те предприятия, которые все еще застряли в "теории преимуществ ИИ" и игнорируют управление привилегиями, столкнутся с самой большой ценой.

Кибератаки с использованием искусственного интеллекта становятся новым трендом: прогнозирование образцов атак на 2025 год и 2026 год

Согласно отчетам службы безопасности, в четвертом квартале 2025 года появилось множество случаев кибератак с использованием автономных агентов искусственного интеллекта. Злоумышленники значительно расширили свою площадь атаки, автоматизировав сбор разведданных, латеральное перемещение и повышение привилегий с помощью таких интеллектов. Некоторые аналитики отмечают, что некоторые угрожающие субъекты национального уровня уже используют ИИ-агенты для выполнения 80%-90% этапов цепочки атак в реальных боевых действиях, причем скорость и скрытность превосходит скорость и скрытность традиционных человеческих хакерских команд. Эксперты прогнозируют, что по мере дальнейшего развития больших моделей и автоматизированных систем в 2026 году "автономные атаки ИИ" могут превратиться в новую основную угрозу, более разрушительную, чем традиционные выкупные программы и фишинг, особенно в отношении критической инфраструктуры и облачных сред.

Мошенничество с использованием искусственного интеллекта и утечки данных резко возрастут в 2026 году

Согласно последнему прогнозу Experian, искусственный интеллект станет одной из основных угроз кибербезопасности в 2026 году: только за первую половину 2025 года в мире произошло более 8000 утечек данных и было раскрыто около 345 миллионов записей. В то же время Experian и Fortune сообщают, что мошенничество с помощью ИИ продолжит стремительно расти в 2026 году: в предыдущем году убытки уже оценивались в 12,5 миллиарда долларов, а на финансовых, электронных и социальных платформах быстро распространятся глубокие подделки и умный фишинг. Согласно отчетам, инструменты искусственного интеллекта "демократизируют" возможности мошенничества, позволяя низкоквалифицированным злоумышленникам серийно генерировать высокореалистичные текстовые сообщения, голос и синтетическое видео, в результате чего традиционным правилам борьбы с мошенничеством становится сложно вовремя распознать эти новые модели атак.

Глобальная перспектива кибербезопасности на 2026 год: искусственный интеллект стал самым большим риском для роста числа атак кибербезопасности

В отчете Global Cybersecurity Outlook 2026 говорится, что 87% опрошенных организаций считают уязвимости, связанные с ИИ, самым быстрорастущим киберриском с 2025 года, и что ИИ укрепляет как наступательную, так и оборонительную стороны спектра. Согласно отчету, 77% организаций применяют ИИ в своих операциях по обеспечению безопасности для обнаружения фишинга, реагирования на аномальные вторжения и анализа поведения пользователей, однако утечки данных и неправомерное использование моделей являются одними из главных проблем руководителей. Доля организаций, активно оценивающих безопасность инструментов ИИ, увеличилась с 37% до 64% по сравнению с 2025 годом, что свидетельствует о том, что организации переходят от "слепого принятия ИИ" к "приоритетному управлению безопасностью".

BreachForums Темная паутина Форумы История базы данных Крупная утечка

С 2022 года BreachForums является одним из крупнейших и наиболее известных в мире форумов, посвященных утечкам данных и хакерским сделкам. Этот подпольный базар данных - не только площадка для демонстрации хакерами своих военных сундуков, но и точка отсчета многих крупных утечек данных и кампаний по выкупу.Первоначально основанный Конором Фитцпатриком (ID "pompompurin"), BreachForums был захвачен в 2023 году. ShinyHunters взял на себя управление. Позже он был отключен от сети в связи с MyBB 0day, и в то время были опубликованы некоторые заметки, подлинность которых неизвестна. В июне этого года Франция и США совместными усилиями арестовали ряд основных членов, включая ShinyHunters, Hollow, Noct и Depressed.

Основные детали инцидента

Источник утечки: предположительно от одного из пользователей оригинального форума BreachForums.

Содержимое утечки: zip-файл с именем breachforum.7z, содержащий:

Полный файл базы данных SQL: содержит основные данные, такие как регистрационная информация пользователя, учетные данные и т. д.

Пользовательский ключ PGP: может повлиять на безопасность зашифрованных сообщений.

Документ заявления: длинный, стилизованный, "поэтический" текст (.txt), содержание которого, как предполагается, может быть приукрашено ИИ или быть заявлением утечки.

Подлинность данных: данные были проверены на подлинность и актуальность существующими пользователями через временный адрес электронной почты, который они использовали в документе.

Скачано с сайта: https://shinyhunte[...] rs/breachforum.7z (Примечание: в целях безопасности ссылки были переведены в безобидный вид, пожалуйста, не переходите по ним напрямую).

Анализ данных об утечках (ранжирование почтовых доменов)

Статистический рейтинг зарегистрированных адресов электронной почты в утечке данных выглядит следующим образом, четко отражая предпочтения пользовательской базы форума, с очень высоким процентом частных и временных почтовых сервисов:

Ранг Доменное имя почтового ящика Число случаев Тип/функции службы

1 gmail.com 239 747 Обычные коммерческие почтовые ящики

2 proton.me 29 851 Почтовые ящики со сквозным шифрованием

3 protonmail.com 12 382 Почтовые ящики со сквозным шифрованием

4 onionmail.org 4,668 Анонимные зашифрованные почтовые ящики, специализирующиеся на сети Tor

5 cock.li 4,577 Служба хостинга электронной почты, подчеркивающая анонимность без проверки личности

6 yahoo.com 4,478 Основные коммерческие почтовые ящики

7 qq.com 3 290 Обычные коммерческие почтовые ящики

8 mozmail.com 2 395 Почтовый ящик для пересылки конфиденциальных данных, предоставляемый Firefox Relay

9 tutanota.com / tutamail.com 2 294 Почтовые ящики со сквозным шифрованием

10 dnmx.org 1,441 Анонимная почтовая служба

Анализ данных Интерпретация:

Высокая концентрация сервисов приватности: более половины из 10 лучших доменов (Proton, OnionMail, Cock.li, Mozilla Relay, Tuta) - это сервисы защиты приватности, ориентированные на анонимизацию, шифрование или пересылку. Это говорит о том, что пользователи BreachForums настроены крайне антиретроактивно и заботятся о конфиденциальности.

Предупреждение "Простор для маневра": Пользователи, говоря о "большом пространстве для маневра", могут иметь в виду, что злоумышленник может использовать механизмы регистрации этих личных почтовых ящиков (например, не требуя проверки номера мобильного телефона) для проведения корреляционного анализа, фишинга или запуска целевых атак на пользователей конкретных служб конфиденциальности.