CrowdStrike:Top 3-Angriffstechniken für Intelligentsia: Tool Poisoning, Impersonation und Rugpull bedrohen Unternehmen

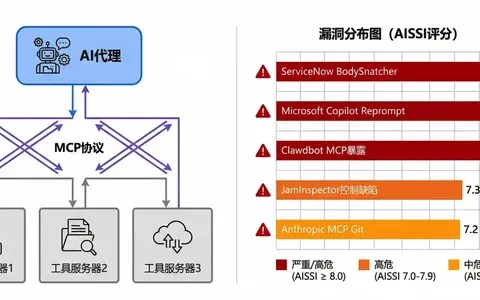

In einem neuen Blogbeitrag zeigt CrowdStrike drei wichtige "Agenten-Toolchain-Angriffe" auf, die die Sicherheit von KI-Agenten bedrohen: Tool Poisoning, Server-Impersonation und Post-Integration-Drift (Rugpull-Angriffe). Diese Angriffe nutzen die Fähigkeit des KI-Agenten aus, durch natürlichsprachliche Beschreibungen, Muster und Beispiele aktiv auszuwählen und auszuführen, um die Sprache, die Metadaten und den Kontext zu manipulieren, die die Entscheidungen des Agenten leiten. Tool Poisoning führt Agenten in die Irre, indem es bösartige Anweisungen in Tool-Beschreibungen versteckt; Server-Impersonation stiehlt Anmeldeinformationen, indem es sich als legitimer MCP-Server ausgibt; und Rugpull-Angriffe ändern das Tool-Verhalten nach der Integration stillschweigend, um eine Datenexfiltration zu implementieren.CrowdStrike empfiehlt Unternehmen den Einsatz mehrerer Schutzebenen wie Signaturmanifeste, Versionssperren, Zwei-Wege-TLS-Authentifizierung, Parametervalidierung und Anomalieerkennung und hat die Falcon AI Detection and Response-Lösung auf den Markt gebracht, um die Angriffsfläche für KI zu verringern.

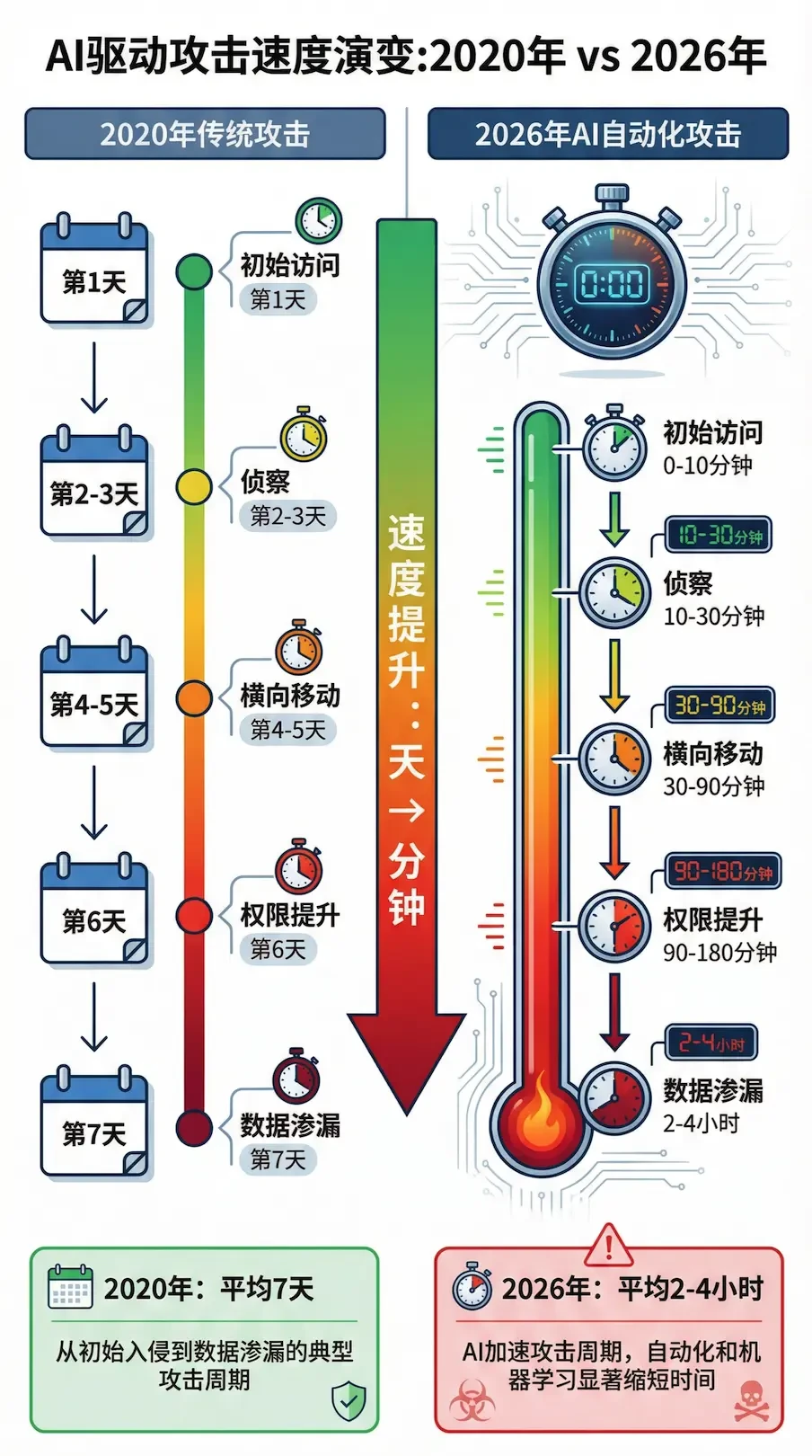

2026 Die neue Normalität in der Cybersicherheit: KI automatisiert Angriffsketten, die Verteidigung muss von Tagen auf Minuten beschleunigt werden

Der von Forvis Mazars veröffentlichte Bericht Cybersecurity 2026: Responsible AI Defence (Cybersicherheit 2026: Verantwortungsvolle KI-Verteidigung) stellt fest, dass KI das Tempo der Cybersicherheit revolutioniert hat, da Angreifer KI nutzen, um Aufklärung, Social Engineering und laterale Bewegungen zu automatisieren und den Angriffszyklus von Tagen auf Stunden oder sogar Minuten zu verkürzen. Der Bericht unterstreicht, dass die zentrale Herausforderung für die Cybersicherheit im Jahr 2026 in der Geschwindigkeit liegt, da die Angriffe vom Datendiebstahl bis zur Aushebelung des Betriebs übergehen und Ausfallzeiten, Rufschädigung und Ablenkung der Teams verursachen. Der Bericht empfiehlt Unternehmen eine verantwortungsvolle KI-Abwehrstrategie, die den Einsatz einer Phishing-resistenten Multi-Faktor-Authentifizierung (MFA), die Implementierung von Identity Threat Detection and Response (ITDR), die Einführung von Extended Detection and Response (XDR)-Plattformen und die Erstellung von mehrschichtigen, unveränderlichen Backups umfasst. Governance first, Zusammenarbeit zwischen Mensch und Computer sowie Transparenz und Überprüfbarkeit sind die drei Grundsätze der KI-Abwehr.

Anstieg von KI-Sicherheitsvorfällen im Januar 2026: MCP-Schwachstellen werden zur größten Bedrohung für Unternehmen

Der von den PointGuard AI Research Labs veröffentlichte Roundup zu KI-Sicherheitsvorfällen vom Januar 2026 zeigt einen deutlichen Anstieg der Anzahl und des Schweregrads von KI-Sicherheitsvorfällen in diesem Monat, wobei mehrere Vorfälle auf dem AI Security Severity Index (AISSI) einen Wert von über 7,0 erreichen. Exposition, JamInspector-Schwachstellen auf der Steuerungsebene und andere hochriskante Vorfälle. Darüber hinaus wurden die Sicherheitslücke "BodySnatcher" von ServiceNow (CVE-2025-12420) und der Angriff "Reprompt" von Microsoft Copilot mit 8,7 bzw. 8,3 hoch eingestuft. Der Bericht stellt fest, dass Angreifer von der experimentellen Erkundung zur systematischen Ausnutzung von KI-Workflows übergegangen sind, dass Cue-Injection-Angriffe immer noch weiterentwickelt werden und dass die meisten hochriskanten Vorfälle auf Schwächen der Toolchain und der Protokolle und nicht auf die Modelle selbst zurückzuführen sind.

Risk Insight: Schatten-KI löst Datenpanne bei persönlichen LLM-Konten aus

Der neueste Cloud Threat Report zeigt, dass Mitarbeiter ihre persönlichen Konten nutzen, um auf LLM-Tools wie ChatGPT, Google Gemini, Copilot und andere zuzugreifen, und dass dies zu einem der Hauptkanäle für Datenschutzverletzungen in Unternehmen geworden ist, wobei die Zahl der Datenschutzverletzungen im Zusammenhang mit generativer KI im Durchschnitt bei 223 pro Monat liegt, was eine Verdoppelung gegenüber dem Vorjahr bedeutet. Dem Bericht zufolge hat sich die Zahl der Hinweise, die in einigen Unternehmen an generative KI-Anwendungen gesendet werden, innerhalb eines Jahres versechsfacht, wobei das Unternehmen mit der Schlagzeile 1% mehr als 1,4 Millionen Hinweise pro Monat einreicht, die hochsensible Daten wie Quellcode, Vertragstexte, Kundeninformationen und sogar Zugangsdaten enthalten, die, sobald sie für das Modelltraining verwendet oder sekundär gestohlen werden, langfristige, irreversible Risiken für die Einhaltung von Vorschriften und das geistige Eigentum darstellen. Die Gemeinsamkeit dieser Art von Schatten-KI ist, dass sie "unsichtbar und unkontrollierbar" ist: Sicherheitsteams neigen dazu, sich nur auf den offiziellen Zugang zu den großen Modellen zu konzentrieren, während sie die grauen Kanäle von Browsern, persönlichen Konten und Mobiltelefonen ignorieren, und in Zukunft wird sie mit personalisierter Werbung überlagert werden, die auf dem Kontext der Sitzung und dem Plug-in-Ökosystem von Drittanbietern basiert, was die Grenzen der Daten weiter verwischen wird. Unternehmen sollten so bald wie möglich Richtlinien für die Nutzung von KI sowie Klassifizierungs- und Einstufungsnormen festlegen, den KI-Verkehr mit Hilfe von CASB/SASE identifizieren und blockieren, den persönlichen LLM-Zugang für hochsensible Abteilungen standardmäßig verbieten und als Alternative eine Unternehmensversion des kontrollierten LLM einführen, mit unterstützenden Audits und Strategien zur Datenminimierung.

ChatGPT stellt Conversational Advertising vor: Neue Herausforderungen für Datensicherheit und Compliance hinter KI-Gewinnmodellen

OpenAI hat angekündigt, dass es In-Session-Anzeigen sowohl in der kostenlosen als auch in der Go-Version von ChatGPT testen wird. Offizielle Stellen betonten, dass sie keine Konversationsdaten an Werbetreibende verkaufen werden und dass die Anzeigen nicht von der Antwortlogik getrennt sind, gaben aber nicht an, welche Arten von Daten und Verarbeitungspfaden für die personalisierte Platzierung verwendet werden, was die Grauzone ist, auf die sich Sicherheits- und Compliance-Teams konzentrieren müssen. Aus technischer Sicht erfordert Chat-Werbung die Extraktion von Merkmalen aus dem Gesprächskontext, Interessenssignalen und Nutzerprofilen in Echtzeit und die anschließende Auswahl "relevanter gesponserter Inhalte" durch Empfehlungs- oder Sortiermodelle, was die Einrichtung minimaler Erfassungs-, Desensibilisierungs- und Nutzungsbeschränkungskontrollen bei der Protokollerfassung, der Merkmalsgenerierung, dem Modelltraining und der Push-Kette erfordert, da sie sich sonst leicht zu "impliziter Malerei" entwickelt. Dies erfordert die Einrichtung minimaler Sammlungs-, Desensibilisierungs- und Verwendungsbeschränkungskontrollen in der Protokollsammlung, der Feature-Generierung, dem Modelltraining und der Push-Kette, da es sich sonst sehr leicht zu einem "impliziten Profiling + Wiederverwendung außerhalb der Grenzen" entwickeln kann. Für die Sicherheitsteams von Unternehmen ist es einerseits notwendig, solche "Conversational AI Ads" in die Risikobewertung von Drittanbieterdiensten einzubeziehen, um zu prüfen, ob es überregionale Datenflüsse, regulatorische rote Linien (wie Minderjährige, sensible Szene, Ad-Blocking-Policies) und Audit-Lücken gibt; andererseits ist es auch notwendig, die Prüfung der eigenen internen KI-Assistenten und Kundendienstroboter umzukehren, um zu sehen, ob es die gleiche "geborgte Interaktion" gibt und ob es die gleiche "geborgte Interaktion" gibt. Andererseits sollten wir auch unsere eigenen internen KI-Assistenten und Kundendienstroboter überprüfen, um festzustellen, ob es denselben Impuls und dieselbe Hinterzimmerlogik der "geliehenen Interaktion, um Werbung/Porträts zu machen" gibt. Es ist absehbar, dass sich die künftige Sicherheit großer Modellprodukte von der reinen Diskussion über "Model Overreach und Prompt Injection" auf "versteckte Marketinggrenzen im Mensch-Maschine-Dialog" ausweiten wird, und die Frage, wie transparente und kontrollierbare Werbe- und Data-Governance-Mechanismen zwischen nachhaltiger Rentabilität, Nutzervertrauen und regulatorischen Anforderungen gestaltet werden können, wird zu einem Schlüsselthema für die nächste Generation. Die Frage, wie transparente und kontrollierbare Werbe- und Datenverwaltungsmechanismen zwischen nachhaltiger Rentabilität, Nutzervertrauen und regulatorischen Anforderungen gestaltet werden können, wird zu einem Schlüsselthema für die nächste Runde der KI-Sicherheitspraktiken.

Risk Insight: 2026 verlagert sich der Fokus der globalen Unternehmenssicherheit auf KI-Schwachstellen

Bericht Kernaussagen:

Das WEF (Weltwirtschaftsforum) führte von August bis Oktober 2025 eine Fragebogenumfrage unter 800 Unternehmenspraktikern weltweit durch, deren Ergebnisse im Januar 2026 veröffentlicht werden. Die Umfrage ergab, dass 94% der Führungskräfte glauben, dass KI der wichtigste Treiber für Veränderungen in der Cybersicherheitslandschaft im Jahr 2026 ist; 87% der Befragten stuften KI-bezogene Schwachstellen als das am schnellsten wachsende Cybersicherheitsrisiko ein. Im Vergleich zur Umfrage von 2025 stieg der Prozentsatz der Unternehmen, die die Sicherheit von KI-Tools bewerten, drastisch von 37% auf 64%. Sowohl aus offensiver als auch aus defensiver Sicht sind die Unternehmen besorgt über Angreifer, die KI nutzen, um die Geschwindigkeit ihrer Angriffe zu beschleunigen (eine Sorge von 72%), und investieren auch in KI-Abwehrtools.

Drei zentrale Fallstricke der KI-Sicherheit:

Die 3 größten Risiken, die von den Organisationen der Zivilgesellschaft genannt wurden, waren in dieser Reihenfolge:

(1) Datenschutzverletzung und Gefährdung der Privatsphäre (30%) - KI-Modell-Trainingsdaten werden vergiftet oder sensible Informationen werden während der Inferenz extrahiert;

(2) Verbesserung der KI-Fähigkeiten von Angreifern (28%) - Böswillige Akteure nutzen KI, um Phishing-E-Mails, adaptive Malware und falsche Meinungen zu generieren;

(3) Technische Sicherheit von KI-Systemen (15%) - KI-spezifische Schwachstellen wie Backdoor-Modelle, Verschleierung von Privilegien und Prompt Injection.

In der Zwischenzeit hat sich das 73%-Unternehmen von "Ransomware-Abwehr zuerst" im Jahr 2025 auf "KI-gesteuerte Betrugs- und Phishing-Abwehr" im Jahr 2026 verlagert.

KI-Intelligenz Problem der Genehmigungsexplosion:

CyberArk und andere Sicherheitsanbieter berichten von einem wichtigen Trend: Nicht-menschliche Identitäten sind dabei, die Nummer eins unter den Cloud-Verstößen zu werden. Bis zum Jahr 2026 wird jede KI-Intelligenz eine "Identität" sein - sie benötigt Datenbankanmeldeinformationen, Cloud-Service-Token, Code-Repository-Schlüssel und mehr. Wenn Unternehmen Dutzende oder sogar Hunderte von KI-Intelligenzen einsetzen, sammeln diese Identitäten exponentiell mehr Privilegien an, was sie zu einem Ziel für Angreifer macht. Der neue Angriffsvektor "Tool-Missbrauch" von oWASP ist besonders gefährlich: Ein Angreifer kann bösartige Daten über einen bösartigen Dateninjektor einspeisen, ohne das Befehlspräfix der KI (System-Eingabeaufforderung) zu ändern, aber auch ohne das Befehlspräfix der KI zu ändern. Der neue OWASP-Angriffsvektor "Tool-Missbrauch" ist besonders gefährlich: Ein Angreifer kann die KI dazu bringen, unbeabsichtigte API-Aufrufe vorzunehmen, die Berechtigungen zu erhöhen oder Daten zu stehlen, ohne den System-Prompt der KI zu verändern.

Vorausschauende Bewältigungsstrategien:

Implementieren Sie eine KI-Identitäts- und Zugriffssteuerung (IAM): Weisen Sie jeder KI-Intelligenz die erforderlichen Mindestberechtigungen zu und überprüfen Sie regelmäßig ihre Anmeldedaten und API-Aufrufprotokolle.

Schutz von Ausdrücken und Hinweisen: Hinzufügen der Erkennung von Befehlsinjektionen zur Eingabevalidierungsschicht des KI-Agenten und Quarantäne nicht vertrauenswürdiger externer Datenquellen

Aufbau eines Vertrauenssystems für die KI-Lieferkette: Überprüfung der Sicherheitsquellen von KI-Modellen, Plug-ins und Datenquellen von Drittanbietern, um zu verhindern, dass Modelle mit Hintertüren eingesetzt werden

Erweiterung von KI-fähigem SIEM: Herkömmliche Log-Analysen haben Schwierigkeiten, mit dem hohen Maß an Autonomie von KI umzugehen, und erfordern eine spezielle KI-Erkennung von Verhaltensanomalien

Bildung eines KI-Sicherheits-Notfallteams: da herkömmlichen Cybersicherheitsteams die Erfahrung in der Notfallreaktion auf KI-spezifische Bedrohungen fehlt

Trend-Einblick:

Das Jahr 2026 wird der Wendepunkt von der "KI-gestützten Sicherheitsabwehr" zur "Systematisierung der KI-Sicherheitsgovernance" sein. Es geht nicht mehr nur darum, "KI zu nutzen, um bösartige KI zu bekämpfen", sondern KI-Risikobewusstsein in den gesamten Prozess des Identitätsmanagements, der Privilegienverwaltung, der Audit-Protokolle, der Notfallmaßnahmen usw. zu integrieren. Diejenigen Unternehmen, die immer noch in der "KI-Nutzentheorie" verharren und das Privilegienmanagement ignorieren, werden den höchsten Preis zahlen müssen.

KI-Cyber-Angriffe werden zu einem neuen Trend: Vorhersage von Angriffsbeispielen für das Jahr 2025 und Versuch mit KI-Sicherheitsrisiken für das Jahr 2026

Aus Sicherheitsberichten geht hervor, dass im vierten Quartal 2025 mehrere Fälle von Cyberangriffen mit autonomen KI-Agenten aufgetaucht sind, wobei die Angreifer ihre Angriffsfläche durch die Automatisierung der Informationsbeschaffung, der seitlichen Bewegungen und der Ausweitung der Rechte durch die Intelligenz erheblich vergrößert haben. Einige Analysen haben darauf hingewiesen, dass einige Bedrohungsakteure auf nationaler Ebene bereits KI-Agenten eingesetzt haben, um 80%-90% Schritte der Angriffskette im tatsächlichen Kampf auszuführen, und zwar mit einer Geschwindigkeit und Unauffälligkeit, die die herkömmlicher menschlicher Hacker-Teams übertreffen. Experten sagen voraus, dass sich "autonome KI-Angriffe" im Jahr 2026 zu einer neuen Mainstream-Bedrohung entwickeln könnten, die zerstörerischer als herkömmliche Ransomware und Spear-Phishing ist und insbesondere auf kritische Infrastrukturen und Cloud-Umgebungen abzielt, wenn große Modelle und automatisierte Frameworks weiter sinken.

KI-Betrug und Datenverletzungen werden 2026 stark zunehmen

KI wird im Jahr 2026 eine der größten Bedrohungen für die Cybersicherheit darstellen. Laut der jüngsten Prognose von Experian wurden allein in der ersten Hälfte des Jahres 2025 weltweit mehr als 8.000 Datenschutzverletzungen und rund 345 Millionen Datensätze offengelegt. Experian und Fortune berichten, dass KI-gesteuerter Betrug im Jahr 2026 weiter in die Höhe schießen wird, wobei die Verluste im Vorjahr bereits auf 12,5 Milliarden US-Dollar geschätzt wurden, und dass sich Deep Counterfeiting und Smart Phishing auf Finanz-, E-Commerce- und sozialen Plattformen rasch ausbreiten werden. Den Berichten zufolge "demokratisieren" KI-Tools die Betrugsmöglichkeiten und ermöglichen es wenig qualifizierten Angreifern, höchst realistische Textnachrichten, Sprach- und synthetische Videodateien im Stapel zu generieren, so dass es für herkömmliche Betrugsbekämpfungsregeln schwierig ist, diese neuen Angriffsmuster rechtzeitig zu erkennen.

Global Cybersecurity Outlook 2026: KI ist das größte Risiko für das Wachstum von Cybersecurity-Angriffen geworden

Der Bericht "Global Cybersecurity Outlook 2026" stellt fest, dass 87% der befragten Unternehmen Schwachstellen im Zusammenhang mit KI als das am schnellsten wachsende Cyber-Risiko seit 2025 betrachten und dass KI sowohl das offensive als auch das defensive Ende des Spektrums stärkt. Dem Bericht zufolge haben 77% der Unternehmen KI in ihren Sicherheitsabläufen für die Erkennung von Phishing, die Reaktion auf anomale Eindringlinge und die Analyse des Nutzerverhaltens eingesetzt, aber Datenschutzverletzungen und Modellmissbrauch gehören zu den größten Sorgen der Führungskräfte. Der Anteil der Unternehmen, die die Sicherheit von KI-Tools proaktiv bewerten, ist im Vergleich zu 2025 von 37% auf 64% gestiegen, was darauf hindeutet, dass sich die Unternehmen von einer "blinden Akzeptanz von KI" zu einer "Priorisierung der Security Governance" bewegen.

BreachForums Dark Web Foren Geschichte Datenbank Major Leak

Seit 2022 ist BreachForums eines der weltweit größten und berüchtigtsten Foren für Datenschutzverletzungen und Hacker-Deals. Dieser unterirdische Datenbasar ist nicht nur eine Bühne für Hacker, um ihre Kriegskassen zu präsentieren, sondern auch der Ausgangspunkt für viele große Datenschutzverletzungen und Lösegeldkampagnen. 2023 wurde BreachForums von Conor Fitzpatrick (ID "pompompurin") gegründet und von ShinyHunters übernahm den Betrieb. Später wurde es wegen des MyBB 0day offline genommen, und es wurden damals einige Notizen veröffentlicht, deren Authentizität unbekannt ist. Im Juni dieses Jahres arbeiteten Frankreich und die Vereinigten Staaten zusammen, um eine Reihe von Kernmitgliedern zu verhaften, darunter ShinyHunters, Hollow, Noct und Depressed.

Die wichtigsten Details des Vorfalls

Quelle des Lecks: Angeblich von einem Mitglied des ursprünglichen BreachForums.

Durchgesickerter Inhalt: eine Zip-Datei namens breachforum.7z, die Folgendes enthält:

Vollständige SQL-Datenbankdatei: enthält Kerndaten wie Benutzerregistrierungsinformationen, Anmeldedaten usw.

Benutzer-PGP-Schlüssel: kann die Sicherheit der verschlüsselten Kommunikation beeinträchtigen.

Statement-Dokument: ein langer, stilisierter, "poetischer" Text (.txt), dessen Inhalt möglicherweise mit KI-Verzierungen versehen ist oder eine Erklärung des Informanten darstellt.

Authentizität der Daten: Die Daten wurden von den bestehenden Nutzern anhand der von ihnen im Dokument verwendeten temporären E-Mail-Adresse als authentisch und aktuell verifiziert.

Heruntergeladen von: https://shinyhunte[...] rs/breachforum.7z (Hinweis: Die Links wurden aus Sicherheitsgründen unschädlich gemacht, bitte greifen Sie nicht direkt auf sie zu).

Analyse von Leakage-Daten (E-Mail-Domain-Ranking)

Die statistische Rangfolge der registrierten E-Mail-Adressen in den durchgesickerten Daten sieht wie folgt aus und spiegelt eindeutig die Vorlieben der Nutzer des Forums wider, mit einem sehr hohen Anteil an privaten und temporären E-Mail-Diensten:

Rang Mailbox Domänenname Anzahl der Vorkommen Dienstart/Funktionen

1 gmail.com 239.747 Kommerzielle Hauptpostfächer

2 proton.me 29.851 End-zu-End verschlüsselte private Postfächer

3 protonmail.com 12.382 End-zu-End verschlüsselte private Postfächer

4 onionmail.org 4.668 Anonyme verschlüsselte Mailboxen, spezialisiert auf das Tor-Netzwerk

5 cock.li 4,577 E-Mail-Hosting-Dienst mit Schwerpunkt auf Anonymität ohne persönliche Überprüfung

6 yahoo.com 4.478 Kommerzielle Postfächer der breiten Masse

7 qq.com 3.290 Kommerzielle Postfächer

8 mozmail.com 2.395 Weiterleitungspostfach für den Datenschutz, bereitgestellt von Firefox Relay

9 tutanota.com / tutamail.com 2.294 Ende-zu-Ende verschlüsselte private Postfächer

10 dnmx.org 1.441 Anonymer Postdienst

Datenanalyse Interpretation:

Hohe Konzentration von Diensten zum Schutz der Privatsphäre: mehr als die Hälfte der Top 10 Domains (Proton, OnionMail, Cock.li, Mozilla Relay, Tuta) sind Dienste zum Schutz der Privatsphäre, die sich auf Anonymisierung, Verschlüsselung oder Weiterleitung konzentrieren. Dies zeigt, dass die Nutzer von BreachForums extrem anti-retroaktiv und datenschutzbewusst sind.

Warnung vor "großem Handlungsspielraum": Wenn Nutzer von "großem Handlungsspielraum" sprechen, meinen sie damit möglicherweise die Tatsache, dass ein Angreifer die Registrierungsmechanismen dieser privaten Mailboxen (z. B. ohne Verifizierung der Mobiltelefonnummer) ausnutzen kann, um Korrelationsanalysen, Phishing oder gezielte Angriffe gegen Nutzer bestimmter Datenschutzdienste durchzuführen.