クラウドストライク:インテリジェンスへの攻撃手法トップ3:ツールポイズニング、なりすまし、ラグプルが企業を脅かす

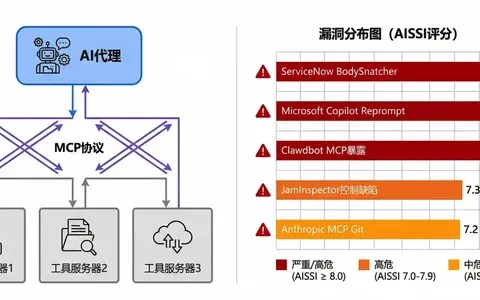

CrowdStrikeは新しいブログ投稿で、AIエージェントのセキュリティを脅かす3つの重要な「エージェントツールチェーン攻撃」、すなわちツールポイズニング、サーバなりすまし、統合後のドリフト(Rugpull攻撃)を明らかにした。これらの攻撃は、AIエージェントが自然言語の記述、パターン、例を通して能動的に選択し実行する能力を利用し、エージェントの決定を導く言語、メタデータ、コンテキストを操作します。ツールポイズニングは、ツールの説明文に悪意のある命令を隠すことでエージェントを欺き、サーバなりすましは、正当なMCPサーバになりすまして認証情報を盗み、ラグプル攻撃は、統合後にツールの動作を静かに変更してデータ流出を実行します。クラウドストライクは、企業に対し、シグネチャ・マニフェスト、バージョン・ロック、双方向TLS認証、パラメータ検証、異常検知などの多層防御の採用を推奨しています。

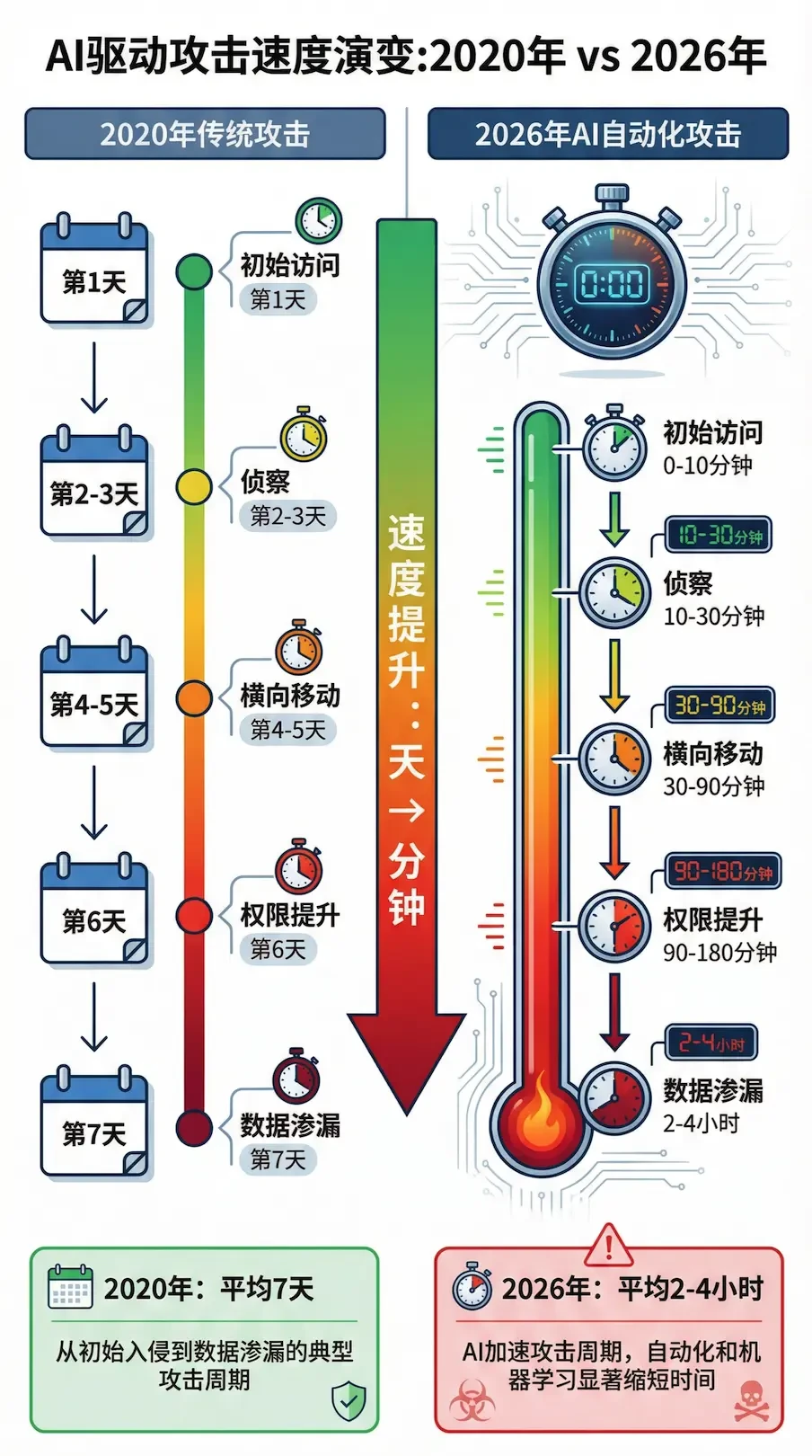

2026 サイバーセキュリティの新常識:AIが攻撃チェーンを自動化、防御は数日から数分へスピードアップが必要

Forvis Mazarsが発行した報告書「Cybersecurity 2026: Responsible AI Defence(サイバーセキュリティ2026:責任あるAI防衛)」によると、AIはサイバーセキュリティのペースに革命をもたらし、攻撃者はAIを活用して偵察、ソーシャルエンジニアリング、横の動きを自動化し、攻撃サイクルを数日から数時間、あるいは数分に圧縮しているという。報告書は、2026年のサイバーセキュリティの中心的な課題はスピードであり、攻撃はデータ窃盗から業務活用に移行し、ダウンタイム、風評被害、チームの注意散漫を引き起こすと強調している。フィッシングに強い多要素認証(MFA)の導入、Identity Threat Detection and Response(ITDR)の導入、Extended Detection and Response(XDR)プラットフォームの採用、レイヤー化された不変のバックアップの作成などを含む「責任あるAI防御」戦略を採用することを推奨している。ガバナンス・ファースト、人間とコンピューターのコラボレーション、透明性と監査可能性がAI防御の3原則である。

2026年1月、AIセキュリティインシデントが急増:MCPの脆弱性が企業の大きな脅威に

PointGuard AI Research Labsが発表した2026年1月のAIセキュリティ・インシデント・ラウンドアップによると、今月はAIセキュリティ・インシデントの件数と深刻度が大幅に増加し、AIセキュリティ深刻度指数(AISSI)で7.0を超えるインシデントが複数発生した。の暴露、JamInspector 制御プレーンの欠陥、その他の高リスクのインシデントが含まれる。さらに、ServiceNowの「BodySnatcher」脆弱性(CVE-2025-12420)とMicrosoft Copilotの「Reprompt」攻撃は、8.7と8.3の高いリスク評価を受けた。8.3という高いリスク評価を受けました。同レポートは、攻撃者が実験的な探索からAIワークフローの組織的な悪用に移行していること、キューインジェクション攻撃は依然として進化していること、高リスクインシデントの大半はモデルそのものではなくツールチェーンやプロトコルの弱点に起因していることを指摘している。

リスク洞察:シャドーAIが個人LLM口座データ流出を爆発させる

最新のCloud Threat Reportによると、従業員が個人アカウントを使ってChatGPT、Google Gemini、CopilotなどのLLMツールにアクセスすることが、企業のデータ漏えいの主なチャネルの1つになっており、genAI関連のデータポリシー違反は月平均223件と、昨年の2倍に増加している。 報告書によると、一部の組織でジェネレーティブAIアプリケーションに送信されるチップの数は1年間で6倍に増加しており、見出しの1%企業では毎月140万件以上のチップを送信している。これらのチップには、ソースコード、契約テキスト、顧客情報、さらには認証情報などの機密性の高いデータが含まれており、いったんモデルのトレーニングに使用されたり、二次的に盗まれたりすると、コンプライアンスや知的財産に長期的かつ不可逆的なリスクをもたらす。 この種のシャドーAIの共通点は、「目に見えず、管理できない」ことである。セキュリティチームは、ブラウザ、個人アカウント、モバイルといったグレーチャネルを無視する一方で、ビッグモデルへの公式アクセスに注目しがちであり、将来的には、セッションのコンテキストに基づくパーソナライズ広告やサードパーティのプラグインが重なり、データの境界がさらに曖昧になるだろう。 企業は、できるだけ早くgenAIの使用ポリシーと分類および等級基準を確立し、CASB/SASEの助けを借りてAIトラフィックを識別しブロックし、機密性の高い部門についてはデフォルトで個人LLMアクセスを禁止し、監査とデータ最小化戦略をサポートする代替手段として企業版管理LLMを導入すべきである。

ChatGPTが会話型広告を紹介:AI収益モデルの背後にあるデータセキュリティとコンプライアンスの新たな課題

OpenAIは、ChatGPTの無料版とGo版の両方でセッション内広告をテストしていると発表した。 関係者は、会話データを広告主に販売しないこと、広告が回答ロジックから切り離されていないことを強調したが、パーソナライズされた配置に使用されるデータの種類と処理経路については明らかにしなかった。 技術的な観点からは、チャット広告は、会話のコンテキスト、興味信号、ユーザープロファイルのリアルタイムな特徴抽出を必要とし、その後、レコメンデーションやソートモデルを通じて「関連性の高いスポンサー付きコンテンツ」を選択する。そのためには、ログ収集、特徴生成、モデルトレーニング、プッシュチェーンにおいて、最小限の収集、非感覚化、使用制限のコントロールを確立する必要があり、そうでなければ、容易に「暗黙のペインティング」に発展する。このため、ログの収集、機能の生成、モデルのトレーニング、およびプッシュ・チェーンにおいて、最小限の収集、減感作、および使用制限の制御を確立する必要があり、そうでなければ、「暗黙のプロファイリング+境界外の再使用」に非常に簡単に発展します。 企業のセキュリティチームにとっては、一方では、このような「会話型AI広告」をサードパーティサービスのリスクアセスメントに含め、クロスリージョンのデータフロー、規制のレッドライン(未成年者、センシティブシーンの広告ブロックポリシーなど)、監査ギャップがないかどうかをチェックすることが必要であり、他方では、自社内のAIアシスタントやカスタマーサービスロボットについても、同じような「借り物のインタラクション」がないかどうか、「借り物のインタラクション」がないかどうかを逆に検証することも必要である。他方、自社の社内AIアシスタントや接客ロボットにも、同じように「インタラクションを借りて広告・似顔絵を作る」という衝動や裏論理がないかどうか、目を向けるべきだろう。 今後の大型模型商品のセキュリティは、純粋に「模型の行き過ぎとプロンプト注入」を議論することから、「人間と機械の対話における隠れたマーケティングの境界線」へと拡大していくことが予見され、持続可能な収益性、ユーザーの信頼、規制要件の間で、いかに透明でコントロール可能な広告とデータガバナンスの仕組みを設計するかが、次世代の重要な課題となってきている。持続可能な収益性、ユーザーの信頼、規制要件の間で、透明で制御可能な広告とデータガバナンスの仕組みをどのように設計するかが、次のAIセキュリティ実践の重要な命題になりつつある。

リスクインサイト:2026年、世界の企業セキュリティの焦点はAIの脆弱性に移る

中核となる調査結果を報告する:

WEF(世界経済フォーラム)は2025年8月から10月にかけて、全世界の企業実務者800人を対象にアンケート調査を実施し、その結果を2026年1月に発表した。調査の結果、94%の経営幹部が、AIが2026年のサイバーセキュリティの状況を変化させる最も重要な原動力であると考えており、回答者の87%がAI関連の脆弱性を最も急成長しているサイバーセキュリティリスクに位置付けていることが明らかになった。2025年の調査と比較すると、AIツールのセキュリティを評価する企業の割合は37%から64%に劇的に増加した。攻撃と防御の観点から、企業は攻撃者がAIを使用して攻撃のスピードを加速させることを懸念しており(72%の懸念)、AI防御ツールにも投資している。

AIセキュリティの3つの核心的落とし穴

CSOが特に指摘したリスクのトップ3は、以下の順であった:

(1)データ漏洩とプライバシー侵害(30%) - AIモデルの学習データが汚染されたり、推論中に機密情報が抽出されたりする;

(2)敵対的AI能力の強化(28%)-悪意ある行為者はAIを使用して、フィッシングメール、適応型マルウェア、偽の意見を生成する;

(3) AIシステム技術セキュリティ(15%) - モデルバックドア、特権難読化、プロンプトインジェクションなどのAI特有の脆弱性。

一方、73%の企業は、2025年の「ランサムウェア防御第一」から、2026年の「AIを活用した詐欺とフィッシング防御」にシフトしている。

AIインテリジェンシアの許可爆発問題:

CyberArkと他のセキュリティベンダーは、重要な傾向を報告している。2026年までには、すべてのAIインテリジェンスが「ID」となり、データベース認証情報、クラウドサービス・トークン、コード・リポジトリ・キーなどを必要とするようになるだろう。oWASPの新しい「ツールの悪用」攻撃ベクトルは特に危険だ。攻撃者は、AIのコマンドプレフィックス(システムプロンプト)を変更することなく、悪意のあるデータインジェクタを通じて悪意のあるデータを注入することができる。OWASPの新しい「ツールの悪用」攻撃ベクトルは特に危険です。攻撃者はAIのシステムプロンプトを修正することなく、AIを騙して意図しないAPIコールをさせたり、特権を昇格させたり、データを盗んだりすることができます。

前向きな対処戦略:

AI Identity and Access Governance(IAM)の導入:各AIインテリジェンスに最低限必要な権限を割り当て、その資格情報とAPI呼び出しログを定期的に監査する。

AIエージェントの入力検証レイヤーにコマンドインジェクション検出機能を追加し、信頼できない外部データソースを隔離する。

AIサプライチェーンの信頼システムの確立:サードパーティのAIモデル、プラグイン、データソースのセキュリティソースを見直し、バックドアモデルの導入を防ぐ。

AI対応SIEMの拡張:従来のログ分析ではAIの高度な自律性に対応できず、専用のAI行動異常検知が必要だった

AIセキュリティ緊急対応チームの結成:従来のサイバーセキュリティチームはAI特有の脅威への緊急対応の経験が不足しているため

トレンドの洞察

2026年は、「AIによるセキュリティ防御」から「AIによるセキュリティガバナンスの体系化」への転換点になるだろう。単に「悪意のあるAIに対抗するためにAIを利用する」のではなく、ID管理、特権管理、監査ログ、緊急対応などのプロセス全体にAIリスク認識を統合することが求められるようになる。いまだに「AIメリット論」に囚われ、特権管理を無視している企業は、最大の代償に直面することになるだろう。

AIサイバー攻撃が新たなトレンドに:2025年第4四半期攻撃サンプル予測試行 2026年AIセキュリティリスク

セキュリティ・レポートによると、2025年第4四半期に自律型AIエージェントを利用したサイバー攻撃の事例が複数現れており、攻撃者はインテリジェンスによる情報収集、横の動き、権限の昇格を自動化することで、攻撃対象領域を大幅に拡大している。 一部の分析では、国家レベルの脅威行為者がすでにAIエージェントを使用して、実際の戦闘で攻撃チェーンの80%-90%ステップを実行しており、スピードと隠密性は従来の人間のハッカーチームを上回っていると指摘している。 専門家は、大規模なモデルと自動化されたフレームワークがさらに沈み込むにつれて、「自律型AI攻撃」は2026年に、特に重要なインフラやクラウド環境を標的とした、従来のランサムウェアやスピアフィッシングよりも破壊力のある新たな主流の脅威へと進化する可能性があると予測している。

2026年に急増するAI詐欺とデータ侵害

エクスペリアンの最新予測によると、AIは2026年にサイバーセキュリティの中核的脅威のひとつとなり、2025年上半期だけで全世界で8,000件以上のデータ漏えいと約3億4,500万件の記録が流出するという。 一方、エクスペリアンとフォーチュンは、AIを活用した詐欺は2026年も急増すると報告しており、前年の損失額はすでに125億ドルと見積もられているほか、金融、電子商取引、ソーシャル・プラットフォームでディープ・カウンセティングやスマート・フィッシングが急速に普及している。 報告書によると、AIツールは詐欺の能力を「民主化」しており、スキルの低い攻撃者が高度にリアルなテキストメッセージや音声、合成動画を一括生成することを可能にしているため、従来の詐欺対策ルールではこうした新たな攻撃パターンを時間内に認識することが難しくなっている。

世界のサイバーセキュリティ展望 2026年:AIがサイバーセキュリティ攻撃拡大の最大のリスクに

Global Cybersecurity Outlook 2026」報告書によると、調査対象となった組織のうち87%が、AI関連の脆弱性を2025年以降最も急成長しているサイバーリスクと考えており、AIは攻撃と防御の両面を強化しているという。 報告書によると、77%の組織がフィッシング検知、異常侵入対応、ユーザー行動分析などのセキュリティ業務にAIを導入しているが、データ漏洩やモデルの悪用は経営幹部の最大の懸念事項の一つとなっている。 AIツールのセキュリティを積極的に評価している組織の割合は、2025年と比較して37%から64%に増加しており、組織が「やみくもにAIを導入する」から「セキュリティ・ガバナンスを優先する」方向に移行していることを示唆している。

BreachForumsダークウェブ・フォーラムの履歴データベースが大規模流出

2022年以来、BreachForumsはデータ漏洩とハッキング取引のための世界最大かつ最も悪名高いフォーラムの1つとなっている。このアンダーグラウンドのデータバザールは、ハッカーたちが軍資金を誇示する舞台であるだけでなく、多くの大規模なデータ流出や身代金要求キャンペーンの発信地でもある。もともとはコナー・フィッツパトリック(ID "pompompurin")によって設立されたBreachForumsは、2023年、シャイニー・ハンターズ(ID "ShinyHunters")によって運営を引き継がれた。ShinyHuntersが運営を引き継いだ。その後、MyBB 0dayのためにオフラインになり、その際にいくつかのメモが公開されたが、その真偽は不明である。今年6月、フランスと米国が協力し、ShynyHunters、Hollow、Noct、Depressedを含む多くの中心メンバーを逮捕した。

事件の核心部分

リーク元:オリジナルのBreachForums内のメンバーからとされる。

流出したコンテンツ:breachforum.7zというzipファイル:

完全なSQLデータベースファイル:ユーザー登録情報、資格情報などのコアデータが含まれています。

ユーザーPGPキー:暗号化通信のセキュリティに影響を与える可能性がある。

声明文書:長い、様式化された、「詩的な」テキスト(.txt)で、その内容はAIによる装飾の可能性、あるいはリーカーの声明であることが示唆されている。

データの真正性:データは、既存のユーザーによって、彼らが文書で使用した一時的な電子メールアドレスを通じて、真正かつ最新のものであることが確認されている。

ダウンロード元:https://shinyhunte[...]rs/breachforum.7z(注:セキュリティ上の理由からリンクは無害化されています。)

漏洩データ分析(メールドメインランキング)

流出したデータにおける登録メールアドレスの統計的な順位は以下の通りで、明らかにフォーラムのユーザー層の好みを反映しており、私的なメールサービスや一時的なメールサービスの割合が非常に高い:

順位 メールボックス ドメイン名 回数 サービスタイプ/機能

1 gmail.com 239,747 商用メールボックスの主流

2 proton.me 29,851 エンド・ツー・エンドで暗号化されたプライバシー・メールボックス

3 protonmail.com 12,382 エンドツーエンドで暗号化されたプライバシーメールボックス

4 onionmail.org 4,668 Torネットワーク専門の匿名暗号化メールボックス

5 cock.li 4,577 個人認証なしの匿名性を重視したメールホスティングサービス

6 yahoo.com 4,478 商業用メールボックスの主流

7 qq.com 3,290 商業用メールボックスの主流

8 mozmail.com 2,395 Firefox Relayが提供するプライバシー転送メールボックス

9 tutanota.com / tutamail.com 2,294 エンドツーエンドで暗号化されたプライバシーメールボックス

10 dnmx.org 1,441 匿名メールサービス

データ分析の解釈:

プライバシー保護サービスの高い集中度:上位10ドメインの半分以上(Proton、OnionMail、Cock.li、Mozilla Relay、Tuta)は、匿名化、暗号化、転送に焦点を当てたプライバシー保護サービスです。このことは、BreachForumsのユーザーが極めて反体制的でプライバシーに敏感であることを示している。

"操作の余地 "に関する警告:ユーザーが "操作の余地が大きい "と言っているのは、攻撃者がこれらのプライベート・メールボックスの登録メカニズムを悪用して(例えば、携帯電話番号認証を必要としない)、相関分析やフィッシングを行ったり、特定のプライバシー・サービスのユーザーに対して標的型攻撃を仕掛けたりすることができるという事実を指しているのかもしれない。