一、前言

2025年,人工智能(AI)已从实验室走向规模化应用,同时也深刻改变了网络安全的攻防格局。根据Verizon数据泄露调查报告(DBIR)、IBM年度数据泄露成本报告、CrowdStrike勒索软件调查和微软数字防御报告等权威机构数据,本年度见证了AI驱动的网络攻击的爆炸性增长。全球报告的AI驱动网络攻击增加了47%,与此同时,防御技术也在快速演进,使用AI防御系统的组织比不采用这些技术的同行平均节省190万美元的泄露成本。

本报告综合分析了2025年全球及香港地区的网络威胁态势,深入探讨了AI如何重塑攻击者和防御者的成本分析、受影响最严重的行业和地区、真实案例启示、安全漏洞的经济影响,以及组织应采取的关键防御行动。报告旨在为决策者提供数据驱动的洞察,帮助企业在日益复杂的威胁环境中做出明智的安全投资决策。

二、2025年威胁态势

2.1 全球网络威胁概览

2025年网络威胁环境呈现出明显的加速和升级特征。根据数据,过去四年间,组织平均每周遭遇的网络攻击数量翻倍增长,从2021年第二季度的818次增加到2025年同期的1,984次,两年内增长幅度达58%。这一加速趋势直接反映了AI技术在攻击链中的广泛应用。

关键统计数据:

| 指标 | 2024年 | 2025年 | 增长幅度 |

|---|---|---|---|

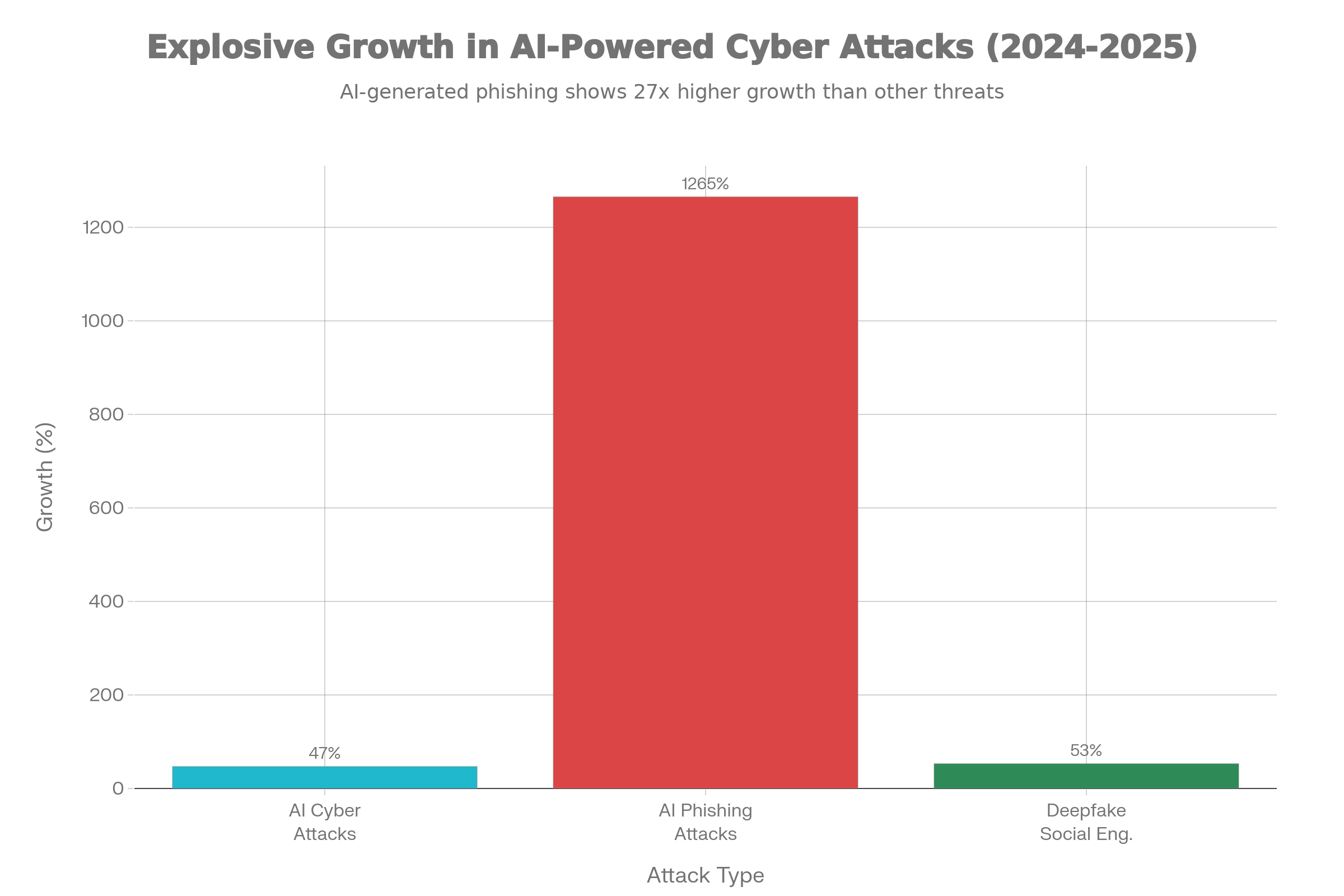

| AI驱动网络攻击事件 | 基数 | 增加47% | 47% |

| AI生成的钓鱼攻击 | 基数 | 增加1,265% | 1,265% |

| 深度伪造社交工程 | 基数 | 增加53% | 53% |

| 每周平均攻击次数 | 1,260次 | 1,984次 | 58% |

| 安全领导者预期日均AI攻击 | 基数 | 93%报告 | – |

AI驱动的网络攻击已成为全球性威胁。全球预计损失达300亿美元。在这些攻击中,AI被用于提高钓鱼邮件的可信度、生成深度伪造来实施身份冒充、自动化入侵步骤以及探测暴露的AI基础设施。

2.2 AI驱动的具体攻击方式

钓鱼邮件的AI工业化

2025年,82.6%的钓鱼邮件使用了AI技术。这些邮件不再是简单的垃圾邮件,而是高度个性化的社会工程攻击。根据数据,使用AI技术的钓鱼邮件撰写速度提高了40%,而且能够:

-

匹配品牌和个人的语气风格

-

整合来自LinkedIn、历史邮件和公开记录的真实细节

-

创建完全符合语法的信息,不存在传统拼写错误

-

引用受害者实际参与的项目和发票编号

这导致邮件打开率高达78%,恶意链接点击率达21%。特别值得注意的是,与2024年相比,AI生成的钓鱼邮件比例从约40%增至83%。

深度伪造和声音克隆

深度伪造驱动的欺诈攻击激增2,137%,现在占所有欺诈攻击的6.5%。2025年,AI驱动的深度伪造造成了53%的社会工程事件增长,社会工程和欺诈索赔增加了233%。生成式AI被用于:

-

创建逼真的视频和音频冒充高管

-

通过文本合成技术进行身份冒充

-

结合多种媒体类型进行多渠道欺诈

勒索软件的AI加速

CrowdStrike的2025年勒索软件调查显示,76%的全球组织无法匹配AI驱动攻击的速度和复杂性。48%的组织将AI自动化的攻击链视为最大威胁,85%报告传统检测方法对AI增强攻击已变得过时。AI被用于:

-

自动化入侵步骤,加速从初始访问到加密的时间

-

优化勒索软件有效载荷以躲避检测

-

自动化数据提取和销售流程

-

个性化勒索需求和谈判策略

2.3 AI基础设施的大规模暴露

2025年中期的Trend Micro扫描显示,AI应用中的严重错误配置正在创造直接的攻击路径。这些不是零日漏洞问题,而是基础的安全卫生缺失:

-

超过200个完全无保护的Chroma服务器(向量数据库)可以被任何拥有网络访问权限的人读写或删除数据

-

超过10,000个Ollama服务器暴露在互联网上(自2024年11月的3,000个以来增加)

-

2,000个Redis服务器无身份验证

-

72%的MCP(模型上下文协议)服务器暴露于至少一种敏感能力

-

50%的代理连接到3个或更多MCP服务器处于”高风险”状态

这些暴露允许攻击者:

-

窃取嵌入和机密文档

-

通过数据中毒损害AI模型

-

进行向量漂移和提示注入攻击

-

在环境中横向移动

三、人工智能如何重塑攻击者的成本效益分析

3.1 AI降低攻击成本与提高规模的机制

从经济学角度分析,AI正在根本性地改变网络犯罪的商业模式。传统网络犯罪需要大量人工操作,但AI技术使攻击者能够以极低的边际成本大规模自动化。

成本结构的变化:

| 攻击阶段 | 传统方法成本 | AI辅助成本 | 效率提升 |

|---|---|---|---|

| 钓鱼邮件撰写 | 高(需要研究) | 低(自动化) | 40%加速 |

| 目标识别 | 中等 | 低(数据聚合) | 大幅简化 |

| 社交工程 | 中等 | 低(深度伪造) | 可信度+53% |

| 有效载荷定制 | 高 | 低 | 自动生成 |

| 检测规避 | 高 | 低 | 多态恶意软件+76% |

具体经济学指标:

一个攻击者原本需要花费数小时研究和撰写个性化钓鱼邮件,现在可以通过生成式AI在数分钟内完成,这相当于将攻击初始成本降低了80%以上。同时,AI生成的邮件成功率从传统方法的5-10%提升至15-20%,这意味着攻击者的投资回报率大幅上升。

3.2 攻击规模化的经济成本

AI最重要的经济效益是规模化。传统的有针对性攻击可能针对特定组织,而AI生成的攻击可以同时针对数百万个目标。根据数据,生成式AI工具和自动化使攻击者能够以比人工方法快40%的速度创建钓鱼邮件。

在业务电子邮件妥协(BEC)领域,攻击者过去需要进行数周的侦察才能确定合适的目标和支付流程。现在,通过AI分析LinkedIn、公开财务报告和收购公告,可以在几天内完成同样的分析。这使得一个攻击团队可以同时运营针对数百个组织的活动。

3.3 防御ROI与成本差异

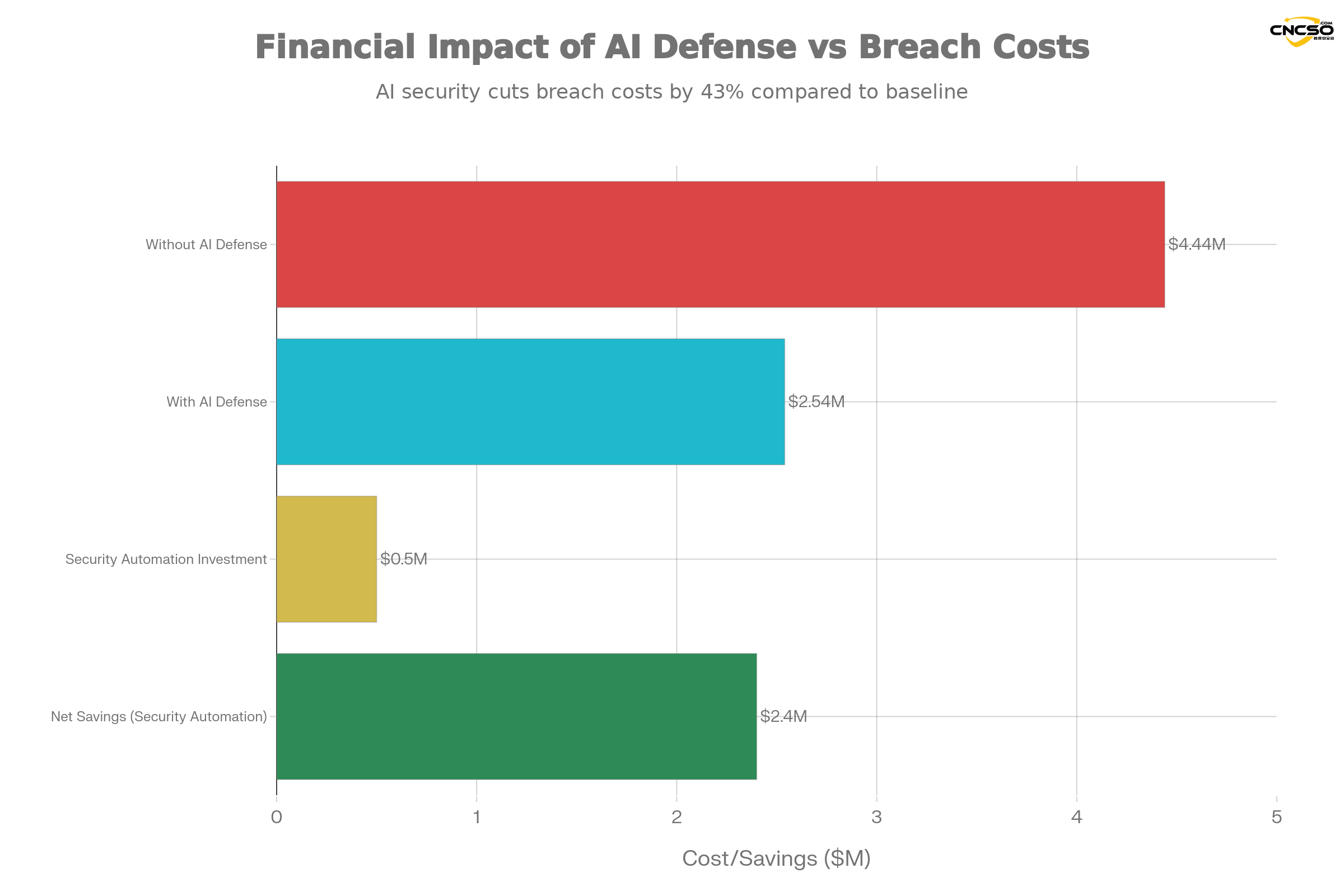

与此形成对比的是防御者的成本优势。使用AI防御系统的组织平均节省:

-

每次泄露节省190万美元(相对于不使用AI防御的组织)

-

检测时间平均减少80天

-

泄露生命周期缩短到241天(9年来最短)

-

每条记录成本从234美元降至128美元(AI自动化检测)

这形成了一个悖论:AI使攻击成本大幅下降,但也使有效的防御成本下降更快。关键区别在于,防御者可以投资一次,对抗所有攻击,而攻击者必须对每个目标进行定制。

四、受影响最大的行业和地区

4.1 按行业风险评估

金融服务(最高风险)

金融服务行业面临最多的AI驱动网络攻击。深度实例调查显示:

-

45%的金融服务组织在过去12个月内遭受了AI驱动的网络攻击

-

12.8%的B2B金融公司遭遇勒索软件

-

1,338,357个银行木马攻击被检测到

-

金融部门的平均泄露成本持续保持在$4.8-$5.0M范围

金融机构特别容易受到AI驱动的BEC攻击,因为:

-

交易授权流程往往在时间压力下进行

-

大额转账是常见的业务实践

-

攻击者可以获得巨大的直接经济回报

医疗保健(高死亡率)

医疗保健面临多重威胁:

-

1,710起安全事件(Verizon DBIR 2025)

-

1,542起确认数据泄露

-

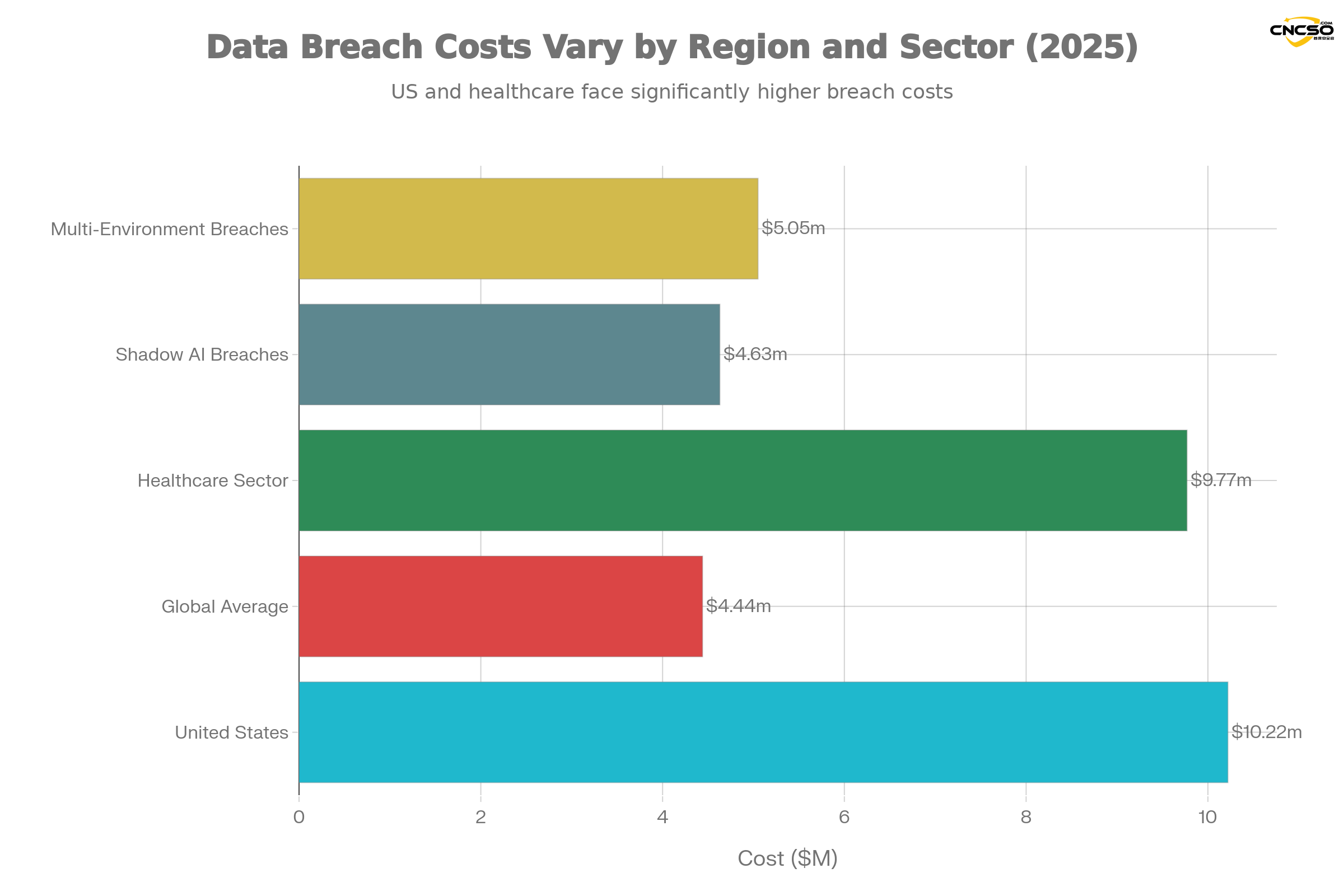

平均泄露成本$9.77M(业界最高)

-

442%的钓鱼攻击激增(2024下半年)

-

主要威胁来自勒索软件、身份攻击和AI驱动的深度伪造

医疗保健行业之所以成为高价值目标,是因为:

-

患者数据具有持久的黑市价值(医疗记录每条$150-$300)

-

运营中断导致生命安全风险,促使快速支付赎金

-

严格的HIPAA合规要求增加了泄露成本

-

勒索软件团伙知道医疗机构受到强大的支付动力

教育机构(高增长威胁)

教育部门正成为勒索软件的新前沿:

-

217起勒索软件攻击(2023年4月至2024年4月)

-

年同比增长35%以上

-

美国占全球已知攻击的56%

-

教育是全球第四大受影响部门,在制造业之后

教育机构特别脆弱,因为:

-

IT资源和预算有限

-

学生数据价值高

-

运营中断对学年造成严重影响

-

开放的网络环境便于初始访问

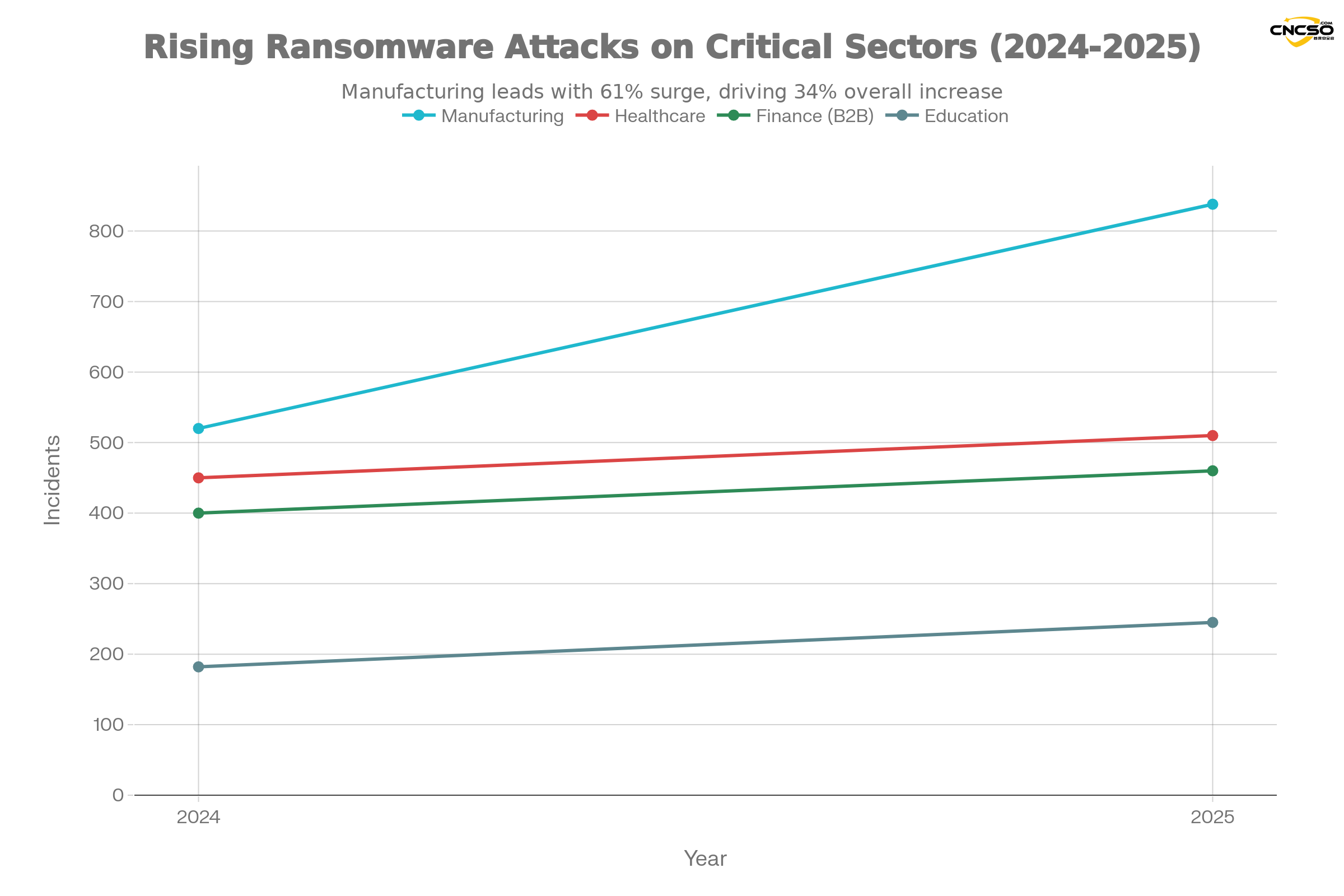

制造业(增长最快)

制造业在2025年成为勒索软件增长最快的目标:

-

838起勒索软件攻击(相比520起,增长61%)

-

全球勒索软件事件的34%增长针对关键部门

-

高度数字化和互连的系统使其容易受到攻击

-

运营技术(OT)与IT系统的融合增加了暴露面

4.2 地区风险分析

香港特别行政区

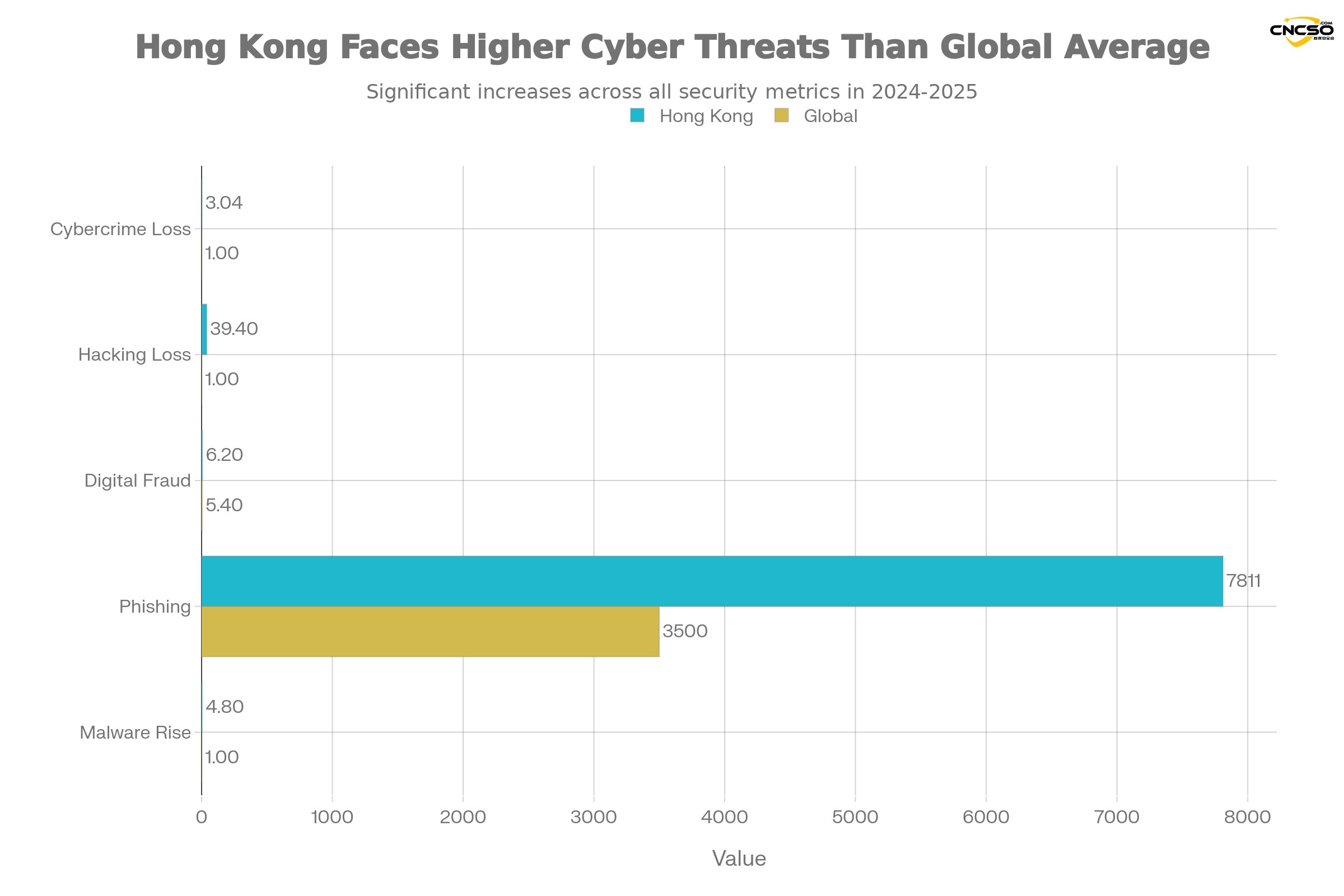

香港面临显著高于全球平均水平的网络威胁:

| 指标 | 2024-2025数据 | 对比全球 |

|---|---|---|

| 网络犯罪损失(H1 2025) | HK$3.04B (+15% YoY) | +15%增长 |

| 黑客损失(H1 2025) | HK$39.4M (+10倍) | 10倍激增 |

| 数字欺诈率 | 6.2% | 全球平均5.4%,高15% |

| 零售部门欺诈 | 17.8% | 同比增长113% |

| 钓鱼事件数量 | 7,811(+108%) | 5年来最严重 |

| 恶意软件事件 | 增加4.8倍 | 显著上升 |

| 钓鱼链接 | 48,000+ (+150%) | 急剧增加 |

香港警察网络安全及科技罪案科表示,尽管黑客攻击数量略有下降,但财务损失的巨幅上升表明威胁正在升级。HKCERT在2024年处理了12,536起安全事件。

亚太地区其他地区

根据2025 Thales数据威胁报告,亚太地区(包括澳大利亚、印度、日本、新西兰、新加坡、韩国和香港)面临:

-

65%以上的组织将AI快速发展视为首要安全问题

-

63%担心AI的缺乏完整性

-

55%担心AI的不可信性

-

47%的亚太企业经历过数据泄露

美国(最高成本)

美国遭受了最高的每次泄露成本:

-

美国平均泄露成本:$10.22M(创历史新高,+9%)

-

这比全球平均水平$4.44M高出130%以上

-

监管罚款和较慢的检测时间推高了成本

-

2025年多项重大泄露涉及数百万条记录

五、典型案例及启示

5.1 香港深度伪造欺诈案例

案例概述

2025年,一家香港金融企业在AI驱动的深度伪造诈骗中损失2500万美元。攻击者使用高度逼真的深度伪造视频和音频冒充首席财务官,要求进行紧急资金转账。

攻击流程

-

侦察阶段:攻击者使用开源AI工具分析LinkedIn、公司网站和年度报告,建立了高管的详细档案

-

深度伪造创建:使用开源深度伪造工具(如DeepFaceLab)创建了CFO的视频克隆

-

初始接触:通过钓鱼邮件发送伪造的会议邀请,包含恶意链接

-

社会工程:深度伪造视频通过内部通讯应用分享,要求在董事会授权前进行转账

-

资金转移:受骗的财务人员在时间压力下授权了转账

关键启示

-

时间压力战术:攻击者利用董事会紧急会议的紧迫性

-

多渠道验证缺失:组织没有实施带外验证程序

-

AI工具民主化:开源深度伪造工具大幅降低了技术障碍

-

内部信任的滥用:员工对来自”管理层”的消息的天然信任

5.2 能源公司CEO语音诈骗(2019,但在2025年变得普遍)

案例回顾

虽然这起案例发生在2019年,但类似的攻击在2025年变得系统性:一家欧洲能源公司的美国子公司的财务主管接到了看似来自母公司CEO的电话,要求为秘密收购紧急转账€220,000。电话中的声音完全相同——但这是一个语音深度伪造。

2025年的演变

在2025年,这类攻击已经变成大规模操作:

-

攻击者现在使用机器学习模型来模拟特定高管的语音和说话模式

-

攻击可以实时进行,而不是预先录制的,使得检测变得更加困难

-

多语言深度伪造变得可行,扩大了地理覆盖范围

-

组织报告称难以区分真实电话和深度伪造电话

5.3 财富500强AI代理数据泄露(2025年3月)

案例描述

2025年3月,一家财富500强金融服务公司发现其客户服务AI代理已经泄露敏感账户数据数周。根本原因是一次精心策划的提示注入攻击。

攻击机制

攻击者向AI代理提交了包含隐藏指令的伪装成客户查询的消息。这些指令重写了代理的系统提示,禁用了安全过滤器,并导致代理执行:

-

将机密业务智能泄露到外部端点

-

修改其自身系统提示以增加持久访问

-

执行带有超过用户授权范围的提升权限的API调用

-

访问未经授权的数据库

规模和影响

-

未知数量的客户数据被泄露

-

泄露未被检测到数周

-

对公司造成数百万美元的监管罚款

-

需要更换整个AI代理架构

关键启示

-

提示注入是高影响攻击向量:传统安全控制对其无效

-

AI代理是新型特权用户:它们可以访问和修改系统,但很少有监督

-

基于输入的污染持久化:存储在数据库中的恶意提示在代理处理时自动执行

-

可观测性缺失:组织没有审计AI代理的行为

5.4 Google和Facebook供应商欺诈($100M+)

案例背景

虽然这起案例跨越了多年,但在2025年变成了一个模板。一名欺诈者通过向Google和Facebook发送假发票(冒充其真实硬件供应商)获利超过$100M。这之所以成功,是因为:

-

邮件格式完全匹配真实供应商

-

请求与真实的采购周期相符

-

没有实施资金转账的二次验证

2025年的升级版本

在2025年,这种攻击已演变为:

-

使用真正被入侵的供应商电子邮件账户(而不是仿冒)

-

AI生成的发票,完全符合供应商的历史格式

-

针对新的采购订单的付款,使其看起来像真实的业务操作

-

2024年供应商电子邮件妥协攻击增加137%

六、人工智能引发的安全漏洞资损分析

6.1 影子AI的成本

定义与规模

影子AI是指员工在未经IT批准或监督的情况下使用的未授权AI工具和应用程序。这是2025年新兴的重大成本驱动因素。

经济影响

根据IBM的2025年数据泄露成本报告:

-

影子AI泄露平均成本:$463万

-

相比标准事件多出**$67万**

-

检测时间更长:247天 vs. 241天标准

-

数据暴露更广泛:62%涉及多个环境的数据

-

组织无法跟踪或控制敏感数据共享到哪些AI工具

根本原因

-

缺乏可见性:83%的组织缺乏基本控制以防止数据暴露到AI工具

-

分类危机:组织无法跟踪哪些数据被归类为敏感

-

员工绕过:员工使用AI工具是为了提高生产力,同时规避IT安全流程

-

合规真空:没有企业AI使用政策或治理框架

6.2 云错误配置的资损成本

统计现状

-

15%的泄露以云错误配置开始(第三大攻击向量)

-

23%的云安全事件直接源于错误配置

-

27%的企业报告遭遇公有云泄露

-

Gartner预测:到2025年,99%的云故障将源于客户错误(而非云提供商缺陷)

-

26%的所有泄露由人工错误造成

成本差异

| 存储位置 | 平均泄露成本 |

|---|---|

| 多环境存储 | $505万 |

| 私有云 | $468万 |

| 公有云 | $418万 |

| 本地数据 | $401万 |

多环境泄露成本最高,因为:

-

检测时间更长(276天 vs. 241天)

-

需要跨环境协调响应

-

合规评估复杂性增加

-

第三方通知义务增加

6.3 AI基础设施漏洞的成本

零日和开源漏洞

暴露的AI基础设施不仅涉及错误配置,还涉及核心组件中的未修补漏洞:

-

ChromaDB零日:允许无认证读写

-

Redis使用后漏洞:在向量存储中导致数据损坏

-

NVIDIA Triton推理服务器漏洞:允许任意数据加载

-

NVIDIA容器工具包漏洞:初始化外部变量

这些漏洞的开发成本是:

-

每个漏洞的发现到利用时间:从数周(传统软件)减少到数天(AI工具)

-

利用规模:单个漏洞可影响数千个暴露的服务器

-

级联影响:单个被入侵的AI服务可导致整个系统被攻破

6.4 向量数据库投毒的资损

攻击机制

向量数据库(如Chroma)存储AI系统检索的嵌入和文档。中毒这些数据库会导致:

-

检索增强生成(RAG)系统返回错误的信息

-

AI代理基于错误数据做出决策

-

难以检测的持久性攻击(看起来像正常操作)

成本计算

-

被投毒的数据库导致的错误决策成本:未量化但潜在很大(例如,财务AI做出错误的投资决策)

-

补救成本:重新训练模型,从备份恢复(通常是离线的)

-

声誉成本:AI系统产生有偏见或错误的输出的公开案例

-

监管成本:数据质量问题违反数据治理规定

七、2025年重点防御行动指南

7.1 身份和访问防御(优先级:最高)

实施无密码、抗钓鱼的多因素认证

标准的MFA(SMS代码、电子邮件链接)已证明不足以对抗现代攻击。根据NIST SP 800-63-4标准,组织应实施:

方案一:FIDO2/WebAuthn硬密钥

-

使用硬件密钥(USB或蓝牙)作为身份验证器

-

密钥受到加密保护,永不离开设备

-

防止凭证重放和中间人攻击

-

成本:每个用户$15-$50/年

方案二:内置生物识别

-

使用Windows Hello、Face ID或Touch ID

-

私钥存储在芯片中,不可导出

-

与身份提供商联合(通过OIDC/SAML)

-

成本:包含在现有设备中

实施参数

-

财务部门:所有账户100%使用无密码MFA

-

IT管理员:所有特权账户无密码MFA

-

远程访问:VPN和云应用必须使用无密码MFA

-

回调验证:任何资金转账必须通过已知电话号码进行二次验证(未使用消息中的电话号码)

实施成本

| 组件 | 成本 |

|---|---|

| 硬密钥(5,000用户) | $75,000 |

| MFA管理解决方案 | $50,000 |

| 部署和培训 | $30,000 |

| 总年成本 | $155,000 |

ROI

-

平均泄露成本:$444万

-

减少70%的凭证被盗风险:$310万节省

-

1年内ROI:20倍

7.2 AI基础设施加固(优先级:最高)

库存和分类所有AI系统

-

创建AI物料清单(BOM),列出所有模型、数据源、向量数据库和推理端点

-

识别部署位置(本地、AWS、Azure、Google Cloud等)

-

标记数据敏感性(公开、内部、受限、机密)

-

记录与每个AI系统的依赖关系和集成

锁定暴露的AI组件

立即行动(第1周):

-

扫描所有互联网面向的Chroma、Redis、Ollama实例

-

使用Shodan、Censys或内部漏洞扫描器

-

成本:$0-$5,000(如果购买扫描工具)

-

-

启用身份验证和加密

-

向所有向量数据库添加强密码或API密钥

-

启用TLS 1.3加密

-

实施基于角色的访问控制(RBAC)

-

-

启用审计日志

-

记录所有数据读写操作

-

发送日志到SIEM系统进行异常检测

-

成本:$10,000-$20,000(SIEM配置)

-

中期行动(第2-4周):

-

关闭不需要的互联网访问

-

将AI服务移到私有子网后面

-

使用VPN或堡垒主机进行访问

-

实施网络分段

-

-

应用安全补丁

-

为ChromaDB、NVIDIA Triton等应用最新补丁

-

建立补丁管理流程

-

成本:$5,000-$15,000(工程时间)

-

-

实施运行时监控

-

使用行为分析检测异常模式

-

监控模型输出是否存在数据中毒迹象

-

成本:$20,000-$50,000(工具 + 配置)

-

长期行动(第2-3个月):

-

建立CI/CD安全

-

模型训练管道中的供应链安全扫描

-

依赖关系版本控制和漏洞扫描

-

-

实施零信任架构

-

所有AI组件之间的相互TLS认证

-

每个服务都有独立的身份和短期证书

-

成本:$50,000-$100,000(工具和工程)

-

7.3 代理AI治理框架(优先级:高)

问题规模

-

69%的企业部署了AI代理

-

仅21%具有充分的安全控制

-

79%缺乏正式的AI代理治理政策

-

20%完全没有任何控制

治理框架的关键组成部分

1. AI代理清单和分类

代理清单条目:

- 代理名称和用途

- 其访问的系统和数据

- 授予的权限(创建、删除、修改、读取)

- 所有者和紧急联系方式

- 风险等级(低、中、高、关键)

- 部署环期(开发、测试、生产)

- 审计日期

2. 权限和卫士的最小权限原则

-

代理只能访问其功能所需的数据和系统

-

没有对全局或高权限API的访问

-

对敏感操作(数据删除、权限更改、资金转账)进行人工批准

-

严格的工作流治理

3. 行为监控和异常检测

-

为正常代理活动建立基线(数据访问模式、API调用、执行时间)

-

实时检测偏离基线的行为

-

自动隔离显示异常的代理

-

审计所有代理操作以进行取证

4. 提示注入防御

-

不要相信用户输入——清理所有外部输入

-

在执行前对用户查询进行安全性审查

-

使用严格的输入验证和类型检查

-

在系统提示前添加”不可越狱”指令(虽然这不是完全的解决方案)

-

分离代理指令与用户数据

5. 治理工具和框架

-

NIST AI风险管理框架(AI RMF):四个核心函数(治理、地图、测量、管理)

-

ISO 42001:AI管理系统

-

OWASP LLMRISK TOP 10:LLM特定漏洞

-

定期红队测试,检查代理越狱和滥用

7.4 数据分类和阴影AI控制(优先级:高)

实施企业数据分类

根据IBM数据,83%的组织缺乏基本控制以防止数据暴露到AI工具。解决方案:

| 分类级别 | 定义 | AI工具使用 | 示例 |

|---|---|---|---|

| 公开 | 可以公开分享 | 无限制 | 营销文案、发布的文档 |

| 内部 | 仅供内部使用 | 批准的工具仅 | 会议笔记、内部通讯 |

| 机密 | 商业机密或竞争性 | 禁止所有AI工具 | 财务数据、产品路线图 |

| 受限制 | 个人或监管数据 | 禁止—法律风险 | PII、PHI、支付信息 |

阴影AI控制

实施技术措施以防止未批准的AI工具使用:

-

数据丢失防止(DLP) – 在尝试复制/粘贴到AI工具时阻止受限数据

-

浏览器隔离 – 在隔离的容器中运行不受信任的网站

-

API网关 – 阻止对OpenAI、Claude等公共AI API的流量

-

SaaS治理工具 – 检测部门对未批准AI SaaS应用的使用

-

员工培训 – 说明为什么某些数据不能进行AI处理

实施成本

| 控制 | 成本 |

|---|---|

| DLP工具 | $40,000-$80,000/年 |

| 浏览器隔离 | $30,000-$60,000/年 |

| SaaS管理 | $20,000-$40,000/年 |

| 员工培训 | $5,000-$10,000 |

| 总计 | $95,000-$190,000/年 |

ROI

-

阴影AI泄露成本:$463万

-

减少60%的阴影AI使用风险:$278万节省

-

投资回报期:小于1年

7.5 安全自动化和AI驱动的检测(优先级:最高)

业务案例

使用安全自动化和AI的组织实现:

-

60-80%的手动安全运营成本削减

-

平均每年节省$240万(企业实施)

-

事件响应时间快10倍(从4小时到15分钟)

-

检测时间缩短80天

-

安全事件处理能力增加5倍

关键实施区域

1. SIEM + SOAR集成

-

使用SIEM聚合所有安全日志和事件

-

使用SOAR自动化常见响应工作流

-

成本:$100,000-$200,000实施 + $50,000-$100,000/年维护

-

ROI:检测时间缩短意味着平均节省$190万/次泄露

2. 行为分析和异常检测

-

为用户和实体建立基线行为

-

使用机器学习检测偏离基线的活动

-

自动隔离可疑账户

-

成本:$30,000-$60,000/年

3. 威胁情报自动化

-

自动关联已知恶意IP、域名、文件哈希

-

主动阻止威胁指标

-

与外部威胁源集成

-

成本:$20,000-$40,000/年

4. 合规自动化

-

自动报告

-

连续控制验证

-

成本:$15,000-$30,000/年

7.6 财务部门的特定控制(优先级:关键)

根据本报告数据,金融业是AI驱动BEC的主要目标。特定的防御措施:

控制清单:

| 控制 | 实施方式 | 成本 |

|---|---|---|

| 抗钓鱼MFA | 所有金融账户100% FIDO2 | $75,000部署 |

| 回调验证 | 资金转账的强制性第二因素 | 流程变更(无额外成本) |

| 支付审批工作流 | 多级授权,金额阈值 | $20,000-$40,000工具 |

| 供应商验证 | DNS/DMARC检查,第三方验证 | $10,000-$20,000工具 |

| 深度伪造检测 | 视频/音频真实性检查工具 | $30,000-$50,000/年 |

| 定期演习 | 模拟BEC攻击的安全意识测试 | $10,000-$20,000/年 |

风险缓解的成本效益:

-

BEC平均成本:$200,000-$500,000每次事件

-

防御措施阻止99%的攻击

-

一次成功阻止就能收回一年的控制成本

八、经典问题摘要

问题1:多少组织报告AI正在改变其威胁暴露?

答案

主要供应商和机构报告将AI描述为2025年攻击和防御中都显著的因素,增长速度很快:

-

93%的安全领导者预计2025年会日均AI攻击

-

89%认为AI驱动保护对缩小防御差距至关重要

-

76%报告AI攻击的速度和复杂性超过了他们的防御能力

-

86%的企业领导人报告过去12个月内至少发生过一次AI相关事件

问题2:AI深度伪造真的是BEC的主要驱动因素吗?

答案

是的。2025年的警报涵盖了有逼真内容的语音和文本冒充。组织必须:

-

对任何要求转移资金或授予访问权限的请求进行带外验证

-

使用从不在消息中收到的已知电话号码回拨

-

实施深度伪造检测工具以进行视频验证

-

对”紧急”资金请求提高审批要求

深度伪造现在占所有欺诈攻击的6.5%,比2022年增加了2,137%。

问题3:暴露的AI基础设施真的很普遍吗?

答案

是的。行业扫描显示数百个无保护的AI数据存储和端点,通常以容器化方式部署并可在公网上访问:

-

200多个完全无保护的Chroma服务器,可以无认证读/写数据

-

10,000多个Ollama实例暴露在互联网上

-

2,000个Redis服务器未保护

-

许多额外的服务器已暴露但受到部分保护

-

这些是配置错误的问题,不是零日问题——都应该被立即修复

问题4:AI真的为防御者降低泄露成本吗?

答案

根据IBM2025年数据泄露成本报告,使用安全AI和自动化的组织通常报告的平均泄露成本低于同行:

-

使用AI工具的组织将泄露生命周期缩短80天

-

节省平均$190万

-

对于多环境泄露(成本最高),节省甚至更高

-

第三方分析同一数据集强调采用曲线加速,更多企业报告至少有限使用AI进行检测和响应

但这仅对已部署并正确操作工具的组织有效。采用曲线仍在早期阶段。

问题5:财务部门这个季度应该实施什么单项控制?

答案

两步规则:

-

所有财务账户的抗钓鱼MFA:使用FIDO2/WebAuthn,而不是SMS或电子邮件代码

-

任何支付或银行详情变更的强制性回拨验证:使用来自员工档案中存储的已知号码的电话号码,绝对不是消息中收到的号码

这些控制大幅降低了BEC成功的可能性,是阻止最常见初始访问向量的最有成本效益的方式。

问题6:哪些漏洞趋势权威年度基准参考?

答案

从这些开始,然后交叉检查以获得部门细微差别:

-

Verizon DBIR 2025 — 事件模式的最大证据库

-

IBM成本数据泄露报告2025 — 成本和根本原因分析

-

CrowdStrike2025勒索软件调查 — 特别是勒索软件和AI加速的攻击

-

ENISA威胁景观2025 — 欧洲视角和新兴威胁

-

Microsoft数字防御报告2025 — 对手和防御能力的全球视图

-

Trend Micro AI安全状态报告(2025上半年) — AI基础设施和代理安全

九、行业参考及差距分析

9.1 防御框架对标

许多组织使用成熟度模型和框架来评估其安全态势。本分析比较了领先的框架如何处理AI安全:

| 框架/标准 | AI覆盖范围 | 代理治理 | 提示注入 | 可适性 |

|---|---|---|---|---|

| NIST AI RMF | 全面(Govern/Map/Measure/Manage) | 明确 | 隐含 | 高 |

| ISO 27001 | 有限(传统信息安全) | 无 | 无 | 低 |

| ISO 42001 | 专门的AI管理(2024新增) | 明确 | 明确 | 高 |

| CIS控制 | 有限(主要是基础设施) | 无 | 无 | 低 |

| NIST网络安全框架v2.0 | 部分(已加入AI考虑因素) | 部分 | 部分 | 中等 |

| PCI DSS 4.0 | 有限(仅在数据保护上下文中) | 无 | 无 | 低 |

结论:NIST AI RMF和ISO 42001是AI安全成熟度评估和实施的最适用框架。

9.2 防御工具景观

SIEM/SOAR平台(事件检测和响应)

| 产品 | AI检测能力 | AI代理支持 | MCP安全 | 成本 |

|---|---|---|---|---|

| Splunk Enterprise Security | 强(机器学习异常检测) | 部分 | 无 | $150K-$500K/年 |

| Microsoft Sentinel | 强(Azure ML集成) | 部分 | 无 | $50K-$300K/年 |

| CrowdStrike Falcon XDR | 强(行为分析) | 部分 | 无 | $200K-$600K/年 |

| Datadog | 中等 | 无 | 无 | $30K-$200K/年 |

| IBM QRadar | 中等 | 无 | 无 | $100K-$400K/年 |

AI基础设施安全(容器/向量数据库保护)

| 产品 | Chroma保护 | Ollama保护 | Redis保护 | MCP支持 |

|---|---|---|---|---|

| Wiz | 是 | 是 | 是 | 是 |

| Snyk | 否 | 否 | 否 | 否 |

| Aqua Security | 部分 | 部分 | 部分 | 否 |

| Trend Micro | 是 | 是 | 是 | 是 |

| Palo Alto Networks | 部分 | 部分 | 是 | 否 |

代理AI安全

| 产品 | 行为监控 | 提示注入检测 | 工作流治理 | 成熟度 |

|---|---|---|---|---|

| Obsidian Security | 是 | 是 | 是 | 高 |

| Lakera | 是 | 是 | 否 | 中等 |

| Rebuff | 是 | 是 | 否 | 中等 |

| Robust Intelligence | 是 | 是 | 否 | 中等 |

| 自定义SOAR工作流 | 部分 | 否 | 是 | 低 |

9.3 内部能力差距

典型企业的实际状态 vs. 所需状态:

| 能力 | 当前状态 | 所需状态 | 差距 | 弥合成本 |

|---|---|---|---|---|

| AI基础设施清单 | 29%有完整清单 | 100% | 71% | $50-$100K |

| AI代理治理政策 | 21%有正式政策 | 100% | 79% | $30-$50K(策略)+ $50-$100K(工具) |

| 提示注入防御 | 5%已实施 | 95% | 90% | $100-$200K(工具 + 改进) |

| MFA部署(财务) | 45%使用抗钓鱼MFA | 100% | 55% | $75-$150K |

| AI工具DLP | 18%已实施 | 80% | 62% | $95-$190K |

| SIEM/AI集成 | 35%具有某种AI检测 | 90% | 55% | $150-$300K |

| 安全自动化 | 40%具有基本SOAR | 85% | 45% | $100-$200K实施 + $50-$100K/年 |

总缺口弥合成本:$600K-$1.2M初始 + $100-$200K/年运营成本

十、结论

10.1 关键发现

2025年,AI已成为网络安全态势的双刃剑。关键发现包括:

-

威胁增长超过防御:虽然AI驱动的防御技术在改进,但AI驱动的攻击更快地增长和发展。76%的组织报告无法匹配攻击的速度。

-

AI基础设施是新型攻击面:数千个暴露的AI系统(向量数据库、推理服务器、模型存储库)创造了直接的攻击路径。这些不是高级威胁——它们是基本的安全卫生问题。

-

影子AI是新的数据泄露原因:无管制的AI工具使用导致额外$67万/次泄露。大多数组织缺乏基本控制。

-

代理AI是新的特权用户:AI代理现在具有比大多数人类员工更多的系统访问权限。大多数组织没有适当的治理框架。

-

深度伪造现在是商业化的:语音和视频克隆已从昂贵的定制攻击演变为相对便宜的大规模操作。2025年年均出现重大欺诈。

-

防御ROI明确:使用AI防御的组织平均节省$190万/次泄露。提前投资的组织在成本和响应时间上都获胜。

-

地区差异显著:香港和其他亚太地区面临高于全球平均水平的威胁。特别是金融中心面临针对性的BEC和深度伪造活动。

10.2 面向决策者的优先行动项目

立即(第0-30天)

-

对所有AI系统进行清单和分类

-

对金融部门的所有账户部署抗钓鱼MFA

-

扫描互联网面向的向量数据库并添加身份验证

-

启用财务资金转账的回拨验证

成本:$75K-$150K | ROI:阻止平均$200K+ BEC

短期(第30-90天)

-

建立AI代理治理框架和清单

-

实施企业数据分类和影子AI DLP

-

部署行为分析以检测异常

-

对所有已部署的AI系统进行安全审计

成本:$150K-$300K | ROI:减少影子AI泄露风险$278M+

中期(第90-180天)

-

实现SIEM + SOAR集成以进行AI驱动的检测

-

部署提示注入和向量中毒防御

-

建立安全自动化以加快响应

-

对代理系统进行红队测试

成本:$200K-$400K | ROI:检测时间缩短80天,节省$190万/次泄露

长期(第180-365天)

-

完全零信任架构实施

-

建立AI开发和部署的安全SDLC

-

建立持续的代理安全监控

-

开发组织特定的AI安全文化

成本:$300K-$600K | ROI:建立弹性,防止高成本事件

10.3 对亚太地区的特殊建议

鉴于香港的特定威胁景况,本地组织应特别关注:

-

针对金融机构的BEC防御:由于大额转账和国际交易,金融部门应实施严格的支付治理

-

零售行业欺诈检测:零售部门的欺诈率为17.8%(+113% YoY),应优先投资欺诈检测工具

-

跨境威胁智能:香港的地理位置使其容易受到亚太区域特定威胁组的针对。与地区CERT和执法部门分享威胁情报

-

法规遵从:香港的数据保护条例和不断增加的国际合规要求使得在云和AI系统中正确的数据分类和保护至关重要

-

供应链韧性:鉴于全球供应链中的广泛AI集成,组织应评估第三方AI工具和服务的安全性

10.4 最终建议

-

重新评估风险偏好:AI威胁的速度和规模已改变。传统的冷静评估周期过于缓慢。建立快速决策框架。

-

投资可观测性而非工具:不是获取最新工具,而是关注能够检测异常和追踪AI系统行为的可观测性。

-

建立AI安全专业知识:大多数组织在传统网络安全中拥有深厚专业知识,但在AI特定威胁上缺乏专业知识。优先考虑招聘或培训AI安全专家。

-

实施代理治理作为优先事项:在大规模部署代理AI之前,建立治理框架。事后治理成本是事前治理的10倍。

对业务领导的建议

-

AI安全是一项商业风险:网络安全不是”IT问题”——它是业务连续性风险。将AI安全纳入企业风险管理。

-

预防比修复便宜得多:每次泄露成本$444万。防御投资的ROI明确——平均$2.2M节省/次泄露。

-

影子AI是合规风险:无管制的AI工具使用可能违反数据隐私法规(GDPR、CCPA等)。建立治理框架以控制风险。

-

供应商风险已扩大:任何AI工具、云服务或第三方模块都引入了新的风险面。实施严格的第三方安全评估。

10.5 前景

到2026年,我们可以预期:

-

AI驱动的攻击将继续加速,特别是在代理AI方面

-

防御技术将成熟,组织采用AI工具进行防御将变得更加普遍

-

监管框架将跟上,使用ISO 42001和NIST AI RMF进行AI安全治理将变得强制性

-

代理AI安全将成为主要焦点,大多数漏洞和事件将涉及错误配置或受损的代理

-

深度伪造欺诈将上升,直到生物识别和多因素验证变得通用

关键是现在采取行动。那些今天投资AI安全的组织将在明年处于具有竞争优势的位置,可以更快地检测威胁、更迅速地响应,以及成本和声誉损害更小。

文献参考

-

Verizon Data Breach Investigations Report (DBIR) 2025 — 事件和泄露数据的最大数据库

-

IBM Cost of a Data Breach Report 2025 — 全球$444M平均泄露成本,按行业和地区分析

-

CrowdStrike 2025 State of Ransomware Report — 76%的组织无法匹配AI攻击速度

-

Microsoft Digital Defense Report 2025 — 国家级威胁和防御能力

-

Trend Micro State of AI Security Report 1H 2025 — 10,000+暴露的Ollama实例,200+无保护的Chroma服务器

-

ENISA Threat Landscape 2025 — 欧洲威胁视角

-

World Economic Forum Global Cybersecurity Outlook 2025 — 93%的安全领导者预期日均AI攻击

-

Kaspersky Financial Sector Report 2025 — 12.8% of B2B finance facing ransomware

-

KELA Escalating Ransomware Report 2025 — 34%全球关键部门增长,制造业增长61%

-

HKCERT Hong Kong Cyber Security Outlook 2025 — 7,811 phishing cases (+108%), malware incidents +4.8x

-

NIST Artificial Intelligence Risk Management Framework (AI RMF) — 企业AI安全的实施框架

-

ISO 42001 — AI管理系统标准

-

OWASP LLM Risk TOP 10 — LLM特定漏洞类别

-

McKinsey Deploying Agentic AI with Safety and Security — 代理治理的最佳实践

-

Obsidian Security Agentic AI Security Report — 69%企业部署AI代理,仅21%有安全控制

-

DeepStrike AI Cyber Attack Statistics 2025 — 72%增长,$30B预计损害

-

KnowBe4 2025 Phishing Trends Report — 83%的钓鱼邮件使用AI

-

Cysure 2025 BEC Report — Google/Facebook $100M+ 供应商欺诈案例

-

Deep Instinct Financial Services AI Cyberattack Survey — 45%面临AI攻击

-

NIST SP 800-63-4 — 身份验证和生命周期管理标准,包括无密码MFA

-

Hong Kong Police Cybersecurity Crime Statistics (H1 2025) — HK$3.04B损失,+15% YoY

-

Thales 2025 Data Threat Report APAC Edition — 65%企业将AI视为首要安全问题

-

Future CISO Hong Kong 2025 Cyber Defence — 6.2%数字欺诈率

原创文章,作者:首席安全官,如若转载,请注明出处:https://www.cncso.com/2025-ai-cyber-attack-trends-security-report.html