大規模モデル(LLM)の普及に伴い、Ollamaに代表されるオープンソースのローカライズされたデプロイメント・フレームワークは、開発者がAIモデルを使用・管理する敷居を大幅に下げている。しかし、この利便性は新たな大規模なセキュリティリスクも生み出している。SentinelOne社、Censys社、Pillar Security社が共同で発表した最近の調査では、インターネット上に公開されているOllamaのインスタンスが世界全体で17万5,000以上存在し、大規模なAIコンピューティング・インフラストラクチャのセキュリティ攻撃面リスクを生み出しているという驚くべき事実が明らかになった。

.本レポートは、このインシデントの詳細な技術的分析を提供し、その攻撃対象、実際の脅威、システムリスクを分析し、対応する企業レベルのセキュリティ強化およびガバナンス戦略を提案することを目的としている。

1.はじめに:OllamaとローカライズされたAIの台頭

Ollamaは、開発者がパーソナルコンピュータ(Windows、macOS、Linux)またはサーバー上であらゆる種類の大規模言語モデルを簡単にダウンロード、実行、管理できるオープンソースのフレームワークです。Ollamaのコアバリューは、ローカライズされたAIのデプロイプロセスを簡素化し、開発者がカスタマイズ可能なプライベートAIサービスを迅速に構築できるようにすることです。デフォルトでは、Ollamaサービスはローカルのループバックアドレス(127.0.0.1:11434)を使って、ローカルからのみアクセスできるようにしている。しかし、一見些細な設定変更、つまりバインドアドレスを0.0.0.0あるいはどんなパブリック・ネットワーク・インターフェースでも、そのAPIを完全にパブリック・ネットワークに公開していたことになる。この単純な設定ミスが、今回の大規模な暴露につながったのだ。

2.暴露面の分析:マスターのいないグローバルAIネットワーク

この調査によると、発見された17万5000のインスタンスは、前例のない、世界に広がる「影のAIネットワーク」を構成している。その規模と特徴は詳細な分析に値する。

2.1 地理的分布とネットワーク環境

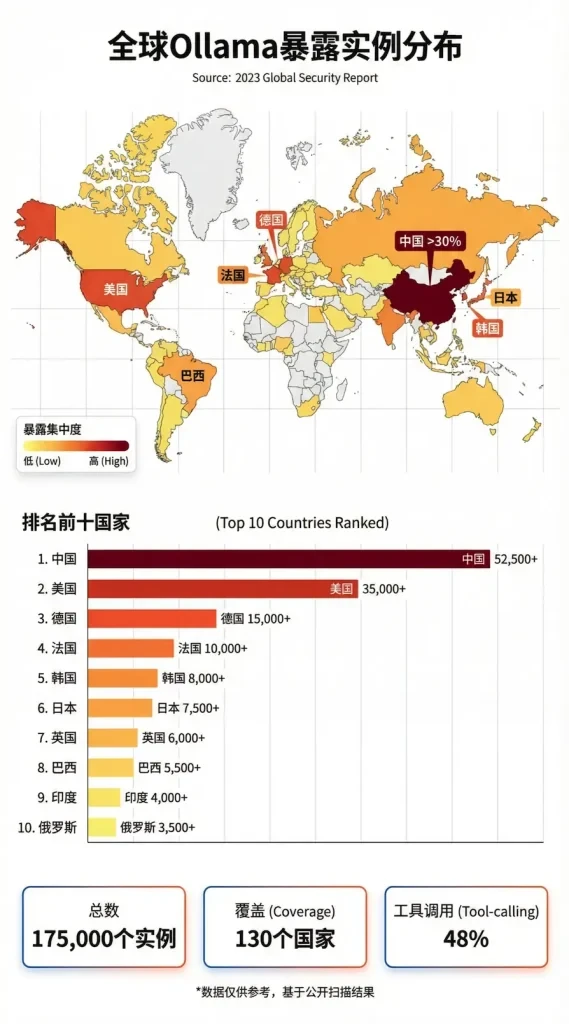

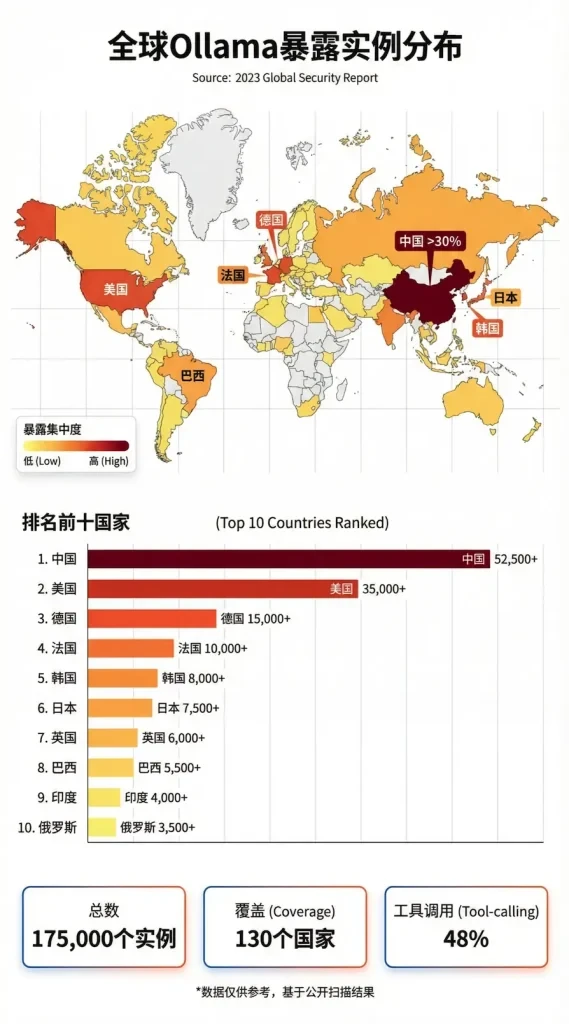

暴露されたOllamaホストは世界130カ国に存在し、幅広い地理的分布を示しています。中でも、30%を超える中国がトップで、米国、ドイツ、フランス、韓国などの技術先進国がそれに続いている。この分布は、Ollamaの流行が世界的なものであることを示唆しているが、セキュリティ意識の普及はその展開に追いついていない。

さらに懸念されるのは、これらのホストが従来のクラウドサービスプロバイダー(AWS、Azure、Google Cloudなど)に存在するだけでなく、家庭用ブロードバンドネットワークにも多く分散しているという事実だ。一般的に家庭用ネットワークにはエンタープライズ・グレードのセキュリティ監視・管理メカニズムがないため、このようなハイブリッドな展開環境はガバナンスの複雑さを大幅に増大させる。

|

主な被爆国

|

|

1.中国(>30%)

|

|

2.アメリカ

|

|

3.ドイツ

|

|

4.フランス

|

|

5.韓国

|

|

6.インド

|

|

7.ロシア

|

|

8.シンガポール

|

|

9.ブラジル

|

|

10.イギリス

|

表1:Ollamaインスタンスが公開されている上位10カ国の分布

AI Ollamaの公開インスタンス攻撃面分布ヒートマップ

AI Ollamaの公開インスタンス攻撃面分布ヒートマップ

図1:世界のOllama暴露インスタンス分布のヒートマップ

2.2 リスクの高い能力:テキスト生成から特権操作まで

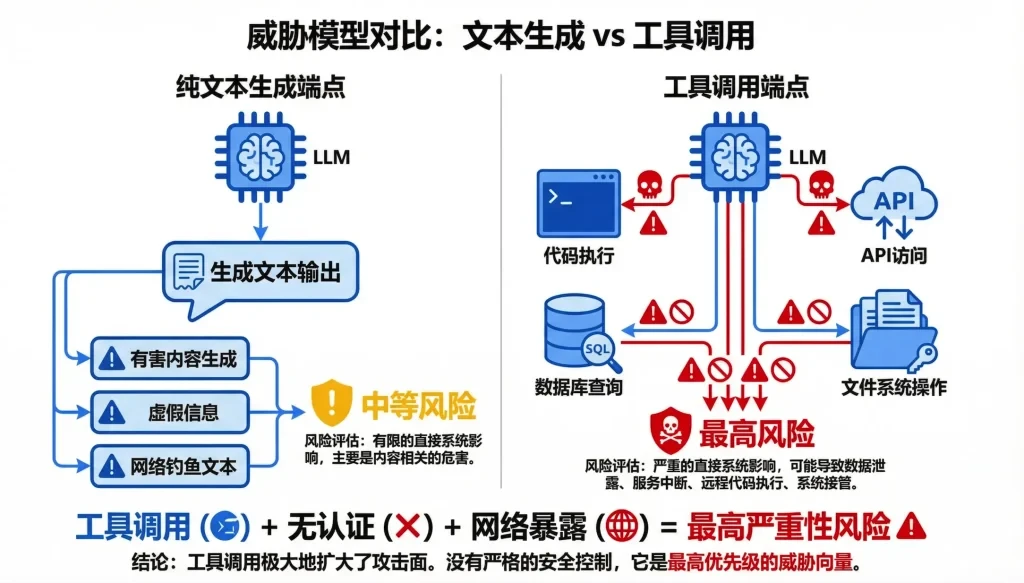

この報告書で最も憂慮すべきことは、暴露されたすべてのホストの中で半数近く(48%以上)がツールコールを有効にしている。.ファンクション・コールとしても知られるツール・コールは、ネイティブ・コードの実行、外部APIの呼び出し、データベースやオペレーティング・システム・リソースへのアクセスなど、LLMが外部の世界と相互作用することを可能にする。この機能は脅威モデルを根本的に変えてしまう。

「プレーンテキストを生成するエンドポイントは有害なコンテンツを生成することができるが、ツールを使用できるエンドポイントは特権的な操作を実行することができる。不十分な認証やネットワークへの露出と組み合わせると、これは我々の評価においてエコシステム内で最も深刻度の高いリスクとなる。 -- SentinelOneリサーチャー

つまり、攻撃者はチャットボットと会話する代わりに、パスワードで保護されていないAPIを通じて被害者のマシン上で直接コマンドを実行できる可能性がある。さらに、この調査では、セキュリティフェンスが取り除かれた「無修正」のアラートテンプレートを実行している201のホストが見つかり、悪意のあるコンテンツを生成したり、危険な行動を引き起こしたりすることが容易になりました。

図2:テキスト生成エンドポイントとツール呼び出しエンドポイントの脅威モデルの比較

3.脅威モデリングと実際の攻撃:LLMジャッキング

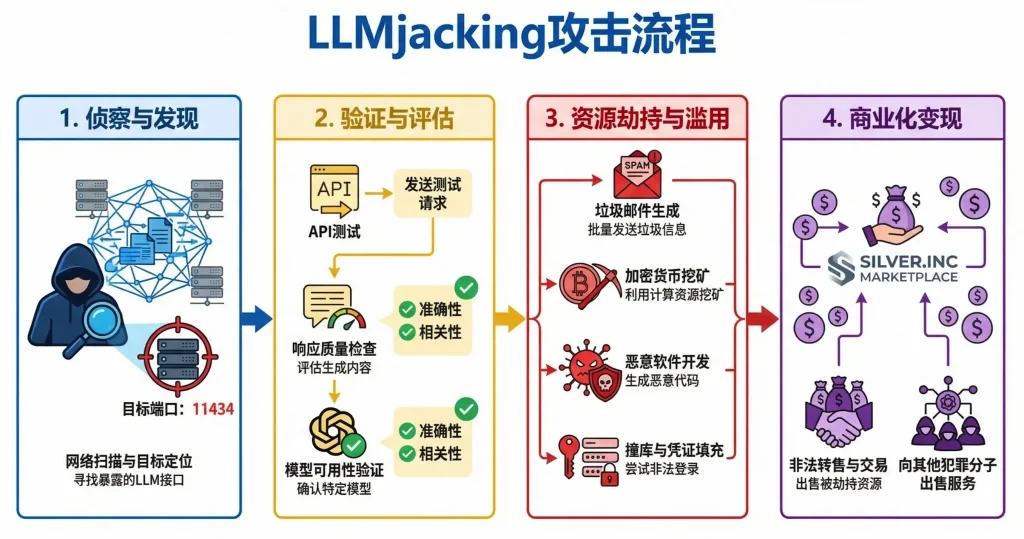

このようなAIインフラの露出に対応して、「LLMjacking」と呼ばれる新しいタイプの攻撃が出現した。攻撃者は被害者のLLMコンピューティング・リソースを乗っ取って自らの目的に利用し、被害者はすべてのコンピューティング・コストを負担する。

3.1 LLMジャッキング攻撃の流れ

LLMジャッキング攻撃は通常、不正アクセスから始まり、リソースの悪用と商業的実現で終わる標準的なプロセスをたどる。

1.偵察と発見攻撃者はmasscanのような自動化ツールを使って、開いているOllamaのデフォルトポート(11434)やその他の既知のAIサービスポートをインターネット上で大量にスキャンします。

2.検証と評価開いているポートを発見すると、攻撃者はテストリクエストを送信し、それが有効な認証されていないAIサービスであることを確認し、そのパフォーマンスと利用可能なモデルを評価する。

3.リソースのハイジャックと乱用標的が特定されると、攻撃者はそのコンピューティングリソースを使用して、以下を含むさまざまな悪意のあるタスクを実行することができる:

•大規模なコンテンツ生成スパム、フィッシング、偽情報キャンペーン用。

•暗号通貨マイニングLLMはマイニングには最適化されていませんが、大規模なハイジャックの場合には収益を上げることができます。

•マルウェア開発悪意のあるコードの記述、難読化、変異を支援するためにAIを使用する。

•ブルートフォース・クラッキングとバウチャー・フィリングパスワード辞書を作成したり、ログイン試行を自動化する。

4.商業化の実現ダークウェブや専門市場で「安価なAIパワー」として転売するために、ハイジャックされたAIアクセスをパッケージ化する。

3.2 「奇妙なバザール作戦」:LLMジャッキングの商業化の例

Pillar Securityの研究者は、「Operation Bizarre Bazaar(奇妙なバザール作戦)」と呼ばれる実際の攻撃キャンペーンを特定し、その原因を突き止めた。このキャンペーンは、"Hecker"(別名Sakuya、LiveGamer101)という名の脅威アクターによって実行されており、彼は "Hecker "という名前の攻撃者を作成しました。シルバーインクのウェブサイトはLLMのAPIゲートウェイとして機能し、インターネットからハイジャックしたAIサービスへのアクセスを公然と販売している。

この市場の手口は、LLMジャッキングの完全な連鎖を明確に示している。自動化されたネットワーク全体のスキャンから、サービス品質の検証、最終的な商業転売まで。これは、AIインフラに対する攻撃が、散発的な個人的行為から、組織化された利益追求型の犯罪活動へと進化したことを示している。

4.システミック・リスクとガバナンスの課題

Ollamaの暴露は、分散型AI展開モデルにおける深いシステミックリスクとガバナンスの課題を明らかにした。

•ガバナンスの溝暴露されたホストは、クラウドと家庭の両方のネットワークにまたがっており、従来の境界ベースの企業セキュリティモデルを無効にしている。セキュリティ・チームは、従業員の自宅や未報告のクラウド・インスタンスを効果的に監視・管理できない。

•新たな攻撃ベクトルこれらの孤立したAIノードは、キューインジェクション、データポイズニング、モデル汚染などの攻撃の理想的な実験場であり、踏み台となります。攻撃者はこれらのノードを使用して、悪意のあるトラフィックをプロキシし、その本当の出所を隠すことができます。

•サプライチェーンのリスクツールコール機能を有効にしたOllamaのインスタンスは、組織内のプロセスを自動化するために使用された場合、攻撃者が組織のイントラネットに侵入するための入口となる可能性があり、深刻なサプライチェーンセキュリティリスクを引き起こす可能性があります。

•セキュリティ意識の遅れOllamaの使いやすさは多くの開発者を惹きつけているが、多くの開発者は、単純なネットワーク設定のミスが、これほど深刻なセキュリティ上の結果をもたらすことに気づいていないかもしれない。技術の普及とセキュリティ教育の間には明らかな断絶がある。

5.緩和策と安全勧告

この新たな脅威に直面し、企業や個々の開発者はAI導入戦略を見直し、厳格なセキュリティ対策を採用しなければならない。

5.1 セキュリティの基本原則

ローカルLLMを特権的サービスとして扱うコードを実行したり、外部システムと相互作用したりできるAIサービスは、データベースや管理バックエンドと同じレベルで重要なインフラとして扱われ、適切なセキュリティ管理が課されるべきである。

5.2 具体的な技術的提言

|

レベル

|

推奨される対策

|

明示的記述

|

|

ネットワーク層

|

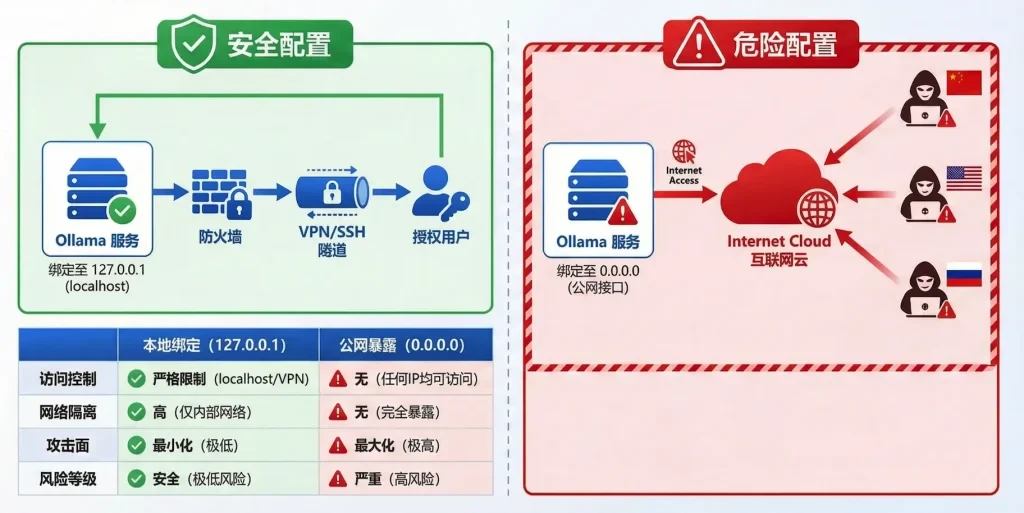

ローカル・バインディングにこだわる

|

常にOllamaサービスを127.0.0.1.リモートアクセスが必要な場合は、ポートを直接公開するのではなく、安全なトンネリング技術(VPN、SSHトンネリング、Tailscale、ZeroTierなど)を使用すべきである。

|

図4:安全なコンフィギュレーションと危険なコンフィギュレーションのアーキテクチャ

ファイアウォールルールの実施 ホストおよびネットワークレベルで厳密なファイアウォールルールを設定し、信頼できるIPアドレスからのトラフィックのみがAIサービスポートにアクセスできるようにします。

アプリケーション層強制認証 Ollamaフロントエンドにリバースプロキシ(Nginx、Caddyなど)を導入し、必須の認証メカニズム(HTTP Basic Auth、OAuth2、クライアント証明書など)を設定する。

APIレートの制限 ブルートフォース攻撃やサービス拒否攻撃を防ぐため、APIエンドポイントにレート制限をかける。

モニタリングと監査資産目録の作成 企業は、AI資産の動的インベントリーを作成し、ネットワーク・スキャン・ツールを使用して、内部および外部ネットワークにおける未承認のAIサービスを定期的に検出する必要がある。

ログの監視とアラート Ollamaのアクセスログや操作ログを監視し、異常なアクセスパターン(不明なIPからのリクエスト、高頻度のAPIコールなど)に対してアラートを設定する。

構成管理 :セキュリティベースラインAIのデプロイメントのためのセキュリティ設定のベースラインを開発し、実施し、自動チェックのためにセキュリティ設定をCI/CDプロセスに組み込む。

6.結論

Ollamaインスタンス17万5000台の公開は、AI時代の「シャドーIT」問題の集中的な発生である。これは、AI技術がエッジや個人のデバイスに降りてくるにつれて、従来の中央集権的なセキュリティ・ガバナンス・モデルが深刻な課題に直面していることを明確に示している。攻撃者は、こうした無人のAIリソースを組織的に利用し、偵察から実現までの完全な犯罪チェーンを形成し始めている。

セキュリティ・コミュニティにとって、これは警鐘である。我々は、AIインフラ、特に外界と相互作用する能力を持つ「エージェント」AIを、最高レベルのセキュリティ管理下に置かなければならない。一般的な開発者にとって、オープンソースと利便性を受け入れることは、セキュリティの左側へのシフトと、デプロイの最初の段階から「デフォルトでセキュリティ」という考え方を伴うものでなければならない。そうでなければ、今日私たちに利便性をもたらすAIアシスタントが、明日には狼を家の中に導くトロイの木馬になってしまうかもしれない。

元記事はChief Security Officerによるもので、転載の際はhttps://www.cncso.com/jp/ai-ollama-attack-surface-analysis-report.html。