CrowdStrike:智能体三大攻击手法:工具投毒、冒充和Rugpull威胁企业

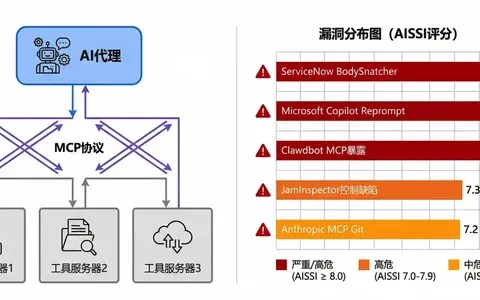

CrowdStrike 在最新博客中揭示了威胁AI代理安全的三种关键”代理工具链攻击”:工具投毒、服务器冒充和后集成漂移(Rugpull攻击)。这些攻击利用AI代理通过自然语言描述、模式和示例主动选择和执行能力的特性,操纵引导代理决策的语言、元数据和上下文。工具投毒通过在工具描述中隐藏恶意指令误导代理;服务器冒充伪装成合法MCP服务器窃取凭证;Rugpull攻击则在集成后悄然改变工具行为实施数据渗漏。CrowdStrike建议企业采用签名清单、版本锁定、双向TLS认证、参数验证和异常检测等多层防护措施,并推出Falcon AI检测与响应解决方案应对AI攻击面。

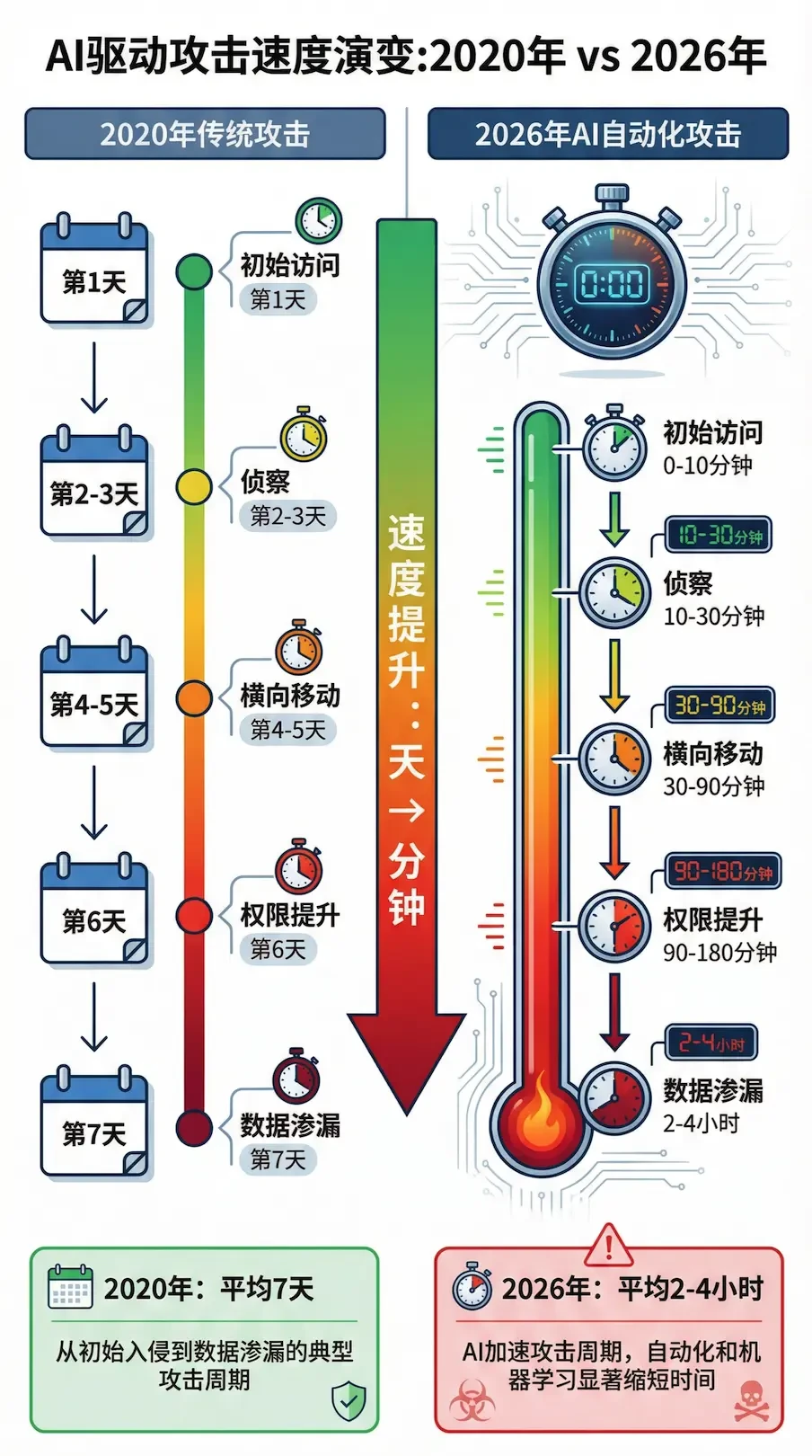

2026网络安全新常态:AI自动化攻击链,防御需从天级提速至分钟级

Forvis Mazars 发布的《2026年网络安全:负责任的AI防御》报告指出,人工智能已彻底改变网络安全节奏,攻击者利用AI自动化侦察、社会工程和横向移动,将攻击周期从数天压缩至数小时甚至数分钟。报告强调,2026年网络安全的核心挑战是速度,攻击已从数据窃取转向运营杠杆,造成停机、声誉损害和团队分心。报告建议企业采用”负责任的AI防御”策略,包括部署抗钓鱼多因素认证(MFA)、实施身份威胁检测与响应(ITDR)、采用扩展检测与响应(XDR)平台,并建立分层不可变备份。治理优先、人机协同和透明可审计成为AI防御的三大原则。

2026年1月AI安全事件激增:MCP漏洞成企业主要威胁

PointGuard AI 研究实验室发布的《2026年1月AI安全事件综述》显示,本月AI安全事件数量和严重性显著上升,多起事件在AI安全严重性指数(AISSI)上评分超过7.0。其中,模型上下文协议(MCP)相关漏洞成为主要威胁类别,包括 Clawdbot MCP 暴露、JamInspector 控制平面缺陷等高危事件。此外,ServiceNow “BodySnatcher” 漏洞(CVE-2025-12420)和 Microsoft Copilot “Reprompt” 攻击分别获得8.7和8.3的高危评分。报告指出,攻击者已从实验性探索转向系统化利用AI工作流,提示注入攻击仍在演变,且大多数高危事件源于工具链和协议弱点,而非模型本身。

风险洞察:Shadow AI 引爆个人 LLM 账号数据泄露

最新云威胁报告显示,员工使用个人账户访问 ChatGPT、Google Gemini、Copilot 等 LLM 工具已成为企业数据泄露的主渠道之一,genAI 相关的数据策略违规平均每月高达 223 起,较去年翻倍增长。 报告指出,部分组织中发往生成式 AI 应用的提示数量在一年内增长六倍,头部 1% 企业每月提交提示超过 140 万条,其中包含源代码、合同文本、客户资料甚至凭据等高敏数据,一旦被用于模型训练或遭二次窃取,将给合规与知识产权带来长期不可逆风险。 这类 Shadow AI 的共性在于“看不见、管不住”:安全团队往往只盯住官方接入的大模型,而忽视浏览器、个人账号和移动端的灰色通道,未来还将叠加基于会话上下文的个性化广告与第三方插件生态,进一步模糊数据边界。 企业应尽快建立 genAI 使用策略与分类分级规范,借助 CASB/SASE 对 AI 流量进行识别与阻断,对高敏部门默认禁止个人 LLM 访问,并引入企业版受控 LLM 作为替代,配套审计与数据最小化策略。

ChatGPT 引入对话式广告:AI 盈利模式背后的数据安全与合规新挑战

OpenAI 宣布在 ChatGPT 免费版与 Go 版本中测试会话内广告,这一商业化调整同时把“广告合规与数据安全”推上台前。 官方强调不会向广告商出售对话数据、广告与回答逻辑隔离,但并未细化用于个性化投放的数据类型和处理路径,这正是安全与合规团队需要重点审视的灰区。 从技术路径看,聊天式广告需要把对话上下文、兴趣信号与用户画像做实时特征抽取,再通过推荐或排序模型选出“相关赞助内容”,这要求在日志采集、特征生成、模型训练和推送链路中建立最小化采集、脱敏与用途限定控制,否则极易演变为“隐性画像 + 越界再利用”。 对企业安全团队而言,一方面要将此类“对话式 AI 广告”纳入第三方服务风险评估,排查是否存在跨区域数据流转、监管红线(如未成年人、敏感场景广告屏蔽策略)与审计缺口;另一方面也要反向审视自身内部的 AI 助手和客服机器人,是否同样存在“借交互顺手做广告/画像”的冲动和暗箱逻辑。 可以预见,面向未来的大模型产品安全,将从单纯讨论“模型越权、提示注入”扩展到“人机对话中的隐性营销边界”,如何在可持续盈利、用户信任与监管要求之间设计透明可控的广告与数据治理机制,正成为下一轮 AI 安全实践的关键命题。

风险洞察:2026全球企业安全焦点转向AI漏洞

报告核心发现:

WEF(世界经济论坛)在2025年8-10月期间对全球800名企业从业者进行问卷调查,结果于2026年1月发布。调查显示,94%的高管认为AI是2026年网络安全格局中最显著的变革驱动力;87%的受访者将AI相关漏洞列为增长最快的网络安全风险。与2025年的调查相比,企业评估AI工具安全性的比例从37%剧增至64%。从攻防角度看,企业既担心攻击者利用AI加速攻击速度(72%关注),也在投资AI防御工具。

AI安全三大核心隐患:

CSO们具体识别的Top 3风险依次为:

(1)数据泄露与隐私暴露(30%)——AI模型训练数据被投毒或推理时敏感信息被提取;

(2)对手AI能力提升(28%)——恶意行为人利用AI生成钓鱼邮件、自适应恶意软件、虚假舆论;

(3)AI系统技术安全性(15%)——模型后门、权限混淆、提示注入等AI特有漏洞。

与此同时,73%企业已从2025年的”勒索软件防御优先”转向2026年的”AI驱动欺诈与网络钓鱼防御”。

AI智能体权限爆炸问题:

CyberArk与其他安全厂商报告指出一个关键趋势:非人类身份(machine identities)即将成为第一大云侵害向量。到2026年,每个AI智能体都是一个”身份”——需要数据库凭证、云服务token、代码仓库密钥等。随着组织部署数十乃至数百个AI智能体,这些身份累积的权限呈指数增长,成为攻击者目标。OWASP新增的”工具误用”(tool misuse)攻击向量尤其危险:攻击者在不修改AI指令前缀(system prompt)的前提下,通过恶意数据注入(如订单地址字段中的提示注入),诱导AI执行非预期的API调用、权限提升或数据窃取操作。

前瞻性应对策略:

实施AI身份与访问治理(IAM):给每个AI智能体分配最小必需权限,定期审计其凭证与API调用日志

部署表达式与提示防护:在AI代理的输入验证层增加指令注入检测,对不信任的外部数据源进行隔离处理

建立AI供应链信任体系:审查第三方AI模型、插件与数据源的安全来源,防止后门模型被部署

扩展AI感知SIEM:传统日志分析已难以应对AI的高度自主性,需要专用的AI行为异常检测

组建AI安全应急响应团队:因为传统的网络安全团队缺乏AI特定威胁的应急响应经验

趋势洞察:

2026年将是从”AI赋能安全防御”向”AI安全治理体系化”的转折点。不再是简单地”用AI打击恶意AI”,而是要在身份管理、权限治理、审计日志、应急响应等全流程中融入AI风险意识。那些仍停留在”AI好处论”而忽视权限管理的企业,将面临最大的代价。

AI 网络攻击成新趋势:2025 Q4 攻击样本预测试 2026 AI安全风险

安全报告显示,在 2025 年第四季度出现多起利用自主 AI Agent 的网络攻击案例,攻击者通过智能体自动完成情报收集、横向移动和权限提升,显著扩大了攻击面。 有分析指出,部分国家级威胁行为体已在实战中使用 AI 代理执行 80%–90% 的攻击链步骤,速度和隐蔽性都超过传统人类黑客团队。 专家预判,随着大模型与自动化框架进一步下沉,2026 年“自主 AI 攻击”可能演变为比传统勒索软件和鱼叉式钓鱼更具破坏力的新主流威胁,尤其指向关键基础设施和云环境。

AI 欺诈与数据泄露将在 2026 激增

Experian 最新预测称,AI 将在 2026 年成为网络安全的核心威胁之一,仅 2025 年上半年全球就发生超过 8000 起数据泄露事件,约 3.45 亿条记录被曝光。 与此同时,Experian 和 Fortune 报道预计,AI 驱动的欺诈在 2026 年将继续飙升,前一年相关损失已达约 125 亿美元,深度伪造与智能钓鱼在金融、电商和社交平台上快速扩散。 报道指出,AI 工具正在“民主化”诈骗能力,使低技术门槛的攻击者也可以批量生成高度逼真的短信、语音和合成视频,传统反欺诈规则难以及时识别这些新型攻击模式。

《2026全球网络安全展望》:AI 已成为网络安全攻击增长最大的风险

《2026全球网络安全展望》报告指出,87% 的受访机构认为与 AI 相关的漏洞是 2025 年以来增长最快的网络风险,AI 正在同时强化进攻与防守两端。 报告显示,77% 的组织已在安全运营中采用 AI,用于钓鱼检测、异常入侵响应与用户行为分析,但数据泄露和模型滥用成为高管最担心的问题之一。 与 2025 年相比,主动评估 AI 工具安全性的组织比例从 37% 提升到 64%,说明企业正在从“盲目上 AI”转向“安全治理优先”。

BreachForums暗网论坛历史数据库重大泄露

自 2022 年以来,BreachForums 一直是全球最大、最臭名昭著的数据泄露与黑客交易论坛之一。这个地下数据集市不仅是黑客炫耀战果的舞台,更是许多重大数据泄露和勒索活动的策源点。BreachForums 最初由 Conor Fitzpatrick(ID “pompompurin”)创建,在 2023 年其被捕后由 ShinyHunters 接手运营。后来又因为MyBB 0day下线,当时也发布了一些说明,真假未知。今年6月,法国和美国合作,又逮捕了包括 ShinyHunters、Hollow、Noct 和 Depressed 在内的多名核心成员。

事件核心详情

泄露源:据称来自原BreachForums内部成员。

泄露内容:一个名为 breachforum.7z 的压缩文件,内含:

完整SQL数据库文件:包含用户注册信息、凭证等核心数据。

用户PGP密钥:可能影响加密通信安全。

声明文件:一份风格独特、充满“诗意”的长文(.txt),内容被指可能有AI润色痕迹,或为泄露者声明。

数据真实性:已有用户通过文件中自己曾使用的临时邮箱验证,确认数据为真实且新近的。

下载地址:https://shinyhunte[.]rs/breachforum.7z (注:出于安全考虑,链接已作无害化处理,请勿直接访问)。

泄露数据分析(邮箱域名排名)

泄露数据中注册邮箱的统计排名如下,清晰反映了该论坛用户群体的偏好,其中隐私邮箱和临时邮箱服务占比极高:

排名 邮箱域名 出现数量 服务类型/特点

1 gmail.com 239,747 主流商业邮箱

2 proton.me 29,851 端到端加密隐私邮箱

3 protonmail.com 12,382 端到端加密隐私邮箱

4 onionmail.org 4,668 专注于Tor网络的匿名加密邮箱

5 cock.li 4,577 强调匿名、无需个人验证的邮件托管服务

6 yahoo.com 4,478 主流商业邮箱

7 qq.com 3,290 主流商业邮箱

8 mozmail.com 2,395 Firefox Relay提供的隐私转发邮箱

9 tutanota.com / tutamail.com 2,294 端到端加密的隐私邮箱

10 dnmx.org 1,441 匿名邮件服务

数据分析解读:

隐私服务高度集中:排名前10的域名中,有超过一半(Proton, OnionMail, Cock.li, Mozilla Relay, Tuta)是专注于匿名、加密或转发的隐私保护服务。这表明BreachForums的用户具有极强的反溯源和隐私保护意识。

“操作空间”警告:用户提及的“操作空间大”,可能指攻击者可以利用这些隐私邮箱的注册机制(如无需手机号验证)进行关联分析、钓鱼或发起针对特定隐私服务用户的定向攻击。