Генеративный с 2023 годаИИ(С момента появления генеративного ИИ технологическая эволюция больших языковых моделей (LLM) прошла путь от простого заполнения текста и диалога до агентного ИИ со сложными возможностями логических рассуждений. К 2026 году LLM, представленные семейством Claude компании Anthropic и новым поколением моделей OpenAI, продемонстрируют значительные преимущества в понимании кода, контекстуализации и долгосрочном планировании задач.

Интеллектуальная безопасность тела(Agentic AI Security): относится к безопасности, контролируемости и проблемам с существующими средствами защиты, когда задачи выполняют объекты ИИ с автономными возможностями принятия решений и вызова инструментов.

В настоящее время большие модели уже не ограничиваются статическим поиском знаний, а способны глубоко понимать сложную архитектуру программного обеспечения и бизнес-логику. Этот переход от “вероятностного предсказания” к “глубоким рассуждениям” обеспечивает новую технологическую базу для решения давней проблемы уязвимости "нулевого клика" (Zero-click Vulnerability) и анализа сложных путей удаленного выполнения кода (Remote Code Execution, RCE) в области сетевой безопасности. Анализ путей создает новую техническую базу.

Большие модели в безопасности: от вспомогательных средств до основы обороны

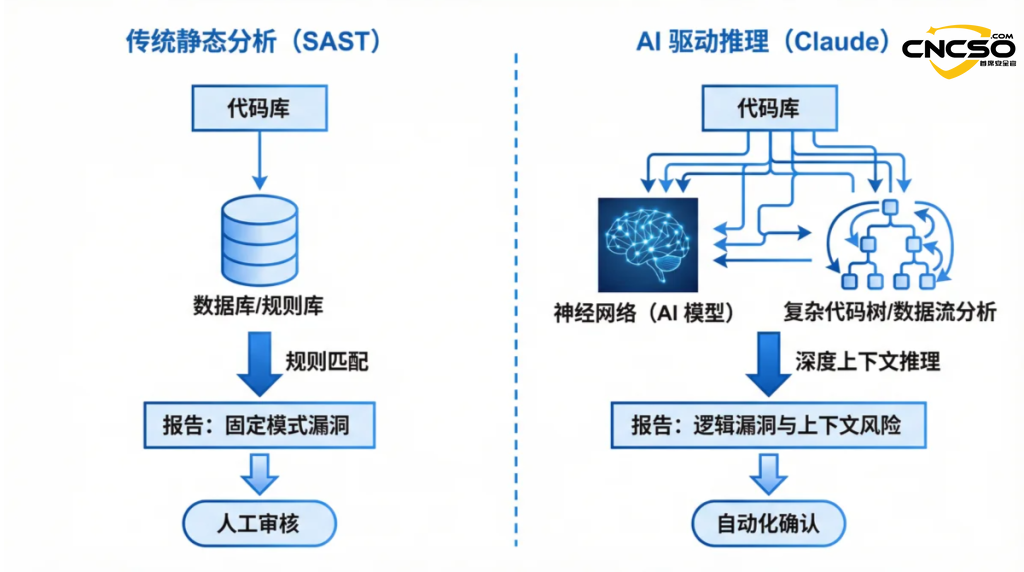

В практике сетевой безопасности применение больших моделей претерпевает трансформацию от “помощника безопасности” к “ядру безопасности”. Традиционная система защиты безопасности в значительной степени опирается на сопоставление кода характеристик и статические правила, чего недостаточно, чтобы справиться с быстрой итерацией полиморфных вредоносных программ и сложной логикой уязвимостей нулевого дня.

| размер применения | традиционная модель | Большая модель, управляемая моделью |

| тестирование уязвимостей | Статический анализ на основе правил (SAST) | Глубокий аудит на основе контекстных рассуждений |

| Разведка угроз | Ручной сбор и структурированная обработка | Автоматизированное объединение и оценка данных из нескольких источников |

| Исправления в коде | Разработчики пишут патчи вручную | ИИ автоматически генерирует и проверяет рекомендации по устранению неполадок |

| Атака и защита | Тестирование на проникновение в систему заданных скриптов | Автономный интеллект Управляемый телом Противостояние красных и синих |

Большая модель способна выявлять тонкие логические недостатки в коде, опираясь на массивную базу кода и исторические данные об уязвимостях. Например, при работе с нестандартными процессами аутентификации или сложной логикой управления памятью ИИ способен смоделировать ход мыслей злоумышленника и обнаружить глубоко спрятанные опасности, до которых сложно добраться с помощью традиционных инструментов.

Безопасность кода Клода Программа: ПеревоплощениеБезопасность цепочки поставок программного обеспечения

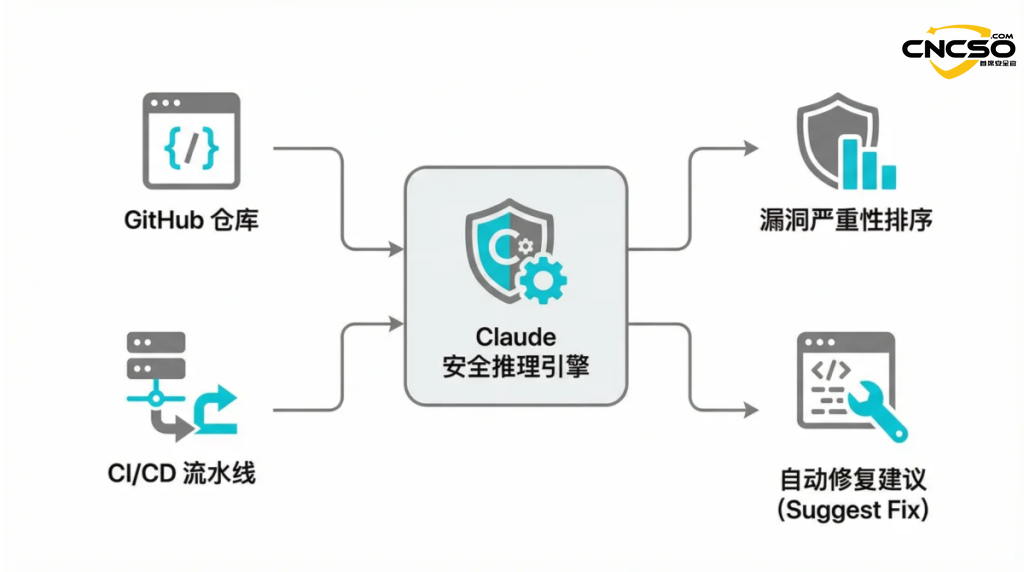

20 февраля 2026 года компания Anthropic официально выпустила Claude Code Security, решение для глубокого анализа безопасности кода, интегрированное в редакции Claude Enterprise и Team. В отличие от традиционных инструментов статического тестирования безопасности приложений (SAST), суть решения заключается в его собственных возможностях рассуждения.

Вместо того чтобы полагаться на библиотеку предопределенных сигнатур уязвимостей, Claude Code Security обеспечивает обнаружение уязвимостей с помощью следующих основных механизмов:

Архитектурное картографирование:Автоматическое построение топологии взаимодействий между компонентами приложения и выявление потенциальных поверхностей атак между модулями.

Отслеживание потока данных (DFT):Анализ в реальном времени пути пользовательского ввода в программе, точное определение опасных точек ввода, которые не поддаются десенсибилизации.

Восстановление по замкнутому циклу (CLR):После обнаружения уязвимости модель не только предоставляет подробное объяснение на естественном языке, но и поддерживает автоматическую генерацию исправлений с помощью кнопки “исправить в один клик”.

Решение, которое теперь поддерживает интеграцию с ведущими платформами хостинга кода, такими как GitHub, призвано расширить границы Shift-left Security, позволяя разработчикам получать отзывы экспертов по аудиту безопасности еще на этапе кодирования.

Влияние на отрасль: смена парадигмы на традиционных рынках безопасности

Запуск Claude Code Security вызвал шок на рынках капитала: акции традиционных гигантов в области безопасности, таких как CrowdStrike и Cloudflare, упали более чем на 8% в день запуска. Это явление отражает обеспокоенность рынка по поводуБезопасность на основе искусственного интеллекта(Безопасность, основанная на искусственном интеллекте) подрывает глубокие ожидания традиционной модели защиты.

С точки зрения отраслевого ландшафта, влияние Claude Code Security ощущается в трех основных аспектах:

Интеграция цепочки инструментов:Традиционные автономные инструменты сканирования могут быть заменены интеллектуальным искусственным интеллектом, интегрированным в среду разработки, а обнаружение безопасности станет более сенсорным и будет происходить в режиме реального времени.

Порог защиты снижен:Малые и средние предприятия могут использовать искусственный интеллект для защиты от сложных логических уязвимостей, таких как Auth Bypass, не прибегая к услугам дорогостоящих экспертов по безопасности.

Перестроены шкалы нападения и защиты:По мере распространения автоматизированного исправления с помощью искусственного интеллекта “окно” между обнаружением и эксплуатацией уязвимости будет значительно сокращаться, что заставит злоумышленников искать атаки более высокого порядка.

Однако решения по обеспечению безопасности на основе ИИ не являются надежными. Галлюцинация моделей может привести к ложным срабатываниям, а точность рассуждений ИИ остается недоказанной для закрытых архитектур с высокой степенью индивидуальности.

Ссылаться на

Акции компаний, специализирующихся на кибербезопасности, падают после того, как Anthropic выпускает Claude Code Security - SiliconANGLE, 2026 г.

Сделать передовые возможности кибербезопасности доступными для организаций - Официальный блог Anthropic, 2026.

Отчет о безопасности ИИ в 2026 году: тенденции и прогнозы - Stellar Cyber, 2026.

За пределами статического анализа: обнаружение уязвимостей с помощью искусственного интеллекта - Medium Engineering, 2025.

Оригинальная статья написана Chief Security Officer, при воспроизведении просьба указывать: https://www.cncso.com/ru/the-paradigm-shift-of-claude-code-security.html.