1.OpenClawの紹介

OpenClawは、以前はMoltbotやClawdbotとして知られていた、オープンソースのエージェント型AIアシスタント(AI Assistant)です。自然言語のコマンドを理解し、ワークフローのトリガー、様々なオンラインサービスとの対話、デバイスをまたいだ操作など、様々な複雑なタスクを自律的に実行する、拡張性の高い自動化エンジンとして設計されている。デジタル世界と直接「手を動かして」対話できることから、セキュリティ研究機関Backslash Securityは、これを「手を持つAI」と表現している。

OpenClawのコアアーキテクチャは、強力な自律的意思決定と実行能力を備えています。ユーザーの意図を解析するだけでなく、タスクのステップを動的に計画し実行することで、従来のソフトウェアにおけるユーザーの意図と機械による実行の明確な境界線を曖昧にしている。この機能により、開発者や高度なユーザー・コミュニティの間で急速に人気が高まり、パーソナル・アシスタントから複雑なエンタープライズ・オートメーションまで、幅広いシナリオで使用されている。

オープンクローの台頭とともに、2つの主要コンポーネントからなる独自のエコシステムが出現した:

ClawHub:これは公式のスキルマーケットプレイスで、ユーザーはOpenClawの機能を拡張する「スキル」を投稿したりダウンロードしたりできる。これらのスキルは、スマートホームデバイスの制御、個人の財務管理、特定の企業ソフトウェアとの統合など、AIインテリジェンスが新たな機能を獲得することを可能にするブラウザのプラグインやモバイルアプリに似ている。このオープンモデルは、OpenClawのアプリケーションシナリオを大いに豊かにするが、同時に悪意のあるコードを拡散させる温床にもなる。

Moltbook:OpenClawと緊密に統合されたソーシャル・ネットワーキング・プラットフォーム。このプラットフォーム上では、OpenClaw上に構築された自律的なAI知能が、人間のユーザーと同じように、Redditのようなフォーラムで互いにコミュニケーションし、コンテンツを投稿し、交流することができる。このコンセプトは非常に革新的である一方、AIインテリジェンス同士がどのように安全に交流できるのか、また悪意のある情報の拡散をどのように防ぐのかについて、深い懸念を引き起こしている。

次の表は、OpenClawとそのエコシステムの主要コンポーネントとその機能をまとめたものです。

| アセンブリー | 類型論 | 機能説明 |

| オープンクロー | AIインテリジェント・ボディ・フレームワーク | 自然言語を理解し、自律的にタスクを計画・実行し、デジタル世界と対話する。 |

| クローハブ | 技能市場 | OpenClaw の機能を拡張するためのダウンロード可能なスキルを提供します。 |

| モルトブック | AIソーシャルネットワーク | OpenClawベースのAIインテリジェンスが社会的に交流し、情報を交換できるようにする。 |

コアとなるフレームワーク、スキル・マーケットプレイス、ソーシャル・ネットワークを組み合わせたこのエコロジー・モデルによって、OpenClawはツールとしてだけでなく、社会的属性を備えた複雑なテクノロジー・プラットフォームとして進化することができた。しかし、この複雑さとオープン性こそが、OpenClawをかつてないセキュリティ・リスクにさらしている。

2.オープンクローと生態系リスク

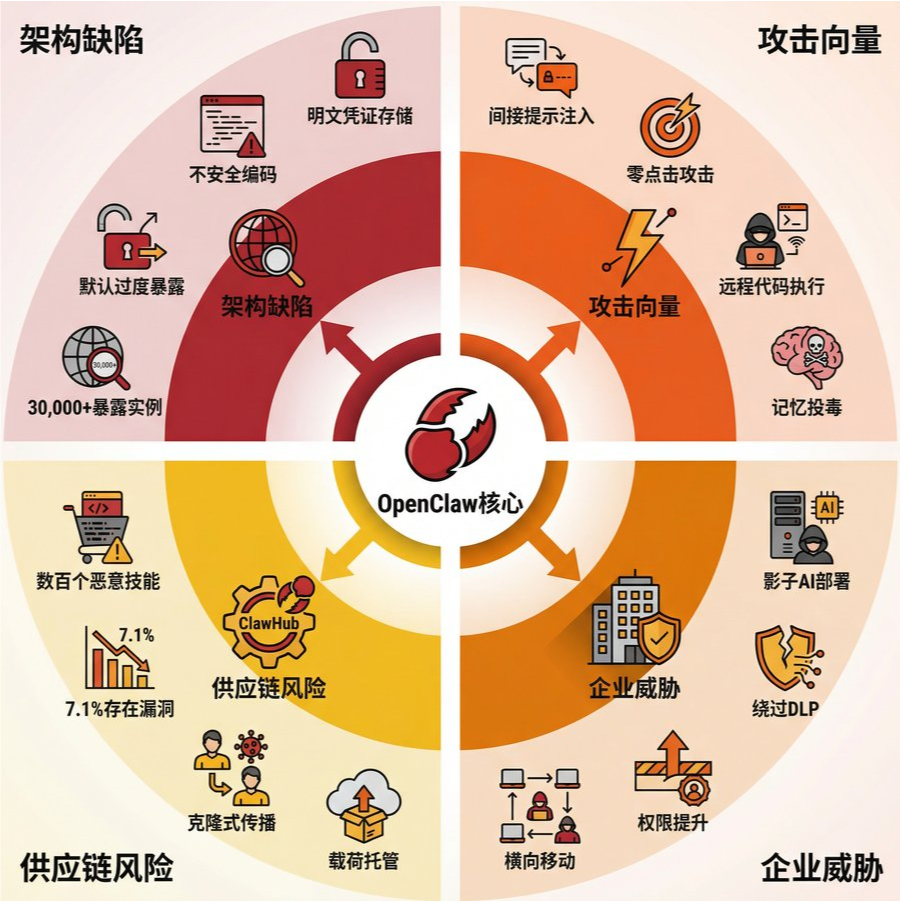

OpenClawの強力な機能とオープンなエコシステムは利便性をもたらす反面、多層的で高次元のセキュリティリスクをもたらします。これらのリスクは、独自のアーキテクチャの設計上の欠陥に起因するだけでなく、そのエコシステム、特にClawHubスキル市場において増幅され、複雑な攻撃対象領域を作り出している。さらに、企業環境における「シャドウ・デプロイメント」現象は、新たなガバナンスの課題を突きつけている。

2.1 アーキテクチャ・レベルのセキュリティ欠陥

基本的なアーキテクチャーに関して、OpenClawは、攻撃者に悪用される機会を提供するいくつかの深刻な設計および実装上の欠陥に悩まされている:

貧弱なクレデンシャル管理:複数のセキュリティレポートによると、OpenClawは初期のバージョンにおいて、APIキーやセッショントークンなどの機密性の高いクレデンシャルをクリアテキストで保存していました。この慣行により、攻撃者はユーザーのデジタル ID 全体を簡単に盗むことができ、ファイルシステムへのアクセス権を得ると、ユーザーに関連するすべてのオンラインサービスをコントロールすることができました。

安全でないコーディング手法:コード監査により、OpenClawではevalのような危険な関数を直接使用してユーザー入力を処理するパターンが確認されています。この安全でないコーディング方法は、コードインジェクション攻撃の扉を開き、攻撃者がAIインテリジェンスの実行環境で任意のコードを実行することを可能にします。

デフォルトの過剰な露出:OpenClaw のゲートウェイはデフォルトで 0.0.0.0:18789 にバインドされているため、そのホストのすべてのネットワークインターフェースにその API が完全に公開されている。Censys社によると、2026年2月8日現在、OpenClawの30,000以上のインスタンスが、公共のインターネットからグローバルにアクセス可能です。ほとんどのインスタンスでは対話するために認証トークンが必要ですが、デフォルトでこのように広く公開されているため、攻撃対象が大幅に増加し、誤った設定や脆弱なインスタンスが標的になりやすくなっています。

特権モデルとサンドボックス機構:HiddenLayerの研究者は、OpenClawがセキュリティの決定を設定された言語モデル(LLM)に依存しすぎており、デフォルトの特権モデルが甘すぎると批判している。ユーザーが積極的にDockerベースのツールのサンドボックス機能を設定し、有効にしない限り、AIインテリジェンスはシステムレベルのフルアクセスで実行される。これは、現代のソフトウェア・セキュリティが提唱する最小特権原則に反する。

2.2 複雑な攻撃ベクトルと脅威シナリオ

上記のアーキテクチャ上の欠陥に基づき、研究者はOpenClawに対する様々な巧妙な攻撃ベクトルを実証し、報告している:

間接的プロンプト・インジェクション:攻撃者は、AIインテリジェンスが処理する信頼できないコンテンツ(ウェブページ、文書、メッセージなど)に悪意のある命令を埋め込むことができます。AIがこのコンテンツを要約または分析するよう求められると、不注意にもこれらの悪意のある命令を実行してしまいます。典型的なケースは、ウェブページに埋め込まれたヒントインジェクションのペイロードが、OpenClawの内部ハートビート・ファイルに攻撃者の命令を追加するように仕向け、持続的な制御を可能にすることです。

ゼロクリック攻撃:さらに巧妙になると、攻撃者は「ゼロクリック」攻撃の連鎖を構築することができる。被害者のAIインテリジェンスが一見無害な文書を自動的に処理すると、隠されたヒントインジェクションのペイロードがトリガーされ、被害者のエンドポイントにバックドアが埋め込まれ、攻撃者はTelegramなどの外部チャネルを介してリモートで制御できるようになります。

One-Click Remote Code Execution (One-Click RCE): パッチされた脆弱性により、攻撃者はユーザーを騙して悪意のあるリンクをクリックさせ、ゲートウェイの制御インターフェースの WebSocket チャネルを活用して OpenClaw の認証トークンを開示し、最終的にホスト上で任意のコードを実行させることができます。

エコシステム内での横の動き:Moltbookプラットフォームでは、攻撃者はプラットフォームのソーシャルメカニズムを活用して悪意のあるコンテンツの拡散を増幅することができ、他のAIインテリジェンスに、データや暗号通貨を盗むために行動を操作できるヒントインジェクションを含む悪意のある投稿を訪問するよう指示することができる。Supabaseデータベースの設定ミスにより、150万個のAPI認証トークンと35,000個の電子メールアドレスが漏洩し、大規模な攻撃が行われた。

2.3 クローハブ技能市場におけるサプライチェーンのリスク

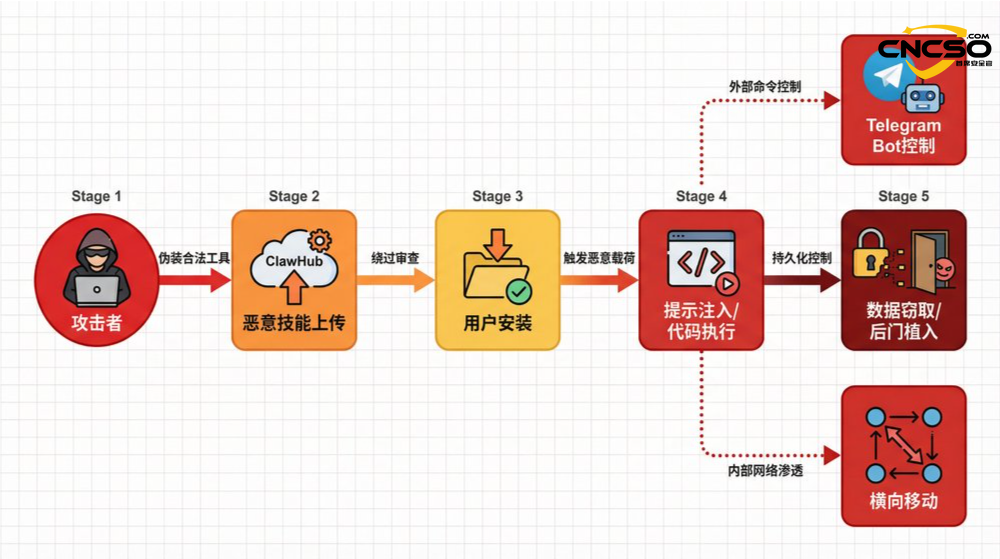

OpenClawの公式スキルマーケットプレイスであるClawHubは、そのエコシステムの中心にあるが、AIのサプライチェーン攻撃の被害も大きい。そのリスクプロファイルは以下の通りだ:

| リスク次元 | 明示的記述 |

| 悪意あるスキルの拡散 | セキュリティ研究者は、ClawHub上で何百もの悪意のあるスキルを発見しました。これらは、正規のツールを装っていますが、実際にはデータの窃盗、バックドアの埋め込み、マルウェアのインストールなどの悪意のある活動を実行します。 |

| セキュリティ上の欠陥の割合が高い | 約4,000のスキルを分析した結果、約7.1%のスキルに、LLMのコンテキスト・ウィンドウや出力ログに機密情報が平文で公開されるなど、深刻なセキュリティ脆弱性があることが判明した。 |

| 大規模な悪意ある活動 | Bitdefenderのレポートでは、攻撃者はしばしば正規のスキルをクローンし、小さな名前の亜種を通して再配布し、悪意のあるペイロードをホストするためにPastebinサービス(glot.ioなど)や公開GitHubリポジトリを使用し、大規模な攻撃のパターンを作成することが明らかになった。 |

セキュリティ研究者のイアン・アルが指摘するように、このオープンマーケットモデルのリスクは、従来のブラウザ拡張機能市場をはるかに超えている。AIインテリジェンスには、ユーザーのデジタルライフ全体にアクセスするための認証情報が付与されているため、悪意のあるAIスキルが1つでもあれば、そのインテリジェンスがアクセスできるすべてのシステムが危険にさらされ、潜在的な被害範囲ははるかに大きくなる可能性がある。

2.4 "影のAI "がもたらすコーポレート・ガバナンスの課題

OpenClawは強力で使いやすいため、従業員はIT部門やセキュリティ部門の承認なしに組織のネットワーク内でOpenClawを導入し、使用することができる。これは組織にとって深刻なガバナンス上の課題となる:

伝統的なセキュリティ制御のバイパス:こうした未承認のAIインテリジェンスは通常、昇格したシステム特権を持ち、ファイルアクセス、データ転送、ネットワーク接続を実行できるため、企業のデータ損失防止(DLP)、セキュリティエージェント、エンドポイント監視システムを完全にバイパスすることができる。

新たな攻撃の入り口の創出:SOCRadarのCISOであるEnsar Sekerが指摘するように、「インテリジェンス・プラットフォームがセキュリティ対策の成熟よりも早く流行すると、設定ミスが主要な攻撃対象となる」。公衆ネットワークに公開されたり、過度に寛容な権限で設定された「影の」AIインテリジェンスは、攻撃者が組織の内部ネットワークに侵入する足がかりとなり得る。

まとめると、OpenClawとそのエコシステムが直面するセキュリティリスクは、体系的かつ多次元的である。これは、セキュリティ設計におけるAIインテリジェントボディ技術の欠点を露呈しているだけでなく、オープンエコロジーとエンタープライズアプリケーションシナリオにおけるAIのサプライチェーンセキュリティとガバナンスが直面する全く新しい課題も明らかにしている。このような背景から、OpenClawは、厳しさを増す脅威の状況を緩和する観点から、外部セキュリティ機能の導入を決定した。

3.OpenClawに統合されたVirusTotalエンジンプログラム

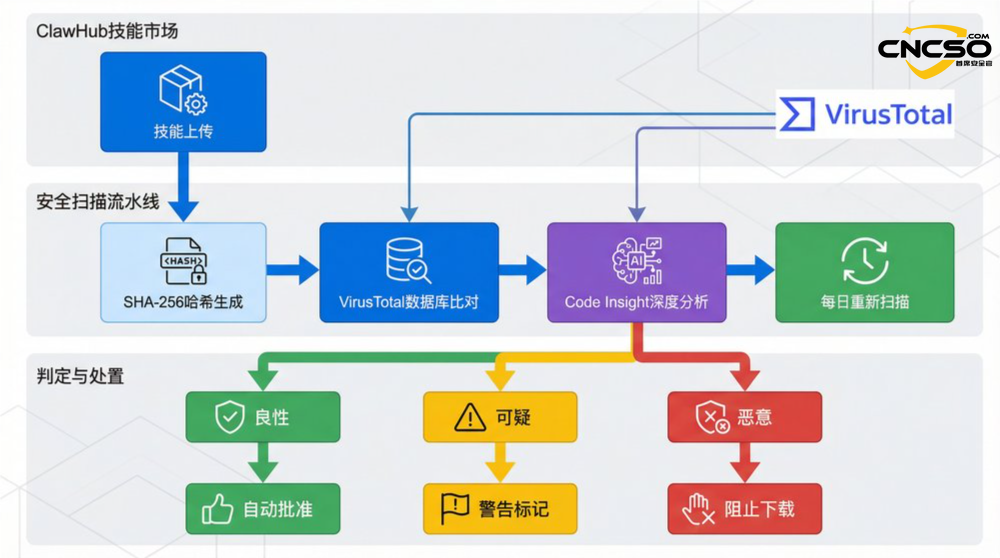

セキュリティの脅威が増大し、セキュリティに対するコミュニティーの懸念が広まる中、OpenClawプロジェクトサイドは、Googleが所有する有名な脅威インテリジェンスプラットフォームであるVirusTotalと提携し、ClawHubにアップロードされたすべてのスキルの強制的なセキュリティスキャンを実施するという重要なイニシアチブを取りました。このプログラムは、OpenClawエコシステムに悪意のあるスキルの拡散に対する重要なセキュリティ防御ラインを追加することを目的としています。

3.1 技術的実現プロセス

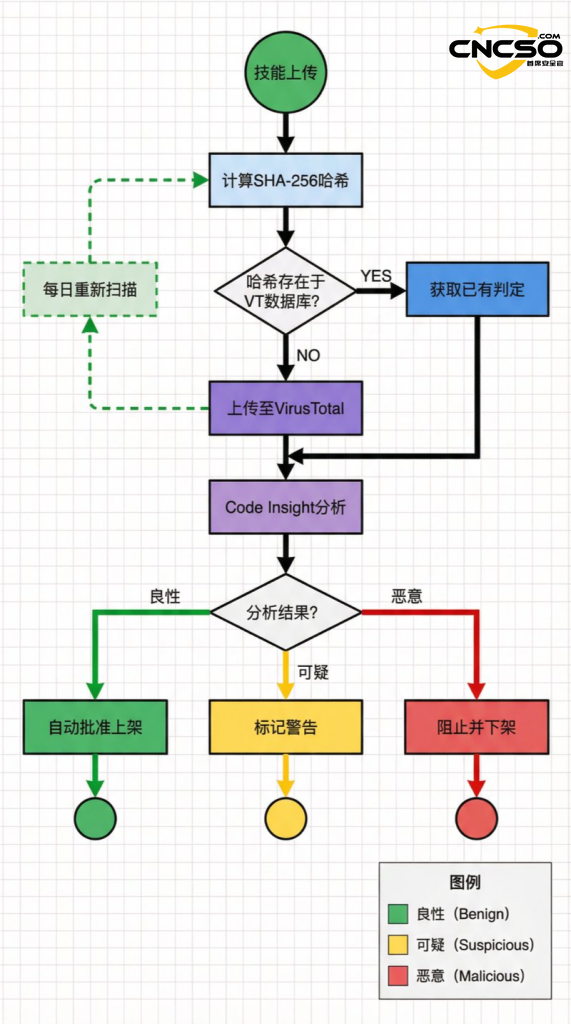

この統合ソリューションの中核は、自動化された多層の悪質コード検出パイプラインの確立にある。その技術的な実装プロセスは、以下の重要なステップに分けることができる:

1.ユニークなハッシュの生成:新しいスキルキットがClawHubにアップロードされると、システムはまずそのスキルキットにユニークなSHA-256ハッシュ値を計算します。このハッシュ値は、スキルパッケージのデジタル指紋として、その後の識別や比較に使用されます。

2.既存のインテリジェンスデータベースの比較:システムは、生成されたSHA-256ハッシュ値をVirusTotalのマルウェアサンプルの巨大なデータベースと相互参照します。ハッシュ値がすでにデータベースに存在し、悪意のあるものとしてマークされている場合、システムはより詳細な分析を行うことなく、迅速に判断を下すことができます。

3.ディープコード分析:VirusTotalのデータベースで一致するハッシュ値が見つからなかった場合、通常、それは新規ファイルまたは変更されたファイルであることを意味します。この時点で、システムは完全なスキルキットを VirusTotal プラットフォームにアップロードし、最新の Code Insight 機能を呼び出して詳細な分析を行います。 VirusTotal Code Insight は、大規模な言語モデルを活用してコードの動作を分析し、悪意のある可能性のある意図を特定することができます。従来のシグネチャベースのエンジンでは検出が困難な悪意のあるコードを検出します。

4.継続的な監視と再スキャン:セキュリティの脅威は動的なものであり、外部リソースやコードベースによっては、今日は無害と思われるスキルが、明日には脆弱性が発見されたり、悪意のあるコードが埋め込まれたりする可能性があります。このような状況に対処するため、OpenClaw のソリューションには継続的な監視メカニズムも含まれています。つまり、ClawHub のインベントリにあるすべてのアクティブなスキルを毎日再スキャンし、「ホワイトからブラックへ」のスキルをタイムリーに検出して廃棄することができます。

3.2 自動化された決定と廃棄のメカニズム

ClawHubはVirusTotalのスキャン結果に基づき、自動化された判定と処分のワークフローを確立し、異なるリスクレベルのスキルに対して差別化された管理戦略を保証しています:

| VirusTotal Code Insightの判定結果 | クローハブ廃棄対策 | ユーザー側の体験 |

| 良性 | ClawHubのスキルを自動的に承認します。 | ユーザーは普通にスキルを検索し、ダウンロードし、インストールすることができる。 |

| 疑わしい | スキルページに明らかな警告メッセージをマークする。 | ユーザーはダウンロードすることはできるが、そのスキルが潜在的に危険であり、その結果を負う必要があることを明確に知らされることになる。 |

| 悪意がある | 即座にスキルのダウンロードをブロックし、市場から削除する。 | ユーザーはスキルの検索やダウンロードができなくなります。 |

3.3 限界と必要な支援措置

強力な VirusTotal エンジンが統合されているとはいえ、OpenClaw のメンテナは、これがすべてのセキュリティ問題に対する「銀の弾丸」ソリューションではないことを認識しています。このソリューションにはまだ固有の限界があり、特に巧妙に隠されたヒント・インジェクションのペイロードに対処できない可能性があります。ヒント・インジェクション攻撃は、伝統的なコードの脆弱性ではなく、言語モデルの構文解析と実行ロジックを悪用するため、純粋なコード解析ツールでは検出が難しい場合があります。

そのため、OpenClaw プロジェクトチームは、VirusTotal の統合に加え、より包括的なセキュリティシステムを構築するために、多くの重要なサポートセキュリティ対策を計画しています。これらの対策には以下が含まれます:

-包括的な脅威モデルの公開:開発者やユーザーが潜在的なリスクポイントを理解するのに役立つよう、詳細な脅威モデルをコミュニティに公開する。

-公共安全ロードマップの策定:将来の安全機能の開発に関する明確な計画と優先順位、および透明性の向上。

-正式なセキュリティ報告プロセスを確立する: 脆弱性とリスクを報告するためのオープンなチャネルを、セキュ リティ研究者に提供する。

-包括的なコードベースのセキュリティ監査の実施:サードパーティのセキュリティ会社を招き、OpenClaw のコード全体を詳細に監査してもらう。

-ClawHubにユーザーレポート機能を追加し、ログインしているユーザーが不審なスキルにフラグを立て、報告できるようにした。

全体として、VirusTotalを統合するOpenClawのソリューションは、サプライチェーンセキュリティの課題に取り組むAIインテリジェンスのエコシステムにとって重要な前進である。技術的な実装の具体例を示しただけでなく、より重要なこととして、単一の技術的ソリューションではすべてのリスクを根絶することはできず、比較的安全で信頼できるAIエコシステムを構築するためには、透明性の高いガバナンス戦略、確立されたプロセス、および広範なコミュニティの関与によって補完されなければならないという深い理解を明らかにした。

4.結論と展望

オープンソースのAIインテリジェンス分野のパイオニアとして、OpenClawの開発の軌跡は、最先端技術の普及に必然的に伴う「成長の痛み」を鮮明に示している。その強力な自律性、オープンなエコシステム、バイラルな伝播速度が相まって、複雑なセキュリティ上の課題を構成している。その核心は、インテリジェンスの能力が高ければ高いほど、その悪用によって引き起こされる被害の範囲が大きくなるという事実にある。明示的に保存された認証情報から、デフォルトによる過剰なネットワーク露出、悪意あるスキルのサプライチェーン攻撃の横行まで、OpenClawが直面するリスクは、AI時代の「シャドーIT」とサプライチェーンセキュリティの問題を象徴している。

この文脈において、VirusTotalエンジンを統合するOpenClawの動きは、AIエコシステムのセキュリティガバナンスにおける重要な実践とみなすことができる。このプログラムは、自動化されたスキャニングとマルチレベルの廃棄メカニズムを通じて、スキル市場に根本的なセキュリティ障壁を設けることで、攻撃者のハードルを効果的に引き上げている。しかし、プロジェクトが認めているように、技術的なスキャンは、特にプロンプト・インジェクションのような高度な脅威の前では万能ではない。このことはAIセキュリティの分野では、純粋に技術的な防御をより広範なガバナンス戦略と組み合わせる必要がある。

今後、AIインテリジェント・エコシステムのセキュリティ構築は、以下の側面から体系的に進める必要がある:

1.左遷:AIインテリジェンス・フレームワークの初期開発段階に、セキュリティ設計原則を深く統合する。これには、必須のサンドボックス・メカニズム、厳格な権限制御、安全なクレデンシャル管理、信頼できない入力のフィルタリングとサニタイジングが含まれる。

2.サプライチェーンセキュリティの強化:従来のソフトウェアサプライチェーンセキュリティの経験に基づき、AIスキル市場により厳格なアクセス、審査、トレーサビリティの仕組みを確立する。例えば、開発者認証、コード署名、依存関係の脆弱性スキャンなどの手段を導入する。

3.AIネイティブな検知・防御技術の開発:キューインジェクションやモデルポイズニングといったAI特有の攻撃ベクトルに対応するため、新しい特殊な検知・防御技術を開発する必要がある。これには、モデルの入出力のリアルタイム監視、モデル動作の異常検知、AIの「赤と青の対決」メカニズムに対抗するためのAIの利用などが含まれる。

4.透明性のあるガバナンスとコミュニティーの協力体制の確立:OpenClawが計画しているように、脅威モデルの公開、セキュリティロードマップの一般公開、スムーズな脆弱性報告ルートの確立、コミュニティーの監視への参加促進は、信頼を築き、協力して脅威から身を守るための鍵となる。

結局のところ、OpenClawの事例は、AIインテリジェンスのセキュリティは単なる技術的な問題ではなく、生態学的なガバナンスの問題でもあることを教えてくれる。技術革新を受け入れる一方で、それに見合ったセキュリティの枠組み、ガバナンスシステム、コミュニティ文化の構築に同等かそれ以上の注意を払う必要がある。そうすることでしか、この強力なAIツールが攻撃者の手によって鋭利な刃物にされるのではなく、真に人類の幸福に役立つことを保証することはできないのだ。

5.参考文献

[1] Backslash Security. AI With Hands: The Rise of Agentic Trojan Horses. Backslash Security Blog.

[2] AIセキュリティ・コミュニティ。 (2026). Clawdbotエンタープライズ・インテリジェント・ボディ・アプリケーション・セキュリティ・ハードニング・ガイド

[3] Bustan, M. S. T., & Zadok, N. (2026 ). OpenClawのセキュリティ分析。

(2026 年 2 月 8 日). インターネットに公開された OpenClaw インスタンス。 センシスデータ。

[6] eSecurityPlanet. OpenClawのClawHubで数百の悪意あるスキルが発見される。

[7] AIセキュリティコミュニティ。 (2026). OpenClaw ワンクリックリモートコード実行脆弱性。

元記事はChief Security Officerによるもので、転載の際はhttps://www.cncso.com/jp/openclaw-integrates-virustotal-engine-scanning.html。