Generativ ab 2023Künstliche Intelligenz (KI)(Seit der Explosion der generativen KI hat sich die technologische Entwicklung von Large Language Models (LLMs) von der einfachen Textvervollständigung und dem Dialog zu agentenbasierter KI mit komplexen logischen Schlussfolgerungen entwickelt. Bis 2026 haben LLMs, die durch die Claude-Familie von Anthropic und die neue Generation von Modellen von OpenAI repräsentiert werden, signifikante Vorteile beim Code-Verständnis, der Kontextualisierung und der langfristigen Aufgabenplanung gezeigt.

Intelligente Körpersicherheit(Agentische KI-Sicherheit): bezieht sich auf die Sicherheit, die Kontrollierbarkeit und die Herausforderungen für bestehende Sicherheitsmaßnahmen, wenn KI-Entitäten mit autonomen Entscheidungs- und Werkzeugaufruffähigkeiten Aufgaben ausführen.

Derzeit beschränken sich große Modelle nicht mehr auf die statische Wissensabfrage, sondern sind in der Lage, komplexe Softwarearchitekturen und Geschäftslogik zu verstehen. Diese Verlagerung von der “probabilistischen Vorhersage” zur “tiefgreifenden Schlussfolgerung” bietet eine neue technologische Grundlage für die Lösung der seit langem bestehenden Null-Klick-Schwachstelle (Zero-click Vulnerability) und die komplexe Pfadanalyse der Remote Code Execution (RCE) im Bereich der Netzsicherheit. Die Pfadanalyse bietet eine neue technische Grundlage.

Große Modelle in der Sicherheit: Von Hilfsmitteln zum Kern der Verteidigung

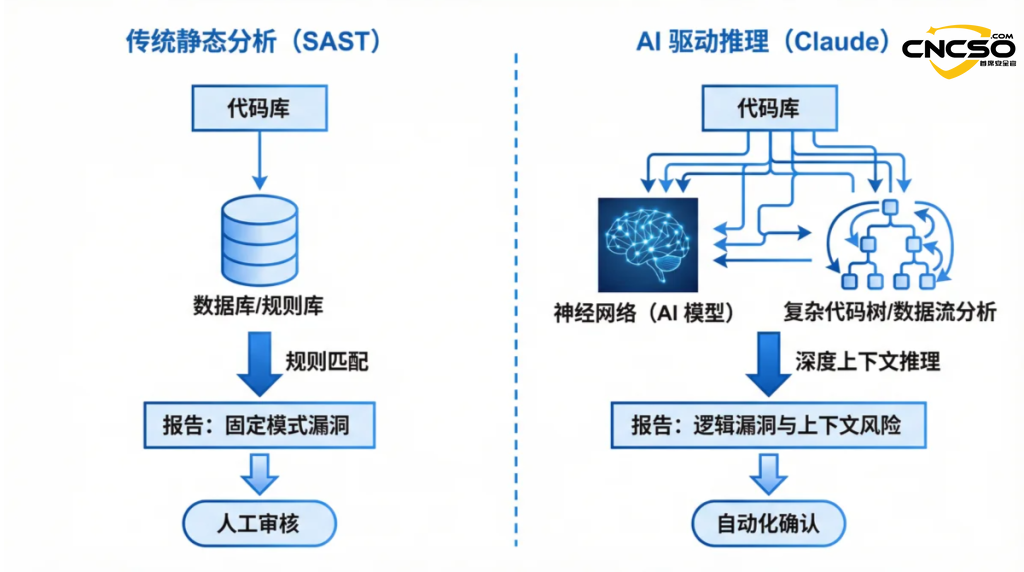

In der Praxis der Netzsicherheit vollzieht sich bei der Anwendung großer Modelle ein Wandel vom “Sicherheitsassistenten” zum “Sicherheitskern”. Das herkömmliche Sicherheitsabwehrsystem stützt sich in hohem Maße auf den Abgleich von Funktionscode und statische Regeln, was nicht ausreicht, um mit der schnellen Iteration polymorpher Malware und der komplexen Logik von Zero-Day-Schwachstellen fertig zu werden.

| Anwendungsdimension | traditionelles Modell | Großes modellgesteuertes Modell |

| Schwachstellenprüfung | Regelbasierte statische Analyse (SAST) | Tiefgreifendes Auditing auf der Grundlage kontextbezogener Schlussfolgerungen |

| Bedrohungsdaten | Manuelle Erfassung und strukturierte Verarbeitung | Automatisierte Zusammenführung und Beurteilung von Informationen aus mehreren Quellen |

| Code-Korrekturen | Entwickler schreiben Patches manuell | KI generiert und validiert automatisch Korrekturvorschläge |

| Angriffs- und Verteidigungsübung | Penetrationstests für voreingestellte Skripte | Autonome Intelligenz Körpergesteuerte Rot-Blau-Konfrontation |

Das große Modell ist in der Lage, subtile Logikfehler im Code zu erkennen, indem es aus der umfangreichen Codebasis und historischen Schwachstellendaten lernt. Bei nicht standardmäßigen Authentifizierungsprozessen oder komplexer Speicherverwaltungslogik kann die KI beispielsweise den Gedankengang eines Angreifers simulieren und tief verborgene Gefahren entdecken, die mit herkömmlichen Tools nur schwer zu erreichen sind.

Claude Code Sicherheit Programm: NeuerfindungSicherheit der Software-Lieferkette

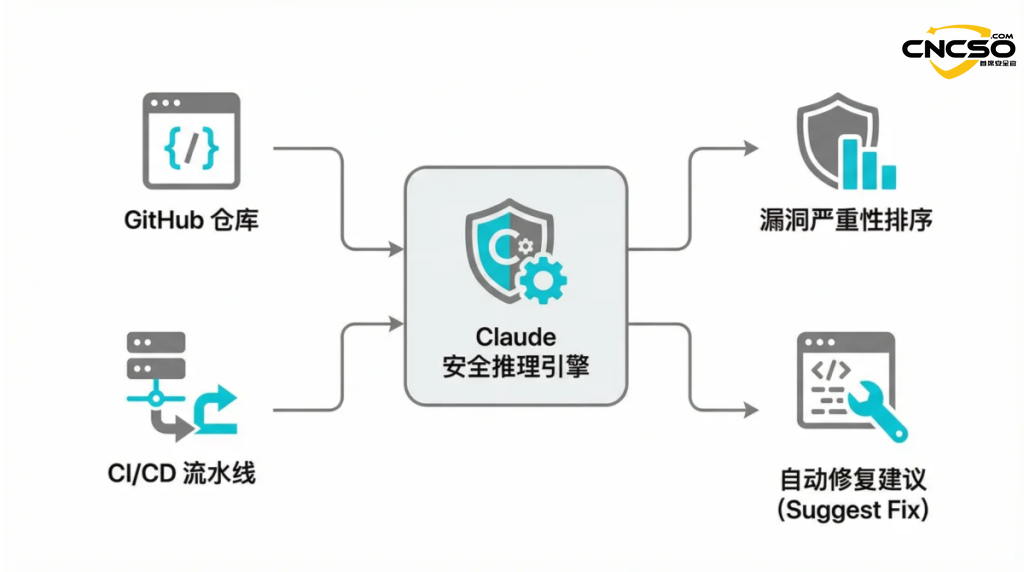

Am 20. Februar 2026 veröffentlichte Anthropic offiziell Claude Code Security, eine Lösung zur tiefgreifenden Analyse der Codesicherheit, die in die Editionen Claude Enterprise und Claude Team integriert ist. Im Gegensatz zu herkömmlichen statischen Sicherheitstests für Anwendungen (SAST) liegt der Kern der Lösung in den nativen Argumentationsfähigkeiten.

Anstatt sich auf eine Bibliothek mit vordefinierten Schwachstellensignaturen zu verlassen, ermöglicht Claude Code Security die Erkennung von Schwachstellen durch die folgenden Kernmechanismen:

Architektonische Kartierung:Baut automatisch die Topologie der Interaktionen zwischen Anwendungskomponenten auf und identifiziert potenzielle Angriffsflächen in allen Modulen.

Datenflussverfolgung (DFT):Echtzeit-Analyse des Flusspfades der Benutzereingabe innerhalb des Programms, wodurch gefährliche Eingabepunkte, die nicht desensibilisiert sind, genau identifiziert werden.

Geschlossene Kreislaufsanierung (CLR):Nach der Identifizierung einer Schwachstelle liefert das Modell nicht nur eine ausführliche Erklärung in natürlicher Sprache, sondern unterstützt auch die automatische Generierung von Patches über die Schaltfläche “Beheben mit einem Klick”.

Die Lösung, die jetzt auch die Integration mit führenden Code-Hosting-Plattformen wie GitHub unterstützt, soll die Grenzen von Shift-left Security erweitern und es Entwicklern ermöglichen, bereits in der Codierungsphase Feedback von Experten für Sicherheitsaudits zu erhalten.

Auswirkungen auf die Branche: Paradigmenwechsel auf den traditionellen Sicherheitsmärkten

Die Einführung von Claude Code Security hat die Kapitalmärkte erschüttert. Die Aktien traditioneller Sicherheitsriesen wie CrowdStrike und Cloudflare fielen am Tag der Einführung um mehr als 8%. Dieses Phänomen spiegelt die Besorgnis des Marktes überNative AI-Sicherheit(KI-native Sicherheit) untergräbt die hohen Erwartungen des traditionellen Schutzmodells.

Der Einfluss von Claude Code Security auf die Branchenlandschaft ist in drei Hauptbereichen zu spüren:

Toolchain-Integration:Herkömmliche eigenständige Scan-Tools könnten durch in Entwicklungsumgebungen integrierte KI-Intelligenzen ersetzt werden, und die Sicherheitserkennung wird zunehmend sensorlos und in Echtzeit erfolgen.

Die Verteidigungsschwelle wird gesenkt:KMUs können KI nutzen, um sich gegen komplexe logische Schwachstellen wie Auth Bypass zu schützen, ohne teure Sicherheitsexperten einstellen zu müssen.

Offensive und defensive Skalen neu gestaltet:Mit der zunehmenden Verbreitung von automatisierter KI wird sich das “Zeitfenster” zwischen der Entdeckung und der Ausnutzung einer Schwachstelle drastisch verkürzen, so dass Angreifer gezwungen sind, nach Angriffen höherer Ordnung zu suchen.

KI-gestützte Sicherheitslösungen sind jedoch nicht narrensicher. Halluzinationen von Modellen können zu Fehlalarmen führen, und die Genauigkeit der KI-Schlussfolgerungen ist bei hochgradig angepassten, geschlossenen Architekturen noch nicht bewiesen.

Beratung

Cybersecurity-Aktien fallen nach Anthropic debütiert Claude Code Security - SiliconANGLE, 2026.

Grenzwertige Cybersicherheitsfähigkeiten für Unternehmen verfügbar machen - Anthropic Official Blog, 2026.

2026 AI Security Report: Trends und Vorhersagen - Stellar Cyber, 2026.

Jenseits der statischen Analyse: KI-gestützte Erkennung von Schwachstellen - Medium Engineering, 2025.

Originalartikel von Chief Security Officer, bei Vervielfältigung bitte angeben: https://www.cncso.com/de/the-paradigm-shift-of-claude-code-security.html