1. 引言:Ollama与本地化AI的兴起

Ollama是一个开源框架,它允许开发者在个人计算机(Windows, macOS, Linux)或服务器上轻松下载、运行和管理各类大型语言模型。其核心价值在于简化了本地化AI的部署流程,使开发者能够快速搭建私有的、可定制的AI服务。默认情况下,Ollama服务仅绑定在本地回环地址(127.0.0.1:11434),确保其仅供本机访问。然而,一个看似微不足道的配置修改——将绑定地址改为0.0.0.0或任何公共网络接口——便会将其API完全暴露于公网之上。正是这一简单的错误配置,导致了此次大规模暴露事件的发生。

2. 暴露面分析:一个全球性的无主AI网络

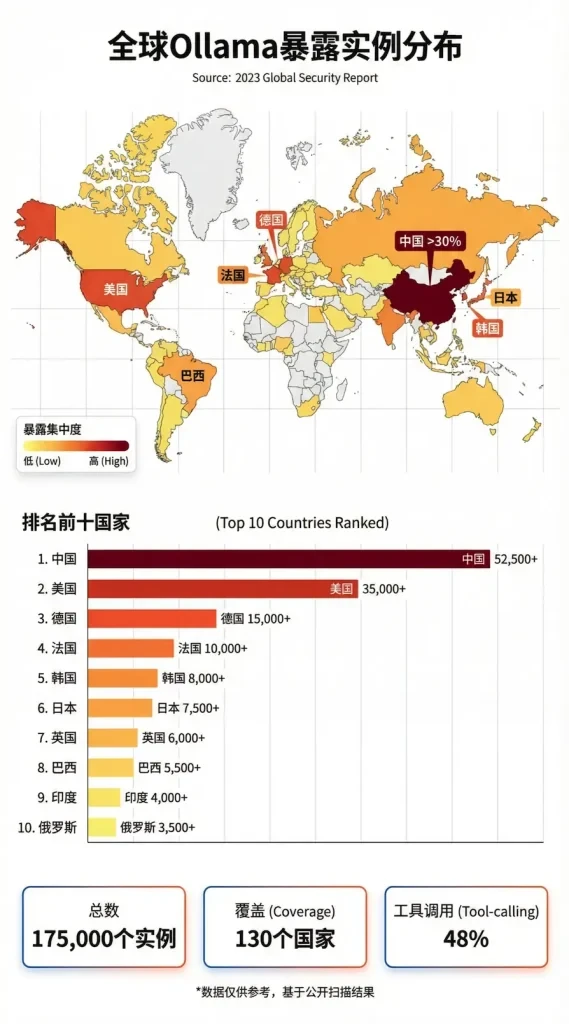

根据研究报告,此次发现的17.5万个暴露实例构成了一个前所未有的、跨越全球的“影子AI网络”。其规模和特征值得深入分析。

2.1 地理分布与网络环境

暴露的Ollama主机遍布全球130个国家,呈现出广泛的地理分布特征。其中,中国以超过30%的比例位居榜首,其次是美国、德国、法国、韩国等技术发达国家。这一分布表明,Ollama的流行是全球性的,但安全意识的普及并未跟上其部署的速度。

更值得关注的是,这些主机不仅存在于传统的云服务提供商(如AWS、Azure、Google Cloud)中,还大量分布在住宅宽带网络中。这种混合部署环境极大地增加了治理的复杂性,因为住宅网络通常缺乏企业级的安全监控和管理机制。

|

暴露实例主要分布国家

|

|

1. 中国 (>30%)

|

|

2. 美国

|

|

3. 德国

|

|

4. 法国

|

|

5. 韩国

|

|

6. 印度

|

|

7. 俄罗斯

|

|

8. 新加坡

|

|

9. 巴西

|

|

10. 英国

|

表1:公开暴露Ollama实例的Top 10国家分布

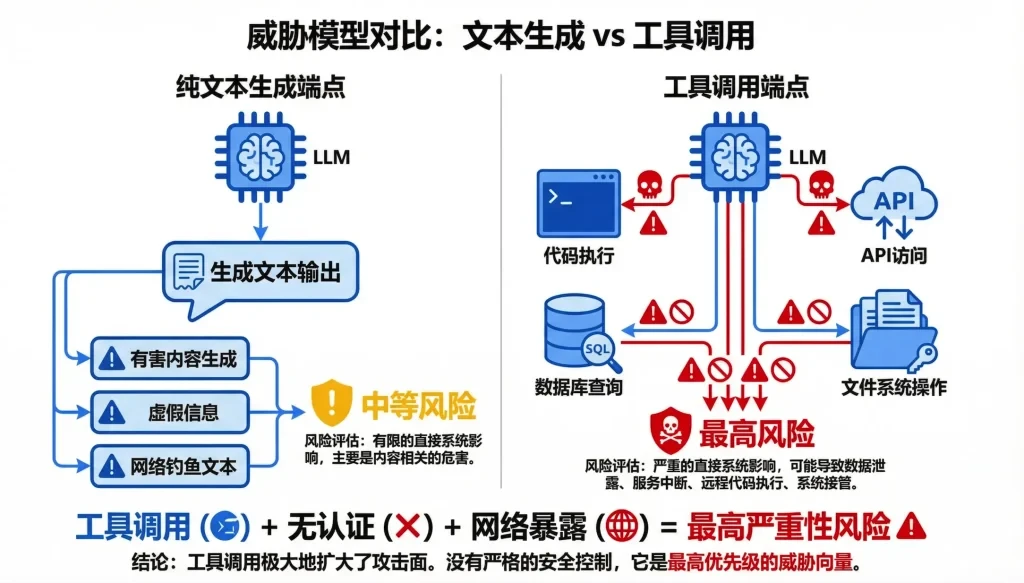

2.2 高风险能力:从文本生成到特权操作

报告中最令人警惕的发现是,在所有暴露的主机中,近一半(超过48%)启用了“工具调用”(Tool-calling)功能。工具调用,也称为函数调用(Function-calling),允许LLM与外部世界进行交互,例如执行本地代码、调用外部API、访问数据库或操作系统资源。这一能力从根本上改变了威胁模型。

“一个纯文本生成端点可以产生有害内容,但一个启用了工具的端点可以执行特权操作。当其与认证不足和网络暴露相结合时,便构成了我们评估中生态系统内最高严重性的风险。” —— SentinelOne研究人员

这意味着,攻击者不再仅仅是与一个聊天机器人对话,而是可能通过一个无密码保护的API,直接在受害者的机器上执行命令。此外,研究还发现201个主机运行着移除了安全护栏的”无审查”提示模板,这使得生成恶意内容或触发危险行为变得更加容易。

图2:文本生成端点与工具调用端点的威胁模型对比

3. 威胁模型与真实世界的攻击:LLMjacking

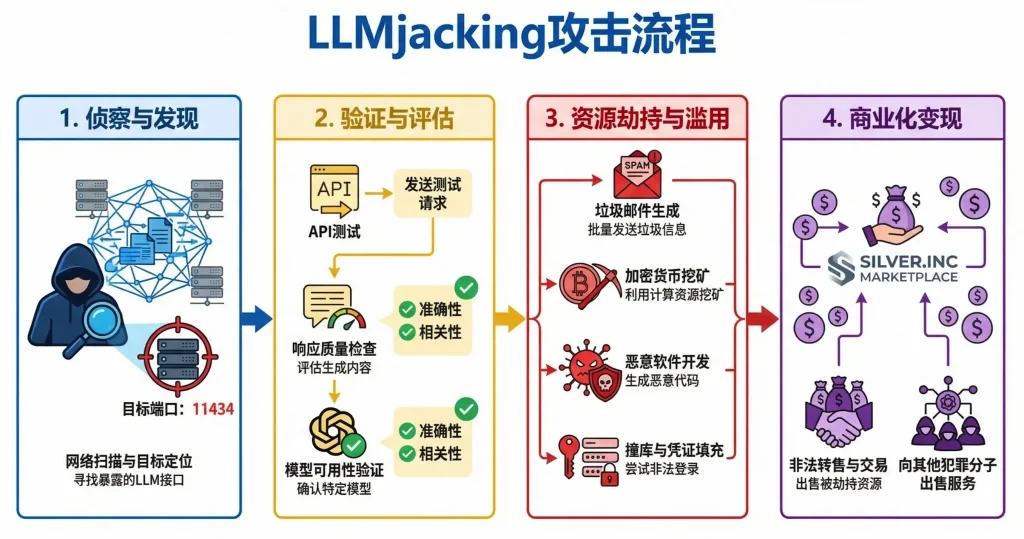

针对这些暴露的AI基础设施,一种名为“LLMjacking”的新型攻击应运而生。攻击者通过劫持受害者的LLM计算资源,服务于自身目的,而所有计算成本则由受害者承担。

3.1 LLMjacking攻击流程

LLMjacking攻击通常遵循一个标准流程,从未经授权的访问开始,到最终的资源滥用和商业变现。

1.侦察与发现:攻击者使用自动化工具(如masscan)大规模扫描互联网,寻找开放的Ollama默认端口(11434)或其他已知的AI服务端口。

2.验证与评估:在发现开放端口后,攻击者会发送测试请求,验证其是否为有效的、无认证的AI服务,并评估其性能和可用的模型。

3.资源劫持与滥用:一旦确认目标,攻击者便可以利用其计算资源执行各种恶意任务,包括:

•大规模内容生成:用于垃圾邮件、网络钓鱼、虚假信息宣传活动。

•加密货币挖矿:虽然LLM并非为挖矿优化,但在大规模劫持的情况下,仍可产生收益。

•恶意软件开发:利用AI辅助编写、混淆和变异恶意代码。

•暴力破解与凭证填充:生成密码字典或自动化尝试登录。

4.商业化变现:将劫持的AI访问权限打包,在暗网或专门的市场上作为一种”廉价AI算力”进行转售。

图3:LLMjacking攻击的完整流程

3.2 “Bizarre Bazaar行动”:LLMjacking的商业化实例

LLMjacking并非理论上的风险。Pillar Security的研究人员已经发现并归因了一个名为“Bizarre Bazaar行动”的真实攻击活动。该活动由一个名为“Hecker”(又名Sakuya、LiveGamer101)的威胁行为者运营,其创建了一个名为silver.inc的网站,作为一个统一的LLM API网关,公开售卖从互联网上劫持来的AI服务访问权限。

这个市场的运作模式清晰地展示了LLMjacking的完整产业链:从自动化的全网扫描,到服务质量验证,再到最终的商业化转售。这标志着针对AI基础设施的攻击已经从零散的个人行为演变为有组织的、以盈利为目的的犯罪活动。

4. 系统性风险与治理挑战

Ollama暴露事件揭示了分散式AI部署模式下深层次的系统性风险和治理挑战。

•治理鸿沟:暴露的主机横跨云端和住宅网络,使得传统的、基于边界的企业安全模型失效。安全团队无法对员工家中或未经报备的云实例进行有效监控和管理。

•新型攻击向量:这些无主AI节点为提示注入、数据投毒和模型污染等攻击提供了理想的试验场和跳板。攻击者可以利用这些节点代理恶意流量,隐藏其真实来源。

•供应链风险:启用了工具调用功能的Ollama实例,如果被用于企业内部的自动化流程,就可能成为攻击者渗透企业内网的入口点,构成严重的供应链安全风险。

•安全意识滞后:Ollama的易用性吸引了大量开发者,但许多人可能并未意识到简单的网络配置错误会带来如此严重的安全后果。技术普及与安全教育之间存在明显的脱节。

5. 缓解措施与安全建议

面对这一新型威胁,企业和个人开发者必须重新审视其AI部署策略,并采取严格的安全措施。

5.1 核心安全原则

将本地LLM视为特权服务:任何能够执行代码或与外部系统交互的AI服务,都应被视为与数据库或管理后台同等级别的关键基础设施,并施加相应的安全控制。

5.2 具体技术建议

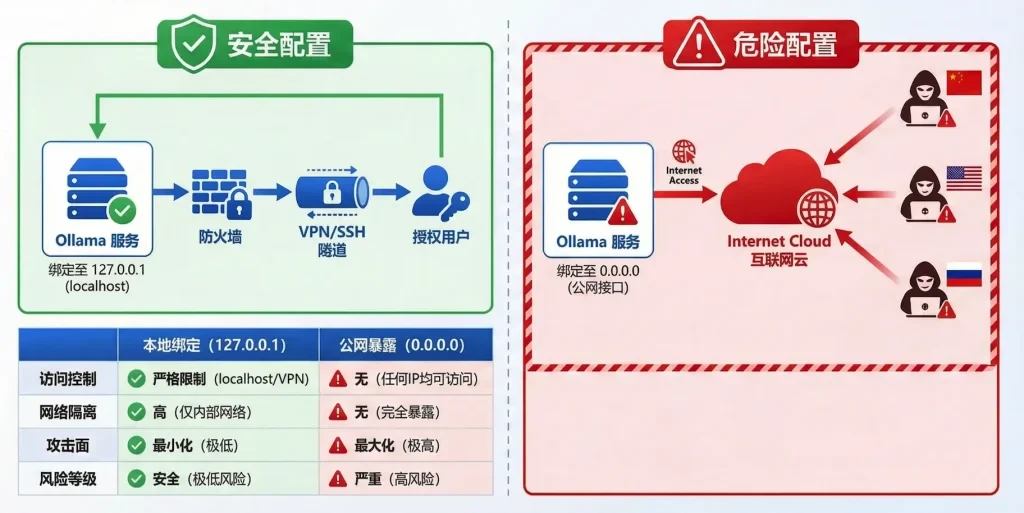

|

层面

|

建议措施

|

具体描述

|

|

网络层

|

坚持本地绑定

|

始终将Ollama服务绑定到127.0.0.1。如需远程访问,应使用安全的隧道技术(如VPN、SSH隧道、Tailscale、ZeroTier)而非直接暴露端口。

|

图4:安全配置与危险配置的对比架构

实施防火墙规则 :在主机和网络层面配置严格的防火墙规则,仅允许来自可信IP地址的流量访问AI服务端口。

应用层强制认证 :在Ollama前端部署一个反向代理(如Nginx、Caddy),并为其配置强制性的认证机制(如HTTP Basic Auth、OAuth2、客户端证书)。

API速率限制 :对API端点实施速率限制,防止暴力破解和拒绝服务攻击。

监控与审计:建立资产清单 企业应建立动态的AI资产清单,使用网络扫描工具定期发现内部和外部网络中未经授权的AI服务。

日志监控与告警 : 监控Ollama的访问日志和操作日志,对异常的访问模式(如来自未知IP的请求、高频次的API调用)设置告警。

配置管理 :安全基线制定并强制执行AI部署的安全配置基线,将安全配置纳入CI/CD流程进行自动化检查。

6. 结论

17.5万个Ollama实例的公开暴露事件,是AI时代“影子IT”问题的一次集中爆发。它清晰地表明,随着AI技术向边缘和个人设备下沉,传统的、中心化的安全治理模式正面临严峻挑战。攻击者已经开始系统化地利用这些无人看管的AI资源,形成了从侦察到变现的完整犯罪链条。

对于安全社区而言,这敲响了警钟。我们必须将AI基础设施,尤其是那些具备与外部世界交互能力的“代理”式AI,纳入最高级别的安全管控范围。对于广大开发者来说,拥抱开源和便利的同时,必须将安全左移,从部署的第一步起就建立起“默认安全”的思维模式。否则,今天为我们带来便利的AI助手,明天就可能成为引狼入室的特洛伊木马。

原创文章,作者:首席安全官,如若转载,请注明出处:https://www.cncso.com/ai-ollama-attack-surface-analysis-report.html