1. OpenClaw介绍

OpenClaw,其前身为Moltbot和Clawdbot,是一个开源的智能体AI助手(Agentic AI Assistant)。它被设计为一个高度可扩展的自动化引擎,能够理解自然语言指令,并自主地执行一系列复杂任务,例如触发工作流、与各类在线服务进行交互以及在不同设备间进行操作。由于其能够直接“动手”与数字世界交互,安全研究机构Backslash Security形象地将其描述为“有手的AI”(AI With Hands)。

OpenClaw的核心架构赋予了其强大的自主决策和执行能力。它不仅能够解析用户意图,还能动态规划并执行任务步骤,模糊了传统软件中用户意图与机器执行之间的明确界限。这种能力使其在开发者和高级用户社区中迅速流行,被广泛应用于从个人助理到复杂企业自动化的多种场景中。

伴随OpenClaw的兴起,一个独特的生态系统也应运而生,其主要由两部分构成:

ClawHub: 这是一个官方的技能市场(Skill Marketplace),用户可以在此发布或下载用于扩展OpenClaw功能的“技能”。这些技能类似于浏览器插件或移动应用,能够让AI智能体获得新的能力,如控制智能家居设备、管理个人财务或集成特定的企业软件。这种开放的模式极大地丰富了OpenClaw的应用场景,但也为恶意代码的传播提供了温床。

Moltbook: 这是一个与OpenClaw紧密集成的社交网络平台。在这个平台上,基于OpenClaw构建的自主AI智能体可以像人类用户一样,在类似Reddit的论坛中相互交流、发布内容和互动。虽然这一概念极具创新性,但也引发了关于AI智能体之间如何安全互动以及如何防止恶意信息传播的深刻担忧 。

下表总结了OpenClaw及其生态系统的关键组成部分及其功能。

| 组件 | 类型 | 功能描述 |

| OpenClaw | AI智能体框架 | 理解自然语言,自主规划并执行任务,与数字世界交互。 |

| ClawHub | 技能市场 | 提供可下载的技能,用于扩展OpenClaw的功能。 |

| Moltbook | AI社交网络 | 允许基于OpenClaw的AI智能体进行社交互动和信息交换。 |

这种集核心框架、技能市场和社交网络于一体的生态模式,使得OpenClaw不仅是一个工具,更演变为一个复杂的、具有社会属性的技术平台。然而,正是这种复杂性和开放性,使其面临着前所未有的安全风险。

2. OpenClaw及生态风险

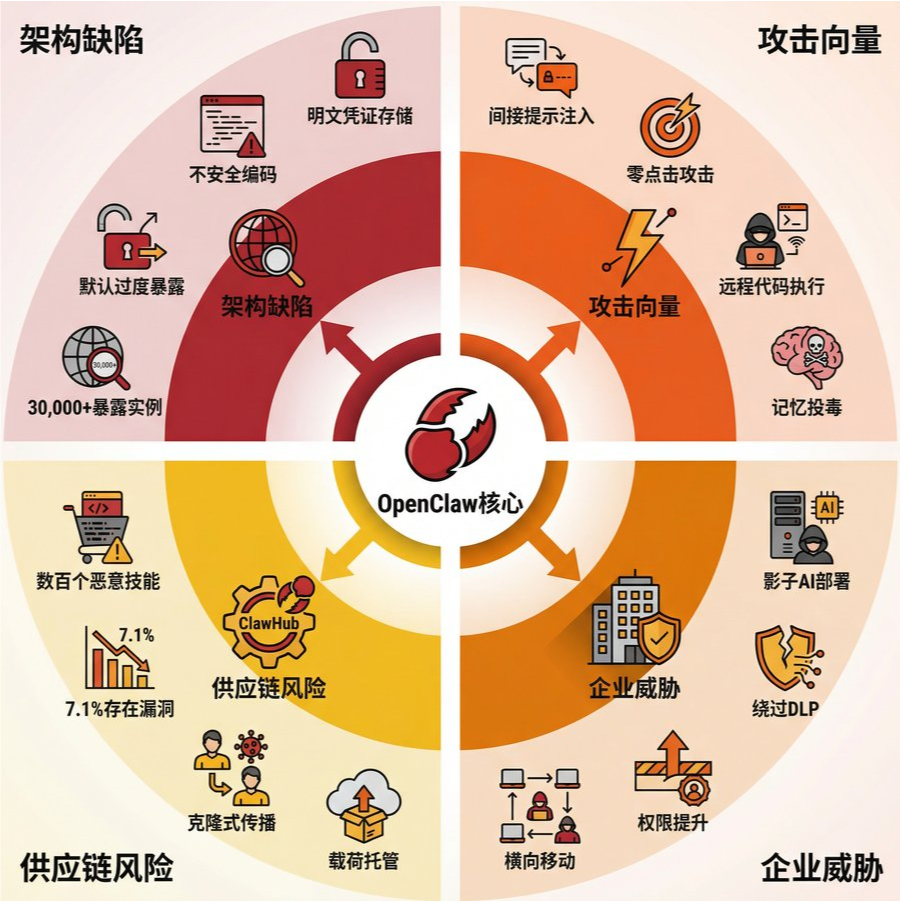

OpenClaw的强大功能和开放生态在带来便利的同时,也引入了多层次、高维度的安全风险。这些风险不仅源于其自身架构的设计缺陷,更在其生态系统,特别是ClawHub技能市场中被放大,形成了一个复杂的攻击面。此外,其在企业环境中的“影子部署”现象也带来了新的治理挑战。

2.1 架构层面的安全缺陷

从底层架构来看,OpenClaw存在若干严重的设计和实现缺陷,这些缺陷为攻击者提供了可乘之机:

凭证管理不善:多个安全报告指出,OpenClaw在其早期版本中以明文形式存储API密钥和会话令牌等敏感凭证 。这种做法使得一旦攻击者获得对文件系统的访问权限,就能轻易窃取用户的全部数字身份,进而控制其关联的所有在线服务。

不安全的编码实践:代码审计发现,OpenClaw中存在直接使用eval等危险函数处理用户输入的模式。这种不安全的编码实践为代码注入攻击打开了大门,允许攻击者在AI智能体的执行环境中运行任意代码。

默认的过度暴露:OpenClaw的网关默认绑定到0.0.0.0:18789,这意味着其完整的API会暴露在主机的所有网络接口上。根据Censys的数据,截至2026年2月8日,全球有超过30,000个OpenClaw实例可从公共互联网访问 。尽管大多数实例需要认证令牌才能交互,但这种默认的广泛暴露极大地增加了攻击面,使配置错误或存在漏洞的实例成为唾手可得的目标。

权限模型与沙箱机制:HiddenLayer的研究人员批评指出,OpenClaw在安全决策上过度依赖其配置的语言模型(LLM),而其默认的权限模型过于宽松 。除非用户主动配置并启用基于Docker的工具沙箱功能,否则AI智能体将以完整的系统级访问权限运行。这与现代软件安全所倡导的“最小权限原则”背道而驰。

2.2 复杂的攻击向量与威胁场景

基于上述架构缺陷,研究人员已经演示并报告了多种针对OpenClaw的复杂攻击向量:

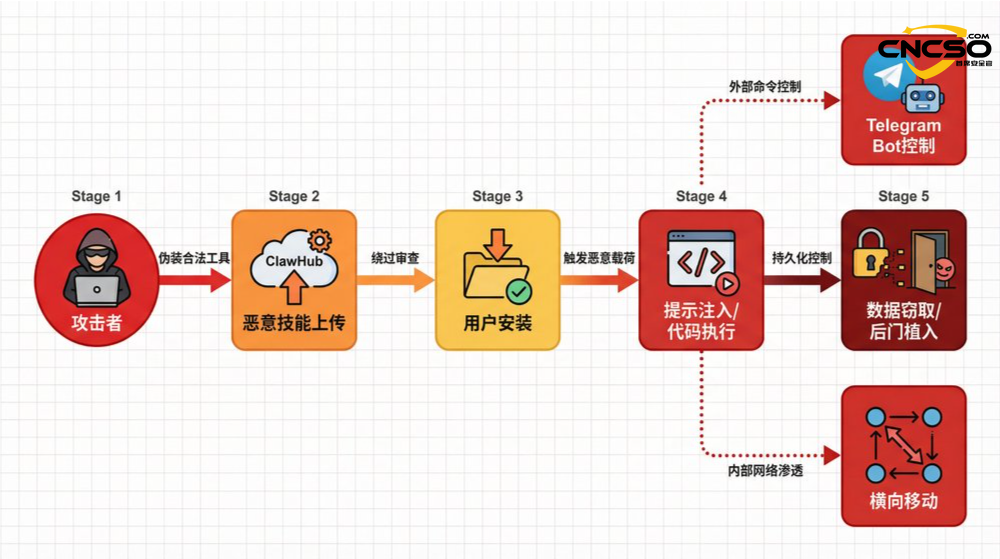

间接提示注入(Indirect Prompt Injection):攻击者可以将恶意指令嵌入到AI智能体将要处理的非受信内容中(如网页、文档或消息)。当AI智能体被要求总结或分析这些内容时,它会无意中执行这些恶意指令。一个典型案例是,一个嵌入在网页中的提示注入载荷,可以诱导OpenClaw将攻击者的指令追加到其内部心跳文件中,从而实现持久化控制 。

零点击攻击(Zero-Click Attack):更为复杂的是,攻击者可以构建一个“零点击”攻击链。当受害者的AI智能体自动处理一个看似无害的文档时,其中隐藏的提示注入载荷会被触发,从而在受害者端点上植入后门,允许攻击者通过Telegram等外部渠道进行远程控制。

一键式远程代码执行(One-Click RCE):一个已被修复的漏洞允许攻击者通过诱骗用户点击一个恶意链接,利用网关控制界面的WebSocket信道泄露OpenClaw的认证令牌,并最终在主机上实现任意代码执行 。

生态系统内的横向移动:在Moltbook平台上,攻击者可以利用平台的社交机制,放大恶意内容的传播范围,引导其他AI智能体访问包含提示注入的恶意帖子,从而操纵它们的行为,窃取数据或加密货币。一个配置错误的Supabase数据库甚至导致了150万个API认证令牌和35,000个电子邮件地址的泄露,为大规模攻击提供了便利 。

2.3 ClawHub技能市场的供应链风险

ClawHub作为OpenClaw的官方技能市场,是其生态系统的核心,但也成为了AI供应链攻击的重灾区。其风险特征如下:

| 风险维度 | 具体描述 |

| 恶意技能泛滥 | 安全研究人员在ClawHub上发现了数百个恶意技能,这些技能伪装成合法工具,实则执行数据窃取、后门植入或恶意软件安装等恶意活动 。 |

| 高比例安全缺陷 | 一项针对近4000个技能的分析显示,约7.1%的技能存在严重安全漏洞,例如在LLM的上下文窗口或输出日志中以明文形式暴露敏感凭证 。 |

| 规模化的恶意活动 | Bitdefender的报告揭示,攻击者常常克隆合法的技能,通过微小的名称变体重新发布,并利用Pastebin服务(如glot.io)或公共GitHub仓库来托管其恶意载荷,形成了规模化的攻击模式 。 |

这种开放市场模式下的风险,正如安全研究员Ian Ahl所指出的,远超传统的浏览器扩展市场。因为AI智能体被授予了访问用户整个数字生活的凭证,一个恶意的AI技能可能危及该智能体所能访问的所有系统,其潜在的破坏半径要大得多 。

2.4 “影子AI”带来的企业治理挑战

由于OpenClaw的强大功能和易用性,员工可能在未经IT或安全部门批准的情况下,在企业网络内部署和使用它,这种现象被称为“影子AI”(Shadow AI)。这给企业带来了严峻的治理挑战:

绕过传统安全控制:这些未经授权的AI智能体通常拥有较高的系统权限,能够进行文件访问、数据传输和网络连接,完全绕过了企业的数据丢失防护(DLP)、安全代理和端点监控体系。

创造新的攻击入口:如SOCRadar的CISO Ensar Seker所言,“当智能体平台的病毒式传播速度快于安全实践成熟时,配置错误成为主要攻击面” 。一个暴露在公网或配置了过度宽松权限的“影子”AI智能体,就可能成为攻击者渗透企业内部网络的跳板。

综上所述,OpenClaw及其生态系统所面临的安全风险是系统性的、多维度的。它不仅暴露了AI智能体技术在安全设计上的不足,也揭示了在开放生态和企业应用场景下,AI供应链安全和治理所面临的全新挑战。正是在这一背景下,OpenClaw决定引入外部安全能力,以期缓解日益严峻的威胁态势。

3. OpenClaw集成VirusTotal引擎方案

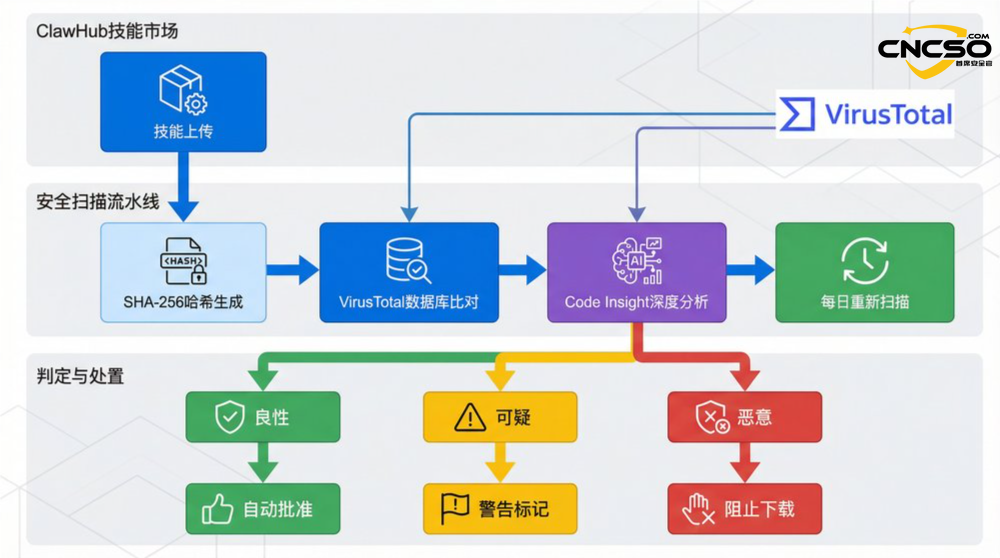

面对日益严峻的安全威胁和社区对安全问题的广泛关注,OpenClaw项目方采取了一项关键举措:与Google旗下的知名威胁情报平台VirusTotal合作,对上传至ClawHub的所有技能进行强制性安全扫描。这一方案旨在为OpenClaw生态系统增加一道关键的安全防线,以应对恶意技能的传播。

3.1 技术实现流程

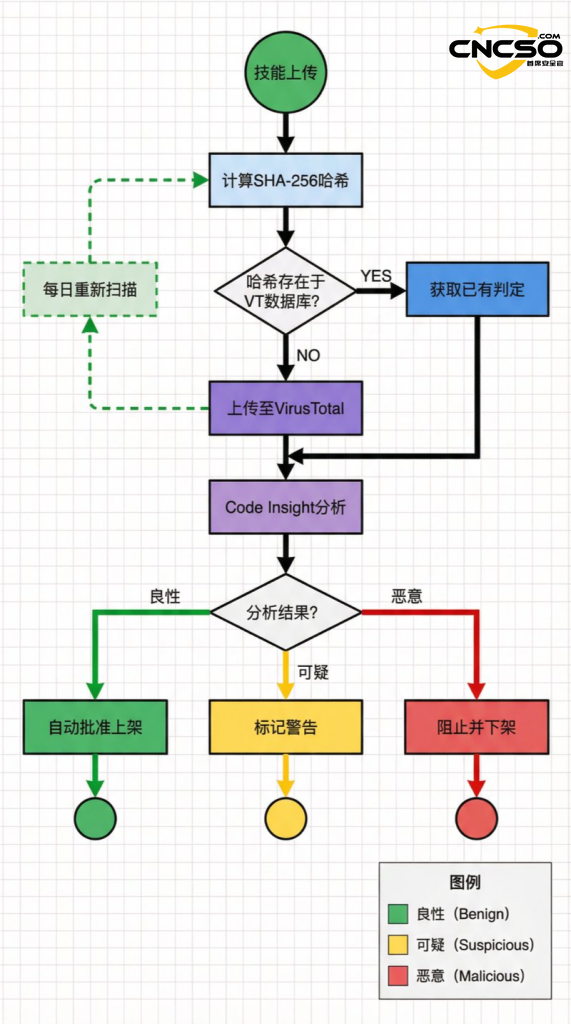

该集成方案的核心在于建立一个自动化的、多层次的恶意代码检测流水线。其技术实现流程可以分解为以下几个关键步骤:

1.唯一哈希生成:当一个新技能包被上传到ClawHub时,系统会首先为其计算一个唯一的SHA-256哈希值。这个哈希值作为该技能包的数字指纹,用于后续的识别和比对。

2.现有情报库比对:系统将生成的SHA-256哈希值与VirusTotal庞大的恶意软件样本数据库进行交叉比对。如果该哈希值在数据库中已存在并被标记为恶意,系统可以迅速做出判断,无需进行更深入的分析。

3.深度代码分析:如果在VirusTotal的数据库中未找到匹配的哈希值,这通常意味着这是一个全新的或经过修改的文件。此时,系统会将完整的技能包上传至VirusTotal平台,并调用其最新的Code Insight功能进行深度分析。VirusTotal Code Insight利用大型语言模型来分析代码行为,能够识别潜在的恶意意图,这对于检测传统基于签名的引擎难以发现的新型或混淆的恶意代码尤为重要。

4.持续监控与重新扫描:安全威胁是动态变化的,一个今天看起来无害的技能,其依赖的外部资源或代码库明天可能被发现存在漏洞或被植入恶意代码。为了应对这种情况,OpenClaw的方案还包括一个持续监控机制,即对ClawHub上所有存量的活跃技能进行每日重新扫描,以确保能够及时发现和处置那些“由白变黑”的技能。

3.2 自动化判定与处置机制

基于VirusTotal的扫描结果,ClawHub建立了一套自动化的判定与处置工作流,以确保对不同风险等级的技能采取差异化的管理策略:

| VirusTotal Code Insight 判定结果 | ClawHub 处置措施 | 用户侧体验 |

| 良性 (Benign) | 自动批准该技能在ClawHub上架。 | 用户可以正常搜索、下载和安装该技能。 |

| 可疑 (Suspicious) | 在技能页面上标记明显的警告信息。 | 用户仍然可以下载,但会被明确告知该技能存在潜在风险,需要自行承担后果。 |

| 恶意 (Malicious) | 立即阻止该技能的下载,并将其从市场下架。 | 用户将无法搜索到或下载该技能。 |

3.3 局限性与必要的配套措施

尽管集成了强大的VirusTotal引擎,但OpenClaw的维护者清醒地认识到,这并非解决所有安全问题的“银弹”(silver bullet)。该方案依然存在其固有的局限性,其中最主要的是对巧妙隐藏的提示注入载荷可能无能为力。因为提示注入攻击利用的是语言模型的解析和执行逻辑,而非传统的代码漏洞,所以纯粹的代码分析工具可能难以有效检出。

因此,除了集成VirusTotal之外,OpenClaw项目方还规划了一系列重要的配套安全措施,以构建一个更全面的安全体系。这些措施包括:

•发布综合威胁模型:向社区公开详细的威胁模型,帮助开发者和用户理解潜在的风险点。

•制定公共安全路线图:明确未来的安全功能开发计划和优先级,增加透明度。

•建立正式的安全报告流程:为安全研究人员提供一个通畅的漏洞和风险报告渠道。

•进行全面的代码库安全审计:邀请第三方安全公司对OpenClaw的全部代码进行深入审计。

•强化社区监督机制:在ClawHub上增加了用户举报功能,允许登录用户标记和报告可疑技能,利用社区的力量共同监督生态安全。

总而言之,OpenClaw集成VirusTotal的方案,是AI智能体生态系统在应对供应链安全挑战方面迈出的重要一步。它不仅提供了一个具体的技术实现范例,更重要的是,它揭示了一个更深层次的认知:单一的技术解决方案无法根除所有风险,必须辅以透明的治理策略、完善的流程和广泛的社区参与,才能构建一个相对安全和可信的AI生态。

4. 结论与展望

OpenClaw作为开源AI智能体领域的先驱,其发展轨迹生动地展示了前沿技术在普及过程中所必然伴随的“生长痛”。其强大的自主性、开放的生态和病毒式的传播速度,共同构成了一个复杂的安全挑战,其核心在于,智能体的能力越大,其被滥用时所造成的破坏半径也越大。从明文存储凭证到默认的过度网络暴露,再到猖獗的恶意技能供应链攻击,OpenClaw所面临的风险是AI时代“影子IT”和供应链安全问题的一个缩影。

在此背景下,OpenClaw集成VirusTotal引擎的举措,可以被视为AI生态安全治理的一次重要实践。该方案通过自动化扫描和多级处置机制,为技能市场建立了一道基础的安全屏障,有效地提高了攻击者的门槛。然而,正如项目方所承认,技术扫描并非万能,尤其是在面对高级威胁如提示注入时。这凸显了在AI安全领域,纯粹的技术防御必须与更广泛的治理策略相结合。

展望未来,AI智能体生态系统的安全建设需要从以下几个方面系统性地推进:

1.安全左移(Shift Left):将安全设计原则深度融入AI智能体框架的初始开发阶段。这包括强制性的沙箱机制、严格的权限控制、安全的凭证管理以及对不可信输入的过滤和净化。

2.强化供应链安全:借鉴传统软件供应链安全的经验,为AI技能市场建立更严格的准入、审查和溯源机制。例如,引入开发者身份验证、代码签名以及依赖项漏洞扫描等措施。

3.发展AI原生的检测与防御技术:针对提示注入、模型中毒等AI特有的攻击向量,需要研发新的、专门的检测和防御技术。这可能涉及到对模型输入输出的实时监控、对模型行为的异常检测,以及利用AI来对抗AI的“红蓝对抗”机制。

4.建立透明的治理与社区协作:正如OpenClaw所规划的,发布威胁模型、公开安全路线图、建立通畅的漏洞报告渠道,并鼓励社区参与监督,是建立信任和共同抵御威胁的关键。

最终,OpenClaw的案例告诉我们,AI智能体的安全不仅仅是技术问题,更是一个生态治理问题。它要求我们在拥抱技术创新的同时,必须以同等甚至更高的重视程度,去构建与之相匹配的安全框架、治理体系和社区文化。只有这样,我们才能确保这些强大的AI工具真正服务于人类的福祉,而非沦为攻击者手中的利刃。

5. 参考引用

[2] AI安全社区. (2026). Clawdbot企业级智能体应用安全加固指南

[3] Bustan, M. S. T., & Zadok, N. (2026 ). OpenClaw Security Analysis. OX Security Research.

[4] Censys. (2026, February 8). Internet-Exposed OpenClaw Instances. Censys Data.

[7] AI安全社区. (2026). OpenClaw One-Click 远程代码执行漏洞.

原创文章,作者:首席安全官,如若转载,请注明出处:https://www.cncso.com/tw/openclaw-integrates-virustotal-engine-scanning.html